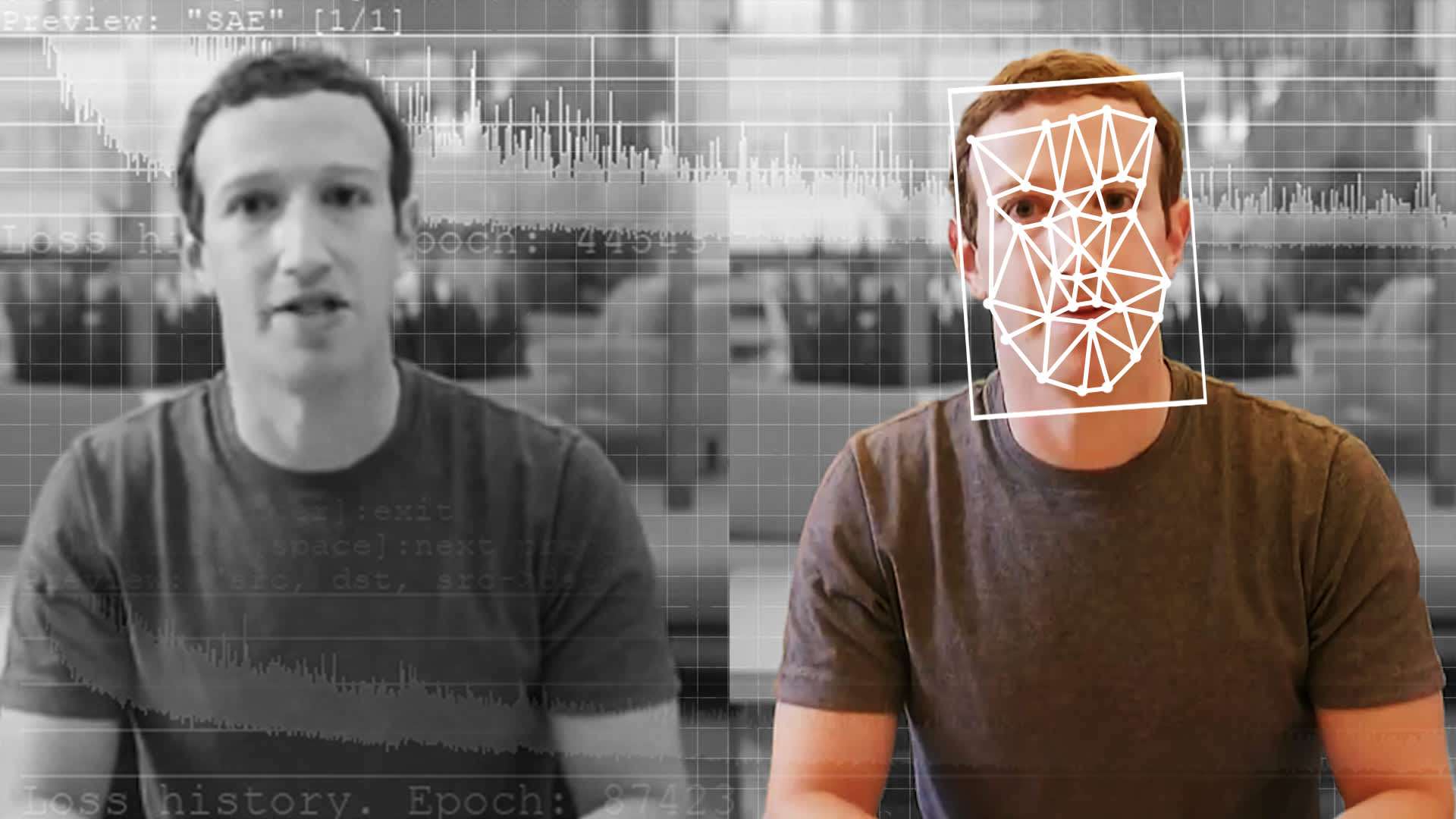

Vîdyoyên Mark Zuckerberg ku diziya daneyan qebûl dike û Barack Obama destdirêjiya Donald Trump dike, ev demek dirêj e li ser înternetê belav bûne?

Van vîdyoyan encama teknolojiya AI-ya pir pêşkeftî û paşerojê ya bi navê Deepfake ne.

Bi hêsanî, ew ji bo vîdyoyê alternatîfek photoshop e. Ji aliyekî ve, ew dikare bi rakirina hewcedariya kesek rastîn şoreşek medya elektronîkî bike.

Ji hêla din ve, ew bi tundî nasnameya yekî tehdîd dike ji ber ku hûn dikarin kesek bihêlin ku li ser vîdyoyê tiştek bêje.

Deepfakes bikar tînin hînbûna kûr ji bo afirandina wêne û vîdyoyên bûyerên sexte, ji ber vê yekê navê deepfake. Ew ne tenê dikare rûyên li ser vîdyoyên heyî biguhezîne lê di heman demê de çarçove û vîdyoyên nû jî ji nû ve biafirîne.

Origin of Deepfakes

Dirêjkirî lêkolînek akademîk di van çend salên borî de sînorên manîpulasyona wêne û vîdyoyê derbas kiriye. Deepfake jî encama van lêkolînên akademîk e.

Bûyera yekem a manîpulasyona vîdyoyê di sala 1997 de hate ragihandin. Vîdyoyek kesek hate guheztin da ku peyvên ku di şopek dengek cûda de hene biaxive. Ew yekem doza vejîna rû bi kar bû fêrbûna makîneyê teknîkî

Pêşveçûnek din a girîng di sala 2017-an de hate çêkirin dema ku vîdyoyek serokê berê yê Dewletên Yekbûyî Barack Obama hate guheztin da ku peyvên cihêreng bêje ku bi rêgezek dengî ya cûda re têkildar in.

Di sala 2018-an de, lêkolînerên li Zanîngeha California, Berkeley, serîlêdanek destnîşan kirin ku dikare a Vîdyoya dansê ya sexte ku fêrbûna kûr bikar tîne. Ev nîşana berfirehbûna kûrahiyên li seranserê laş kir ji ber ku karên berê bi rûyan re sînordar bûn.

Deepfakes çawa têne afirandin?

Bi saya pêşkeftinên di komputerê de, hûn naha dikarin kûrahiyên kûr bi hêsanî û bi lêçûnek kêm pêşve bibin. Du rêbazên sereke têne bikar anîn ku ji bo afirandina kûrahiyên kûr.

Method 1

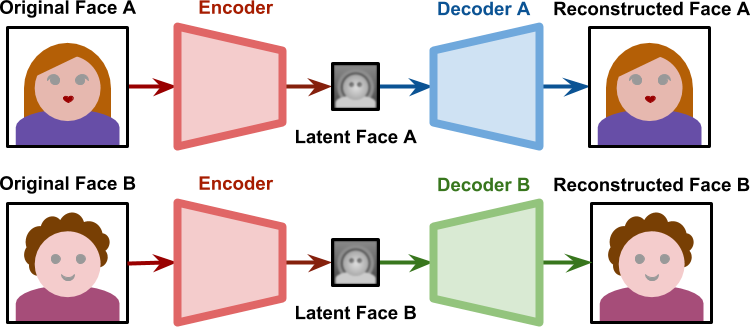

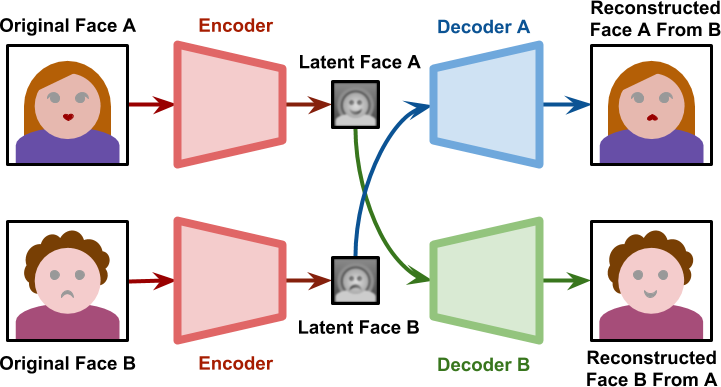

Divê hûn perwerde bikin a torê neural li ser dîmenên vîdyoyê yên rastîn ên kesê. Ev ê destûrê bide torê neural ji bo têgihîştina taybetmendiyên rûyê mijarê di hêlên cûda û mercên ronahiyê de.

Piştî wê, hûn ê hem rûyê orîjînal û hem jî rûyê dereng bi algorîtmayek AI-ê ya ku jê re kodker tê gotin pêvajoyê bikin. Ew ê ferq û hevsengiyên di navbera her du rûyan de bibîne û fêr bibe û her du rû bi wêneyek pêçandî ku taybetmendiyên hevpar parve dike têne kêm kirin.

Dûv re algorîtmaya duyemîn a AI-ê ya bi navê dekoder tê, ku rûyên ji wêneyên pêçandî vedigire. Her du rû ji hêla du dekoderên cûda ve têne vegerandin.

Ji bo pêkanîna guheztina rû, hûn tenê wêneyên kodkirî di dekodera din de bişînin.

Mînakî, derçûnek şîfreker a rûyê A di dekodera ku li ser rûyê B hatî perwerde kirin de tê xwarin, ku dûv re rûyê B bi taybetmendiyên rûyê A-yê ji nû ve ava dike. Ji bo encamek pêbawer divê hûn vê yekê li ser her çarçoweya vîdyoyê bikin.

Method 2

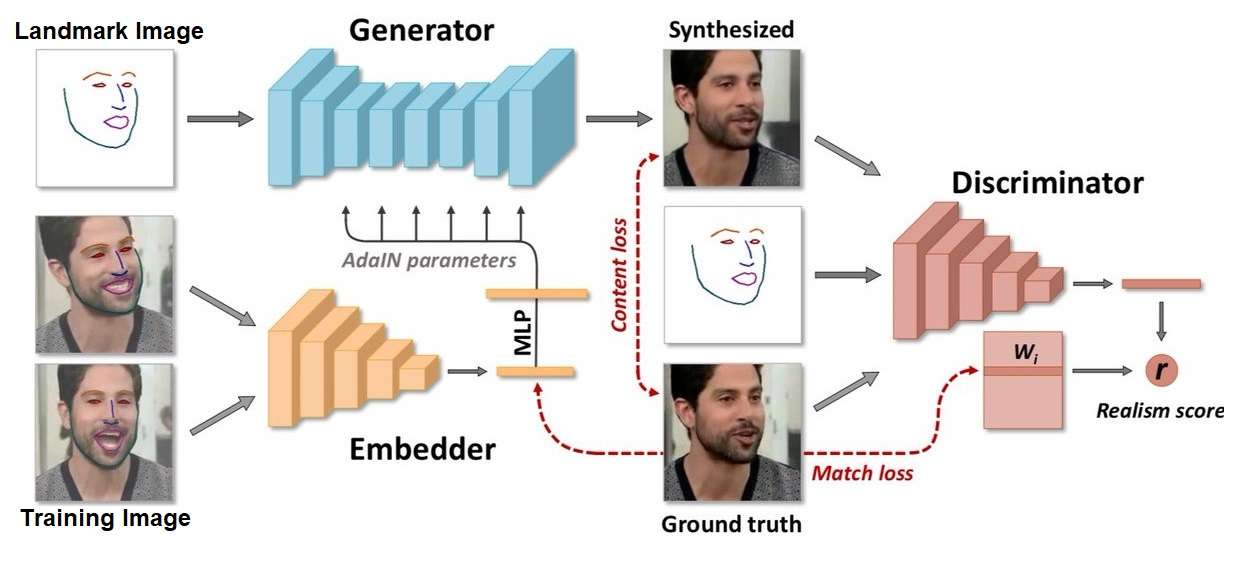

Rêbazek din a ji bo çêkirina kûr-fakeran Tora Dijbera Generative (GAN) e.

Hûn ê neçar in ku du algorîtmayên hevrik bikar bînin da ku hûn derewînên kûr çêbikin. Yekem dê dengek rasthatî bikar bîne da ku wêneyek çêbike û ji ber vê yekê jê re jenerator tê gotin. Ev wêneya sentetîk bi navgîniya algorîtmaya duyemîn a bi navê cudaker tê veguheztinek wêneyên rastîn.

Cudakar bertek dide jeneratorê ku li gorî bertekan wêneyek din çêdike. Bi vî rengî, her du algorîtma bi her dubarekirinê re encamên çêtir didin. Ev pêvajo gelek caran tê dubare kirin heya ku asta rastbûna pêdivî bi dest bixe.

GAN encamên bêkêmasî realîst peyda dike, lê xebitandina wê dijwar e û pêdivî ye ku hejmareke mezin a daneya perwerdehiyê û hêza hesabkirinê heye. Ji ber vê yekê ew bi gelemperî ji bo hilberîna wêneyan ne ji klîbên vîdyoyê tê tercîh kirin.

Hin mînakên pêbawer ên Deepfakes

Hin kûrahiyên pir pêbawer hene ku li dora înternetê dizivirin û piraniya wan navdar in.

Mînakî, hesabek TikTok heye ku tenê ji kûrahiyên Tom Cruise re hatî veqetandin. Vîdyo nîşan didin ku Cruise golfê dike an jî hîleyek sêrbaz nîşan dide.

@deeptomcruise Gerrîn! ????

Dewrêşeke din a pir tevlihev bi Tom Cruise, Robert Downey Jr., Jeff Goldblum, George Lucas û Ewan McGregor re li YouTube hate barkirin. Hin kêmasiyên wê yên eşkere hene, lê bi hevdemî pêvajokirina 3 û 4 kûr-fakeyên di vîdyoyekê de bi serê xwe serkeftinek e.

Mînakek din vîdyoyek kûr a serokê berê Barack Obama ye.

Ev yek ji ber ku deng û îşaretên qehremanan ên ku dikarin deng û îşaretên mijarê bişibînin bikar tîne, bi heybetî qanîker e.

Em naha di pîşesaziya serpêhatiya seretayî ya nûjen de kûrahiyan dibînin.

Ew ji bo kişandina dîmenên Paul Walker di Fast and Furious 7 de piştî mirina nediyar a lîstikvan hate bikar anîn. Deepfake li ser birayê wî bi rastiyek berbiçav hate bikar anîn.

Deepfakes çi tîne ser sifrê?

Deepfakes îsbat kiriye ku teknolojiyek pir pêbawer e ku di medya û şahiyê de şoreşê bîne.

Ma hûn dikarin bînin bîra xwe dema ku di "Man of Steel" de mustaxê Henry Cavill ji hêla CGI ve hat rakirin û ew karesatek bû?

Heman tişt naha dikare li ser komputerên çend hezar dolaran bi encamên pir pêbawertir were kirin.

Naha hûn dikarin bav û kalên xwe yên mirî û hezkiriyên xwe bibînin. Tewra hûn dikarin beşdarî dersek Fîzîkê ya ji Albert Einstein bixwe bibin.

Ji bilî van hemîyan, deepfake bi tevahî bi awayê ku hatî armanc kirin nehatiye bikar anîn. Nêzîkî 96% ji kûrahiyan li ser înternetê pornografiya ne razî ne.

Hejmara zêde ya daneyên perwerdehiyê yên ku ji bo navdaran peyda dibin, bûye sedem ku ew bibin qurbaniyên herî mexdûr ên kûr-fake.

Vê yekê hişt ku em her kesê têxin nav senaryoyên xeternak an lihevhatî û ji ber vê yekê ew ji her kesî re xeterek mezin çêdike.

Hat ragihandin ku kûrhatiyên dengî ji bo xapandina pargîdaniyan têne bikar anîn. Di sala 2019-an de, qelpek dengek sexte ya kûr bikar anî da ku ferman bide CEO ya pargîdaniyek Brîtanî ku 220,000 € veguhezîne bankek Macarîstanê bi nepenîkirina rêveberê pargîdaniya dêûbavê pargîdaniyê.

Meriv çawa li dijî Deepfakesên Malicious li ber xwe dide?

Bi gelemperî, hûn dikarin vîdyoyên kûr-fake bi baldarî temaşekirina çarçoveyek çarçove û lêgerîna hunerî û neqanûnî bibînin.

Lêbelê, ew pêvajoyek dijber e û gelek pargîdan li ser algorîtma û nermalavê dixebitin kûr-fakeran tespît bike.

Facebook lêkolînerên ji Berkeley, Oxford, û saziyên din kir ku dedektorek kûr-fake ava bikin. Bi heman rengî, YouTube ragihand ku ew ê vîdyoyên kûr ên têkildarî hilbijartinên Dewletên Yekbûyî, prosedurên dengdanê, an serjimêriya Dewletên Yekbûyî yên 2020-an qebûl nekin.

Her weha hûn dikarin bernameyên mîna bikar bînin Reality Defender û Deeptrace ji bo tespîtkirina deepfakes.

Di heman demê de welat di derbarê karanîna kûrahiyên bi gelemperî de di qanûndanînê de jî mijûl in. Dewletên Yekbûyî di sala borî de gelek qanûn di derheqê kûr-fake de bicîh anîn.

Hot dog

Deepfake vehewandina zindî ya pêşkeftina AI-ê ye. Ew bêtir sînorê pêşerojê dişewitîne, lêbelê, ew xeterek potansiyel e li ser pêbaweriya naveroka vîdyo-grafîk a li ser înternetê.

Dê demek hebe ku mirov dest bi gumana her vîdyoyek li ser înternetê bikin û em ê têkevin serdemek nediyariyek din.

Leave a Reply