სარჩევი[დამალვა][ჩვენება]

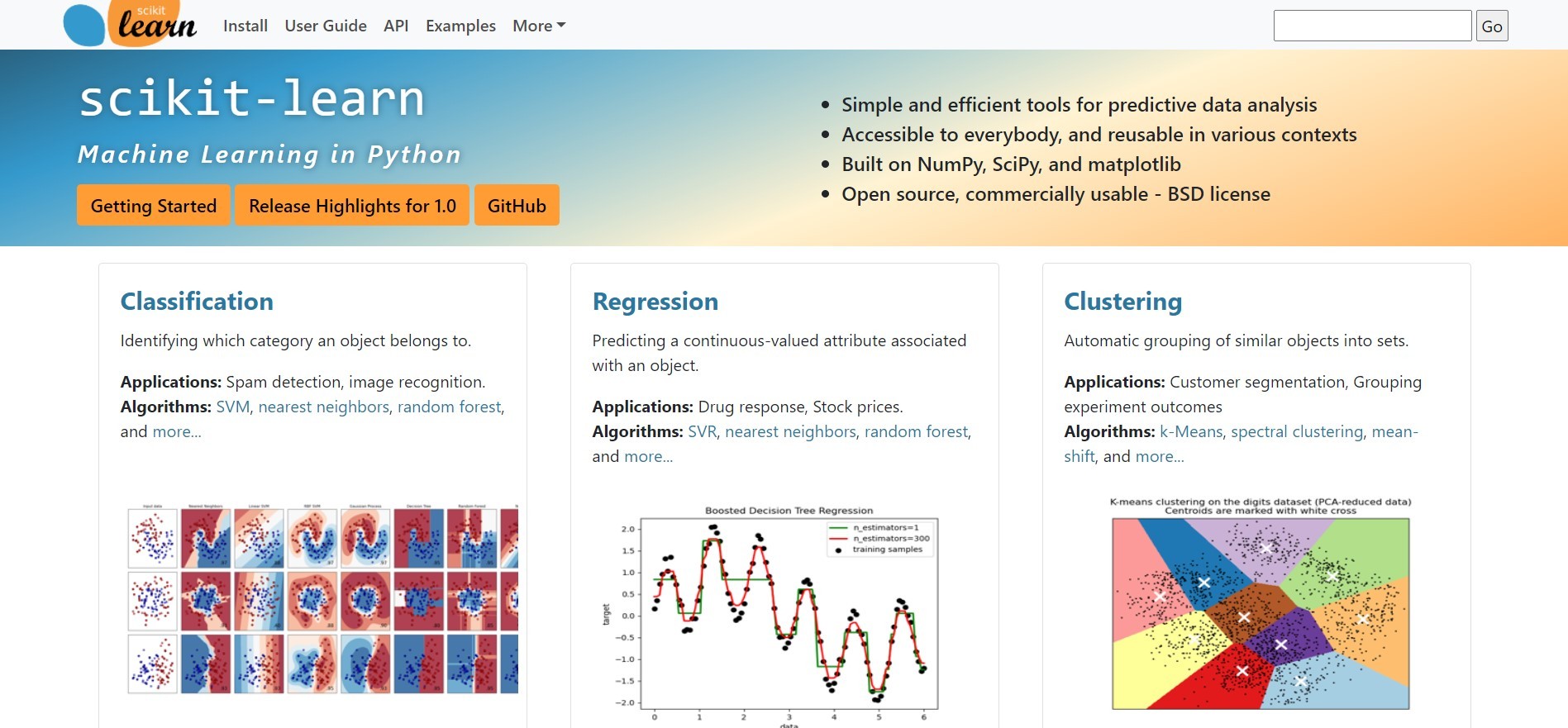

თუ თქვენ ხართ პითონის პროგრამისტი ან თუ ეძებთ მძლავრ ინსტრუმენტთა ნაკრების გამოყენებას მანქანური სწავლების წარმოების სისტემაში დასანერგად, Scikit-learn არის ბიბლიოთეკა, რომელიც უნდა შეამოწმოთ.

Scikit-learn კარგად არის დოკუმენტირებული და მარტივი გამოსაყენებლად, მიუხედავად იმისა, ახალი ხართ მანქანური სწავლების სფეროში, გსურთ სწრაფად დაიწყოთ მუშაობა და გსურთ გამოიყენოთ ყველაზე განახლებული ML კვლევის ინსტრუმენტი.

ის საშუალებას გაძლევთ შექმნათ პროგნოზირებადი მონაცემთა მოდელი კოდის მხოლოდ რამდენიმე სტრიქონში და შემდეგ გამოიყენოს ეს მოდელი, რათა მოერგოს თქვენს მონაცემებს, როგორც მაღალი დონის ბიბლიოთეკას. ეს არის მოქნილი და კარგად მუშაობს სხვებთან პითონის ბიბლიოთეკები როგორიცაა Matplotlib დიაგრამებისთვის, NumPy მასივის ვექტორიზაციისთვის და პანდები მონაცემთა ვიზუალიზაციისთვის.

ამ სახელმძღვანელოში თქვენ შეიტყობთ ყველაფერს იმის შესახებ, თუ რა არის ის, როგორ შეგიძლიათ გამოიყენოთ იგი, მის დადებით და უარყოფით მხარეებთან ერთად.

რა არის Scikit- ისწავლე?

Scikit-learn (ასევე ცნობილი როგორც sklearn) გთავაზობთ სტატისტიკური მოდელებისა და მანქანური სწავლების მრავალფეროვან კომპლექტს. უმეტესი მოდულებისგან განსხვავებით, sklearn განვითარებულია Python-ში და არა C. მიუხედავად იმისა, რომ იგი განვითარებულია Python-ში, sklearn-ის ეფექტურობა მიეკუთვნება NumPy-ის გამოყენებას მაღალი ხარისხის ხაზოვანი ალგებრასა და მასივის ოპერაციებისთვის.

Scikit-Learn შეიქმნა Google-ის Summer of Code პროექტის ფარგლებში და მას შემდეგ გაამარტივა მილიონობით პითონზე ორიენტირებული მონაცემთა მეცნიერის ცხოვრება მთელ მსოფლიოში. სერიის ეს განყოფილება ფოკუსირებულია ბიბლიოთეკის წარდგენაზე და ფოკუსირებაზე ერთ ელემენტზე - მონაცემთა ტრანსფორმაციაზე, რომელიც წარმოადგენს საკვანძო და სასიცოცხლო მნიშვნელობის ნაბიჯს პროგნოზირების მოდელის შემუშავებამდე.

ბიბლიოთეკა დაფუძნებულია SciPy-ზე (სამეცნიერო პითონი), რომელიც უნდა იყოს დაინსტალირებული, სანამ შეძლებთ scikit-learn-ის გამოყენებას. ეს დასტა შეიცავს შემდეგ ელემენტებს:

- NumPy: პითონის სტანდარტული n-განზომილებიანი მასივის პაკეტი

- SciPy: ეს არის ფუნდამენტური პაკეტი სამეცნიერო გამოთვლისთვის

- პანდები: მონაცემთა სტრუქტურები და ანალიზი

- Matplotlib: ეს არის მძლავრი 2D/3D შეთქმულების ბიბლიოთეკა

- Sympy: სიმბოლური მათემატიკა

- IPython: გაუმჯობესებული ინტერაქტიული კონსოლი

Scikit-learn ბიბლიოთეკის აპლიკაციები

Scikit-learn არის ღია კოდის Python პაკეტი მონაცემთა დახვეწილი ანალიზისა და მაინინგის მახასიათებლებით. მას გააჩნია ჩაშენებული ალგორითმის სიმრავლე, რომელიც დაგეხმარებათ მაქსიმალურად მიიღოთ თქვენი მონაცემთა მეცნიერების პროექტებიდან. Scikit-learn ბიბლიოთეკა გამოიყენება შემდეგი გზებით.

1. რეგრესია

რეგრესიული ანალიზი არის სტატისტიკური ტექნიკა ორ ან მეტ ცვლადს შორის კავშირის გასაანალიზებლად და გასაგებად. რეგრესიული ანალიზის გასაკეთებლად გამოყენებული მეთოდი გვეხმარება იმის დადგენაში, თუ რომელი ელემენტებია რელევანტური, რომელი შეიძლება იგნორირებული იყოს და როგორ ურთიერთქმედებენ ისინი. მაგალითად, რეგრესიის ტექნიკა შეიძლება გამოყენებულ იქნას აქციების ფასების ქცევის უკეთ გასაგებად.

რეგრესიის ალგორითმები მოიცავს:

- ხაზოვანი რეგრესიის

- ქედის რეგრესია

- ლასოს რეგრესია

- გადაწყვეტილების ხის რეგრესია

- შემთხვევითი ტყე

- მხარდაჭერის ვექტორული მანქანები (SVM)

2. კლასიფიკაცია

კლასიფიკაციის მეთოდი არის ზედამხედველობითი სწავლის მიდგომა, რომელიც იყენებს სასწავლო მონაცემებს ახალი დაკვირვების კატეგორიის დასადგენად. კლასიფიკაციის ალგორითმი სწავლობს მოცემულიდან მონაცემთა ბაზა ან დაკვირვებები და შემდეგ დამატებით დაკვირვებებს ანაწილებს მრავალ კლასში ან დაჯგუფებაში. ისინი, მაგალითად, შეიძლება გამოყენებულ იქნას ელექტრონული ფოსტის კომუნიკაციების სპამად კლასიფიკაციისთვის თუ არა.

კლასიფიკაციის ალგორითმები მოიცავს შემდეგს:

- ლოგისტიკური რეგრესია

- K- უახლოესი მეზობლები

- მხარდაჭერის ვექტორული მანქანა

- გადაწყვეტილების ხე

- შემთხვევითი ტყე

3. კლასტერირება

კლასტერიზაციის ალგორითმები Scikit-learn-ში გამოიყენება მსგავსი თვისებების მქონე მონაცემების ავტომატური მოწყობისთვის ნაკრებებად. კლასტერირება არის ერთეულების ნაკრების დაჯგუფების პროცესი ისე, რომ იმავე ჯგუფში მყოფნი უფრო ჰგვანან სხვა ჯგუფებს. მომხმარებელთა მონაცემები, მაგალითად, შეიძლება განცალკევდეს მათი მდებარეობის მიხედვით.

კლასტერიზაციის ალგორითმები მოიცავს შემდეგს:

- DB-SCAN

- კ- ნიშნავს

- მინი პარტია K-საშუალებები

- სპექტრული კლასტერირება

4. მოდელის შერჩევა

მოდელის შერჩევის ალგორითმები იძლევა მეთოდებს მონაცემთა მეცნიერების ინიციატივებში გამოსაყენებლად ოპტიმალური პარამეტრებისა და მოდელების შედარების, დადასტურებისა და შერჩევისათვის. მონაცემების გათვალისწინებით, მოდელის შერჩევა არის სტატისტიკური მოდელის არჩევის პრობლემა კანდიდატ მოდელების ჯგუფიდან. ყველაზე ძირითად გარემოებებში მხედველობაში მიიღება წინასწარ არსებული მონაცემების კოლექცია. თუმცა, ამოცანა შეიძლება ასევე მოიცავდეს ექსპერიმენტების დიზაინს ისე, რომ მიღებული მონაცემები კარგად მოერგოს მოდელის შერჩევის პრობლემას.

მოდელის შერჩევის მოდულები, რომლებსაც შეუძლიათ გააუმჯობესონ სიზუსტე პარამეტრების კორექტირებით, მოიცავს:

- ჯვარედინი დადასტურება

- ბადის ძიება

- Metrics

5. განზომილების შემცირება

მონაცემთა გადაცემა მაღალი განზომილებიანი სივრციდან დაბალგანზომილებიან სივრცეში ისე, რომ დაბალი განზომილებიანი წარმოდგენა შეინარჩუნოს ორიგინალური მონაცემების ზოგიერთი მნიშვნელოვანი ასპექტი, იდეალურად მის თანდაყოლილ განზომილებაში, ცნობილია როგორც განზომილების შემცირება. ანალიზისთვის შემთხვევითი ცვლადების რაოდენობა მცირდება განზომილების შემცირებისას. გარე მონაცემები, მაგალითად, არ შეიძლება ჩაითვალოს ვიზუალიზაციის ეფექტურობის გასაუმჯობესებლად.

განზომილების შემცირების ალგორითმი მოიცავს შემდეგს:

- მხატვრული შერჩევა

- ძირითადი კომპონენტის ანალიზი (PCA)

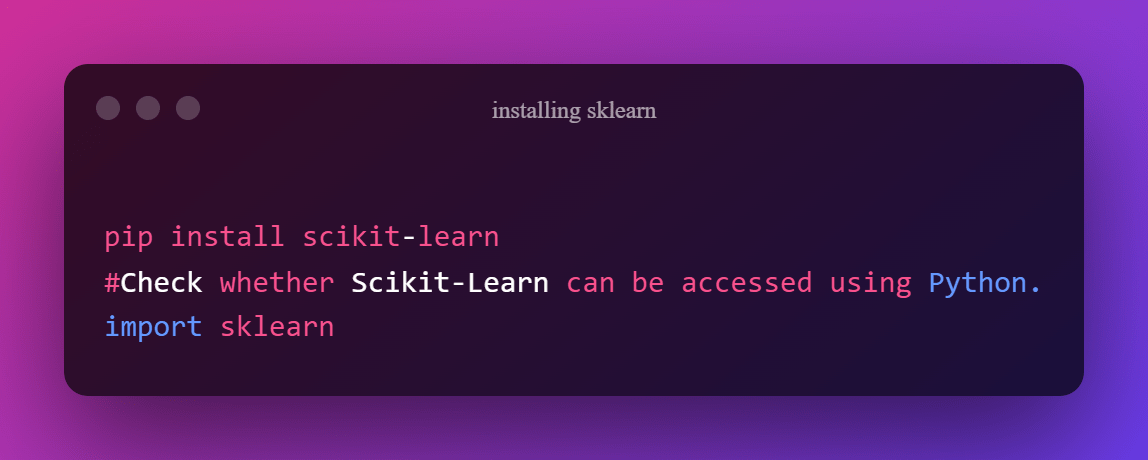

Scikit-learn-ის ინსტალაცია

Scikit-learn-ის გამოყენებამდე საჭიროა NumPy, SciPy, Matplotlib, IPython, Sympy და Pandas ინსტალაცია. მოდით დავაინსტალიროთ ისინი პიპის გამოყენებით კონსოლიდან (მუშაობს მხოლოდ Windows-ისთვის).

მოდით დავაინსტალიროთ Scikit-learn ახლა, როცა დავაყენეთ საჭირო ბიბლიოთეკები.

მისი მახასიათებლებია;

Scikit-learn, რომელიც ზოგჯერ ცნობილია როგორც sklearn, არის პითონის ხელსაწყოების ნაკრები მანქანათმცოდნეობის მოდელების და სტატისტიკური მოდელირებისთვის. ჩვენ შეგვიძლია გამოვიყენოთ ის მრავალი მანქანური სწავლის მოდელის შესაქმნელად რეგრესიის, კლასიფიკაციისა და კლასტერიზაციისთვის, ასევე სტატისტიკური ხელსაწყოების შესაქმნელად ამ მოდელების შესაფასებლად. ის ასევე მოიცავს განზომილების შემცირებას, მახასიათებლების შერჩევას, ფუნქციების ამოღებას, ანსამბლის მიდგომებს და ჩაშენებულ მონაცემთა ნაკრებებს. ჩვენ გამოვიკვლევთ თითოეულ ამ თვისებას სათითაოდ.

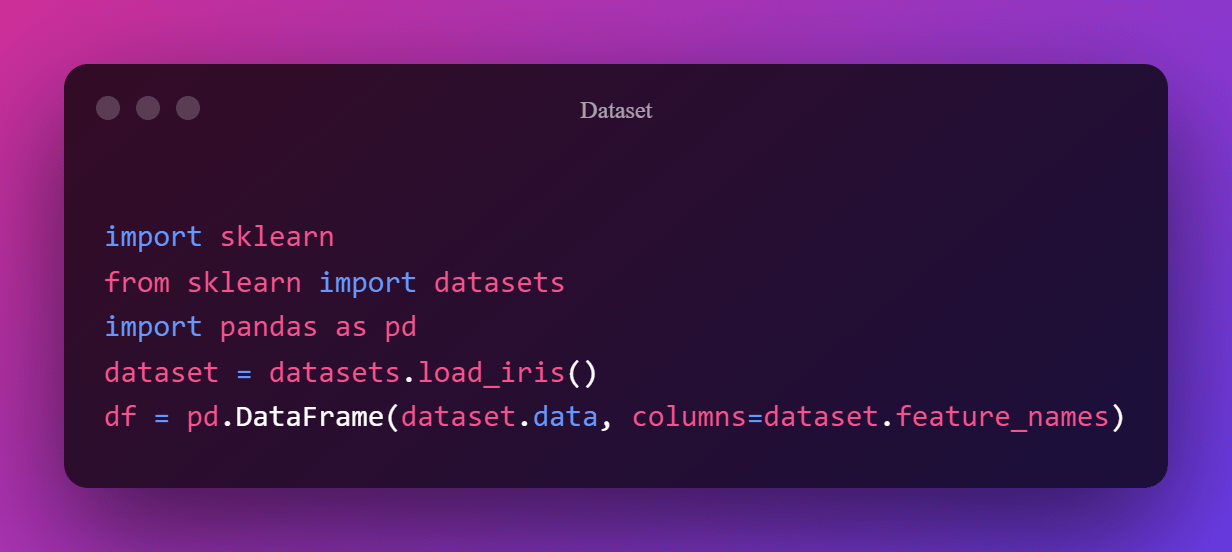

1. მონაცემთა ნაკრების იმპორტი

Scikit-learn მოიცავს უამრავ წინასწარ აშენებულ მონაცემთა ნაკრებებს, როგორიცაა iris მონაცემთა ნაკრები, სახლის ფასების მონაცემთა ნაკრები, Titanic მონაცემთა ნაკრები და ა.შ. ამ მონაცემთა ნაკრების მთავარი უპირატესობებია ის, რომ ისინი ადვილად აღსაქმელია და შეიძლება გამოყენებულ იქნას ML მოდელების დაუყოვნებლივ შესაქმნელად. ეს მონაცემთა ნაკრები შესაფერისია დამწყებთათვის. ანალოგიურად, შეგიძლიათ გამოიყენოთ sklearn დამატებითი მონაცემთა ნაკრების იმპორტისთვის. ანალოგიურად, შეგიძლიათ გამოიყენოთ იგი დამატებითი მონაცემთა ნაკრების იმპორტისთვის.

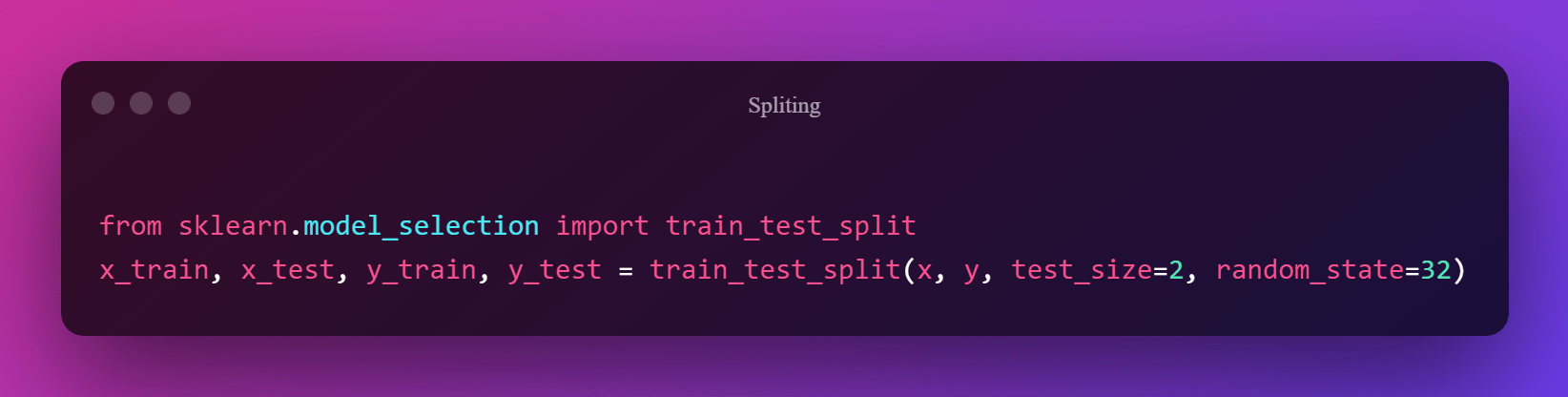

2. მონაცემთა ნაკრების გაყოფა ტრენინგისა და ტესტირებისთვის

Sklearn მოიცავდა მონაცემთა დაყოფის შესაძლებლობას სასწავლო და ტესტირების სეგმენტებად. მონაცემთა ნაკრების გაყოფა საჭიროა პროგნოზის შესრულების მიუკერძოებელი შეფასებისთვის. ჩვენ შეგვიძლია განვსაზღვროთ ჩვენი მონაცემების რამდენი ნაწილი უნდა იყოს შეტანილი მატარებლისა და ტესტირების მონაცემთა ნაკრებში. ჩვენ დავყავით მონაცემთა ნაკრები მატარებლის ტესტის გაყოფის გამოყენებით ისე, რომ მატარებლის ნაკრები შეიცავს მონაცემთა 80%-ს, ხოლო ტესტის კომპლექტს აქვს 20%. მონაცემთა ნაკრები შეიძლება დაიყოს შემდეგნაირად:

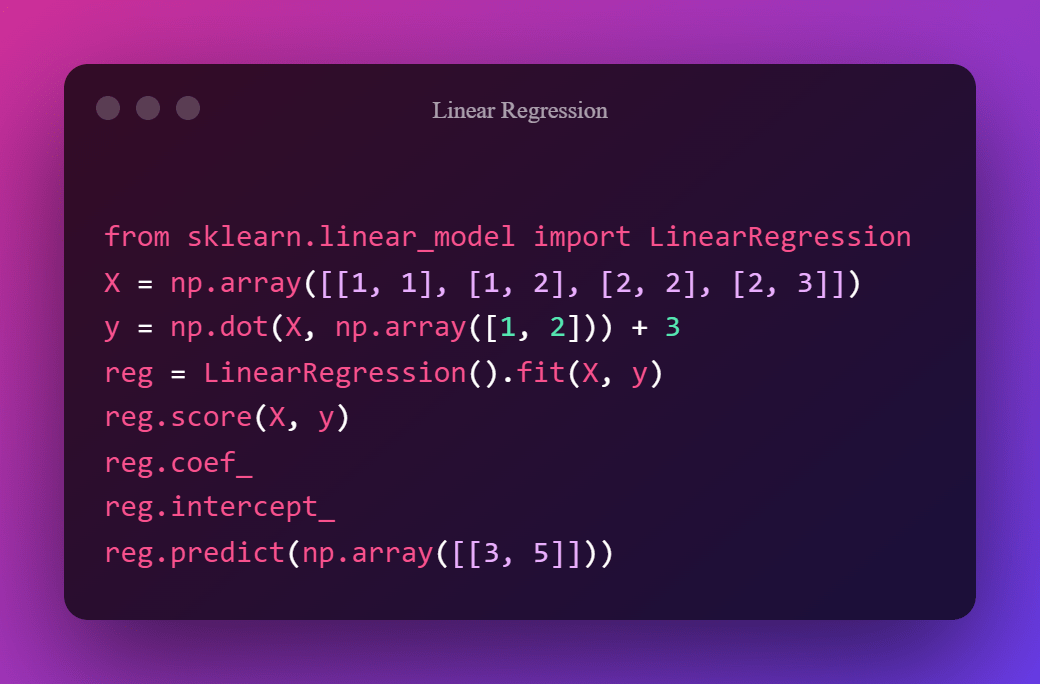

3. ხაზოვანი რეგრესია

ხაზოვანი რეგრესია არის მეთვალყურეობის ქვეშ სწავლაზე დაფუძნებული მანქანათმცოდნეობის ტექნიკა. ის ახორციელებს რეგრესიულ სამუშაოს. დამოუკიდებელ ცვლადებზე დაყრდნობით, რეგრესია აყალიბებს მიზნის პროგნოზირების მნიშვნელობას. იგი ძირითადად გამოიყენება ცვლადებსა და წინასწარმეტყველებას შორის კავშირის დასადგენად. რეგრესიის სხვადასხვა მოდელები განსხვავდება დამოკიდებულ და დამოუკიდებელ ცვლადებს შორის კავშირის ტიპის მიხედვით, ასევე გამოყენებული დამოუკიდებელი ცვლადების რაოდენობით. ჩვენ შეგვიძლია უბრალოდ შევქმნათ ხაზოვანი რეგრესიის მოდელი sklearn-ის გამოყენებით შემდეგნაირად:

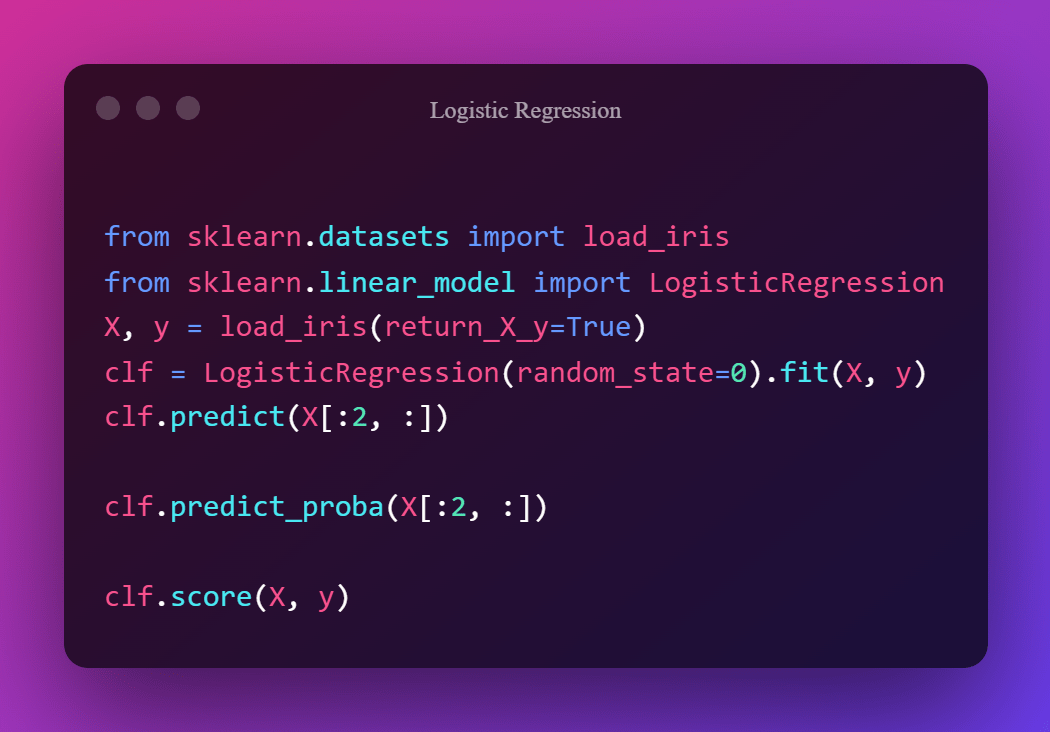

4. ლოგისტიკური რეგრესია

კატეგორიზაციის საერთო მიდგომა არის ლოგისტიკური რეგრესია. ის იმავე ოჯახშია, როგორც პოლინომიური და წრფივი რეგრესია და მიეკუთვნება ხაზოვანი კლასიფიკატორის ოჯახს. ლოგისტიკური რეგრესიის დასკვნები მარტივია გასაგებად და სწრაფად გამოსათვლელი. ისევე, როგორც ხაზოვანი რეგრესია, ლოგისტიკური რეგრესია არის ზედამხედველობითი რეგრესიის ტექნიკა. გამომავალი ცვლადი კატეგორიულია, ასე რომ, ეს არის ერთადერთი განსხვავება. მას შეუძლია განსაზღვროს აქვს თუ არა პაციენტს გულის დაავადება.

სხვადასხვა კლასიფიკაციის საკითხები, როგორიცაა სპამის აღმოჩენა, შეიძლება მოგვარდეს ლოგისტიკური რეგრესიის გამოყენებით. შაქრიანი დიაბეტის პროგნოზირება, იმის დადგენა, მომხმარებელი იყიდის კონკრეტულ პროდუქტს თუ გადაერთვება კონკურენტზე, განსაზღვრა დააწკაპუნებს თუ არა მომხმარებელი კონკრეტულ მარკეტინგულ ბმულზე და მრავალი სხვა სცენარი მხოლოდ რამდენიმე მაგალითია.

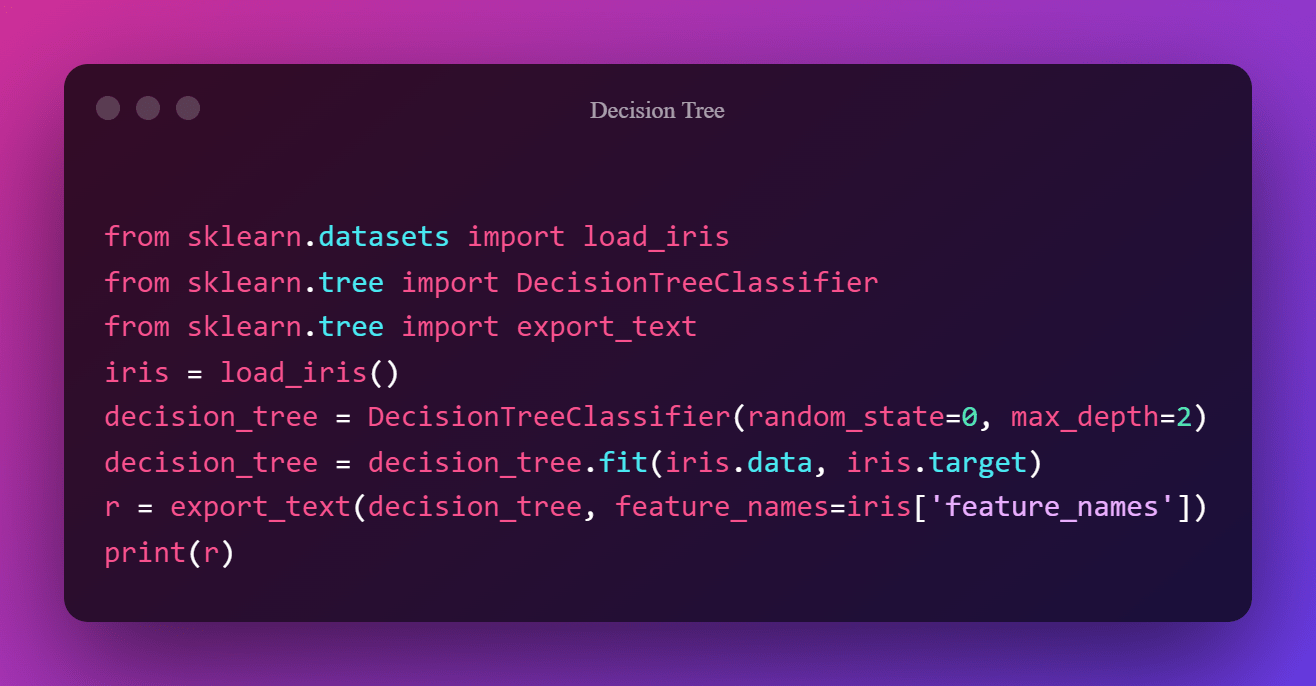

5. გადაწყვეტილების ხე

ყველაზე ძლიერი და ფართოდ გამოყენებული კლასიფიკაციისა და პროგნოზირების ტექნიკა არის გადაწყვეტილების ხე. გადაწყვეტილების ხე არის ხის სტრუქტურა, რომელიც ჰგავს დიაგრამას, სადაც თითოეული შიდა კვანძი წარმოადგენს ტესტს ატრიბუტზე, თითოეული ტოტი წარმოადგენს ტესტის დასკვნას და თითოეული ფოთლის კვანძი (ტერმინალური კვანძი) ფლობს კლასის იარლიყს.

როდესაც დამოკიდებულ ცვლადებს არ აქვთ წრფივი კავშირი დამოუკიდებელ ცვლადებთან, ანუ როდესაც წრფივი რეგრესია არ იძლევა სწორ დასკვნებს, გადაწყვეტილების ხეები სასარგებლოა. DecisionTreeRegression() ობიექტი შეიძლება გამოყენებულ იქნას ანალოგიურად გადაწყვეტილების ხის გამოსაყენებლად რეგრესიისთვის.

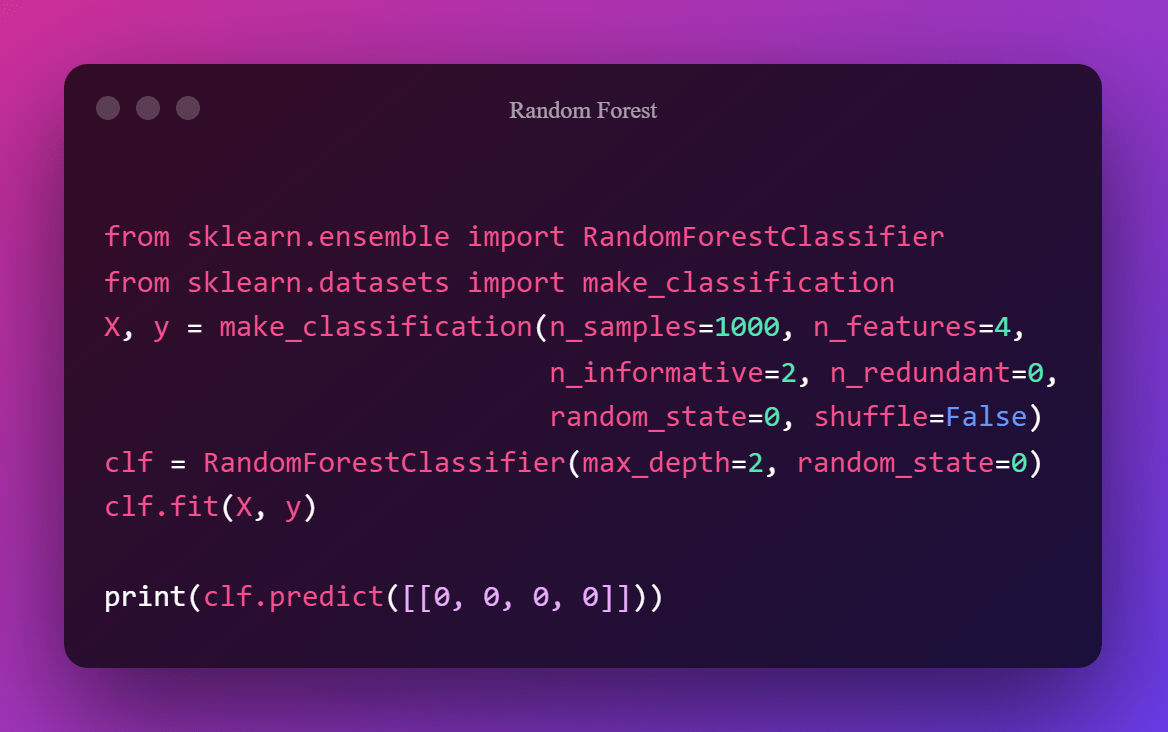

6. შემთხვევითი ტყე

შემთხვევითი ტყე არის ა მანქანა სწავლის რეგრესიის და კლასიფიკაციის საკითხების გადაჭრის მიდგომა. ის იყენებს ანსამბლის სწავლებას, რომელიც არის ტექნიკა, რომელიც აერთიანებს მრავალ კლასიფიკატორს რთული პრობლემების გადასაჭრელად. შემთხვევითი ტყის მეთოდი შედგება გადაწყვეტილების ხეების დიდი რაოდენობით. ის შეიძლება გამოყენებულ იქნას სესხის განაცხადების კატეგორიზაციისთვის, თაღლითური ქცევის გამოსავლენად და დაავადების გავრცელების მოსალოდნელად.

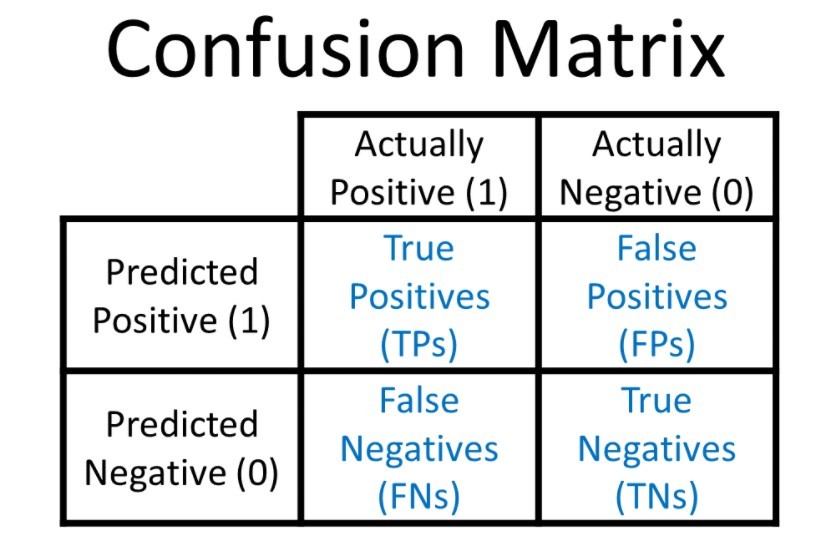

7. დაბნეულობის მატრიცა

დაბნეულობის მატრიცა არის ცხრილი, რომელიც გამოიყენება კლასიფიკაციის მოდელის შესრულების აღსაწერად. შემდეგი ოთხი სიტყვა გამოიყენება დაბნეულობის მატრიცის შესამოწმებლად:

- True Positive: ეს ნიშნავს, რომ მოდელი დაპროექტებული იყო ხელსაყრელი შედეგით და ის იყო სწორი.

- ჭეშმარიტი ნეგატივი: ეს ნიშნავს, რომ მოდელმა აჩვენა ცუდი შედეგი და ის იყო სწორი.

- ცრუ დადებითი: ეს ნიშნავს, რომ მოდელი ელოდა ხელსაყრელ შედეგს, მაგრამ ის ნამდვილად უარყოფითი იყო.

- ცრუ უარყოფითი: ეს ნიშნავს, რომ მოდელი ელოდა უარყოფით შედეგს, ხოლო შედეგი ნამდვილად დადებითი იყო.

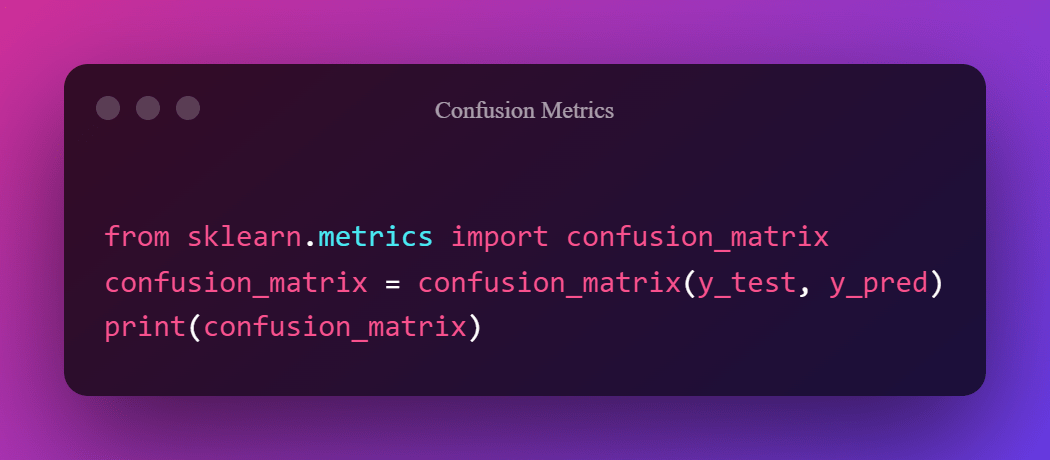

დაბნეულობის მატრიცის განხორციელება:

დადებითი

- მისი გამოყენება მარტივია.

- Scikit-learn პაკეტი უკიდურესად ადაპტირებადი და სასარგებლოა, ემსახურება რეალურ სამყაროში არსებულ მიზნებს, როგორიცაა მომხმარებელთა ქცევის პროგნოზირება, ნეიროიმიჯის განვითარება და ა.შ.

- მომხმარებლები, რომლებსაც სურთ ალგორითმების დაკავშირება თავიანთ პლატფორმებთან, იპოვიან დეტალურ API დოკუმენტაციას Scikit-learn ვებსაიტზე.

- მრავალი ავტორი, თანამშრომელი და დიდი მსოფლიო ონლაინ საზოგადოება მხარს უჭერს და განაახლებს Scikit-learn-ს.

Cons

- ეს არ არის იდეალური ვარიანტი სიღრმისეული შესწავლისთვის.

დასკვნა

Scikit-learn არის კრიტიკული პაკეტი ყველა მონაცემთა მეცნიერისთვის, რომელსაც აქვს ძლიერი გაგება და გარკვეული გამოცდილება. ეს სახელმძღვანელო დაგეხმარებათ მონაცემთა მანიპულირებაში sklearn-ის გამოყენებით. არსებობს Scikit-learn-ის მრავალი სხვა შესაძლებლობა, რომელსაც აღმოაჩენთ მონაცემთა მეცნიერების თავგადასავლის წინსვლისას. გაგვიზიარეთ თქვენი აზრები კომენტარებში.

დატოვე პასუხი