Sommario[Nascondere][Spettacolo]

Sono sicuro che hai sentito parlare di intelligenza artificiale, oltre a parole come apprendimento automatico e elaborazione del linguaggio naturale (NLP).

Soprattutto se lavori per un'azienda che gestisce centinaia, se non migliaia, di contatti con i clienti ogni giorno.

L'analisi dei dati di post sui social media, e-mail, chat, risposte a sondaggi aperti e altre fonti non è un processo semplice e diventa ancora più difficile se affidato solo alle persone.

Ecco perché molte persone sono entusiaste del potenziale di intelligenza artificiale per il loro lavoro quotidiano e per le imprese.

L'analisi del testo basata sull'intelligenza artificiale utilizza un'ampia gamma di approcci o algoritmi per interpretare il linguaggio in modo organico, uno dei quali è l'analisi degli argomenti, che viene utilizzata per scoprire automaticamente gli argomenti dai testi.

Le aziende possono utilizzare i modelli di analisi degli argomenti per trasferire lavori facili sulle macchine piuttosto che sovraccaricare i lavoratori con troppi dati.

Considera quanto tempo il tuo team potrebbe risparmiare e dedicare al lavoro più essenziale se un computer potesse filtrare elenchi infiniti di sondaggi sui clienti o problemi di supporto ogni mattina.

In questa guida esamineremo la modellazione degli argomenti, i diversi metodi di modellazione degli argomenti e faremo un'esperienza pratica con essa.

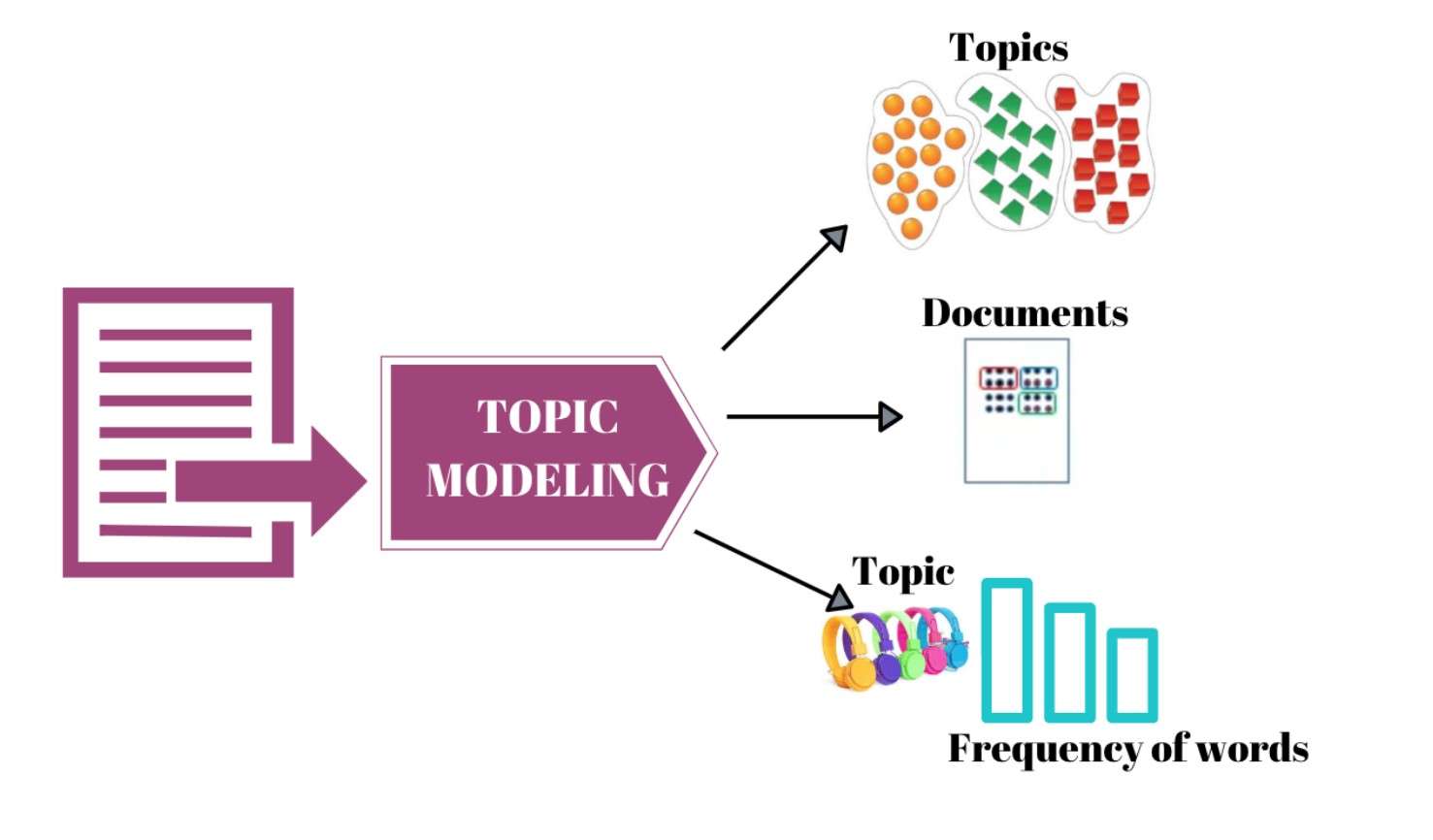

Che cos'è la modellazione di argomenti?

La modellazione degli argomenti è un tipo di estrazione di testo in cui statistiche non supervisionate e supervisionate machine learning le tecniche vengono utilizzate per rilevare le tendenze in un corpus o un volume significativo di testo non strutturato.

Può richiedere la tua enorme raccolta di documenti e utilizzare un metodo di somiglianza per organizzare le parole in gruppi di termini e scoprire argomenti.

Sembra un po' complesso e difficile, quindi semplifichiamo la procedura di modellazione del soggetto!

Supponi di leggere un giornale con un set di evidenziatori colorati in mano.

Non è vecchio stile?

Mi rendo conto che al giorno d'oggi, poche persone leggono i giornali in formato cartaceo; tutto è digitale e gli evidenziatori appartengono al passato! Fai finta di essere tuo padre o tua madre!

Quindi, quando leggi il giornale, evidenzi i termini importanti.

Un'altra ipotesi!

Utilizzi una tonalità diversa per enfatizzare le parole chiave dei vari temi. Classifica le parole chiave in base al colore e agli argomenti forniti.

Ogni raccolta di parole contrassegnate da un determinato colore è un elenco di parole chiave per un determinato argomento. La quantità di vari colori che hai scelto mostra il numero di temi.

Questa è la modellazione tematica più fondamentale. Aiuta nella comprensione, organizzazione e sintesi di grandi raccolte di testi.

Tuttavia, tieni presente che per essere efficaci, i modelli di argomenti automatizzati richiedono molto contenuto. Se hai un foglio corto, potresti voler andare alla vecchia scuola e usare gli evidenziatori!

È anche utile dedicare un po' di tempo alla conoscenza dei dati. Questo ti darà un'idea di base di ciò che il modello di argomento dovrebbe trovare.

Ad esempio, quel diario potrebbe riguardare le tue relazioni presenti e precedenti. Pertanto, prevedo che il mio amico robot per l'estrazione di testo escogita idee simili.

Questo può aiutarti ad analizzare meglio la qualità dei soggetti che hai identificato e, se necessario, a modificare i set di parole chiave.

Componenti della modellazione di argomenti

Modello probabilistico

Le variabili casuali e le distribuzioni di probabilità sono incorporate nella rappresentazione di un evento o fenomeno nei modelli probabilistici.

Un modello deterministico fornisce un'unica potenziale conclusione per un evento, mentre un modello probabilistico fornisce una distribuzione di probabilità come soluzione.

Questi modelli considerano la realtà che raramente abbiamo una conoscenza completa di una situazione. C'è quasi sempre un elemento di casualità da considerare.

Ad esempio, l'assicurazione sulla vita si basa sulla realtà che sappiamo che moriremo, ma non sappiamo quando. Questi modelli potrebbero essere parzialmente deterministici, parzialmente casuali o completamente casuali.

Recupero delle informazioni

Il recupero delle informazioni (IR) è un programma software che organizza, archivia, recupera e valuta le informazioni dagli archivi di documenti, in particolare le informazioni testuali.

La tecnologia aiuta gli utenti a scoprire le informazioni di cui hanno bisogno, ma non fornisce chiaramente le risposte alle loro richieste. Segnala la presenza e l'ubicazione di documenti che possono fornire le informazioni necessarie.

I documenti rilevanti sono quelli che soddisfano le esigenze dell'utente. Un sistema IR impeccabile restituirà solo i documenti selezionati.

Coerenza degli argomenti

Topic Coherence assegna un punteggio a un singolo argomento calcolando il grado di somiglianza semantica tra i termini con punteggio elevato dell'argomento. Queste metriche aiutano a distinguere tra argomenti che sono semanticamente interpretabili e argomenti che sono artefatti di inferenza statistica.

Se un gruppo di affermazioni o fatti si supportano a vicenda, si dice che sono coerenti.

Di conseguenza, un insieme di fatti coeso può essere compreso in un contesto che comprende tutti o la maggior parte dei fatti. "Il gioco è uno sport di squadra", "il gioco si gioca con una palla" e "il gioco richiede un enorme sforzo fisico" sono tutti esempi di serie di fatti coerenti.

Diversi metodi di modellazione degli argomenti

Questa procedura critica può essere eseguita da una varietà di algoritmi o metodologie. Tra questi ci sono:

- Allocazione latente di Dirichlet (LDA)

- Fattorizzazione a matrice non negativa (NMF)

- Analisi semantica latente (LSA)

- Analisi semantica latente probabilistica (pLSA)

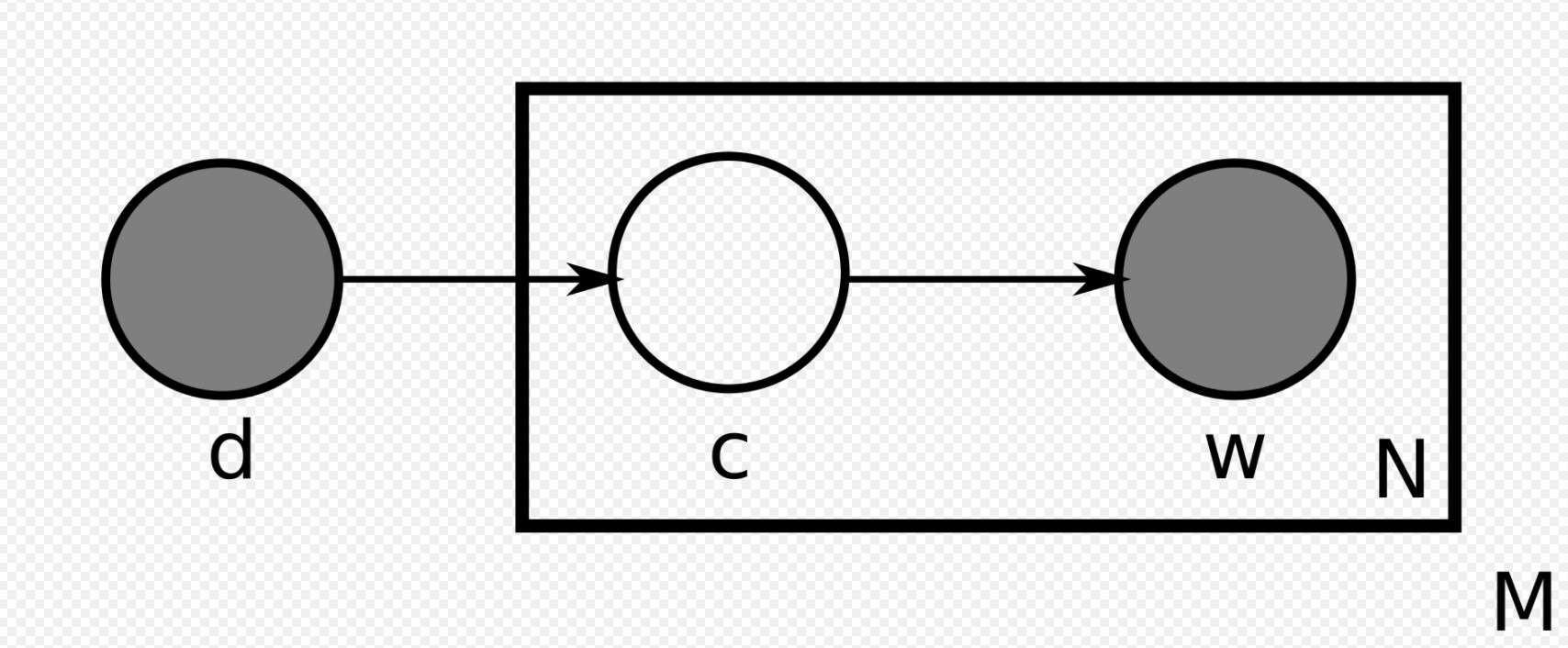

Allocazione Dirichlet latente (LDA)

Per rilevare le relazioni tra più testi in un corpus, viene utilizzato il concetto statistico e grafico di Allocazione Dirichlet latente.

Utilizzando l'approccio Variational Exception Maximization (VEM), si ottiene la più grande stima di probabilità dall'intero corpus di testo.

Tradizionalmente, vengono scelte le prime poche parole da un sacco di parole.

Tuttavia, la frase è completamente priva di significato.

Secondo questa tecnica, ogni testo sarà rappresentato da una distribuzione probabilistica di argomenti e ogni argomento da una distribuzione probabilistica di parole.

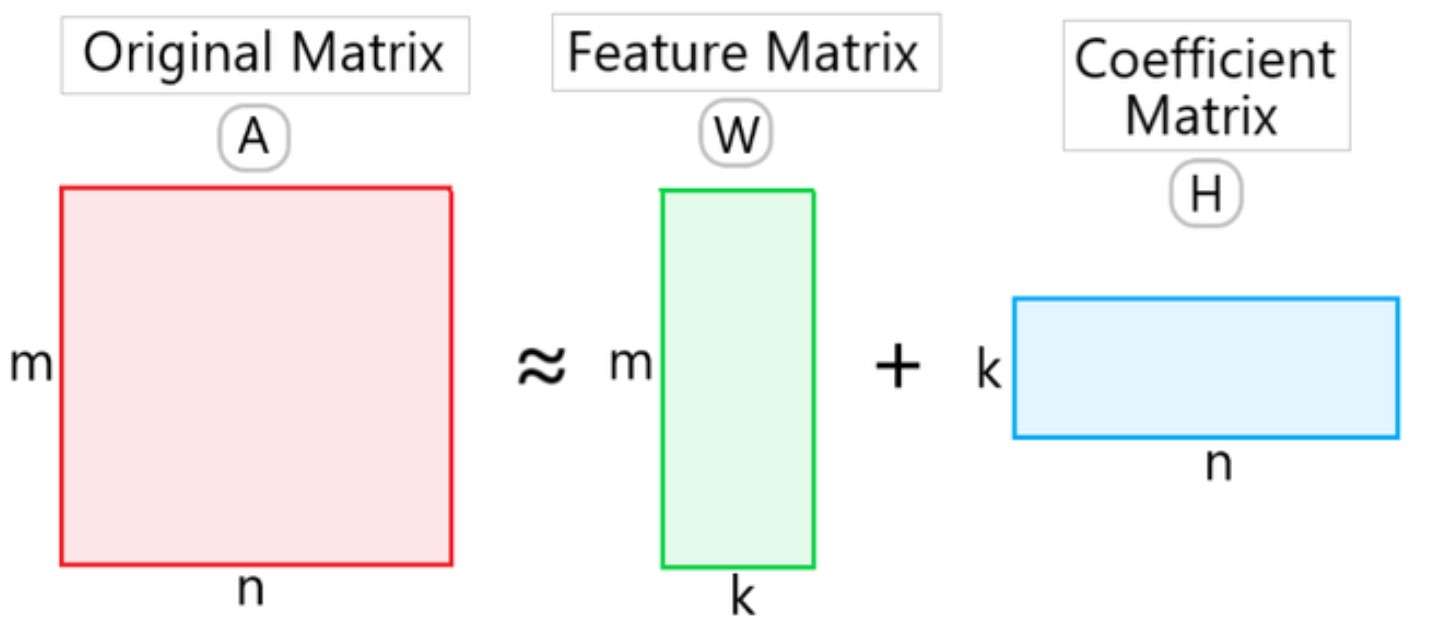

Fattorizzazione della matrice non negativa (NMF)

Matrice con valori non negativi La fattorizzazione è un approccio all'avanguardia per l'estrazione di caratteristiche.

Quando ci sono molte qualità e gli attributi sono vaghi o hanno scarsa prevedibilità, NMF è vantaggioso. NMF può generare modelli, soggetti o temi significativi combinando caratteristiche.

NMF genera ciascuna funzione come una combinazione lineare del set di attributi originale.

Ogni caratteristica contiene una serie di coefficienti che rappresentano l'importanza di ogni attributo della caratteristica. Ogni attributo numerico e ogni valore di ogni attributo di categoria ha il proprio coefficiente.

Tutti i coefficienti sono positivi.

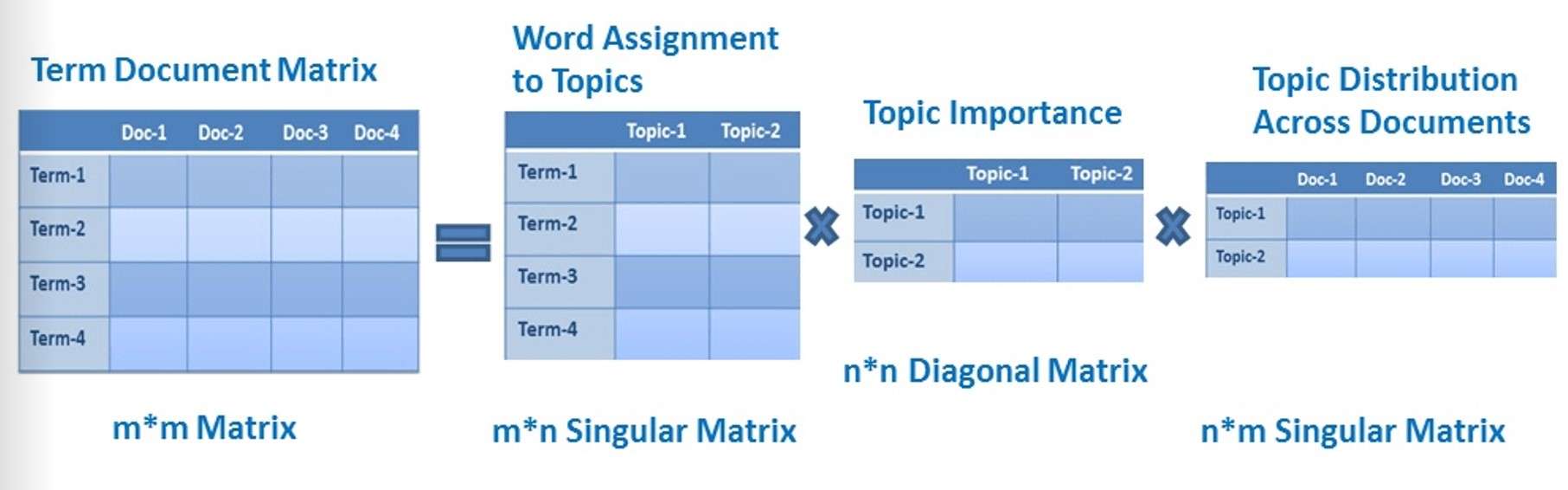

Analisi semantica latente

È un altro metodo di apprendimento non supervisionato utilizzato per estrarre associazioni tra parole in una serie di documenti è l'analisi semantica latente.

Questo ci aiuta a scegliere i documenti corretti. La sua funzione primaria è quella di ridurre la dimensionalità dell'enorme corpus di dati testuali.

Questi dati non necessari servono come rumore di fondo per acquisire le informazioni necessarie dai dati.

Analisi semantica latente probabilistica (pLSA)

L'analisi semantica latente probabilistica (PLSA), a volte nota come indicizzazione semantica latente probabilistica (PLSI, in particolare nei circoli di recupero delle informazioni), è un approccio statistico per l'analisi di dati bimodali e di co-occorrenza.

Infatti, analogamente all'analisi semantica latente, da cui è emerso il PLSA, è possibile derivare una rappresentazione a bassa dimensione delle variabili osservate in termini di affinità con particolari variabili nascoste.

Pratica con la modellazione di argomenti in Python

Ora, ti guiderò attraverso un compito di modellazione di soggetti con Python linguaggio di programmazione usando un esempio del mondo reale.

Modellerò articoli di ricerca. Il set di dati che userò qui proviene da kaggle.com. Puoi facilmente ottenere tutti i file che sto usando in questo lavoro da questo pagina.

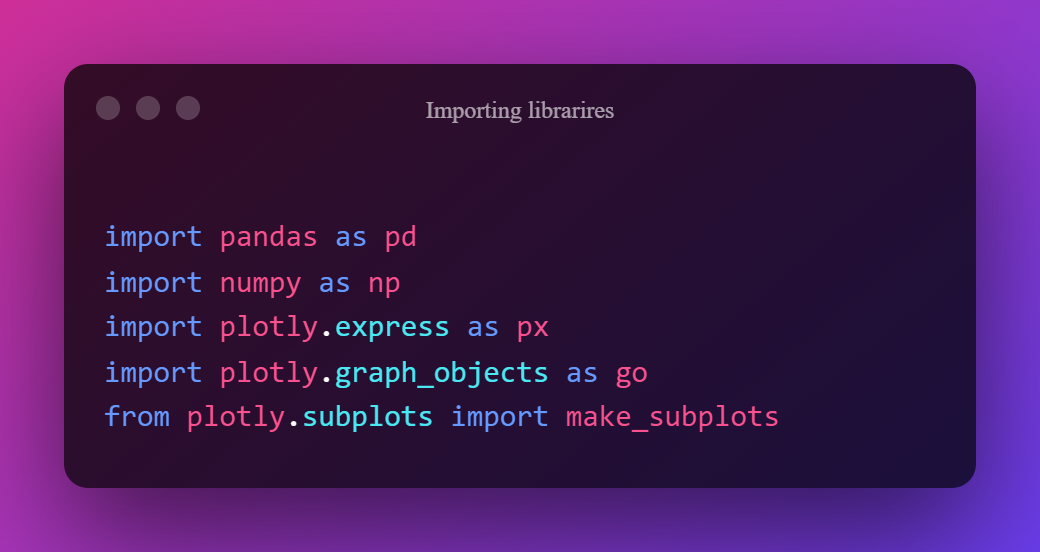

Iniziamo con Topic Modeling usando Python importando tutte le librerie essenziali:

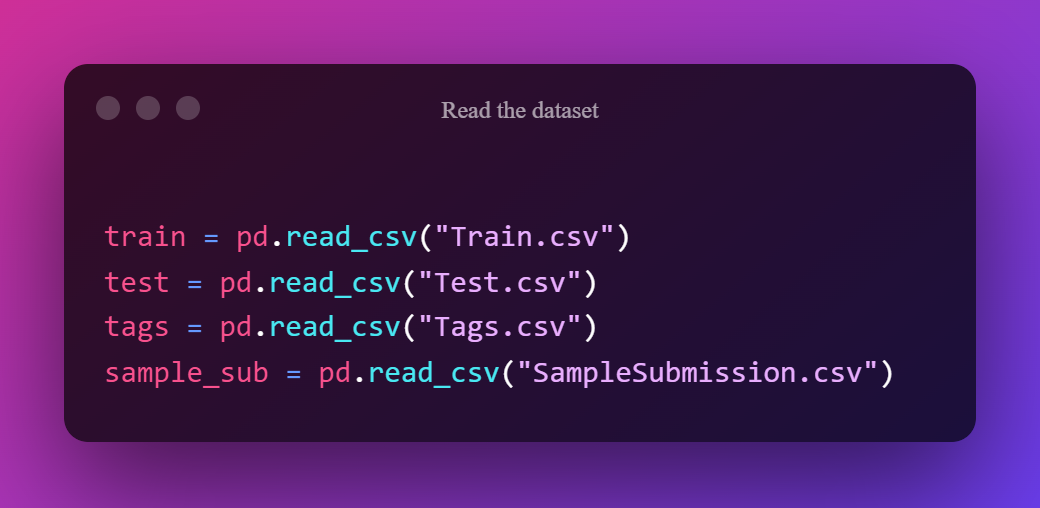

Il passaggio seguente consiste nel leggere tutti i set di dati che utilizzerò in questa attività:

Analisi dei dati esplorativi

EDA (Exploratory Data Analysis) è un metodo statistico che utilizza elementi visivi. Utilizza riepiloghi statistici e rappresentazioni grafiche per scoprire tendenze, modelli e ipotesi di test.

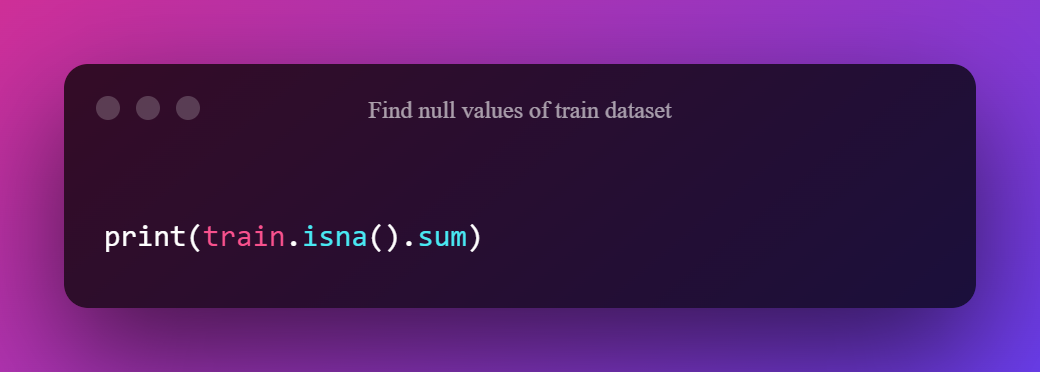

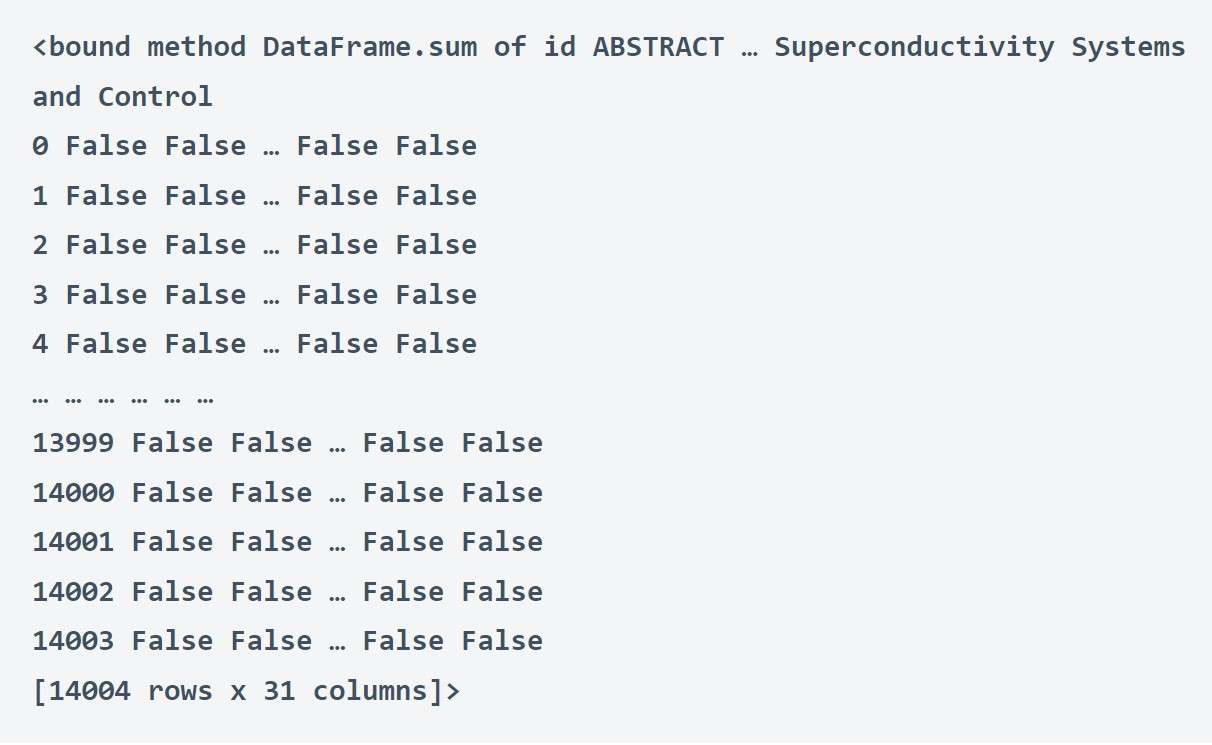

Effettuerò un'analisi esplorativa dei dati prima di iniziare la modellazione degli argomenti per vedere se sono presenti modelli o relazioni nei dati:

Ora troveremo i valori nulli del set di dati di test:

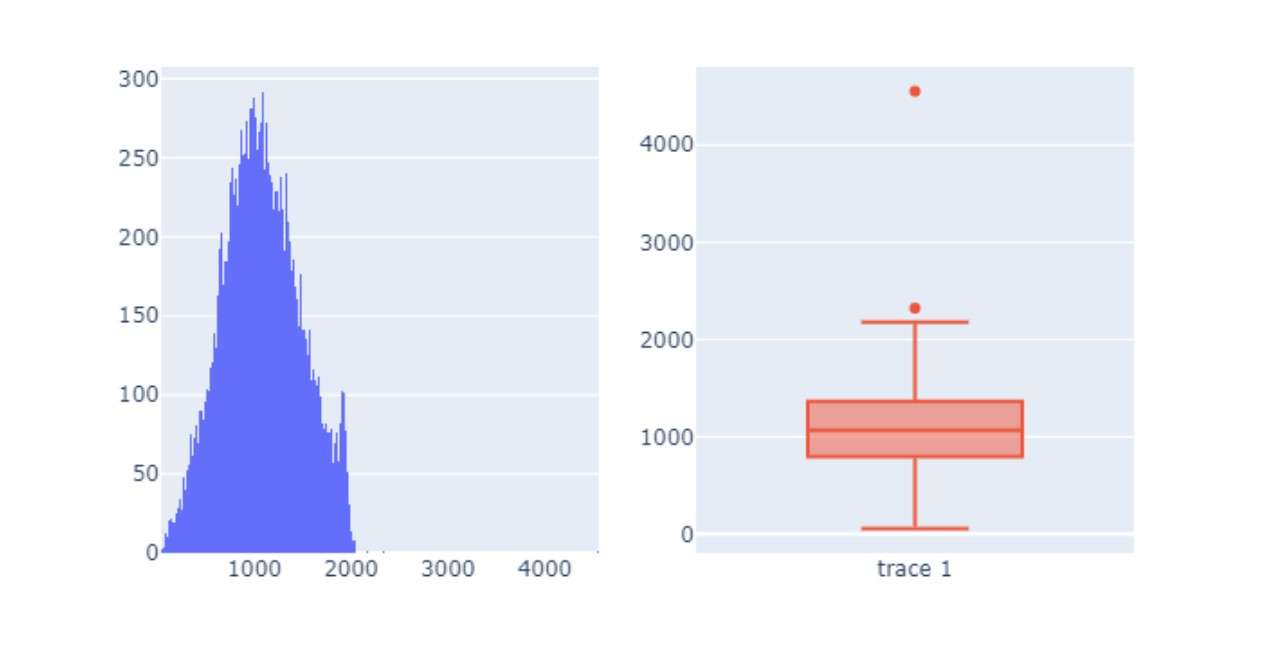

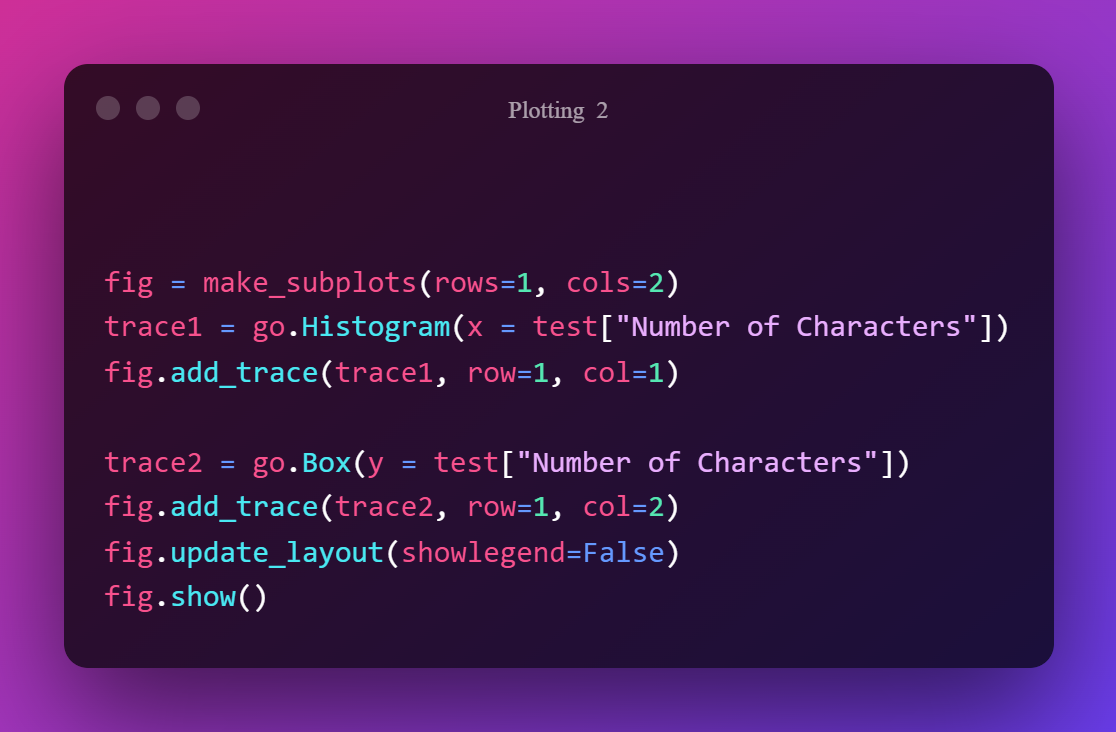

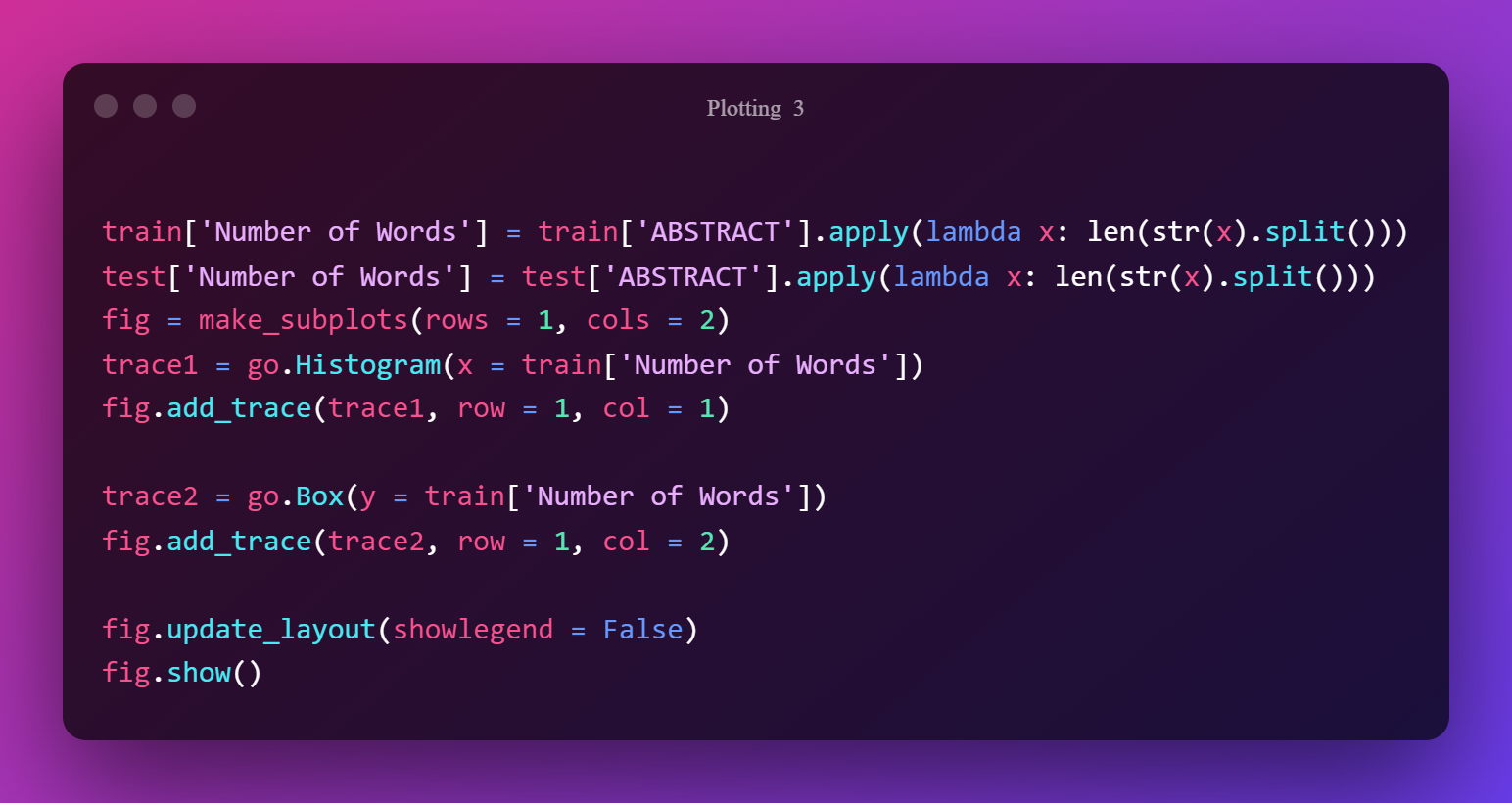

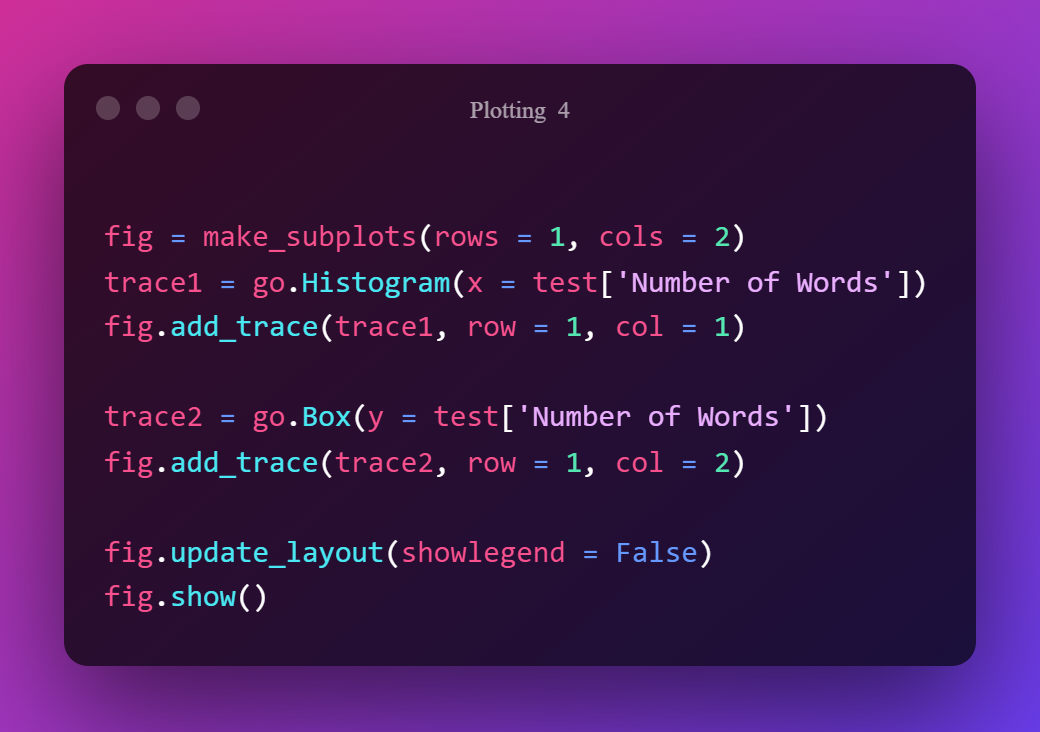

Ora traccerò un istogramma e un boxplot per verificare la relazione tra le variabili.

La quantità di personaggi nel set Abstracts of the Train varia notevolmente.

Sul treno abbiamo un minimo di 54 e un massimo di 4551 caratteri. 1065 è la quantità media di caratteri.

Il set di test sembra essere più interessante del set di addestramento poiché il set di test ha 46 caratteri mentre il set di addestramento ne ha 2841.

Di conseguenza, il set di test aveva una mediana di 1058 caratteri, che è simile al set di addestramento.

Il numero di parole nel set di apprendimento segue uno schema simile al numero di lettere.

Sono consentiti un minimo di 8 parole e un massimo di 665 parole. Di conseguenza, il conteggio medio delle parole è 153.

Sono richieste un minimo di sette parole in un abstract e un massimo di 452 parole nel test set.

La mediana, in questo caso, è 153, che è identica alla mediana del training set.

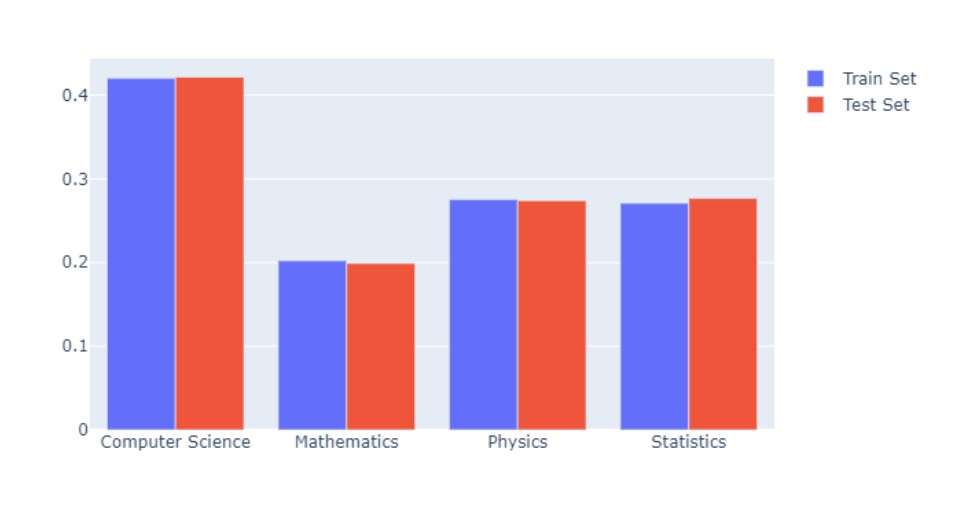

Utilizzo dei tag per la modellazione degli argomenti

Esistono diverse strategie di modellazione degli argomenti. Userò i tag in questo esercizio; diamo un'occhiata a come farlo esaminando i tag:

Applicazioni della modellazione di argomenti

- Un riassunto testuale può essere utilizzato per discernere l'argomento di un documento o di un libro.

- Può essere utilizzato per rimuovere la distorsione del candidato dal punteggio dell'esame.

- La modellazione degli argomenti potrebbe essere utilizzata per costruire relazioni semantiche tra le parole nei modelli basati su grafici.

- Può migliorare il servizio clienti rilevando e rispondendo alle parole chiave nella richiesta del cliente. I clienti avranno più fiducia in te poiché hai fornito loro l'assistenza di cui hanno bisogno al momento opportuno e senza causare loro alcun problema. Di conseguenza, la fedeltà dei clienti aumenta notevolmente e il valore dell'azienda aumenta.

Conclusione

La modellazione tematica è una sorta di modellazione statistica utilizzata per scoprire "soggetti" astratti che esistono in una raccolta di testi.

È una forma del modello statistico utilizzato in machine learning e l'elaborazione del linguaggio naturale per scoprire concetti astratti che esistono in un insieme di testi.

È un metodo di estrazione del testo ampiamente utilizzato per trovare modelli semantici latenti nel corpo del testo.

Lascia un Commento