Anda mungkin pernah mendengar tentang seberapa kuat model AI teks-ke-gambar dalam beberapa tahun terakhir. Tapi tahukah Anda bahwa teknologi yang sama dapat membantu membuat lompatan dari 2D ke 3D?

Model 3D yang dihasilkan AI memiliki kasus penggunaan yang luas dalam lanskap digital saat ini. Video game dan film mengandalkan seniman 3D terampil dan perangkat lunak pemodelan seperti Blender untuk membuat aset 3D untuk mengisi adegan yang dihasilkan komputer.

Namun, apakah mungkin industri dapat menggunakan pembelajaran mesin untuk membuat aset 3D dengan sedikit usaha, serupa dengan bagaimana seniman 2D saat ini mulai mengadopsi teknologi seperti DALL-E dan tengah perjalanan?

Artikel ini akan mengeksplorasi algoritme baru yang mencoba membuat model teks-ke-3D yang efektif menggunakan yang sudah ada model difusi.

Apa itu Penggabungan mimpi?

Salah satu masalah utama dalam membuat model difusi yang menghasilkan aset 3D secara langsung adalah tidak tersedianya banyak data 3D. Model difusi 2D telah menjadi sangat kuat karena banyaknya kumpulan data gambar yang ditemukan di internet. Hal yang sama tidak dapat dikatakan dengan aset 3D.

Beberapa teknik generatif 3D mengatasi kekurangan data ini dengan memanfaatkan kelimpahan data 2D ini.

Penggabungan Mimpi adalah model generatif yang dapat membuat model 3D berdasarkan deskripsi teks yang disediakan. Model DreamFusion menggunakan model difusi teks-ke-gambar pra-pelatihan untuk menghasilkan model tiga dimensi realistis dari permintaan teks.

Meskipun tidak memiliki data pelatihan 3D, pendekatan ini telah menghasilkan aset 3D yang koheren dengan tampilan dan kedalaman fidelitas tinggi.

Bagaimana Apakah Ini Bekerja?

Algoritma DreamFusion terdiri dari dua model utama: model difusi 2D dan a saraf jaringan yang dapat mengubah gambar 2D menjadi adegan 3D yang kohesif.

Model Teks-ke-Gambar Imagen Google

Bagian pertama dari algoritma adalah model difusi. Model ini bertanggung jawab untuk mengubah teks menjadi gambar.

Gambar adalah model difusi yang dapat menghasilkan sampel variasi gambar yang besar dari suatu objek tertentu. Dalam hal ini, variasi gambar kita harus mencakup semua kemungkinan sudut dari objek yang disediakan. Misalnya, jika kita ingin membuat model kuda 3D, kita ingin gambar kuda 2D dari semua sudut yang memungkinkan. Tujuannya adalah menggunakan Imagen untuk memberikan informasi sebanyak mungkin (warna, pantulan, kerapatan) untuk model berikutnya dalam algoritme kami.

Membuat Model 3D dengan NeRF

Selanjutnya, Dreamfusion menggunakan model yang dikenal sebagai a Medan Cahaya Saraf atau NeRF untuk benar-benar membuat model 3D dari kumpulan gambar yang dihasilkan. NeRF mampu membuat adegan 3D yang kompleks dengan memberikan kumpulan data gambar 2D.

Mari kita coba memahami cara kerja NeRF.

Model ini bertujuan untuk membuat fungsi scene volumetrik kontinu yang dioptimalkan dari kumpulan data gambar 2D yang disediakan.

Jika model membuat fungsi, apa input dan outputnya?

Fungsi adegan mengambil lokasi 3D dan arah tampilan 2D sebagai masukan. Fungsi tersebut kemudian menampilkan warna (dalam bentuk RGB) dan kerapatan volume tertentu.

Untuk menghasilkan gambar 2D dari sudut pandang tertentu, model akan menghasilkan sekumpulan titik 3D dan menjalankan titik tersebut melalui fungsi pemandangan untuk mengembalikan kumpulan nilai kerapatan warna dan volume. Teknik rendering volume kemudian akan mengubah nilai tersebut menjadi output gambar 2D.

Menggunakan Model Difusi NeRF dan 2D Secara Bersamaan

Sekarang setelah kita mengetahui cara kerja NeRF, mari kita lihat bagaimana model ini dapat menghasilkan model 3D yang akurat dari gambar yang kita hasilkan.

Untuk setiap prompt teks yang disediakan, DreamFusion melatih NeRF yang diinisialisasi secara acak dari awal. Setiap iterasi memilih posisi kamera secara acak dalam satu set koordinat bola. Pikirkan model yang terbungkus bola kaca. Setiap kali kita menghasilkan gambar baru dari model 3D kita, kita akan memilih titik acak di bola kita sebagai titik pandang keluaran kita. DreamFusion juga akan memilih posisi cahaya secara acak l untuk digunakan untuk rendering.

Setelah kita memiliki kamera dan posisi cahaya, model NeRF akan dirender. DreamFusion juga akan memilih secara acak antara render berwarna, render tanpa tekstur, dan rendering albedo tanpa bayangan apa pun.

Kami telah menyebutkan sebelumnya bahwa kami ingin model teks-ke-gambar (Imagen) kami menghasilkan gambar yang cukup untuk membuat sampel yang representatif.

Bagaimana Dreamfusion mencapai ini?

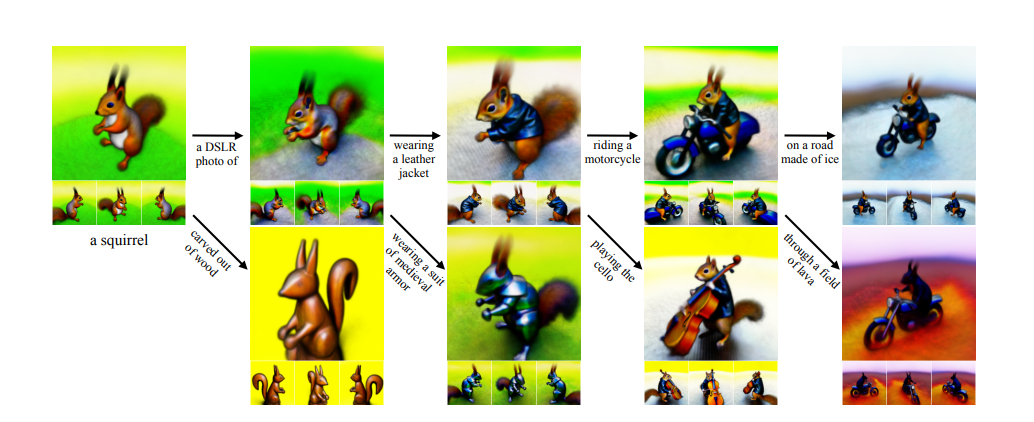

Dreamfusion hanya mengubah input prompt sedikit untuk mencapai sudut yang diinginkan. Misalnya, kita dapat mencapai sudut elevasi tinggi dengan menambahkan "overhead view" ke prompt kita. Kita dapat menghasilkan sudut lain dengan menambahkan frase seperti "tampak depan", "tampak samping", dan "tampak belakang".

Adegan berulang kali dirender dari posisi kamera acak. Rendering ini kemudian melewati fungsi kehilangan distilasi skor. Pendekatan penurunan gradien sederhana perlahan akan meningkatkan Model 3D sampai cocok dengan adegan yang dijelaskan oleh teks.

Setelah kita merender model 3D menggunakan NeRF, kita dapat menggunakan Algoritma Marching Cubes untuk menghasilkan mesh 3D dari model kita. Jala ini kemudian dapat diimpor ke perender 3D populer atau perangkat lunak pemodelan.

keterbatasan

Sementara output DreamFusion cukup mengesankan karena menggunakan model difusi teks-ke-gambar yang ada dengan cara baru, para peneliti telah mencatat beberapa keterbatasan.

Fungsi kerugian SDS telah diamati untuk menghasilkan hasil yang terlalu jenuh dan terlalu halus. Anda dapat mengamati ini dalam pewarnaan yang tidak alami dan kurangnya detail yang tepat yang ditemukan pada hasil keluaran.

Algoritma DreamFusion juga dibatasi oleh resolusi keluaran model Imagen, yaitu 64 x 64 piksel. Hal ini menyebabkan model yang disintesis tidak memiliki detail yang lebih baik.

Terakhir, para peneliti mencatat bahwa ada tantangan yang melekat dalam mensintesis model 3D dari data 2D. Ada banyak kemungkinan model 3D yang dapat kami hasilkan dari kumpulan gambar 2D, yang membuat pengoptimalan menjadi cukup sulit dan bahkan ambigu.

Kesimpulan

Rendering 3D DreamFusion bekerja sangat baik karena kemampuan model difusi teks-ke-gambar untuk membuat objek atau pemandangan apa pun. Sangat mengesankan bagaimana jaringan saraf dapat memahami adegan dalam ruang 3D tanpa data pelatihan 3D. Saya sarankan membaca seluruh kertas untuk mempelajari lebih lanjut tentang detail teknis dari algoritma DreamFusion.

Mudah-mudahan, teknologi ini akan meningkat untuk akhirnya membuat model 3D foto-realistis. Bayangkan seluruh video game atau simulasi yang menggunakan lingkungan buatan AI. Itu bisa menurunkan penghalang masuknya pengembang video game untuk menciptakan dunia 3D yang imersif!

Menurut Anda peran apa yang akan dimainkan oleh model teks-ke-3D di masa mendatang?

Tinggalkan Balasan