Մարկ Ցուկերբերգի տեսանյութերը, որոնք ընդունում է տվյալների գողությունը և Բարաք Օբամայի չարաշահումը Դոնալդ Թրամփին, արդեն երկար ժամանակ է, ինչ տարածվում են համացանցում:

Այս տեսանյութերը Deepfake անունով շատ առաջադեմ և ֆուտուրիստական AI տեխնոլոգիայի արդյունք են:

Պարզ ասած, դա ֆոտոշոփի այլընտրանք է տեսանյութի համար: Մի կողմից, այն կարող է հեղափոխել էլեկտրոնային լրատվամիջոցները՝ վերացնելով իրական անձի կարիքը:

Մյուս կողմից, դա լրջորեն սպառնում է մարդու ինքնությանը, քանի որ դուք կարող եք ստիպել որևէ մեկին որևէ բան ասել տեսանյութով:

Deepfakes-ի օգտագործումը խորը ուսուցում կեղծ իրադարձությունների լուսանկարներ և տեսանյութեր ստեղծելու համար, այստեղից էլ կոչվում է deepfake: Այն կարող է ոչ միայն փոխել դեմքերը գոյություն ունեցող տեսանյութերի վրա, այլև ստեղծել նոր շրջանակներ և տեսանյութեր զրոյից:

Deepfakes-ի ծագումը

Մեծ գիտական հետազոտություններ վերջին մի քանի տարիների ընթացքում անցել է լուսանկարների և տեսանյութերի մանիպուլյացիայի սահմանները: Deepfake-ը նույնպես այս ակադեմիական հետազոտությունների արդյունքն է։

Տեսանյութի մանիպուլյացիայի առաջին դեպքը գրանցվել է 1997թ.-ին: Անձի տեսանյութը փոփոխվել է այլ աուդիո ուղու մեջ պարունակվող բառերն արտահայտելու համար: Դա դեմքի վերակենդանացման առաջին դեպքն էր Machine Learning տեխնիկան:

Հետագա ուշագրավ առաջընթացը տեղի ունեցավ 2017 թվականին, երբ ԱՄՆ նախկին նախագահ Բարաք Օբամայի տեսանյութը փոփոխվեց՝ տարբեր ձայնային ուղու համընկնող տարբեր բառեր արտասանելու համար:

2018 թվականին Բերկլիի Կալիֆոռնիայի համալսարանի հետազոտողները ներկայացրել են հավելված, որը կարող է ստեղծել ա կեղծ պարային տեսանյութ՝ օգտագործելով խորը ուսուցում. Սա նշանավորեց խորը ֆեյքերի ընդլայնումը ամբողջ մարմնի վրա, քանի որ նախորդ աշխատանքները սահմանափակվում էին դեմքերով:

Ինչպե՞ս են ստեղծվում Deepfakes-ը:

Հաշվողական առաջընթացի շնորհիվ այժմ դուք կարող եք զարգացնել խորը ֆեյքեր համեմատաբար հեշտությամբ և ցածր գնով: Դիփֆեյք ստեղծելու համար օգտագործվում են երկու հիմնական մեթոդ.

Մեթոդ 1

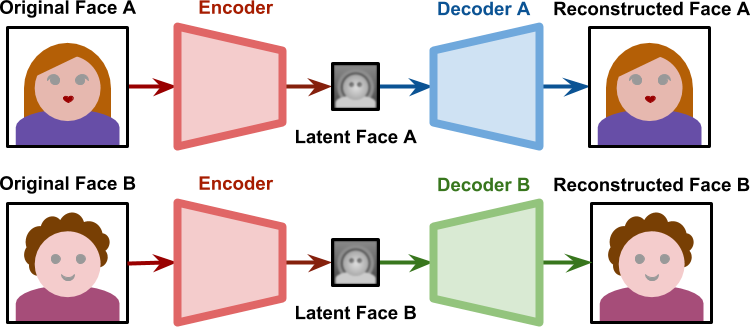

Դուք ստիպված կլինեք մարզել ա նյարդային ցանց անձի իրական տեսագրության վրա. Սա թույլ կտա նյարդային ցանց հասկանալ առարկայի դեմքի հատկությունները տարբեր անկյուններում և լուսավորության պայմաններում:

Դրանից հետո դուք կմշակեք և՛ սկզբնական դեմքը, և՛ թաքնված դեմքը AI ալգորիթմի միջոցով, որը կոչվում է կոդավորիչ: Այն կգտնի և կսովորի երկու դեմքերի միջև եղած տարբերություններն ու նմանությունները, և երկու դեմքերը վերածվում են սեղմված պատկերի, որը կիսում է ընդհանուր հատկանիշները:

Այնուհետև գալիս է երկրորդ AI ալգորիթմը, որը կոչվում է ապակոդավորիչ, որը վերականգնում է դեմքերը սեղմված պատկերներից: Երկու դեմքերը վերականգնվում են երկու տարբեր ապակոդավորիչների միջոցով:

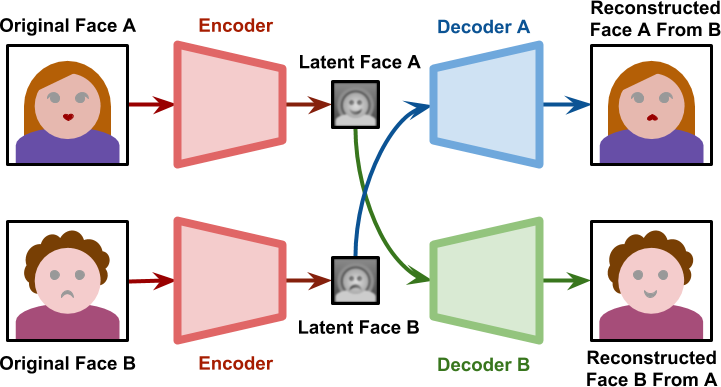

Դեմքի փոխանակումն իրականացնելու համար դուք պարզապես կոդավորված պատկերները կերակրում եք մյուս ապակոդավորիչին:

Օրինակ, A դեմքի կոդավորիչի ելքը սնվում է B դեմքի վրա վարժեցված ապակոդավորիչի մեջ, որն այնուհետև վերակառուցում է B դեմքը դեմքի A դեմքի հատկություններով: Համոզիչ արդյունք ստանալու համար դուք պետք է դա անեք տեսանյութի յուրաքանչյուր կադրում:

Մեթոդ 2

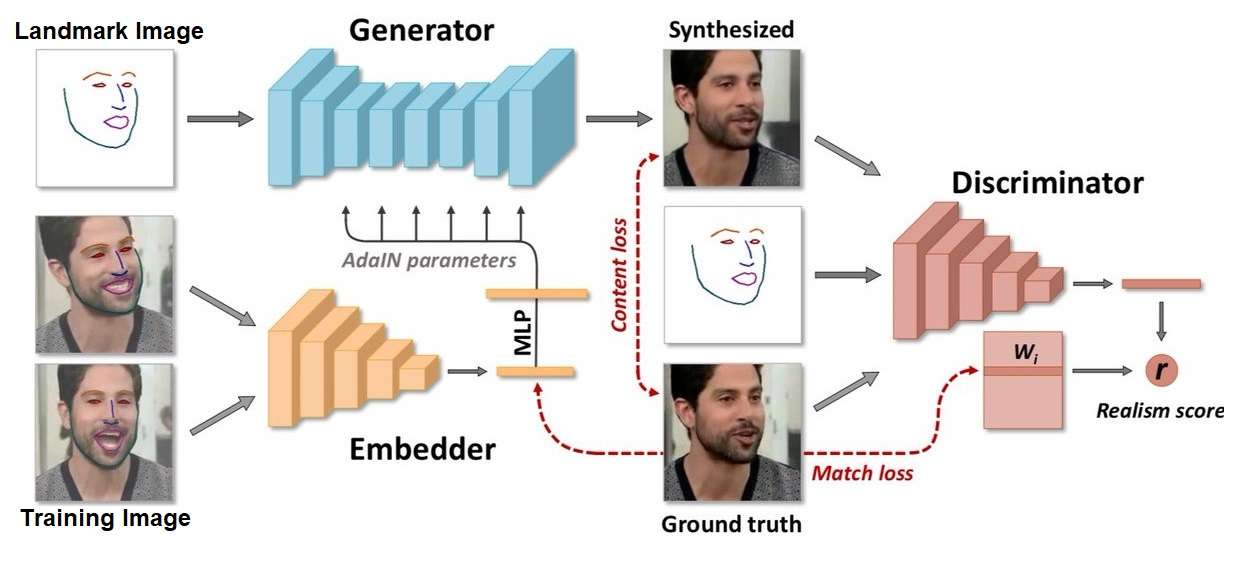

Դիփֆեյք ստեղծելու մեկ այլ մեթոդ է Generative Adversarial Network (GAN):

Դիփֆեյք ստեղծելու համար դուք պետք է օգտագործեք երկու մրցակցող ալգորիթմներ: Առաջինը կօգտագործի պատահական աղմուկ՝ պատկեր ստեղծելու համար, և հետևաբար այն կոչվում է գեներատոր: Այս սինթետիկ պատկերը սնվում է իրական պատկերների հոսքին երկրորդ ալգորիթմի միջոցով, որը կոչվում է տարբերակիչ:

Խտրականացնողը հետադարձ կապ է տրամադրում գեներատորին, որն առաջացնում է մեկ այլ պատկեր՝ ըստ հետադարձ կապի: Այսպիսով, երկու ալգորիթմներն էլ յուրաքանչյուր կրկնությունից ավելի լավ արդյունքներ են տալիս: Այս գործընթացը կրկնվում է բազմիցս, մինչև ձեռք բերվի ճշգրտության անհրաժեշտ մակարդակ:

GAN-ը տալիս է միանգամայն իրատեսական արդյունքներ, սակայն դրա հետ աշխատելը դժվար է և պահանջում է հսկայական քանակությամբ ուսումնական տվյալներ և հաշվողական հզորություն: Այդ իսկ պատճառով այն հիմնականում նախընտրելի է պատկերներ ստեղծելու համար, քան տեսահոլովակներ:

Deepfakes-ի մի քանի համոզիչ օրինակներ

Կան մի քանի շատ համոզիչ խորը ֆեյքեր, որոնք պտտվում են համացանցի շուրջ, և դրանց մեծ մասը հայտնի մարդկանցից է:

Օրինակ, կա TikTok հաշիվ, որը բացառապես նվիրված է Թոմ Քրուզի խորը կեղծիքներին: Տեսանյութերը ցույց են տալիս, որ Կրուիզը գոլֆ է խաղում կամ ցուցադրում է կախարդական հնարք:

@deeptomcruise Ճանապարհորդություն. ????

Մեկ այլ շատ բարդ խորը ֆեյք է վերբեռնվել YouTube-ում՝ Թոմ Քրուզի, Ռոբերտ Դաունի կրտսերի, Ջեֆ Գոլդբլումի, Ջորջ Լուկասի և Յուան Մաքգրեգորի մասնակցությամբ: Այն ունի որոշ ակնհայտ թերություններ, բայց տեսանյութում միաժամանակ 3-ից 4 խորը ֆեյք մշակելը ինքնին սխրանք է:

Մեկ այլ օրինակ է նախկին նախագահ Բարաք Օբամայի խորը կեղծ տեսանյութը:

Այս մեկը ապշեցուցիչ համոզիչ է, քանի որ այն օգտագործում է նմանակողների ձայներն ու ժեստերը, որոնք կարող են ընդօրինակել առարկայի ձայներն ու ժեստերը:

Այժմ մենք տեսնում ենք խորը կեղծիքներ ժամանակակից հիմնական ժամանցային արդյունաբերության մեջ:

Այն օգտագործվել է «Ֆորսաժ 7»-ում Փոլ Ուոքերի տեսարանները նկարահանելու համար՝ դերասանի անսպասելի մահից հետո։ Դիփֆեյքը նրա եղբոր վրա օգտագործվել է ուշագրավ ճշգրտությամբ։

Ի՞նչ են Deepfakes-ը բերում սեղանին:

Deepfakes-ը ապացուցել է, որ շատ հուսալի տեխնոլոգիա է լրատվամիջոցների և զվարճանքի ոլորտում հեղափոխություն անելու համար:

Կարո՞ղ եք հիշել, երբ Հենրի Քավիլի բեղերը հանեցին CGI-ն «Պողպատե մարդը» ֆիլմում, և դա աղետ էր:

Նույնը հիմա կարելի է անել մի քանի հազար դոլարանոց համակարգիչների վրա՝ շատ ավելի համոզիչ արդյունքներով:

Այժմ դուք կարող եք հանդիպել ձեր մահացած նախնիներին և սիրելիներին: Դուք նույնիսկ կարող եք մասնակցել ֆիզիկայի դասախոսությանը հենց Ալբերտ Էյնշտեյնի կողմից:

Բացի այս ամենից, deepfake-ն ամբողջությամբ չի օգտագործվել այնպես, ինչպես նախատեսված էր: Ինտերնետում հայտնված խորը ֆեյքերի մոտ 96%-ը ոչ համաձայնության պոռնոգրաֆիա է:

Հայտնի մարդկանց համար հասանելի թրեյնինգի տվյալների մեծ քանակությունը հանգեցրել է նրան, որ նրանք դառնում են deepfakes-ի ամենաթիրախային զոհերը:

Դա մեզ հնարավորություն է տվել որևէ մեկին դնելու վտանգավոր կամ զիջումային սցենարների մեջ և հետևաբար դա մեծ վտանգ է ներկայացնում բոլորի համար:

Հաղորդվում է, որ աուդիո խորը կեղծիքներն օգտագործվել են կորպորացիաներին խաբելու համար: 2019 թվականին նմանակողն օգտագործել է խորը կեղծ ձայնագրություն՝ հրահանգելու Մեծ Բրիտանիայում գործող ընկերության գործադիր տնօրենին 220,000 եվրո փոխանցել հունգարական բանկ՝ նմանակելով ֆիրմայի մայր ընկերության գործադիրին:

Ինչպե՞ս դիմակայել վնասակար Deepfakes-ին:

Սովորաբար, դուք կարող եք հայտնաբերել խորը կեղծ տեսանյութեր՝ ուշադիր դիտելով կադր առ կադր և փնտրելով արտեֆակտներ և անկանոնություններ:

Այնուամենայնիվ, դա հակաինտուիտիվ գործընթաց է, և շատ ընկերություններ աշխատում են ալգորիթմների և ծրագրային ապահովման վրա հայտնաբերել խորը կեղծիքներ.

Facebook-ը հավաքագրել է Բերկլիի, Օքսֆորդի և այլ հաստատությունների հետազոտողների՝ խորը կեղծ դետեկտոր ստեղծելու համար: Նմանապես, YouTube-ը հայտարարեց, որ իրենք չեն ընդունի խորը կեղծ տեսանյութեր՝ կապված ԱՄՆ ընտրությունների, քվեարկության ընթացակարգերի կամ 2020 թվականի ԱՄՆ մարդահամարի հետ:

Կարող եք նաև օգտագործել այնպիսի ծրագրեր, ինչպիսիք են Իրականության պաշտպան և Deeptrace-ը՝ deepfakes-ը հայտնաբերելու համար:

Երկրները նաև զբաղված են օրենսդրության մշակմամբ՝ առհասարակ դիփֆեյքերի օգտագործման հետ կապված: Անցած տարվա ընթացքում ԱՄՆ-ը մի քանի օրենք է կիրառել՝ կապված deepfakes-ի հետ:

Փաթեթավորեք

Deepfake-ը AI-ի առաջխաղացման կենդանի մարմնացումն է: Այն ավելի է լղոզում ապագայի սահմանները, սակայն այն պոտենցիալ սպառնալիք է համացանցում տեսա-գրաֆիկական բովանդակության վստահելիության համար:

Կգա ժամանակ, երբ մարդիկ կսկսեն կասկածել համացանցի յուրաքանչյուր տեսանյութի վրա, և մենք կտեղափոխվենք հետագա անորոշության դարաշրջան:

Թողնել գրառում