Índice analítico[Ocultar][Mostrar]

Un dos criterios principais para calquera tipo de actividade corporativa é a utilización eficaz da información. Nalgún momento, o volume de datos creados supera a capacidade de procesamento básico.

Aí é onde entran en xogo os algoritmos de aprendizaxe automática. Non obstante, antes de que isto poida ocorrer, a información debe ser estudada e interpretada. En poucas palabras, é para o que se usa a aprendizaxe automática non supervisada.

Neste artigo, examinaremos a aprendizaxe automática sen supervisión en profundidade, incluíndo os seus algoritmos, casos de uso e moito máis.

Que é a aprendizaxe automática sen supervisión?

Os algoritmos de aprendizaxe automática non supervisados identifican patróns nun conxunto de datos que non teñen unha consecuencia coñecida nin etiquetada. Supervisado algoritmos de aprendizaxe automática ter unha saída etiquetada.

Coñecer esta distinción axúdache a comprender por que non se poden usar métodos de aprendizaxe automática sen supervisión para resolver problemas de regresión ou clasificación, xa que non sabes cal pode ser o valor/resposta dos datos de saída. Non pode adestrar un algoritmo normalmente se non coñece o valor/resposta.

Ademais, a aprendizaxe non supervisada pódese utilizar para identificar a estrutura fundamental dos datos. Estes algoritmos detectan patróns ocultos ou agrupacións de datos sen necesidade de interacción humana.

A súa capacidade para detectar semellanzas e contrastes na información convérteo nunha excelente opción para a análise exploratoria de datos, técnicas de venda cruzada, segmentación de consumidores e identificación de imaxes.

Considere o seguinte escenario: estás nun supermercado e ves unha froita sen identificar que nunca antes viches. Podes distinguir facilmente a froita descoñecida diferente das outras froitas da túa contorna en función das túas observacións da súa forma, tamaño ou cor.

Algoritmos de aprendizaxe automática sen supervisión

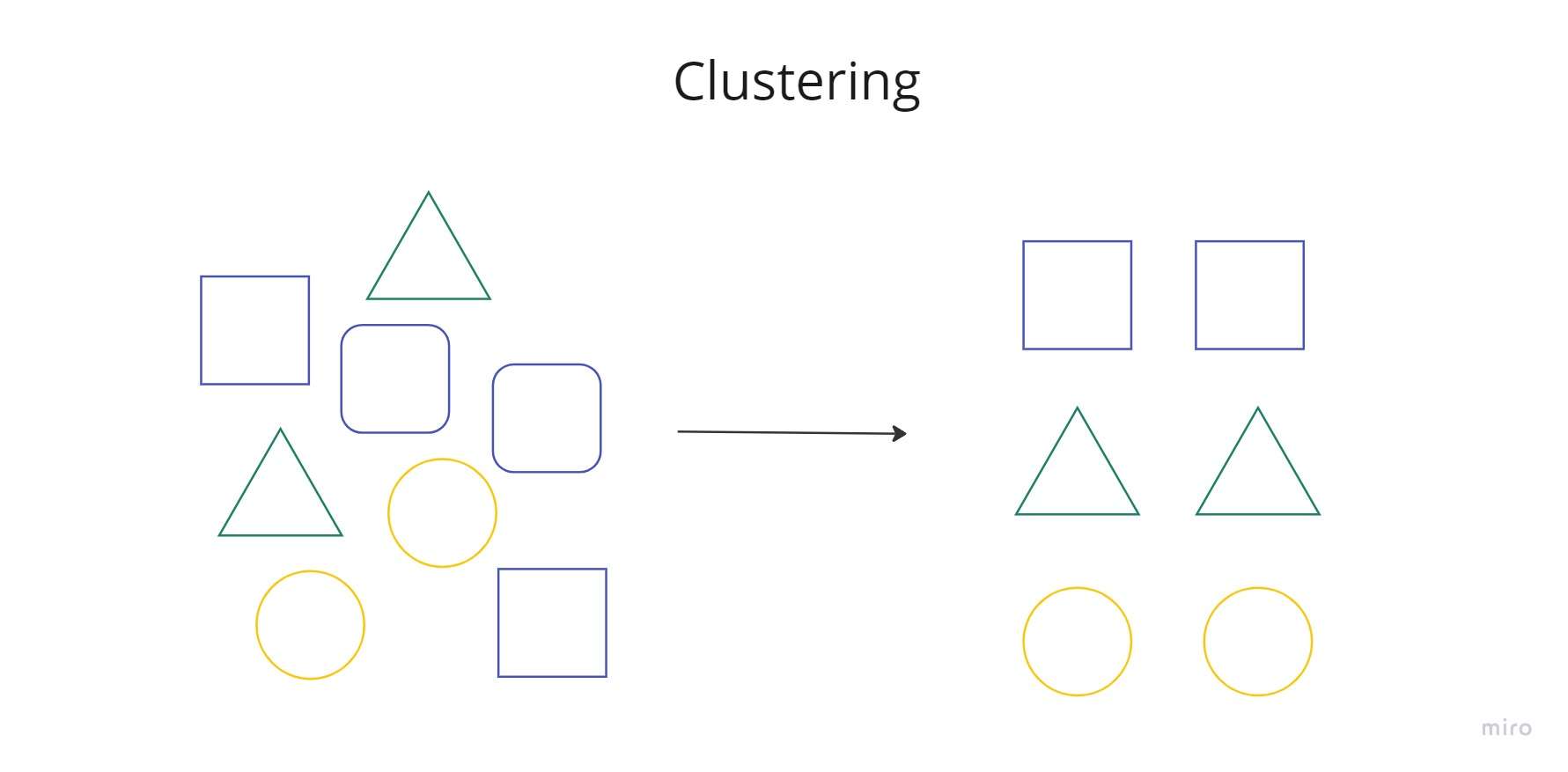

Agrupamento

A agrupación é, sen dúbida, o enfoque de aprendizaxe sen supervisión máis utilizado. Este enfoque coloca elementos de datos relacionados en clústeres xerados aleatoriamente.

Por si mesmo, un modelo de ML descobre calquera patrón, semellanza e/ou diferenza nunha estrutura de datos sen categoría. Un modelo poderá descubrir calquera agrupación ou clase natural nos datos.

Tipos

Hai varias formas de agrupación que se poden usar. Vexamos primeiro os máis importantes.

- A agrupación exclusiva, ás veces coñecida como agrupación "dura", é un tipo de agrupación no que unha única peza de datos pertence a un só clúster.

- A agrupación superposta, coñecida a miúdo como agrupación "suave", permite que os obxectos de datos pertenzan a máis dun clúster en diferentes graos. Ademais, a agrupación probabilística pódese utilizar para abordar problemas de agrupación ou estimación de densidade "suave", así como para avaliar a probabilidade ou probabilidade de que os puntos de datos pertenzan a determinados clústeres.

- Crear unha xerarquía de elementos de datos agrupados é o obxectivo da agrupación xerárquica, como o nome indica. Os elementos de datos deconstrúense ou combínanse en función da xerarquía para xerar clústeres.

Casos de uso:

- Detección de anomalías:

Calquera tipo de valor atípico nos datos pódese detectar mediante a agrupación. As empresas de transporte e loxística, por exemplo, poden utilizar a detección de anomalías para descubrir impedimentos loxísticos ou revelar pezas mecánicas danadas (mantemento preditivo).

As entidades financeiras poden usar a tecnoloxía para detectar transaccións fraudulentas e responder rapidamente, o que pode aforrar moito diñeiro. Obtén máis información sobre como detectar anomalías e fraudes vendo o noso vídeo.

- Segmentación de clientes e mercados:

Os algoritmos de agrupación poden axudar a agrupar persoas que teñen características similares e a crear persoas de consumidores para un marketing máis eficaz e iniciativas dirixidas.

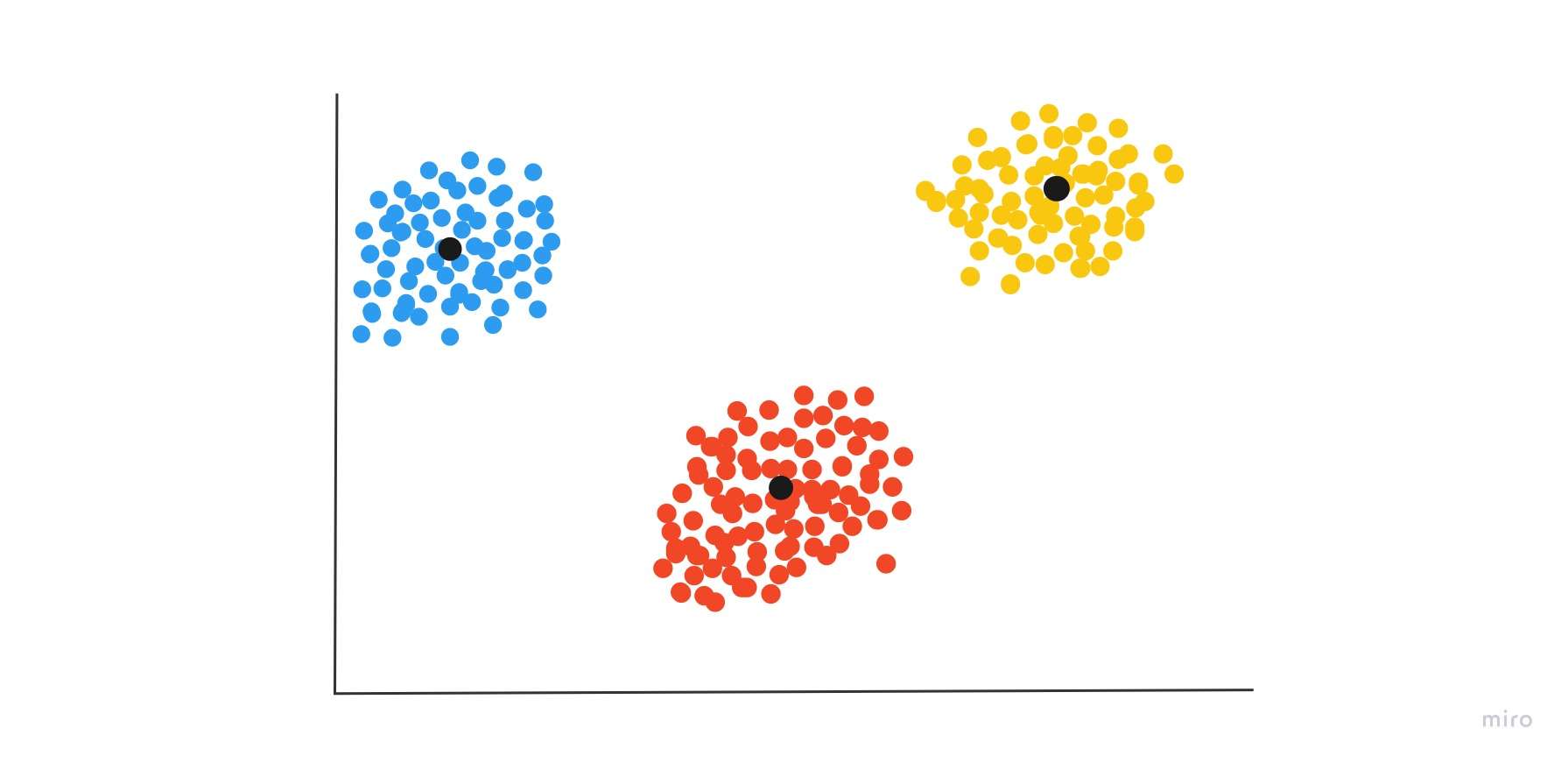

K-Medios

K-means é un método de agrupación que tamén se coñece como partición ou segmentación. Divide os puntos de datos nun número predeterminado de clusters coñecido como K.

No método K-means, K é a entrada xa que lle indicas ao ordenador cantos clústeres queres identificar nos teus datos. Cada elemento de datos asígnase posteriormente ao centro do clúster máis próximo, coñecido como centroide (puntos negros na imaxe).

Estes últimos serven como espazos de almacenamento de datos. A técnica de agrupación pódese facer varias veces ata que os clústeres estean ben definidos.

Medios K difusos

Fuzzy K-means é unha extensión da técnica de K-means, que se usa para facer agrupacións superpostas. A diferenza da técnica de K-means, as K-means difusas indican que os puntos de datos poden pertencer a moitos clusters con distintos graos de proximidade a cada un.

A distancia entre os puntos de datos e o centroide do clúster utilízase para calcular a proximidade. Como resultado, pode haber ocasións nas que varios grupos se solapan.

Modelos Gaussianos de Mesturas

Os modelos de mestura gaussiana (GMM) son un método usado na agrupación probabilística. Debido a que a media e a varianza son descoñecidas, os modelos supoñen que hai un número fixo de distribucións gaussianas, representando cada unha un grupo distinto.

Para determinar a que cluster pertence un punto de datos específico, utilízase esencialmente o método.

Clúster xerárquico

A estratexia de agrupación xerárquica pode comezar con cada punto de datos asignado a un clúster diferente. Os dous grupos que están máis próximos un do outro mestúranse nun único grupo. A fusión iterativa continúa ata que só queda un clúster na parte superior.

Este método coñécese como ascendente ou aglomerativo. Se comezas con todos os elementos de datos vinculados ao mesmo clúster e despois realizas divisións ata que cada elemento de datos sexa asignado como un clúster separado, o método coñécese como agrupación xerárquica descendente ou divisiva.

Algoritmo a priori

A análise da cesta de mercado popularizou os algoritmos a priori, dando lugar a varios motores de recomendación para plataformas de música e tendas en liña.

Utilízanse en conxuntos de datos transaccionais para atopar conxuntos de artigos frecuentes, ou agrupacións de elementos, co fin de prever a probabilidade de consumir un produto en función do consumo doutro.

Por exemplo, se empezo a reproducir a radio de OneRepublic en Spotify con "Counting Stars", unha das outras cancións desta canle seguramente será unha canción de Imagine Dragon, como "Bad Liar".

Isto baséase nos meus hábitos de escoita anteriores, así como nos patróns de escoita dos demais. Os métodos a priori contan os conxuntos de elementos usando unha árbore hash, atravesando o conxunto de datos en primeiro lugar.

Redución de Dimensionalidade

A redución da dimensionalidade é unha especie de aprendizaxe non supervisada que usa unha colección de estratexias para minimizar o número de características (ou dimensións) nun conxunto de datos. Permítenos aclarar.

Pode ser tentador incorporar a maior cantidade de datos posible mentres creas o teu conxunto de datos para a aprendizaxe automática. Non nos malinterpretes: esta estratexia funciona ben xa que máis datos adoitan producir achados máis precisos.

Supón que os datos se almacenan nun espazo de N dimensións, representando cada característica unha dimensión diferente. Pode haber centos de dimensións se hai moitos datos.

Considere as follas de cálculo de Excel, con columnas que representan características e filas que representan elementos de datos. Cando hai demasiadas dimensións, os algoritmos de ML poden funcionar mal e visualización de datos pode chegar a ser difícil.

Polo que fai lóxico limitar as características ou dimensións e transmitir só información pertinente. A redución da dimensionalidade é só iso. Permite unha cantidade controlable de entradas de datos sen comprometer a integridade do conxunto de datos.

Análise de compoñentes principais (PCA)

A análise de compoñentes principais é un enfoque de redución da dimensionalidade. Utilízase para minimizar o número de funcións en conxuntos de datos enormes, resultando nunha maior simplicidade de datos sen sacrificar a precisión.

A compresión do conxunto de datos realízase mediante un método coñecido como extracción de características. Indica que os elementos do conxunto orixinal mestúranse nun novo e máis pequeno. Estes novos trazos coñécense como compoñentes primarios.

Por suposto, hai algoritmos adicionais que podes usar nas túas aplicacións de aprendizaxe sen supervisión. Os enumerados anteriormente son só os máis frecuentes, polo que se comentan con máis detalle.

Aplicación da aprendizaxe non supervisada

- Os métodos de aprendizaxe sen supervisión utilízanse para tarefas de percepción visual, como o recoñecemento de obxectos.

- A aprendizaxe automática sen supervisión dálle aspectos críticos aos sistemas de imaxe médica, como a identificación, clasificación e segmentación de imaxes, que se utilizan en radioloxía e patoloxía para diagnosticar pacientes de forma rápida e fiable.

- A aprendizaxe non supervisada pode axudar a identificar tendencias de datos que se poden usar para crear estratexias de venda cruzada máis eficaces utilizando datos anteriores sobre o comportamento do consumidor. Durante o proceso de pago, as empresas en liña usan isto para suxerir os complementos axeitados aos clientes.

- Os métodos de aprendizaxe sen supervisión poden filtrar enormes volumes de datos para atopar valores atípicos. Estas anomalías poden provocar un mal funcionamento do equipo, erros humanos ou violacións de seguridade.

Problemas coa aprendizaxe non supervisada

A aprendizaxe sen supervisión é atractiva de varias maneiras, desde a posibilidade de atopar información importante sobre datos para evitar un costoso etiquetado de datos operacións. Non obstante, hai varios inconvenientes ao usar esta estratexia para adestrar modelos de aprendizaxe automática que debes ter en conta. Aquí tes algúns exemplos.

- Como os datos de entrada carecen de etiquetas que sirvan como claves de resposta, os resultados dos modelos de aprendizaxe sen supervisión poderían ser menos precisos.

- A aprendizaxe non supervisada adoita funcionar con conxuntos de datos masivos, o que pode aumentar a complexidade computacional.

- O enfoque require a confirmación da saída por parte dos humanos, xa sexan especialistas internos ou externos no tema da investigación.

- Os algoritmos deben examinar e calcular todos os escenarios posibles ao longo da fase de adestramento, que leva algún tempo.

Conclusión

A utilización eficaz dos datos é a clave para establecer unha vantaxe competitiva nun mercado particular.

Podes segmentar os datos mediante algoritmos de aprendizaxe automática sen supervisión para examinar as preferencias do teu público obxectivo ou para determinar como responde unha determinada infección a un tratamento en particular.

Hai varias aplicacións prácticas, e científicos de datos, enxeñeiros e arquitectos poden axudarche a definir os teus obxectivos e desenvolver solucións de ML únicas para a túa empresa.

Deixe unha resposta