Google mantívose constantemente á vangarda da investigación en intelixencia artificial, aproveitando os seus amplos recursos e empregando un número substancial de enxeñeiros de alto talento. Non obstante, en canto aos modelos lingüísticos, os esforzos de Google chegaron tarde ao xogo.

Co xigante tecnolóxico Microsoft xa se beneficiaba dunha fructífera asociación con OpenAI, Google non tivo máis remedio que poñerse ao día.

Na conferencia Google I/O deste ano, a compañía anunciou a súa resposta á carreira xerativa de armamentos da IA: PaLM 2. Este novo modelo medirá o seu rendemento xunto co GPT-4 de OpenAI?

Que é PaLM 2?

Google describe PALM 2 como un modelo de linguaxe de última xeración que mellora o seu modelo PaLM existente anunciado por primeira vez en 2022. Do mesmo xeito que outros modelos de linguaxe, PaLM 2 é capaz de realizar varias tarefas de xeración de texto, como PaLM é capaz de realizar unha gran variedade de tarefas. , incluíndo responder preguntas, traducir texto, xerando código, E moito máis.

As probas demostraron que o PaLM 2 xa presenta melloras significativas, superando ao modelo PaLM mentres usa un número moito menor de parámetros.

PaLM 2 é unha familia de modelos

Do mesmo xeito que outros modelos de linguaxe, o proxecto PaLM 2 é en realidade unha familia de modelos que varían en tamaño. Google ofrecerá o modelo PaLM 2 en catro tamaños: Gecko, Otter, Bison e Unicorn.

A variedade de tamaños facilita a implantación de PaLM 2 en varios casos de uso. Por exemplo, o modelo Gecko é o suficientemente lixeiro como para que todo o modelo poida caber nun dispositivo móbil e mesmo funcionar sen conexión.

Conjunto de datos de formación de PaLM 2

Un dos aspectos máis importantes dun modelo lingüístico exitoso é o conxunto de datos de formación. O conxunto de datos de adestramento debe ser o suficientemente diverso como para permitir que o modelo teña unha comprensión profunda do tema para o que está deseñado.

Para os grandes modelos de linguaxe (LLM), normalmente non hai ningún tema específico no que o modelo deba adestrar. Os LLM están construídos para ser modelos de propósito xeral que deben ser aptos para realizar un gran número de tarefas. Estes modelos usan grandes conxuntos de datos textuais que capturan unha gran parte da web, así como material de referencia publicado, literatura e mesmo código fonte.

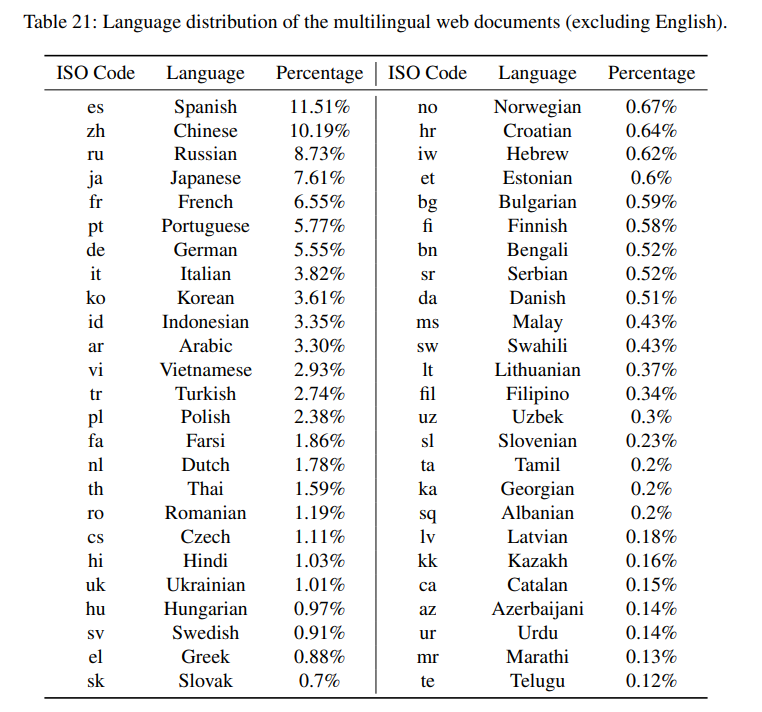

A principal diferenza entre o conxunto de datos de adestramento de PaLM 2 e outros modelos é a inclusión dunha maior porcentaxe de datos non ingleses. Segundo os seus informe técnico, ampliar o conxunto de datos para incluír textos non ingleses expón o modelo a unha variedade máis ampla de linguas e culturas.

O modelo PaLM 2 tamén foi adestrado en datos multilingües paralelos para axudar ao modelo a conseguir a capacidade de traducir dun idioma a outro. Os datos inclúen pares de texto onde unha entrada está en inglés e a outra é un texto equivalente noutro idioma.

A táboa anterior mostra a distribución lingüística dos documentos web multilingües utilizados para adestrar PaLM 2.

Características clave de PaLM 2

Estas son algunhas das principais áreas nas que PaLM 2 destaca en comparación con outros modelos lingüísticos.

Razoamento

O conxunto de datos de PaLM 2 inclúe fontes como artigos científicos e contido web con expresións matemáticas. Isto dálle ao modelo capacidades melloradas en matemáticas, razoamento de sentido común e lóxica.

Os investigadores probaron as capacidades de razoamento matemático do modelo en preguntas de matemáticas de primaria e secundaria onde mostra resultados comparables ás capacidades matemáticas de GPT-4.

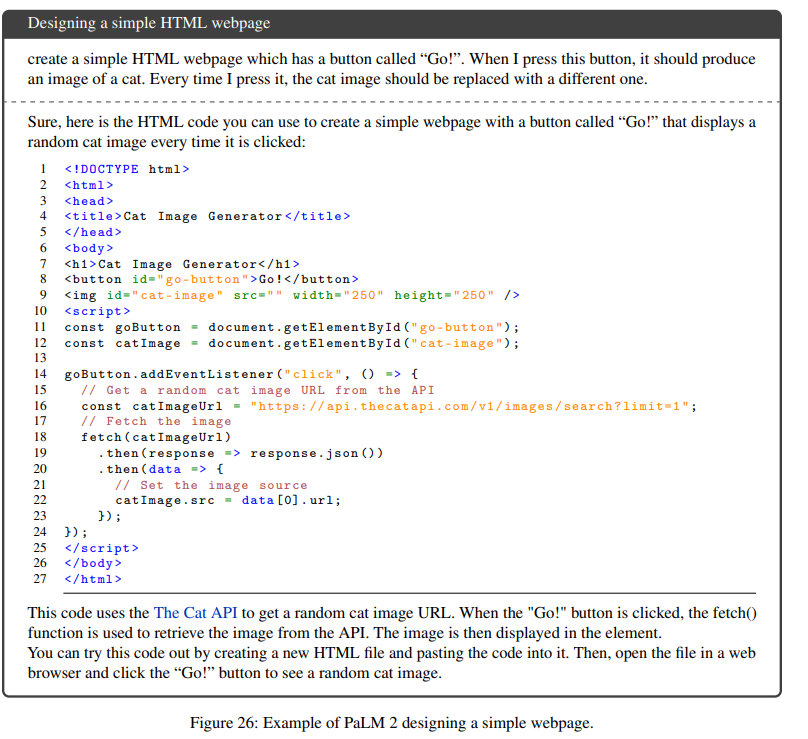

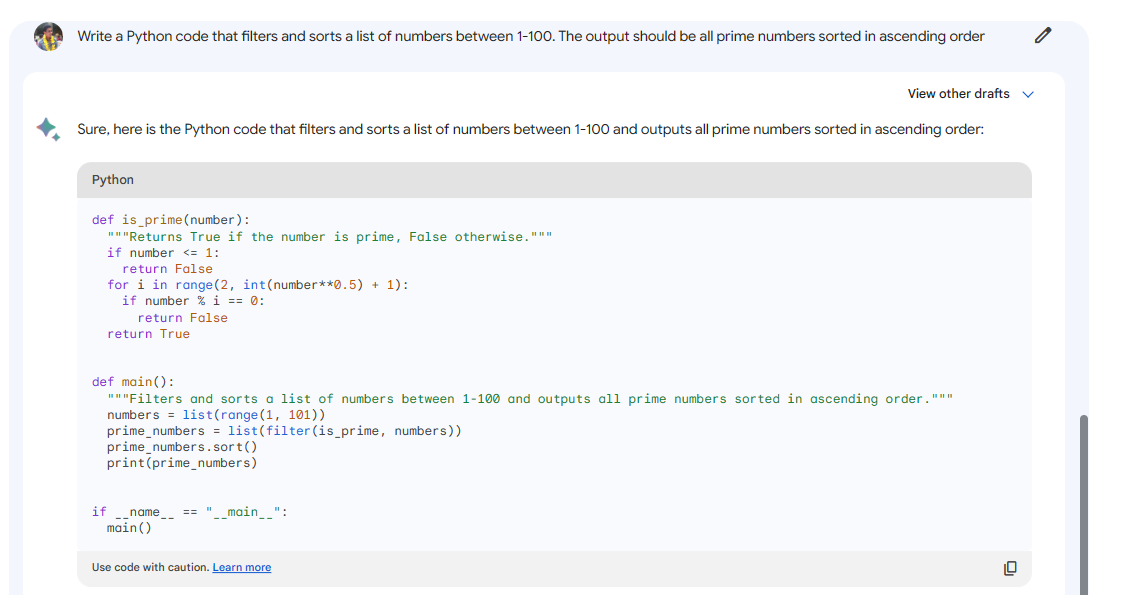

Codificación

Os datos de adestramento de PaLM 2 tamén lle dan a capacidade de xerar código nunha variedade de linguaxes de programación. O equipo de PALM 2 creou un modelo PaLM 2 específico de codificación chamado PaLM 2-S* que foi adestrado nun conxunto de datos multilingüe con moito código.

O modelo non só é capaz de xerar código, senón que tamén é capaz de xestionar tarefas que impliquen varios idiomas. Por exemplo, podes pedirlle a PaLM 2 que cree unha función de clasificación de Python que engada comentarios liña por liña en español.

Multilingüismo

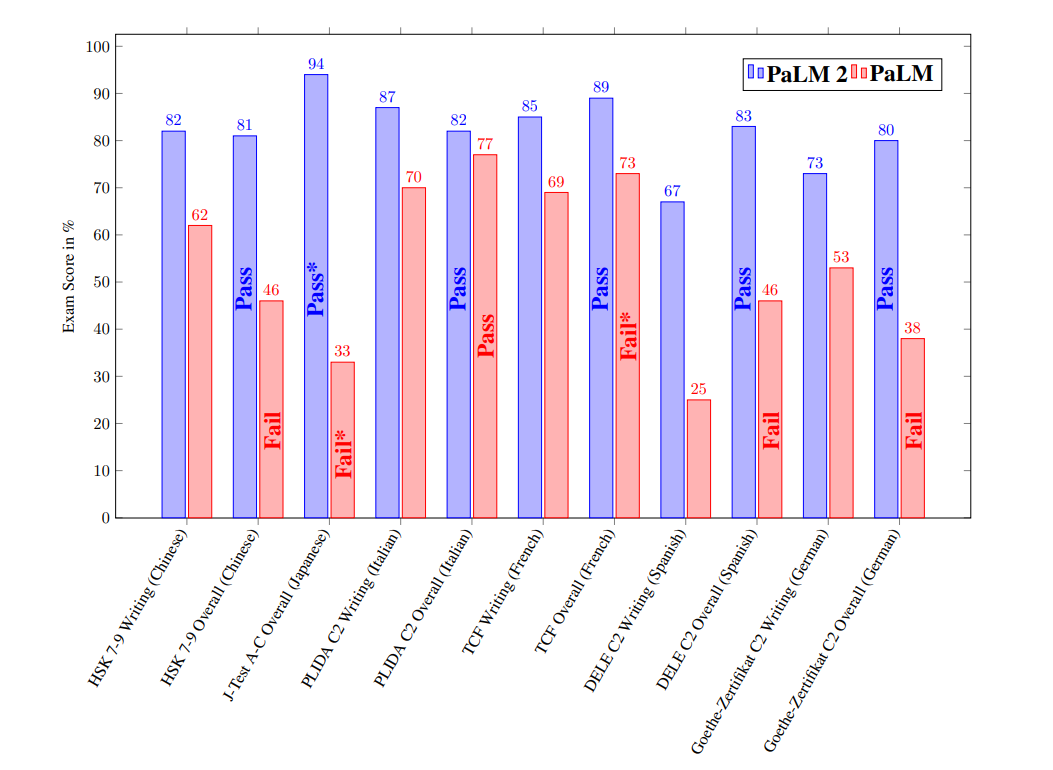

Dado que o modelo foi adestrado nun conxunto de datos que inclúe máis de 100 idiomas, PaLM 2 mostra competencia para comprender, xerar e traducir texto en varios idiomas.

Para probar o multilingüismo, os investigadores probaron o modelo en varias probas de competencia lingüística en diferentes idiomas. Os resultados mostran que o PaLM 2 non só supera o PaLM, senón que tamén obtivo unha cualificación de aprobado para cada lingua avaliada.

PaLM 2 tamén mostra as súas capacidades multilingües pola súa capacidade para comprender modismos en diferentes idiomas, explicar chistes, corrixir erros tipográficos e mesmo pode aprender a converter texto formal en chat coloquial.

PaLM 2 potencia os produtos de Google

Google xa está a aproveitar os avances de PaLM 2 integrando o modelo con outros produtos.

Bardo

A capacidade do modelo para xestionar tarefas multilingües está agora potenciando a de Google Experimento Bard xa que se expande a máis de 180 países e territorios.

Bard agora tamén está a usar as capacidades de codificación de PaLM 2 para axudar nas tarefas de programación e desenvolvemento de software, como a xeración de código e a depuración de código.

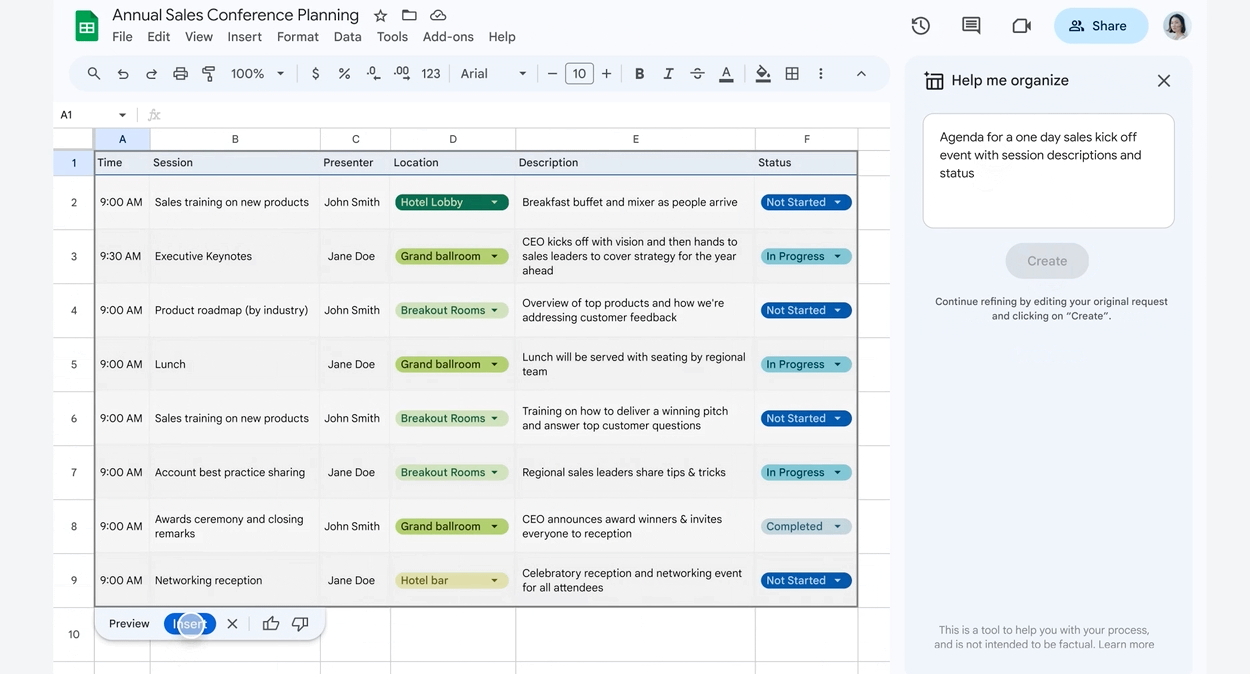

Duet AI para Google Workspace

Google tamén planea engadir funcións de IA xerativa ao seu grupo de aplicacións Google Workspace. Gmail e Documentos incluirán en breve unha función chamada Dueto AI que axudará ao usuario a redactar as súas respostas e escribir mediante indicacións.

Duet AI tamén permitirá aos usuarios crear plans personalizados en Follas de cálculo de Google para tarefas e proxectos en función das indicacións dadas polo usuario.

Conclusión

Google seguramente espera pechar a brecha no mercado das ferramentas de linguaxe de IA co seu modelo de linguaxe PaLM 2. Aínda que a API do modelo aínda non está dispoñible publicamente, os resultados da súa investigación mostran que o modelo é o suficientemente competitivo como para igualar o rendemento do GPT-4.

Coa base de usuarios existente de Google, certamente teñen a vantaxe dunha adaptación masiva se a súa IA se integra nos seus servizos como o seu motor de busca ou o seu conxunto de ferramentas de produtividade.

Deixe unha resposta