Table des matières[Cacher][Montrer]

L'un des principaux critères pour tout type d'activité d'entreprise est l'utilisation efficace de l'information. À un moment donné, le volume de données créé dépasse la capacité de traitement de base.

C'est là que les algorithmes d'apprentissage automatique entrent en jeu. Cependant, avant que cela ne se produise, l'information doit être étudiée et interprétée. En un mot, c'est à cela que sert l'apprentissage automatique non supervisé.

Dans cet article, nous examinerons en profondeur l'apprentissage automatique non supervisé, y compris ses algorithmes, ses cas d'utilisation et bien plus encore.

Qu'est-ce que l'apprentissage automatique non supervisé ?

Les algorithmes d'apprentissage automatique non supervisés identifient des modèles dans un ensemble de données qui n'ont pas de conséquence connue ou étiquetée. Supervisé algorithmes d'apprentissage automatique avoir une sortie étiquetée.

Connaître cette distinction vous aide à comprendre pourquoi les méthodes d'apprentissage automatique non supervisées ne peuvent pas être utilisées pour résoudre les problèmes de régression ou de classification, puisque vous ne savez pas quelle peut être la valeur/réponse des données de sortie. Vous ne pouvez pas former un algorithme normalement si vous ne connaissez pas la valeur/réponse.

De plus, l'apprentissage non supervisé peut être utilisé pour identifier la structure fondamentale des données. Ces algorithmes détectent des modèles cachés ou des regroupements de données sans nécessiter d'interaction humaine.

Sa capacité à détecter les similitudes et les contrastes dans les informations en fait un excellent choix pour l'analyse exploratoire des données, les techniques de vente croisée, la segmentation des consommateurs et l'identification d'images.

Considérez le scénario suivant : vous êtes dans une épicerie et voyez un fruit non identifié que vous n'avez jamais vu auparavant. Vous pouvez facilement distinguer le fruit inconnu des autres fruits en fonction de vos observations sur sa forme, sa taille ou sa couleur.

Algorithmes d'apprentissage automatique non supervisés

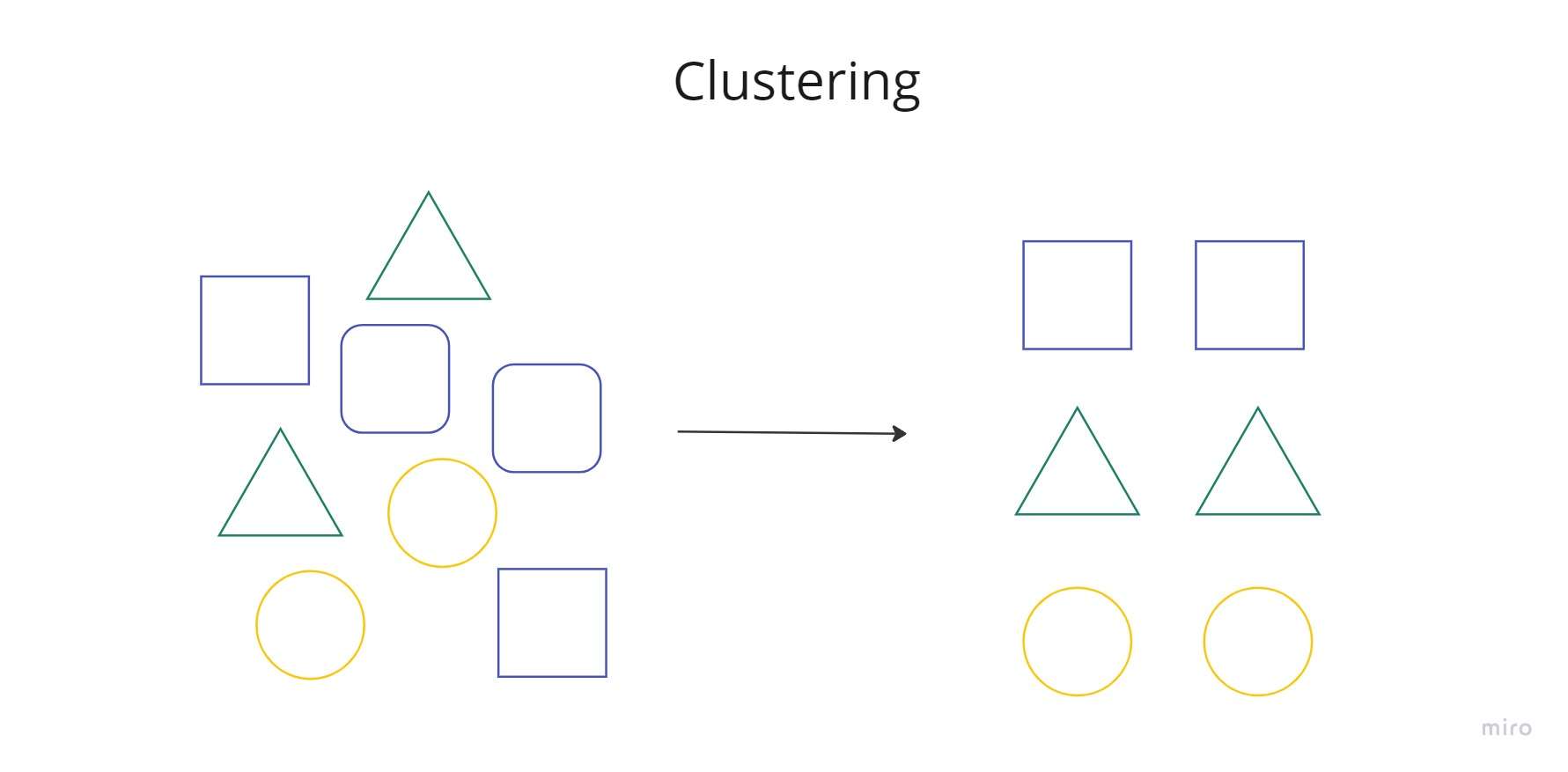

regroupement

Le clustering est sans aucun doute l'approche d'apprentissage non supervisé la plus largement utilisée. Cette approche place les éléments de données associés dans des clusters générés de manière aléatoire.

Par lui-même, un modèle ML découvre tous les modèles, similitudes et/ou différences dans une structure de données non catégorisée. Un modèle pourra découvrir tous les groupements ou classes naturels dans les données.

Types

Plusieurs formes de regroupement peuvent être utilisées. Voyons d'abord les plus importants.

- Le clustering exclusif, parfois appelé clustering "dur", est un type de regroupement dans lequel une seule donnée appartient à un seul cluster.

- Le clustering par chevauchement, souvent appelé clustering « souple », permet aux objets de données d'appartenir à plusieurs clusters à des degrés divers. De plus, le regroupement probabiliste peut être utilisé pour résoudre les problèmes de regroupement « doux » ou d'estimation de la densité, ainsi que pour évaluer la probabilité ou la probabilité que des points de données appartiennent à certains groupes.

- La création d'une hiérarchie d'éléments de données groupés est l'objectif du clustering hiérarchique, comme son nom l'indique. Les éléments de données sont déconstruits ou combinés en fonction de la hiérarchie pour générer des clusters.

Cas d'utilisation:

- Détection d'une anomalie:

Tout type de valeur aberrante dans les données peut être détecté à l'aide du clustering. Les entreprises de transport et de logistique, par exemple, peuvent utiliser la détection d'anomalies pour découvrir des obstacles logistiques ou révéler des pièces mécaniques endommagées (maintenance prédictive).

Les institutions financières peuvent utiliser la technologie pour détecter les transactions frauduleuses et réagir rapidement, ce qui pourrait économiser beaucoup d'argent. Apprenez-en davantage sur la détection des anomalies et des fraudes en visionnant notre vidéo.

- Segmentation des clients et des marchés :

Les algorithmes de clustering peuvent aider à regrouper des personnes ayant des caractéristiques similaires et à créer des personnalités de consommateurs pour un marketing plus efficace et des initiatives ciblées.

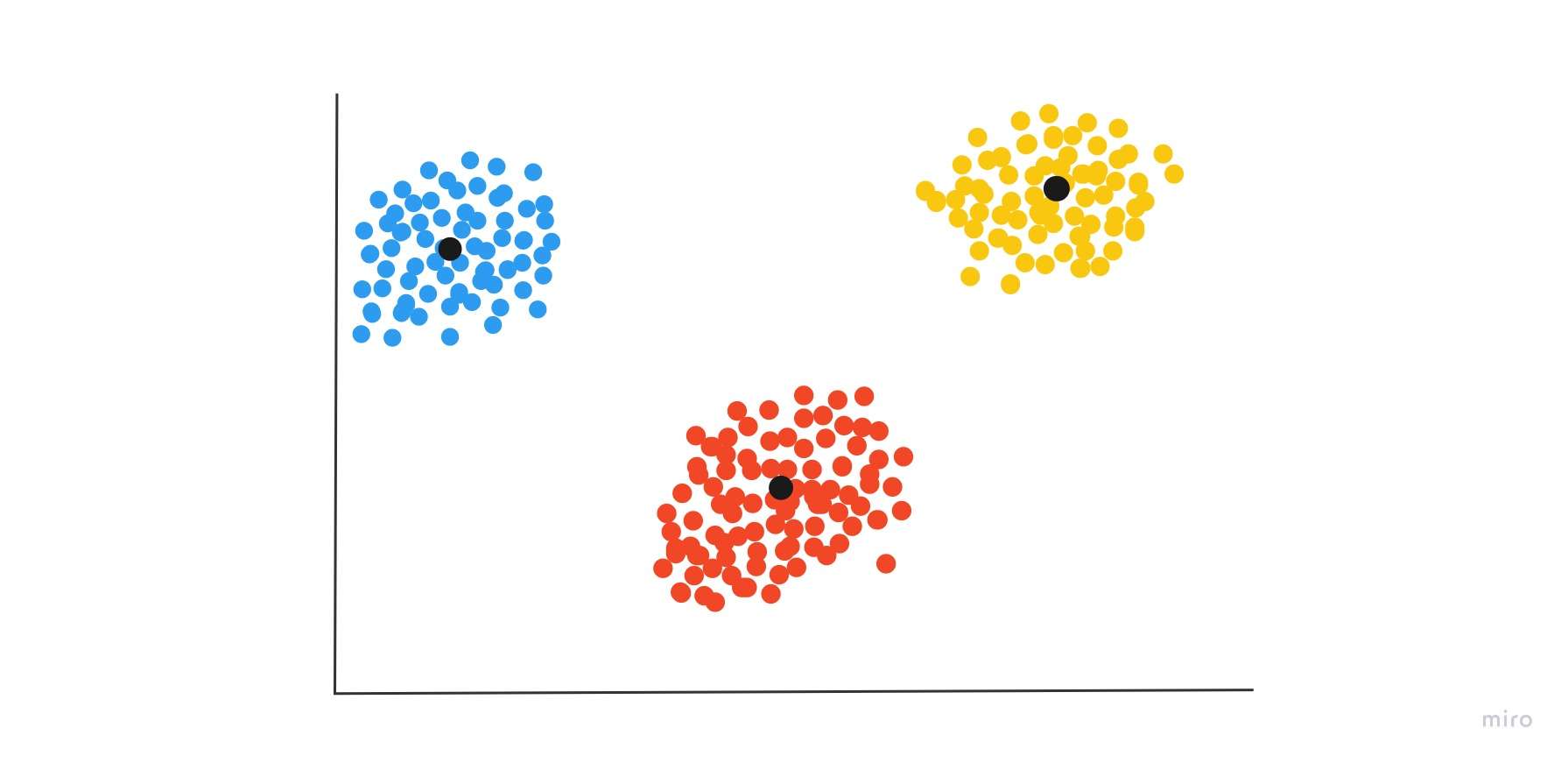

K-Moyens

K-means est une méthode de clustering également appelée partitionnement ou segmentation. Il divise les points de données en un nombre prédéterminé de groupes appelés K.

Dans la méthode K-means, K est l'entrée puisque vous indiquez à l'ordinateur le nombre de clusters que vous souhaitez identifier dans vos données. Chaque élément de données est ensuite affecté au centre de cluster le plus proche, appelé centroïde (points noirs sur l'image).

Ces derniers servent d'espaces de stockage de données. La technique de clustering peut être répétée plusieurs fois jusqu'à ce que les clusters soient bien définis.

K-moyennes floues

Fuzzy K-means est une extension de la technique des K-means, qui est utilisée pour effectuer un regroupement par chevauchement. Contrairement à la technique des K-moyennes, les K-moyennes floues indiquent que les points de données peuvent appartenir à de nombreux clusters avec différents degrés de proximité avec chacun.

La distance entre les points de données et le centroïde du cluster est utilisée pour calculer la proximité. En conséquence, il peut y avoir des occasions où divers clusters se chevauchent.

Modèles de mélange gaussien

Les modèles de mélange gaussien (GMM) sont une méthode utilisée dans le clustering probabiliste. Étant donné que la moyenne et la variance sont inconnues, les modèles supposent qu'il existe un nombre fixe de distributions gaussiennes, chacune représentant un cluster distinct.

Pour déterminer à quel cluster appartient un point de données spécifique, la méthode est essentiellement utilisée.

Classification hiérarchique

La stratégie de clustering hiérarchique peut commencer avec chaque point de données affecté à un cluster différent. Les deux clusters les plus proches l'un de l'autre sont ensuite fusionnés en un seul cluster. La fusion itérative se poursuit jusqu'à ce qu'un seul cluster reste au sommet.

Cette méthode est dite ascendante ou agglomérative. Si vous commencez avec tous les éléments de données liés au même cluster, puis effectuez des fractionnements jusqu'à ce que chaque élément de données soit affecté en tant que cluster distinct, la méthode est connue sous le nom de clustering hiérarchique descendant ou de division.

Algorithme Apriori

L'analyse du panier d'achat a popularisé les algorithmes a priori, aboutissant à divers moteurs de recommandation pour les plateformes musicales et les magasins en ligne.

Ils sont utilisés dans les ensembles de données transactionnelles pour trouver des ensembles d'éléments fréquents, ou des regroupements d'éléments, afin de prédire la probabilité de consommer un produit en fonction de la consommation d'un autre.

Par exemple, si je commence à écouter la radio de OneRepublic sur Spotify avec "Counting Stars", l'une des autres chansons de cette chaîne sera très certainement une chanson d'Imagine Dragon, telle que "Bad Liar".

Ceci est basé sur mes habitudes d'écoute antérieures ainsi que sur les habitudes d'écoute des autres. Les méthodes apriori comptent les ensembles d'éléments à l'aide d'un arbre de hachage, en parcourant d'abord l'ensemble de données.

Réduction de la dimensionnalité

La réduction de la dimensionnalité est une sorte d'apprentissage non supervisé qui utilise un ensemble de stratégies pour minimiser le nombre de caractéristiques - ou dimensions - dans un ensemble de données. Permettez-nous de clarifier.

Il peut être tentant d'incorporer autant de données que possible lors de la création de votre ensemble de données pour l'apprentissage automatique. Ne vous méprenez pas : cette stratégie fonctionne bien, car plus de données produisent généralement des résultats plus précis.

Supposons que les données sont stockées dans un espace à N dimensions, chaque entité représentant une dimension différente. Il peut y avoir des centaines de dimensions s'il y a beaucoup de données.

Considérez les feuilles de calcul Excel, avec des colonnes représentant des caractéristiques et des lignes représentant des éléments de données. Lorsqu'il y a trop de dimensions, les algorithmes de ML peuvent fonctionner de manière médiocre et visualisation de données peut devenir difficile.

Il est donc logique de limiter les caractéristiques ou les dimensions, et de ne transmettre que les informations pertinentes. La réduction de la dimensionnalité n'est que cela. Il permet une quantité gérable d'entrées de données sans compromettre l'intégrité de l'ensemble de données.

Analyse en composantes principales (ACP)

L'analyse en composantes principales est une approche de réduction de la dimensionnalité. Il est utilisé pour minimiser le nombre d'entités dans d'énormes ensembles de données, ce qui se traduit par une plus grande simplicité des données sans sacrifier la précision.

La compression des ensembles de données est réalisée par une méthode connue sous le nom d'extraction de caractéristiques. Cela indique que les éléments de l'ensemble d'origine sont mélangés dans un nouveau, plus petit. Ces nouveaux traits sont appelés composants primaires.

Bien sûr, il existe des algorithmes supplémentaires que vous pouvez utiliser dans vos applications d'apprentissage non supervisé. Ceux énumérés ci-dessus ne sont que les plus répandus, c'est pourquoi ils sont discutés plus en détail.

Application de l'apprentissage non supervisé

- Des méthodes d'apprentissage non supervisées sont utilisées pour des tâches de perception visuelle telles que la reconnaissance d'objets.

- L'apprentissage automatique non supervisé donne des aspects critiques aux systèmes d'imagerie médicale, tels que l'identification, la classification et la segmentation des images, qui sont utilisés en radiologie et en pathologie pour diagnostiquer les patients rapidement et de manière fiable.

- L'apprentissage non supervisé peut aider à identifier les tendances des données qui peuvent être utilisées pour créer des stratégies de vente croisée plus efficaces en utilisant des données antérieures sur le comportement des consommateurs. Au cours du processus de paiement, les entreprises en ligne l'utilisent pour suggérer les bons modules complémentaires aux clients.

- Les méthodes d'apprentissage non supervisées peuvent passer au crible d'énormes volumes de données pour trouver des valeurs aberrantes. Ces anomalies peuvent entraîner un dysfonctionnement de l'équipement, une erreur humaine ou des failles de sécurité.

Problèmes avec l'apprentissage non supervisé

L'apprentissage non supervisé est attrayant à bien des égards, de la possibilité de trouver des informations importantes sur données pour éviter un étiquetage coûteux des données opérations. Cependant, il y a plusieurs inconvénients à utiliser cette stratégie pour former modèles d'apprentissage automatique dont vous devriez être conscient. Voici quelques exemples.

- Comme les données d'entrée manquent d'étiquettes qui servent de clés de réponse, les résultats des modèles d'apprentissage non supervisé pourraient être moins précis.

- L'apprentissage non supervisé fonctionne fréquemment avec des ensembles de données volumineux, ce qui peut augmenter la complexité des calculs.

- L'approche nécessite une confirmation de sortie par des humains, soit des spécialistes internes ou externes du sujet d'enquête.

- Les algorithmes doivent examiner et calculer tous les scénarios possibles tout au long de la phase de formation, ce qui prend un certain temps.

Conclusion

L'utilisation efficace des données est la clé pour établir un avantage concurrentiel sur un marché particulier.

Vous pouvez segmenter les données à l'aide d'algorithmes d'apprentissage automatique non supervisés pour examiner les préférences de votre public cible ou pour déterminer comment une certaine infection répond à un traitement particulier.

Il existe plusieurs applications pratiques et scientifiques de données, ingénieurs et architectes peuvent vous aider à définir vos objectifs et à développer des solutions ML uniques pour votre entreprise.

Soyez sympa! Laissez un commentaire