Google est toujours resté à la pointe de la recherche sur l'IA, tirant parti de ses vastes ressources et employant un nombre important d'ingénieurs de haut niveau. Cependant, en termes de modèles de langage, les efforts de Google ont été tardifs.

Le géant de la technologie Microsoft bénéficiant déjà d'un partenariat fructueux avec OpenAI, Google n'avait d'autre choix que de rattraper son retard.

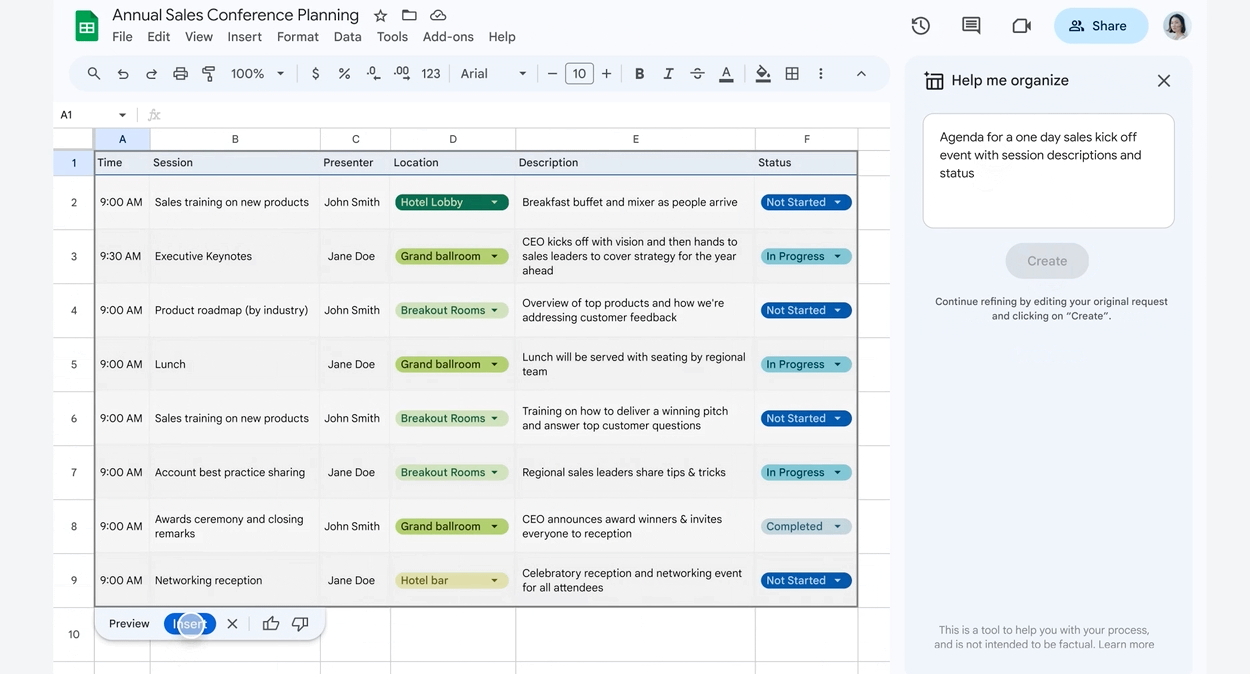

Lors de la conférence Google I/O de cette année, la société a annoncé sa réponse à la course aux armements de l'IA générative : PaLM 2. Ce nouveau modèle sera-t-il à la hauteur des performances du GPT-4 d'OpenAI ?

Qu'est-ce que PalM 2 ?

Google décrit PAUME 2 en tant que modèle de langage à la pointe de la technologie qui améliore leur modèle PaLM existant annoncé pour la première fois en 2022. Semblable à d'autres modèles de langage, PaLM 2 est capable d'effectuer diverses tâches de génération de texte telles que PaLM est capable d'un large éventail de tâches , y compris répondre aux questions, traduire du texte, génération de code, Et bien plus encore.

Les tests ont montré que le PaLM 2 montre déjà des améliorations significatives, surpassant le modèle PaLM tout en utilisant un nombre de paramètres beaucoup plus faible.

PaLM 2 est une famille de modèles

Comme d'autres modèles de langage, le projet PaLM 2 est en fait une famille de modèles de taille variable. Google proposera le modèle PaLM 2 en quatre tailles : Gecko, Otter, Bison et Unicorn.

La variété des tailles facilite le déploiement de PaLM 2 dans divers cas d'utilisation. Par exemple, le modèle Gecko est suffisamment léger pour que le modèle entier puisse tenir dans un appareil mobile et même fonctionner hors ligne.

Jeu de données d'entraînement de PaLM 2

L'un des aspects les plus importants d'un modèle linguistique réussi est la ensemble de données d'entraînement. L'ensemble de données de formation doit être suffisamment diversifié pour permettre au modèle d'avoir une compréhension approfondie du sujet pour lequel il est conçu.

Pour les grands modèles de langage (LLM), il n'y a généralement pas de sujet spécifique sur lequel le modèle doit s'entraîner. Les LLM sont plutôt conçus pour être des modèles à usage général qui doivent être adaptés pour effectuer un grand nombre de tâches. Ces modèles utilisent de grands ensembles de données textuelles qui capturent une grande partie du Web ainsi que des documents de référence publiés, de la littérature et même du code source.

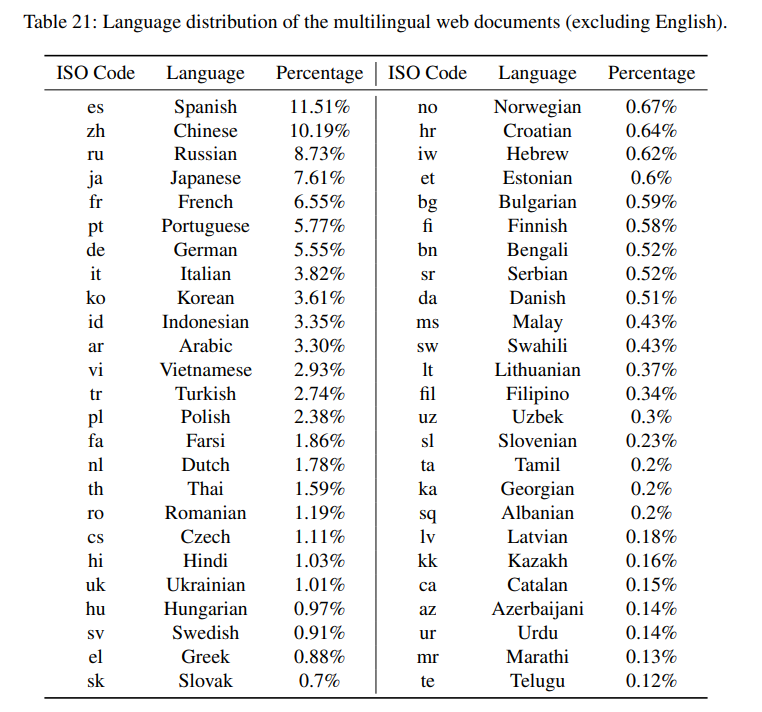

La principale différence entre l'ensemble de données de formation de PaLM 2 et d'autres modèles est l'inclusion d'un pourcentage plus élevé de données non anglaises. Selon eux rapport technique, l'extension de l'ensemble de données pour inclure des textes non anglais expose le modèle à une plus grande variété de langues et de cultures.

Le modèle PaLM 2 a également été formé sur des données multilingues parallèles pour aider le modèle à acquérir la capacité de traduire d'une langue à une autre. Les données incluent des paires de texte où une entrée est en anglais et l'autre est un texte équivalent dans une autre langue.

Le tableau ci-dessus montre la distribution linguistique des documents Web multilingues utilisés pour former PaLM 2.

Principales caractéristiques de PALM 2

Voici quelques-uns des principaux domaines dans lesquels PaLM 2 excelle par rapport aux autres modèles de langage.

Raisonnement

L'ensemble de données de PaLM 2 comprend des sources telles que des articles scientifiques et du contenu Web avec des expressions mathématiques. Cela donne au modèle des capacités améliorées en mathématiques, en raisonnement de bon sens et en logique.

Les chercheurs ont testé les capacités de raisonnement mathématique du modèle sur des questions mathématiques du primaire et du secondaire où il montre des résultats comparables aux capacités mathématiques du GPT-4.

Codage

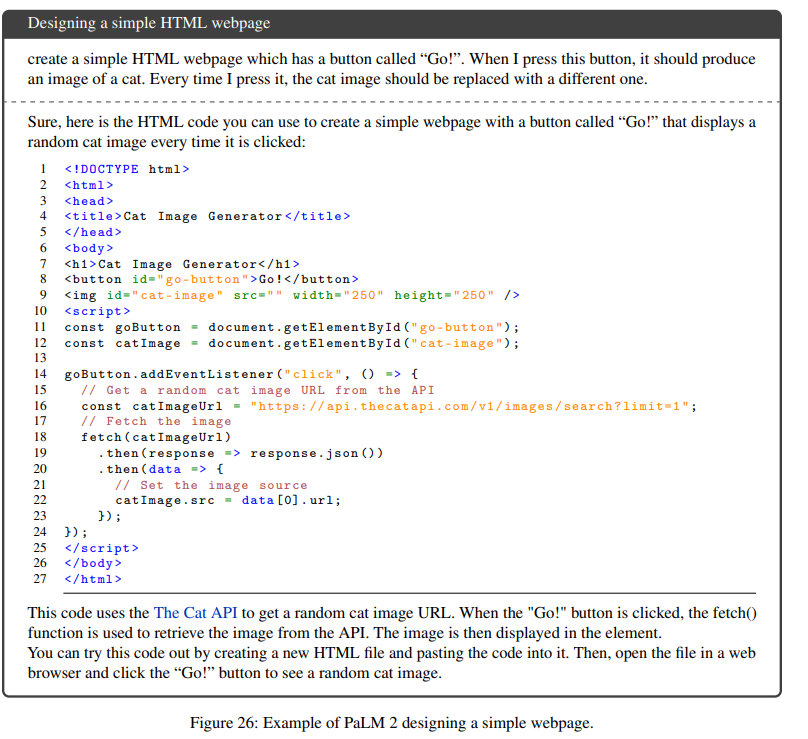

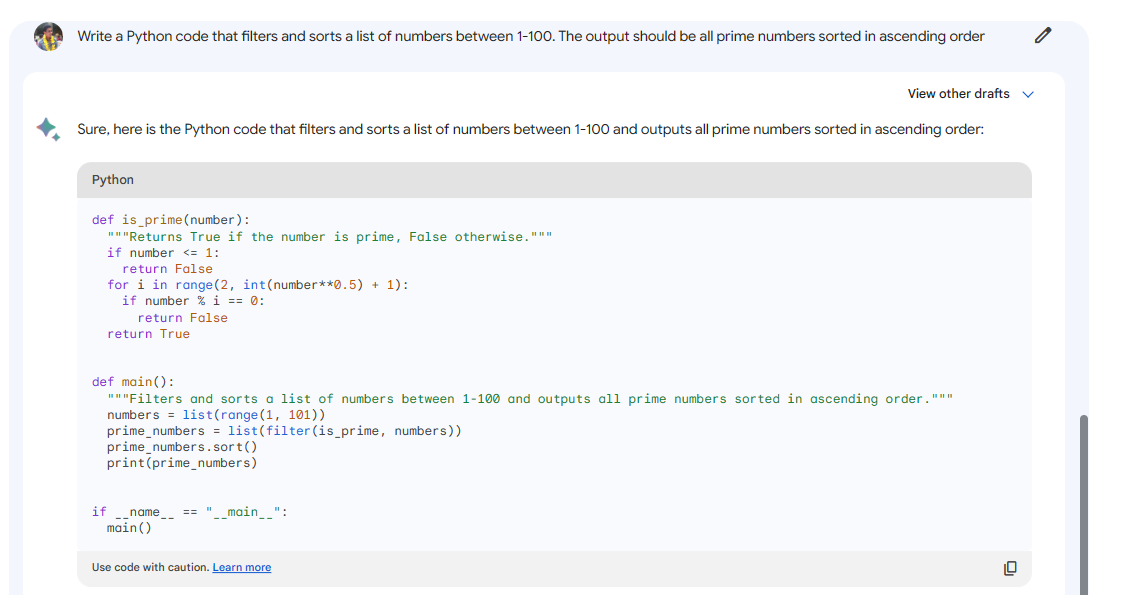

Les données de formation de PaLM 2 lui permettent également de générer du code dans une variété de langages de programmation. L'équipe PALM 2 a créé un modèle PaLM 2 spécifique au codage appelé PaLM 2-S* qui a été formé sur un ensemble de données multilingues à forte densité de code.

Non seulement le modèle est capable de générer du code, mais il est également capable de gérer des tâches impliquant plusieurs langues. Par exemple, vous pouvez demander à PaLM 2 de créer une fonction de tri Python qui ajoute des commentaires ligne par ligne en espagnol.

Multilinguisme

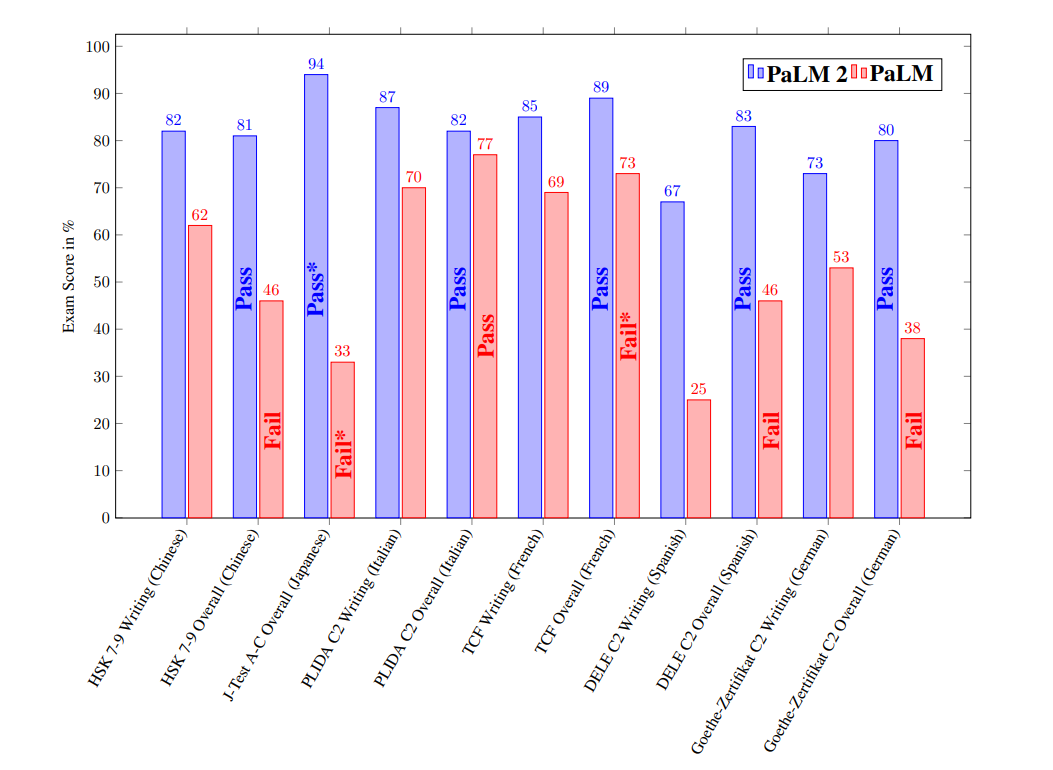

Étant donné que le modèle a été formé sur un ensemble de données comprenant plus de 100 langues, PaLM 2 montre sa capacité à comprendre, générer et traduire du texte dans plusieurs langues.

Pour tester le multilinguisme, les chercheurs ont testé le modèle sur divers tests de compétence linguistique dans différentes langues. Les résultats montrent que non seulement PaLM 2 surpasse PaLM, mais qu'il a également obtenu une note de passage pour chaque langue évaluée.

PaLM 2 montre également ses capacités multilingues par sa capacité à comprendre les idiomes dans différentes langues, à expliquer les blagues, à corriger les fautes de frappe et peut même apprendre à convertir un texte formel en conversation familière.

PALM 2 propulse les produits Google

Google profite déjà des avancées de PaLM 2 en intégrant le modèle à d'autres produits.

barde

La capacité du modèle à gérer des tâches multilingues alimente désormais Google Expérience de barde alors qu'il s'étend à plus de 180 pays et territoires.

Bard utilise désormais également les capacités de codage de PaLM 2 pour faciliter les tâches de programmation et de développement de logiciels telles que la génération de code et le débogage de code.

Duet AI pour Google Workspace

Google prévoit également d'ajouter des fonctionnalités d'IA génératives à son groupe d'applications Google Workspace. Gmail et Docs incluront bientôt une fonctionnalité appelée IA en duo cela aidera l'utilisateur à rédiger ses réponses et à écrire à l'aide d'invites.

Duet AI permettra également aux utilisateurs de créer des plans personnalisés dans Google Sheets pour les tâches et les projets en fonction des invites données par l'utilisateur.

Conclusion

Google espère sûrement combler l'écart sur le marché des outils linguistiques d'IA avec son modèle de langage PaLM 2. Bien que l'API du modèle ne soit pas encore accessible au public, les résultats de leurs recherches montrent que le modèle est suffisamment compétitif pour égaler les performances de GPT-4.

Avec la base d'utilisateurs existante de Google, ils ont certainement l'avantage d'une adaptation massive si leur IA est intégrée à leurs services tels que leur moteur de recherche ou leur suite d'outils de productivité.

Soyez sympa! Laissez un commentaire