La pliiĝo de grandaj lingvomodeloj montris, ke algoritmoj nuntempe pli ol kapablas imiti homan konduton interrete.

A studo de marto 2023 rivelis ke partoprenantoj ne povis precize distingi inter homa aŭ AI-teksto. Esploristoj maltrankviliĝas, ke ĉi tiuj modeloj povus esti uzataj kiel ilo por malicaj agoj.

Kompanioj kiel microsoft efektivigis barilon en sian AI por malhelpi ilin esti uzataj por misinformado kaj aliaj specoj de kabaloj. Tamen, multaj el ĉi tiuj generaj modeloj estas malfermfontaj aŭ likitaj, permesante al iu ajn uzi ĉi tiujn modelojn por sia propra gajno.

Estas ĉiam pli malfacile pruvi, ke iu ajn uzanto kun kiu vi interagas en la interreto estas bot. Sociaj amaskomunikilaj platformoj kiel ekzemple Reddit kaj Tik Tok jam metis komunumajn regulojn, kiuj limigas AI-enhavon de esti sendita.

Ĉar niaj vivoj fariĝas pli dependaj de interretaj interagoj, estas grave por ĉi tiuj interretaj platformoj establi protokolojn, kiuj povas pruvi, ke konto estas administrata de homo.

En ĉi tiu artikolo, ni klarigos la postulojn por tia protokolo kaj rigardos progresojn evoluigitajn de Web3-aplikoj por solvi ĉi tiun problemon pri pruvado de personeco.

Kio estas Pruvo de Personeco?

Pruvo de personeco aŭ PoP estas speco de protokolo kiu ebligas reton kontroli ke vera homo estas malantaŭ aparta okazaĵo.

Malcentraj sistemoj povas efektivigi PoP-mekanismojn por malhelpi malican agadon okazi.

Kio okazas kiam a malcentralizita reto mankas maniero por kontroli homaron?

Unu el la plej malfacilaj Web3-defioj estas trovi manierojn malhelpi a Sibila atako. Ĉi tiu speco de minaco okazas kiam uzanto trovas manieron uzi plurajn kontojn por akiri maljustan avantaĝon en platformo aŭ reto.

Ekzemple, atakanto povas krei plurajn falsajn kontojn en platformo kiel Twitter aŭ Facebook. Post akiri aliron al granda nombro da kontoj, la atakanto povas uzi sian atingon por disvastigi misinformadon aŭ manipuli publikan opinion.

Aŭ en retoj kiuj permesas al ĉiu uzanto voĉdoni, atakanto povas krei plurajn falsajn identecojn por manipuli la rezultojn.

Proto de personeco-protokoloj povas malhelpi Sybil-atakojn postulante individuojn pruvi ke ili estas realaj homoj antaŭ permesi al ili partopreni reton.

La Minaco de AI-Modeloj pri Nunaj PoP-Metodoj

Vi eble jam renkontis bazan formon de PoP kun bot-detektaj servoj kiel ekzemple recapcha. Retejoj aldonas ĉi tiujn testojn por certigi, ke la persono uzanta la servon estas reala homo. Ili ofte postulas, ke vi faru teston, kiu estas sufiĉe facila por homo por solvi sed multe pli malfacila por komputiloj.

Ekzemple, ofta rekapcha testo petus la uzanton elekti ĉiujn kvadratojn en krado kiuj havas ponton, haltsignalon aŭ ŝtuparon.

Tamen, ĉar AI-modeloj iĝas pli progresintaj ĉe bilda detekto, ĉi tiuj specoj de testoj malrapide malnoviĝas. Ĉi tiuj provoj ankaŭ havas unu kritikan limigon: solvi la teston ne pruvas, ke vi estas unika uzanto.

Taŭga kaj sekura PoP-protokolo devas havi manieron fidinde pruvi, ke profilo apartenas al fakta uzanto kaj ke la uzanto ne povas krei plurajn kontojn por si mem.

En la sekva sekcio, ni pli profunde rigardos la ĉefajn postulojn por pruvo de personaj mekanismoj kaj kiel ĉi tiuj trajtoj povas helpi starigi tutmondajn malcentralizitajn identecojn.

Postuloj por Pruvo de Personeco

Jen kelkaj ĉefaj trajtoj de ideala pruvo de personeco protokolo.

- La protokolo devas valori Privateco. La mekanismo PoP devas povi teni la uzanton anonima

- La PoP-protokolo ankaŭ devas esti imuna al fraŭdo. Uzantoj ne devus povi krei plurajn profilojn sur la sama platformo.

- Por ke PoP-protokolo atingu tutmondan adapton, la reto mem devas esti skalebla kaj malcentralizita.

Antaŭ ol ni rigardu kelkajn promesplenajn efektivigojn de PoP-protokoloj, kiuj celas atingi ĉiujn suprajn ecojn, ni rigardu la malavantaĝojn de iuj el la plej popularaj metodoj pri pruvo de personeco.

Unue, ni rigardu la Turing-testan aliron. Vi certe renkontis unu el ĉi tiuj provoj antaŭe, se vi iam devis solvi kapĉan interrete.

Ĉu vi iam rimarkis, ke ĉi tiuj provoj fariĝas pli komplikaj solvi? AI atingas punkton, kie provoj pri defi-respondo kiel kompreni bildon nun estas bagatela tasko. Malicaj aktoroj ankaŭ povas uzi servojn, kiuj dependas de teamo de homaj uzantoj, kiuj estas asignitaj por solvi ĉi tiujn provojn laŭskale.

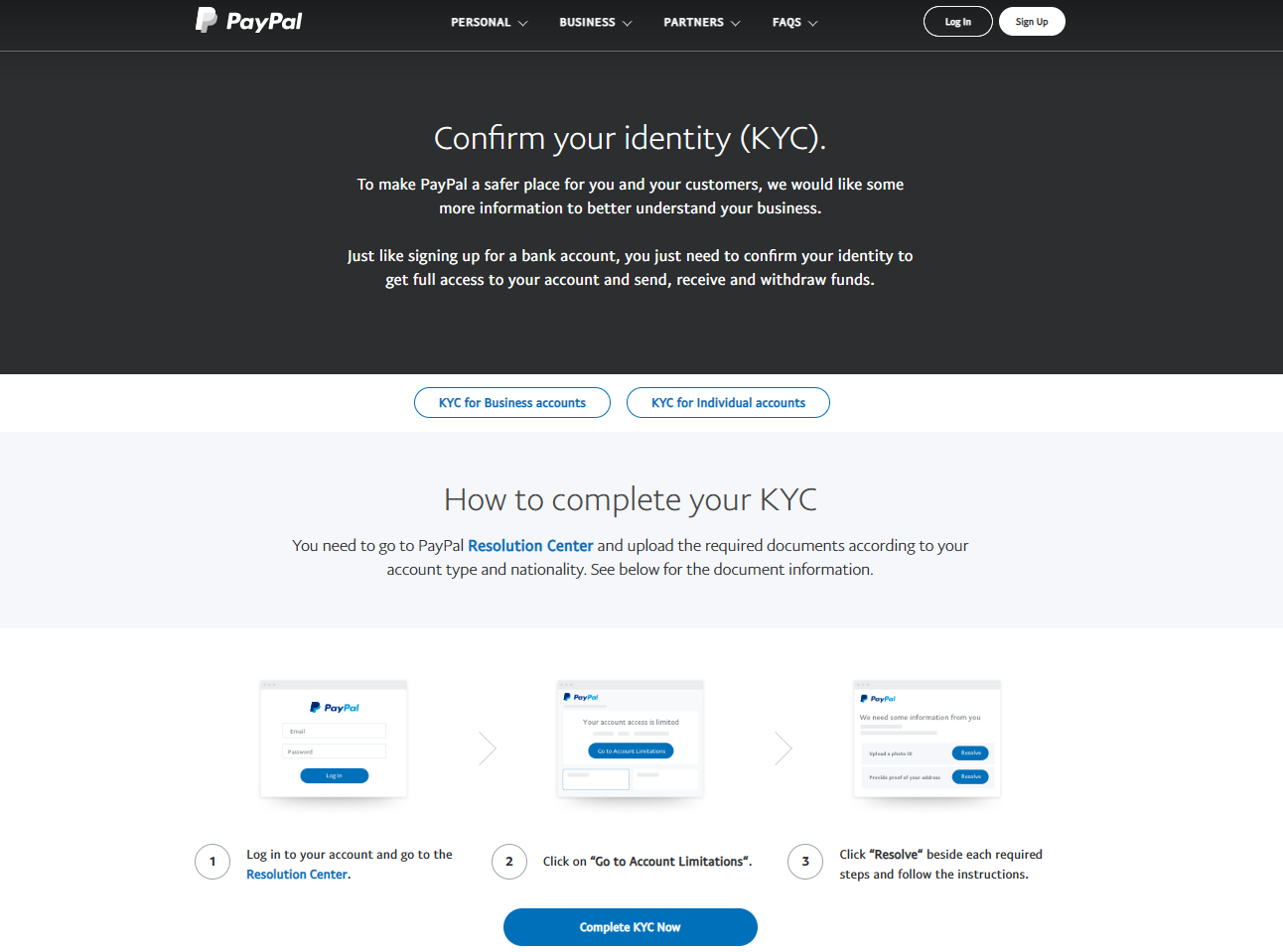

Alia ofta PoP-aliro estas identeckonfirmo. Plej multaj financaj institucioj sekvas iun formon de KYC (Know-Your-Customer) normo al administri fraŭdan aŭ malican agadon sur sia platformo.

Supozu, ke vi volas krei novan konton ĉe via loka banko. La banko kutime postulas, ke vi prezentu iun formon de registara identigilo. Sociaj amaskomunikilaj platformoj kiel Facebook kaj Twitter ankaŭ uzas formon de identeckonfirmo. Ĉi tiuj platformoj petas uzantojn kontroli sian poŝtelefonnumeron aŭ retpoŝton por malhelpi ununuran uzanton krei dekojn da kontoj sur sia platformo.

Kvankam ĉi tiu metodo helpas malinstigi malicajn aktorojn, ankoraŭ ekzistas multaj manieroj preteriri ĉi tiujn limojn. Ekzemple, malica aktoro povas uzi teknikojn kiel ekzemple SMS-parolado por akiri aliron al granda nombro da kontoj.

Aldone, KYC-identigo estas malfacile efektivigi tutmonde, ĉar ne ĉiu persono havas identigilon. Eĉ se individuo havis identigilon, centralizita korpo ankoraŭ konservas kaj kontrolas ĉi tiujn rekordojn.

Eblaj Aliroj por Pruvo de Personeco

Retejo de fido

La reto de fida aliro por pruvo de personeco estas malcentralizita metodo de identeckontrolo.

En ĉi tiu aliro, uzantoj kreas kaj administras siajn proprajn ciferecajn identecojn kreante ciferecajn atestojn sur publika platformo. Uzantoj tiam atendas ke ĉi tiuj atestiloj estu kontrolitaj de aliaj individuoj en la komunumo, kiuj estas fidindaj kaj kontrolitaj. Ĉi tiu procezo kreas "reton de fido" kiu garantias la identecon de la individuo.

Ju pli da individuoj subskribas la atestilon de uzanto, des pli fidindaj kaj kontrolitaj fariĝas ilia identeco. Ĉi tio kreas reton de fido kiu povas helpi kontroli la identecon de individuo interrete.

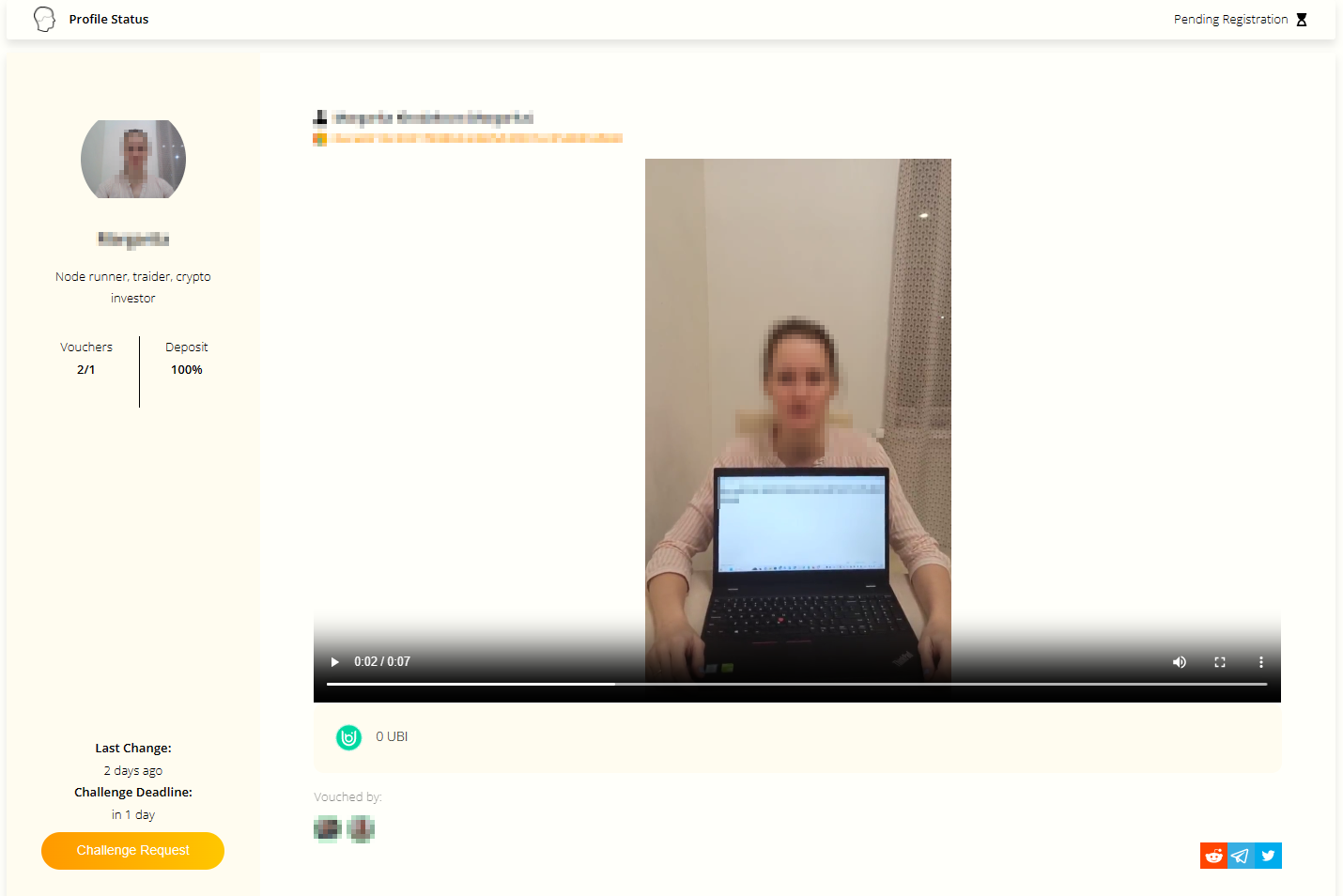

Projektoj kiel Pruvo de Homaro koncentriĝu pri konstruado de fidindaj retejoj por Web3. Uzantoj devas alŝuti videon de ili parolante kun Ethereum-adreso klare videbla sur aparato aŭ paperfolio. La uzanto devas deponi malgrandan nombron da ĵetonoj, kiuj estos resenditaj post kiam registrita uzanto certigis vian identecon.

biometriko

Biometriko estas konfirmmetodo kiu dependas de la unikaj biologiaj karakterizaĵoj de individuo por identeckonfirmo. Ĉar ĉi tiuj trajtoj ne povas esti perditaj aŭ forgesitaj, biometriko povas esti uzata kiel fidinda metodo por pruvo de personeco.

Ekzistas pluraj metodoj de biometriko kun ŝanĝiĝantaj gradoj da malfacileco en efektivigo.

Biometrio de fingrospuroj implikas uzi la unikajn fingrospurpadronojn de individuo por kontroli ilian identecon. Fingrospura biometrio estas vaste akceptita kiel oportuna metodo de pruvo de personeco en registaraj kaj komercaj agordoj.

Uzantoj ankaŭ povas kontroli sian identecon per la uzo de vizaĝbiometriko. Platformoj povas uzi vizaĝrekonan teknologion por egali la vizaĝon de uzanto al sia registar-eldonita identigilo aŭ aliaj dokumentoj. La sukceso de la Face ID-sistemo de Apple montris la fareblecon de vizaĝbiometriko en porteblaj aparatoj kiel alternativon al paskodoj kaj fingrospura biometrio.

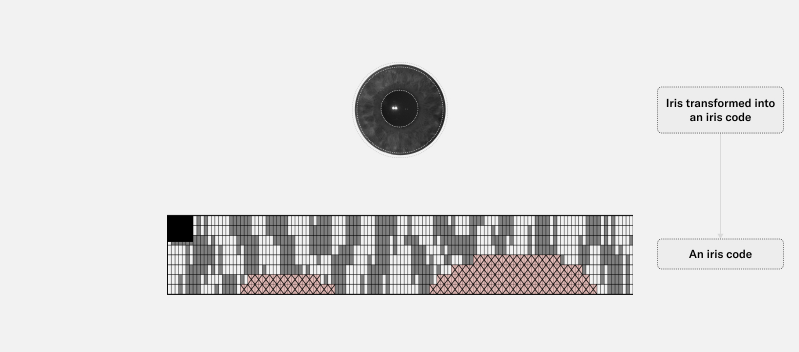

Alia ebla metodo estas la uzo de iris-biometriko por skani la unikajn padronojn trovitajn en la iriso de individuo. Esploristoj argumentas ke iris-biometriko estas pli preciza ol vizaĝrekono kaj fingrospurbiometriko. Irisaj padronoj estas pli unikaj ol fingrospuroj kaj restas relative senĉenigitaj dum la individuaj maljuniĝoj.

Unu averto de iris-biometriko estas ke skanado de la iriso de la uzanto postulas specialigitajn aparatojn.

La privatec-fokusita cifereca identeca platformo Monda monero planas uzi kutiman aparataron nomatan "Orb". La aparato donas pruvon pri personaj akreditaĵoj, kiujn AI malfacilas forĝi. La Orb ankaŭ konservas la informojn de la uzanto sekuraj forigante ĉiujn fotojn post ĉiu konfirmo.

konkludo

Ĉar malcentralizitaj aplikoj trovas pli realajn uzkazojn, programistoj devas integri manierojn malhelpi malicajn agantojn utiligi la sistemon. Pruvo de personaj mekanismoj estas ŝlosila parto por konservi ĉi tiujn platformojn sekuraj kaj fidindaj.

Esplorado pri pruvo de personecaj aliroj ankaŭ devus temigi la danĝeron de atakantoj uzantaj AI por trompi la sistemon. Se AI havas la kapablon imiti la vizaĝon kaj parolon de iu ajn persono, interretaj platformoj povus riski esti superitaj de fraŭdaj kaj malicaj profiloj pozantaj kiel realaj homoj.

Kio laŭ vi estas la plej bona maniero trakti la problemon de ciferecaj identecoj en la epoko de AI?

Lasi Respondon