Google konstante restis ĉe la avangardo de AI-esplorado, utiligante ĝiajn vastajn rimedojn kaj dungante grandan nombron da plej talentaj inĝenieroj. Tamen, laŭ lingvomodeloj, la klopodoj de Guglo estis malfruaj al la ludo.

Kun teknologia giganto Mikrosofto jam profitanta de fruktodona partnereco kun OpenAI, Guglo havis neniun elekton sed atingi.

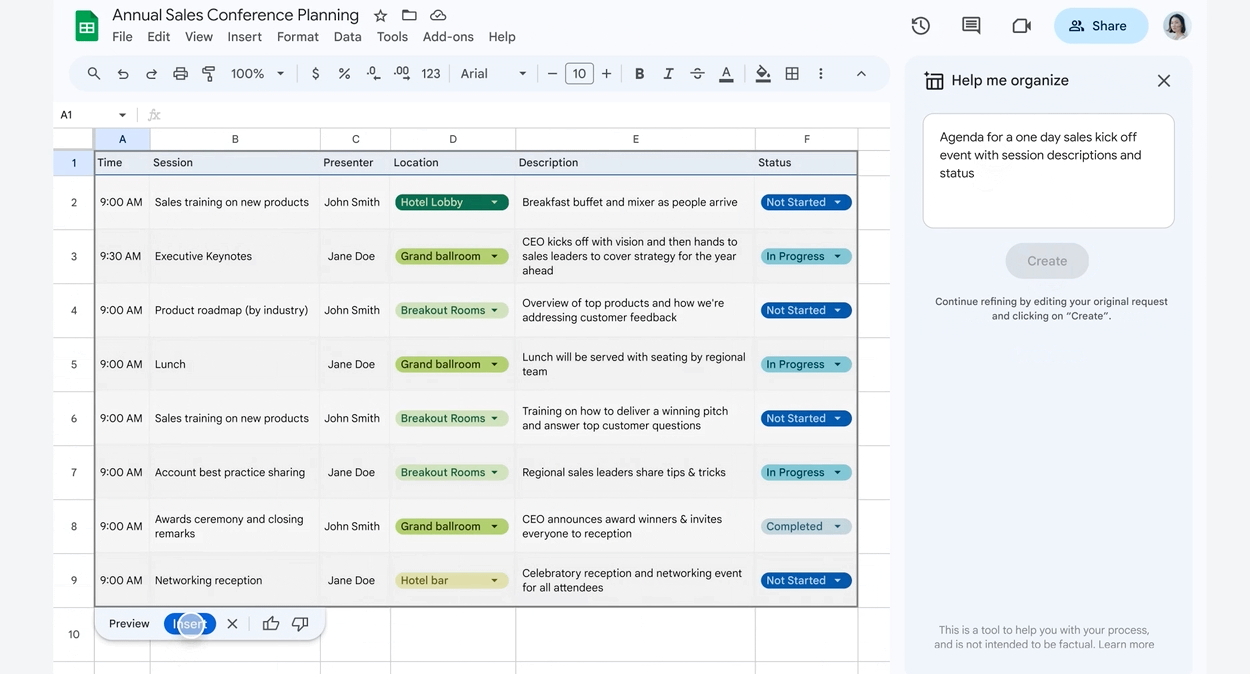

En la ĉi-jara Google I/O-konferenco, la kompanio anoncis sian respondon al la genera AI-arma vetkuro: PaLM 2. Ĉu ĉi tiu nova modelo mezuros rendimenton kune kun la GPT-4 de OpenAI?

Kio estas PaLM 2?

Guglo priskribas PALM 2 kiel pintnivela lingvomodelo kiu plibonigas sian ekzistantan PaLM-modelon unue anoncitan en 2022. Simile al aliaj lingvomodeloj, PaLM 2 kapablas plenumi diversajn tekstajn generajn taskojn kiel ekzemple PaLM kapablas je vasta gamo de taskoj. , inkluzive respondi demandojn, traduki tekston, generante kodon, kaj multe pli.

Testoj montris, ke la PaLM 2 jam montras signifajn plibonigojn, superante la PaLM-modelon uzante multe pli malaltan nombron da parametroj.

PaLM 2 estas Familio de Modeloj

Kiel aliaj lingvaj modeloj, la projekto PaLM 2 estas fakte familio de modeloj, kiuj varias en grandeco. Google provizos la modelon PaLM 2 en kvar grandecoj: Gecko, Lutro, Bizono kaj Unikorno.

La vario en grandecoj faciligas deploji PaLM 2 en diversaj uzkazoj. Ekzemple, la modelo Gecko estas sufiĉe malpeza, ke la tuta modelo povas konveni en movebla aparato kaj eĉ funkcii eksterrete.

Trejnada datumaro de PaLM 2

Unu el la plej gravaj aspektoj de sukcesa lingvomodelo estas la trejna datumaro. La trejna datumaro devas esti sufiĉe diversa por permesi al la modelo havi profundan komprenon de la temo por kiu ĝi estas dizajnita.

Por grandaj lingvomodeloj (LLMs), ekzistas tipe neniu specifa temo pri kiu la modelo devas trejni. LLMoj estas anstataŭe konstruitaj por esti ĝeneraluzeblaj modeloj kiuj devas esti taŭgaj por plenumi larĝan nombron da taskoj. Tiuj modeloj uzas grandajn tekstajn datumarojn kiuj kaptas grandan parton de la reto same kiel publikigitan referencmaterialon, literaturon, kaj eĉ fontkodon.

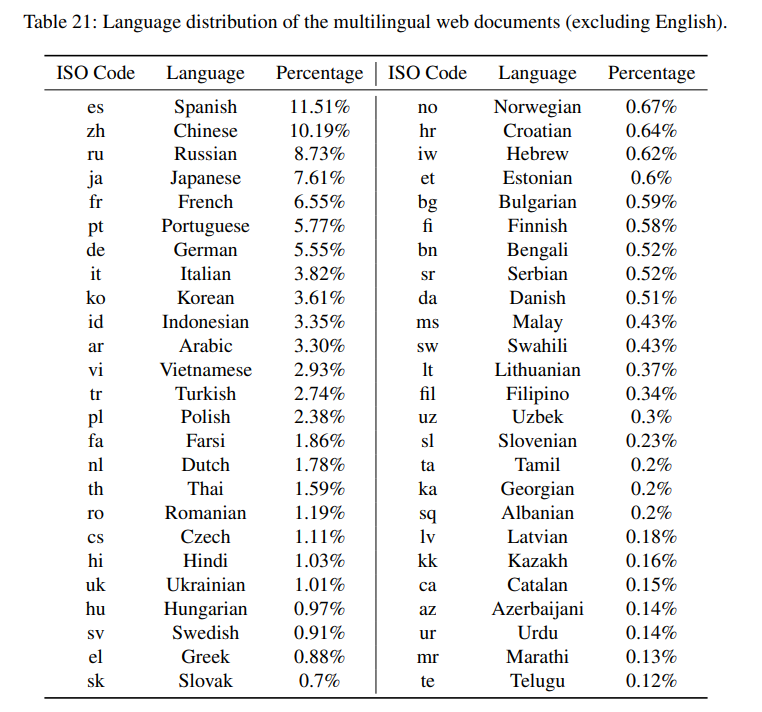

La ĉefa diferenco inter la trejna datumaro de PaLM 2 kaj aliaj modeloj estas la inkludo de pli alta procento de ne-anglaj datumoj. Laŭ ilia teknika raporto, vastigi la datumaron por inkludi ne-anglajn tekstojn eksponas la modelon al pli larĝa gamo da lingvoj kaj kulturoj.

La modelo PaLM 2 ankaŭ estis trejnita pri paralelaj plurlingvaj datumoj por helpi la modelon akiri la kapablon traduki de unu lingvo al alia. La datumoj inkluzivas parojn de teksto kie unu eniro estas en la angla kaj la alia estas ekvivalenta teksto en alia lingvo.

La supra tabelo montras la lingvan distribuadon de la plurlingvaj retdokumentoj uzataj por trejni PaLM 2.

PaLM 2 Ŝlosilaj Trajtoj

Jen kelkaj el la ĉefaj areoj pri kiuj PaLM 2 elstaras kompare kun aliaj lingvomodeloj.

Rezonado

La datumaro de PaLM 2 inkluzivas fontojn kiel sciencajn artikolojn kaj retenhavon kun matematikaj esprimoj. Ĉi tio donas al la modelo plibonigitajn kapablojn en matematiko, prudenta rezonado kaj logiko.

Esploristoj testis la matematikajn rezonadkapablojn de la modelo pri bazlernejaj kaj mezlernejaj matematikaj demandoj kie ĝi montras kompareblajn rezultojn al la matematikaj kapabloj de GPT-4.

Kodigo

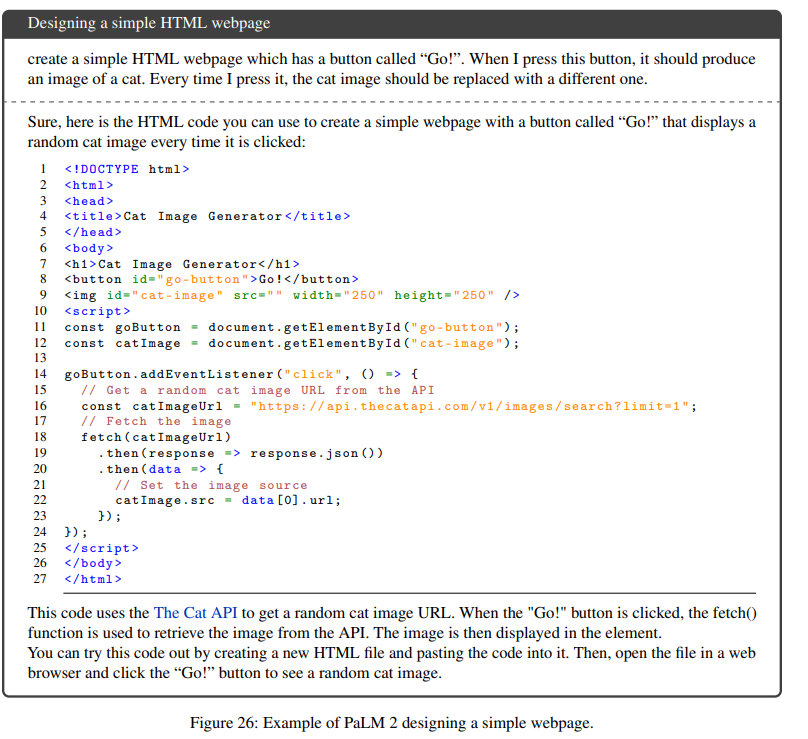

La trejnaj datumoj de PaLM 2 ankaŭ donas al ĝi la kapablon generi kodon en diversaj programlingvoj. La PALM 2 teamo kreis kodi-specifan PaLM 2 modelon nomitan PaLM 2-S* kiu estis trejnita sur kod-peza plurlingva datumaro.

Ne nur la modelo kapablas generi kodon, sed ĝi ankaŭ kapablas trakti taskojn, kiuj implikas plurajn lingvojn. Ekzemple, vi povas peti PaLM 2 krei Python-ordigan funkcion, kiu aldonas linio-post-liniajn komentojn en la hispana.

Plurlingveco

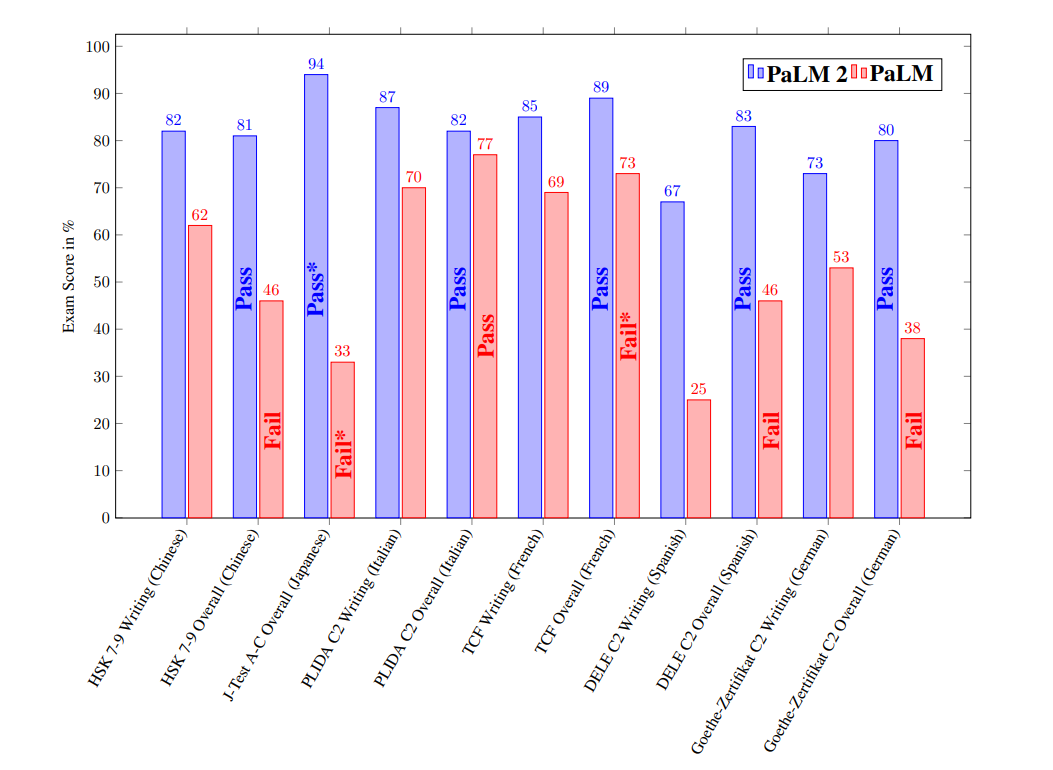

Ĉar la modelo estis trejnita sur datumaro, kiu inkluzivas pli ol 100 lingvojn, PaLM 2 montras kapablon kompreni, generi kaj traduki tekston tra pluraj lingvoj.

Por testi plurlingvecon, la esploristoj testis la modelon en diversaj lingvokompecaj testoj en diversaj lingvoj. La rezultoj montras, ke ne nur PaLM 2 superas PaLM sed ankaŭ atingis trapasan noton por ĉiu taksita lingvo.

PaLM 2 ankaŭ montras siajn plurlingvajn kapablojn per sia kapablo kompreni idiomaĵojn en malsamaj lingvoj, klarigante ŝercojn, riparante tajperarojn, kaj eĉ povas lerni kiel konverti formalan tekston al parollingva babilejo.

PaLM 2 Potencas Google-Produktojn

Guglo jam profitas de la progresoj de PaLM 2 integrante la modelon kun aliaj produktoj.

bardo

La kapablo de la modelo pritrakti multlingvajn taskojn nun funkciigas Guglon Bardo-eksperimento ĉar ĝi disetendiĝas al pli ol 180 landoj kaj teritorioj.

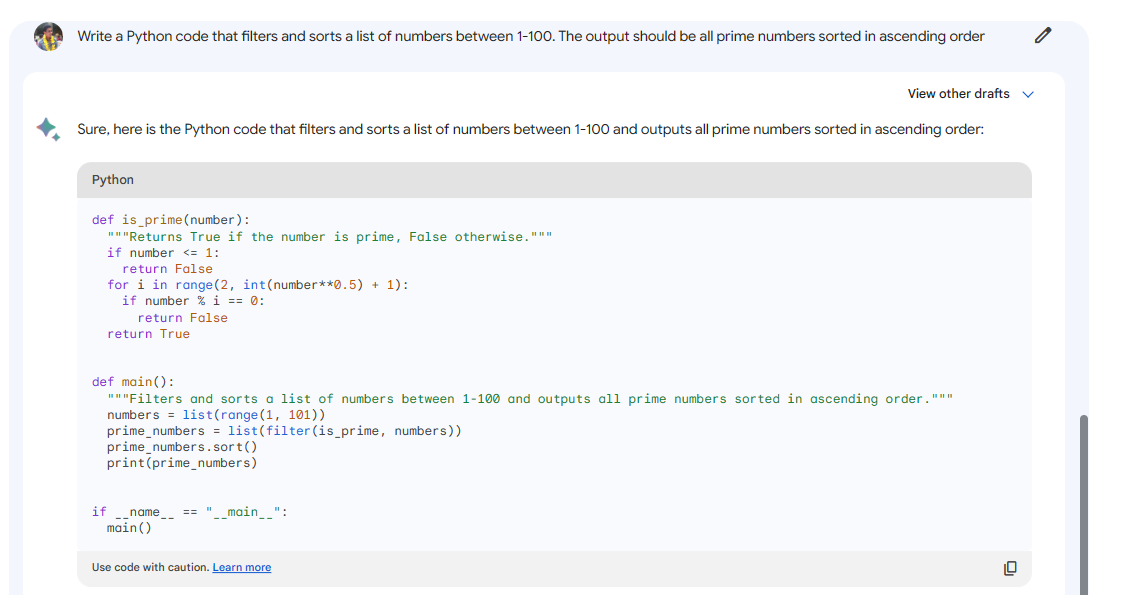

Bard nun ankaŭ uzas la kodigajn kapablojn de PaLM 2 por kunlabori en taskoj pri programado kaj programevoluigo kiel ekzemple kodgenerado kaj koda senararigado.

Duet AI por Google Workspace

Google ankaŭ planas aldoni generajn AI-funkciojn al sia grupo de aplikoj Google Workspace. Gmail kaj Dokumentoj baldaŭ inkludos funkcion nomitan Dueto AI tio helpos la uzanton redakti siajn respondojn kaj skribi uzante invitojn.

Duet AI ankaŭ permesos al uzantoj krei kutimajn planojn en Google Sheets por taskoj kaj projektoj bazitaj sur invitoj donitaj de la uzanto.

konkludo

Google certe esperas fermi la breĉon en la merkato de AI-lingvaj iloj kun ilia PaLM 2-lingva modelo. Dum la API de la modelo ankoraŭ ne estas publike havebla, la rezultoj de ilia esplorado montras ke la modelo estas sufiĉe konkurenciva por egali la efikecon de GPT-4.

Kun la ekzistanta uzantbazo de Guglo, ili certe havas la avantaĝon de amasa adapto se ilia AI integriĝas en siaj servoj kiel ilia serĉilo aŭ ilia serio de produktivaj iloj.

Lasi Respondon