Enhavtabelo[Kaŝi][Montri]

La estonteco estas ĉi tie. Kaj, en ĉi tiu estonta maŝinoj komprenas la mondon ĉirkaŭ ili same kiel homoj. Komputiloj povas veturi aŭtojn, diagnozi malsanojn kaj precize antaŭvidi la estontecon.

Ĉi tio povas ŝajni sciencfikcio, sed profundaj lernaj modeloj faras ĝin realaĵo.

Ĉi tiuj kompleksaj algoritmoj malkaŝas la sekretojn de artefarita inteligento, permesante al komputiloj memlerni kaj disvolviĝi. En ĉi tiu afiŝo, ni enprofundiĝos en la sferon de profunda lernado-modeloj.

Kaj ni esploros la grandegan potencialon, kiun ili havas por revolucii niajn vivojn. Preparu lerni pri avangarda teknologio, kiu ŝanĝas la estontecon de la homaro.

Kio Ĝuste Estas Profunda Lernado-Modeloj?

Ĉu vi iam ludis ludon, en kiu vi devas identigi la diferencojn inter du bildoj?

Ĝi estas tamen amuza, ĝi ankaŭ povas esti malfacila, ĉu ne? Imagu povi instrui komputilon ludi tiun ludon kaj venki ĉiufoje. Profundaj lernaj modeloj plenumas ĝuste tion!

Profunda lernado-modeloj estas similaj al super-inteligentaj maŝinoj kiuj povas ekzameni grandan nombron da bildoj kaj determini kion ili havas komune. Ili plenumas tion malmuntante la bildojn kaj studante ĉiun individue.

Ili tiam aplikas tion, kion ili lernis por identigi ŝablonojn kaj fari antaŭdirojn pri freŝaj bildoj, kiujn ili neniam antaŭe vidis.

Profunda lernado-modeloj estas artefaritaj neŭralaj retoj, kiuj povas lerni kaj eltiri komplikajn ŝablonojn kaj karakterizaĵojn de masivaj datumaroj. Tiuj modeloj konsistas el pluraj tavoloj de ligitaj nodoj, aŭ neŭronoj, kiuj analizas kaj ŝanĝas envenantajn datenojn por generi produktaĵon.

Profundaj lernaj modeloj estas precipe taŭgaj por laboroj postulantaj grandan precizecon kaj precizecon, kiel bildidentigo, parolrekono, naturlingva prilaborado kaj robotiko.

Ili estis uzataj en ĉio, de memveturaj aŭtoj ĝis medicinaj diagnozoj, rekomendaj sistemoj kaj prognozaj analizoj.

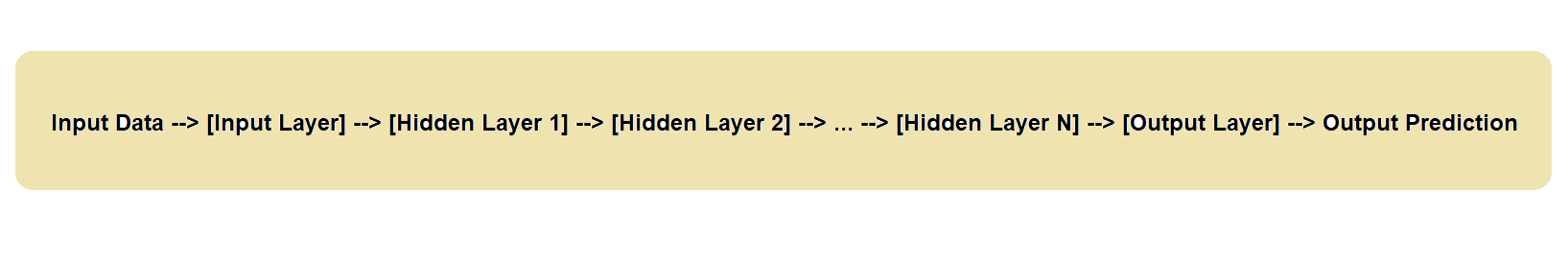

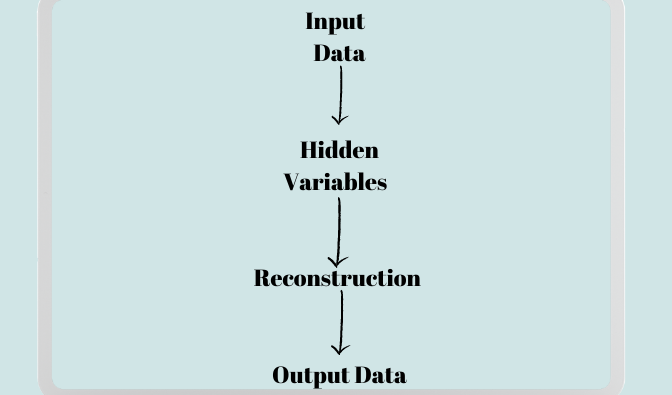

Jen simpligita versio de la bildigo por ilustri datumfluon en profunda lerna modelo.

La enirdatenoj fluas en la enirtavolon de la modelo, kiu tiam pasas la datenojn tra kelkaj kaŝitaj tavoloj antaŭ disponigado de produktaĵprognozo.

Ĉiu kaŝita tavolo elfaras serion de matematikaj operacioj sur la enirdatenoj antaŭ ol pasi ĝin al la sekva tavolo, kiu disponigas la finan prognozon.

Nun, ni vidu, kio estas profundaj lernaj modeloj kaj kiel ni povas uzi ilin en nia vivo.

1. Konvoluciaj Neŭralaj Retoj (CNNoj)

CNNoj estas profunda lernadmodelo kiu transformis la areon de komputila vizio. CNNoj estas uzataj por klasifiki bildojn, rekoni objektojn kaj segmenti bildojn. La strukturo kaj funkcio de la homa vidkortekso informis la dezajnon de CNNoj.

Kiel Ili Funkcias?

CNN konsistas el kelkaj konvoluciaj tavoloj, kunigantaj tavoloj kaj plene ligitaj tavoloj. La enigo estas bildo, kaj la eligo estas antaŭdiro de la klasetikedo de la bildo.

La konvoluciaj tavoloj de CNN konstruas trajtomapon elfarante punktoprodukton inter la eniga bildo kaj aro de filtriloj. La kunigaj tavoloj malaltigas la grandecon de la trajtomapo subspecimentante ĝin.

Finfine, la trajtomapo estas uzata de la plene ligitaj tavoloj por antaŭdiri la klasetikedon de la bildo.

Kial CNN-oj estas Gravaj?

CNN-oj estas esencaj ĉar ili povas lerni detekti ŝablonojn kaj karakterizaĵojn en bildoj, kiujn homoj malfacilas rimarki. CNN-oj povas esti instruitaj rekoni karakterizaĵojn kiel randoj, anguloj kaj teksturoj uzante grandajn datumarojn. Post lerni ĉi tiujn trajtojn, CNN povas uzi ilin por identigi objektojn en freŝaj fotoj. CNN-oj montris avangardan efikecon en diversaj bildaj identigaj aplikoj.

Kie Ni Uzas CNN-ojn

Sanservo, la aŭtoindustrio kaj podetala komerco estas nur kelkaj sektoroj, kiuj uzas CNN-ojn. En la sanindustrio, ili povas esti utilaj por diagnozo de malsano, disvolviĝo de medikamentoj kaj analizo de medicina bildo.

En la aŭtomobila sektoro, ili helpas pri lenodetekto, detekto de objektoj, kaj aŭtonoma veturado. Ili ankaŭ estas tre uzitaj en podetala komerco por vida serĉo, bild-bazita produktorekomendo, kaj stokregistrokontrolo.

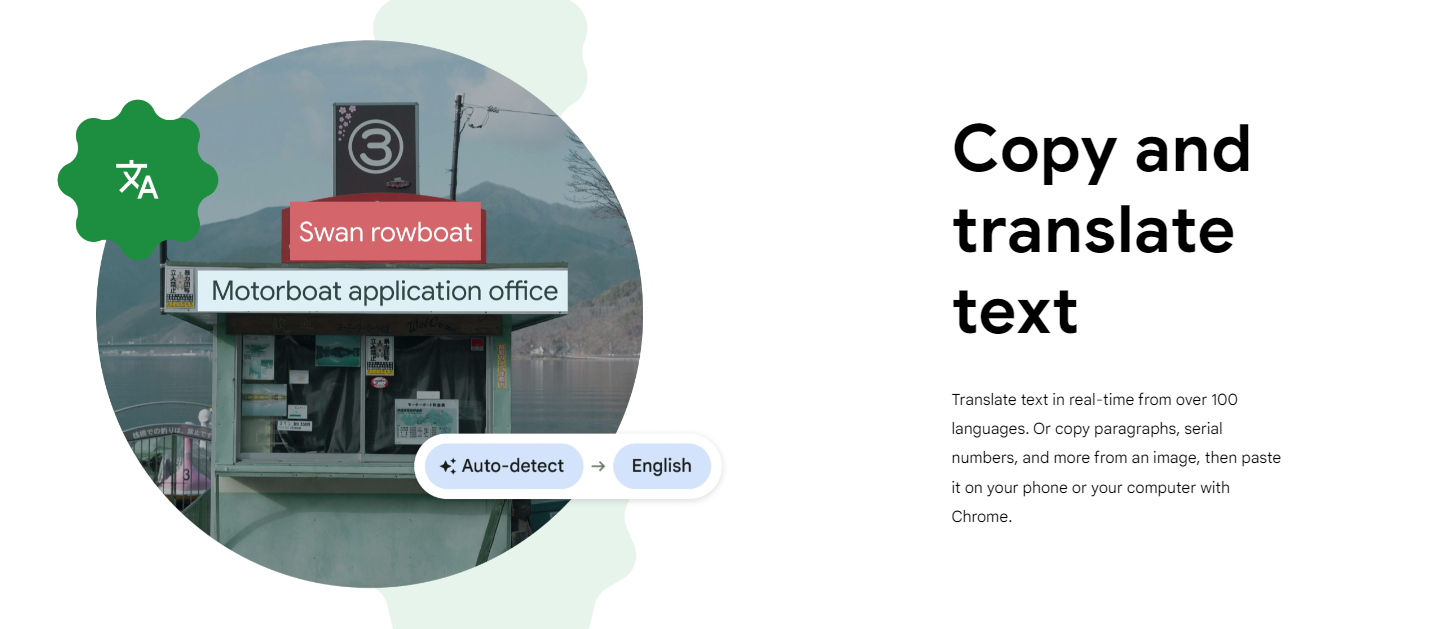

Ekzemple; Google utiligas CNN-ojn en diversaj aplikoj, inkluzive Google Lensoj, tre ŝatata bilda identiga ilo. La programo uzas CNN-ojn por taksi fotojn kaj doni informojn al uzantoj.

Google Lens, ekzemple, povas rekoni aferojn en bildo kaj proponi detalojn pri ili, kiel la speco de floro.

Ĝi ankaŭ povas traduki la tekston ĉerpita el bildo en plurajn lingvojn. Google Lens kapablas doni al konsumantoj utilajn informojn pro la helpo de CNN-oj precize identigi aĵojn kaj ĉerpi trajtojn de fotoj.

2. Longa Mallongdaŭra Memoro (LSTM) retoj

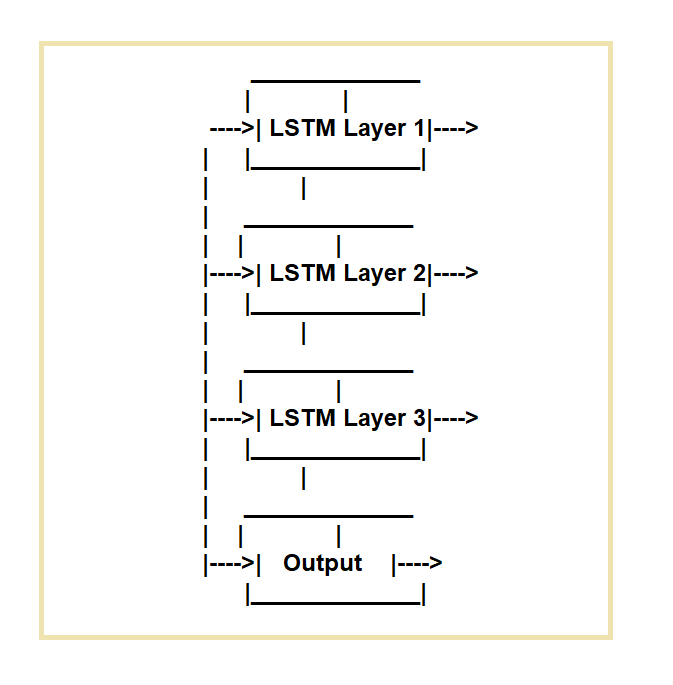

Longa Short-Term Memory (LSTM) retoj estas kreitaj por trakti la mankojn de regulaj ripetiĝantaj neŭralaj retoj (RNNoj). LSTM-retoj estas idealaj por taskoj, kiuj postulas la prilaboradon de datumsekvencoj laŭlonge de la tempo.

Ili funkcias utiligante specifan memorĉelon kaj tri enirmekanismojn.

Ili reguligas la fluon de informoj en kaj el la ĉelo. La eniga pordego, forgesu pordego kaj eliga pordego estas la tri pordegoj.

La eniga pordego reguligas la fluon de datumoj en la memorĉelon, la forgesita pordego reguligas la forigon de datumoj de la ĉelo, kaj la eliga pordego reguligas la fluon de datumoj el la ĉelo.

Kio estas ilia Signifo?

LSTM-retoj estas utilaj ĉar ili povas sukcese reprezenti kaj prognozi datensekvencojn kun longperspektivaj rilatoj. Ili povas registri kaj reteni informojn pri antaŭaj enigaĵoj, permesante al ili fari pli precizajn antaŭdirojn pri estontaj enigaĵoj.

Parola rekono, manskriba rekono, naturlingva prilaborado kaj bildotekstoj estas nur kelkaj el la aplikoj kiuj uzis LSTM-retojn.

Kie Ni Uzas LSTM-Retojn?

Multaj programaroj kaj teknologiaj aplikoj uzas LSTM-retojn, inkluzive de parolrekonosistemoj, naturlingvaj pretigaj iloj kiel sento-analizo, maŝintraduksistemoj, kaj tekst- kaj bildgeneradsistemoj.

Ili ankaŭ estis utiligitaj en la kreado de memveturaj aŭtoj kaj robotoj, same kiel en la financa industrio por detekti fraŭdon kaj antaŭvidi. borso movadoj.

3. Generativaj Kontraŭaj Retoj (GANoj)

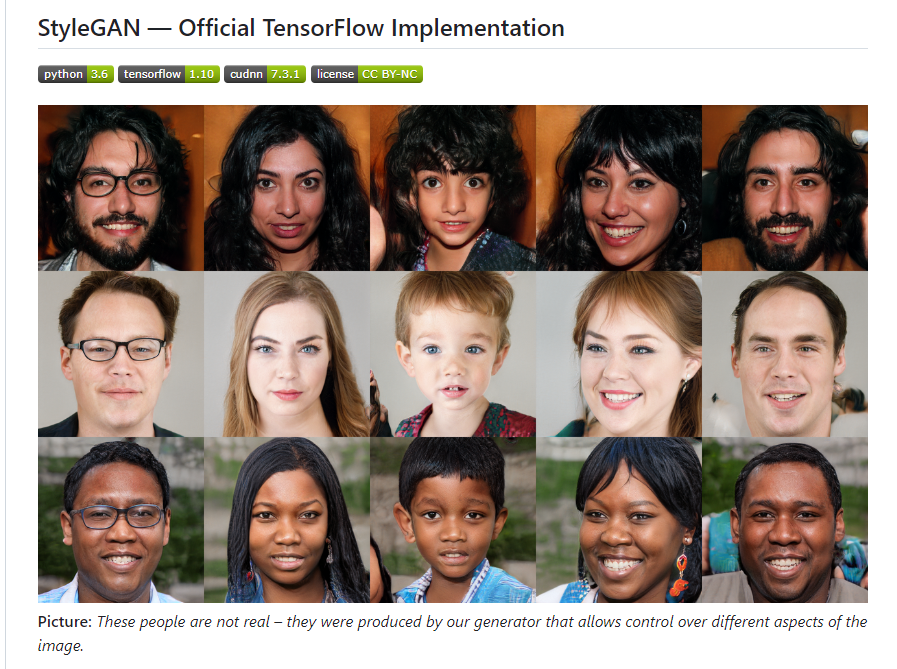

GANoj estas a profunda lernado tekniko kiu estas uzata por generi novajn datenspecimenojn kiuj estas similaj al antaŭfiksita datumaro. GANoj konsistas el du neŭralaj retoj: unu kiu lernas produkti novajn specimenojn kaj unu kiu lernas distingi inter aŭtentaj kaj generitaj specimenoj.

En simila aliro, tiuj du retoj estas trejnitaj kune ĝis la generatoro povas generi provaĵojn kiuj estas nedistingeblaj de faktaj.

Kial Ni Uzas GANojn

GANoj estas signifaj pro sia kapablo produkti altkvalitan sintezaj datumoj kiu povas esti utiligita por diversaj aplikoj, inkluzive de bildo kaj videoproduktado, tekstogenerado, kaj eĉ muzikgenerado.

GANoj ankaŭ estis uzitaj por datenpliigo, kio estas la generacio de sintezaj datumoj por kompletigi realmondajn datumojn kaj plibonigi la agadon de maŝinlernantaj modeloj.

Krome, kreante sintezajn datumojn, kiuj povas esti uzataj por trejni modelojn kaj imiti provojn, GANoj havas la eblecon transformi sektorojn kiel medicino kaj drog-evoluo.

Aplikoj de GANoj

GANoj povas kompletigi datenojn, krei novajn bildojn aŭ filmojn, kaj eĉ generi sintezajn datumojn por sciencaj simulaĵoj. Krome, GANoj havas la eblecon esti utiligitaj en diversaj aplikoj, kiuj iras de distro ĝis medicina.

aĝoj kaj filmetoj. StyleGAN2 de NVIDIA, ekzemple, estis uzata por krei altkvalitajn fotojn de famuloj kaj artaĵoj.

4. Profundaj Kredaj Retoj (DBNoj)

Deep Belief Networks (DBN) estas artefarita inteligento sistemoj kiuj povas lerni ekvidi ŝablonojn en datumoj. Ili plenumas tion segmentante la datumojn en pli kaj pli malgrandajn pecojn, akirante pli ĝisfundan komprenon de ĝi ĉe ĉiu nivelo.

DBNoj povas lerni de datumoj sen esti informitaj kio ĝi estas (tio estas referita kiel "nekontrolita lernado"). Ĉi tio igas ilin ekstreme valoraj por detekti ŝablonojn en datumoj, kiujn persono malfacile aŭ neeblas percepti.

Kio Gravigas DBN-ojn?

DBNoj estas signifaj pro sia kapacito lerni hierarkiajn datenreprezentantarojn. Tiuj reprezentadoj povas esti utiligitaj por gamo da aplikoj kiel klasifiko, anomaliodetekto, kaj dimensiecredukto.

La kapablo de DBN-oj entrepreni nekontrolitan antaŭtrejnadon, kiu povas pliigi la agadon de profundaj lernaj modeloj kun minimumaj etikeditaj datumoj, estas grava avantaĝo.

Kio Estas la Aplikoj de DBN-oj?

Unu el la plej signifaj aplikoj estas detekto de objektoj, en kiu DBNoj kutimas rekoni certajn specojn de aĵoj kiel ekzemple aviadiloj, birdoj, kaj homoj. Ili ankaŭ estas utiligitaj por bildgenerado kaj klasifiko, moviĝdetekto en filmoj, kaj naturlingva kompreno por voĉprilaborado.

Krome, DBNoj estas ofte utiligitaj en datumaroj por taksi homajn pozojn. DBN-oj estas bonega ilo por diversaj industrioj, inkluzive de sanservo kaj bankado, kaj teknologio.

5. Profunda Plifortigo-Lernado-Retoj (DRLs)

profundajn Plifortiga Lernado Retoj (DRLoj) integras profundajn neŭralajn retojn kun plifortigaj lernaj teknikoj por permesi al agentoj lerni en komplika medio per provo kaj eraro.

DRLs estas uzataj por instrui agentojn kiel optimumigi rekompencan signalon interagante kun ilia medio kaj lernante de siaj eraroj.

Kio Faras Ilin Rimarkindaj?

Ili estis uzataj efike en diversaj aplikoj, inkluzive de videoludado, robotiko kaj aŭtonoma veturado. DRLoj estas gravaj ĉar ili povas lerni rekte de kruda sensa enigo, permesante al agentoj fari decidojn bazitajn sur siaj interagoj kun la medio.

Gravaj Aplikoj

DRLoj estas uzataj en realaj cirkonstancoj ĉar ili povas trakti malfacilajn aferojn.

DRLoj estis inkluditaj en pluraj elstaraj softvaroj kaj teknologiaj platformoj, inkluzive de la Trejnsalono de OpenAI, La ML-Agentoj de Unity, kaj DeepMind Lab de Google. AlphaGo, konstruita de Guglo Deepmind, ekzemple, utiligas DRL por ludi la tabulludon Go sur mondĉampiona nivelo.

Alia uzo de DRL estas en robotiko, kie ĝi kutimas kontroli la movadojn de robotbrakoj por efektivigi taskojn kiel ekteni aĵojn aŭ stakigi blokojn. DRL-oj havas multajn uzojn kaj estas utila ilo por trejnante agentojn por lerni kaj fari decidojn en komplikaj agordoj.

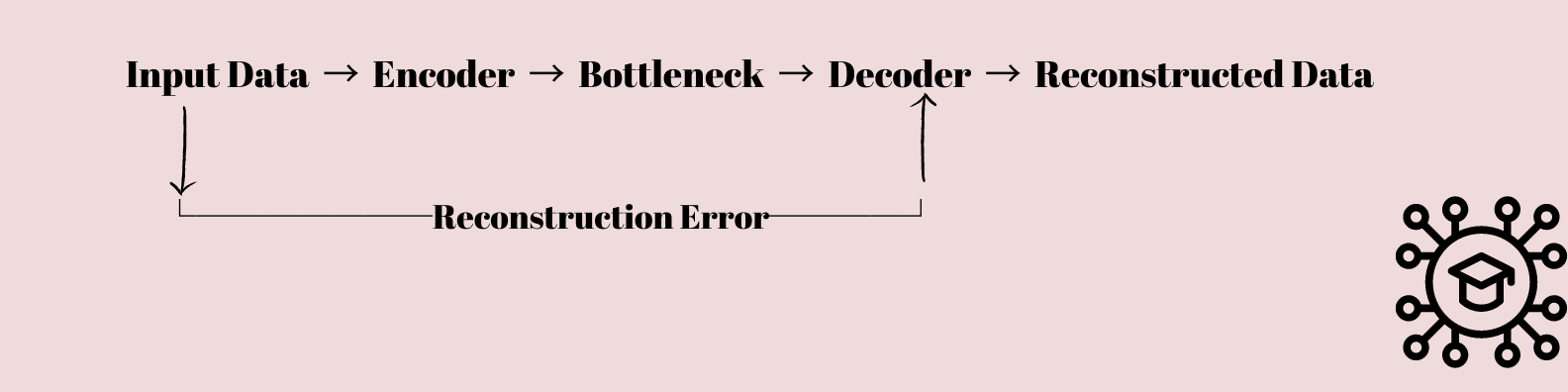

6. Aŭtokodigiloj

Aŭtokodigiloj estas interesa speco de Neŭra reto tio kaptis la intereson de kaj akademiuloj kaj datumsciencistoj. Ili estas esence desegnitaj por lerni kiel kunpremi kaj restarigi datumojn.

La enirdatenoj estas provizitaj tra sinsekvo de tavoloj kiuj iom post iom malaltigas la dimensiecon de la datenoj ĝis ĝi estas kunpremita en proplempunktotavolon kun pli malmultaj nodoj ol la enigaĵo kaj produktaĵtavoloj.

Tiu kunpremita reprezentado tiam kutimas rekrei la originajn enirdatenojn uzante sekvencon de tavoloj kiuj iom post iom levas la dimensiecon de la datenoj reen al sia origina formo.

Kial Ĝi Gravas?

Aŭtokodigiloj estas decida komponanto de profunda lernado ĉar ili ebligas eltiron de funkcioj kaj redukton de datumoj.

Ili kapablas identigi la ŝlosilajn elementojn de la envenantaj datumoj kaj traduki ilin en kunpremitan formon, kiu tiam povas esti aplikata al aliaj taskoj kiel klasifiko, grupiĝo aŭ kreado de novaj datumoj.

Kie Ni Uzas Aŭtokodilojn?

Detekto de anomalioj, prilaborado de natura lingvo, kaj komputila vidado estas nur kelkaj el la disciplinoj, kie oni uzas aŭtokodilojn. Aŭtokodigiloj, ekzemple, povas esti uzitaj por bildkunpremado, bildsenbruigo, kaj bildsintezo en komputila vizio.

Ni povas uzi Aŭtokodilojn en taskoj kiel kreado de tekstoj, kategoriigo de tekstoj kaj resumado de tekstoj en prilaborado de natura lingvo. Ĝi povas identigi anomalian agadon en datenoj kiuj devias de la normo en anomaliidentigo.

7. Kapsula Retoj

Kapsula Retoj estas nova profunda lerna arkitekturo kiu estis evoluigita kiel anstataŭaĵo por Konvoluciaj Neŭralaj Retoj (CNNoj).

Kapsula Retoj estas bazitaj sur la nocio grupigi cerbajn unuojn nomitajn kapsuloj kiuj respondecas pri rekonado de la ekzisto de certa objekto en bildo kaj kodi ĝiajn atributojn, kiel ekzemple orientiĝo kaj pozicio, en siajn produktaĵvektorojn. Kapsula Retoj povas do administri spacajn interagojn kaj perspektivajn fluktuojn pli bone ol CNNoj.

Kial Ni Elektas Kapsulajn Retojn super CNN-oj?

Kapsula Retoj estas utilaj ĉar ili venkas la malfacilaĵojn de CNN en kaptado de hierarkiaj rilatoj inter eroj en bildo. CNN-oj povas rekoni aferojn de diversaj grandecoj sed luktas por kompreni kiel ĉi tiuj eroj konektas unu al la alia.

Kapsula Retoj, aliflanke, povas lerni rekoni aferojn kaj iliajn pecojn, same kiel kiel ili estas metitaj space en bildon, igante ilin realigebla defianto por komputilvidaj aplikoj.

Areoj de Aplikoj

Kapsula Retoj jam montris esperigajn rezultojn en diversaj aplikoj, inkluzive de bildklasifiko, objektoidentigo kaj bildsegmentado.

Ili estis uzataj por distingi aferojn en medicinaj fotoj, rekoni homojn en filmoj kaj eĉ krei 3D modelojn el 2D bildoj.

Por pliigi ilian efikecon, Capsule Networks estis kombinitaj kun aliaj profundaj lernaj arkitekturoj kiel ekzemple Generative Adversarial Networks (GANoj) kaj Variational Autoencoders (VAEs). Kapsula Retoj estas antaŭdirita ludi ĉiam pli decidan rolon en plibonigado de komputilviziaj teknologioj dum la scienco de profunda lernado evoluas.

Ekzemple; Nibabel estas konata Python-ilo por legi kaj skribi neŭrobildigajn dosiertipojn. Por bildsegmentado, ĝi utiligas Capsule Networks.

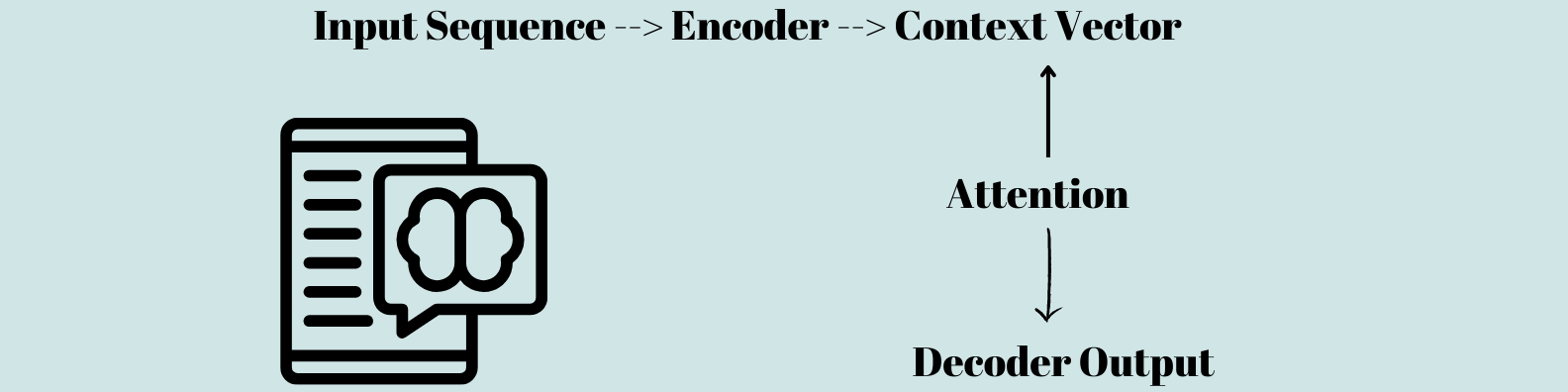

8. Atentobazitaj modeloj

Profundaj lernaj modeloj konataj kiel atento-bazitaj modeloj, ankaŭ konataj kiel atentomekanismoj, klopodas por pliigi la precizecon de modeloj pri maŝinlernado. Ĉi tiuj modeloj funkcias per koncentriĝo pri certaj trajtoj de envenantaj datumoj, rezultigante pli efikan kaj efikan pretigon.

En taskoj pri naturlingva prilaborado kiel maŝintradukado kaj sentanalizo, atentmetodoj montriĝis sufiĉe sukcesaj.

Kio estas Ilia Signifo?

Atent-bazitaj modeloj estas utilaj ĉar ili ebligas pli efikan kaj efikan prilaboradon de komplikaj datumoj.

Tradiciaj neŭralaj retoj taksi ĉiujn enigajn datumojn kiel same gravajn, rezultigante pli malrapidan prilaboradon kaj malpliigitan precizecon. Atentoprocezoj koncentriĝas pri decidaj aspektoj de enigdatenoj, ebligante pli rapidajn kaj pli precizajn prognozojn.

Areoj de Uzado

En la kampo de artefarita inteligenteco, atentomekanismoj havas larĝan gamon de aplikoj, inkluzive de naturlingva prilaborado, bild- kaj sonrekono, kaj eĉ senŝoforaj veturiloj.

Atentometodoj, ekzemple, povas esti uzitaj por plibonigi maŝintradukadon en naturlingva prilaborado permesante al la sistemo temigi certajn vortojn aŭ frazojn kiuj estas esencaj al la kunteksto.

Atentometodoj en aŭtonomiaj aŭtoj povas esti utiligitaj por helpi la sistemon en temigado certajn aĵojn aŭ defiojn en ĝia medio.

9. Transformilo-Retoj

Transformilretoj estas profundaj lernaj modeloj kiuj ekzamenas kaj produktas datensekvencojn. Ili funkcias prilaborante la enirsekvencon unu elementon samtempe kaj produktante produktaĵsekvencon de la sama aŭ malsamaj longoj.

Transformilretoj, male al normaj sekvenco-al-sekvencaj modeloj, ne prilaboras sekvencojn uzantajn ripetiĝantajn neŭralajn retojn (RNNoj). Anstataŭe, ili utiligas mem-atentajn procezojn por lerni la ligilojn inter la pecoj de la sekvenco.

Kio Estas la Graveco de Transformaj Retoj?

Transformilretoj kreskis en populareco en la lastaj jaroj kiel rezulto de sia pli bona efikeco en naturlingvaj pretigaj laborpostenoj.

Ili estas precipe taŭgaj por tekstkreaj taskoj kiel lingvotradukado, tekstsumigo kaj konversacia produktado.

Transformilretoj estas signife pli efikaj kompute ol RNN-bazitaj modeloj, igante ilin preferata elekto por grandskalaj aplikoj.

Kie Vi Povas Trovi Transformilajn Retojn?

Transformilretoj estas vaste utiligitaj en larĝa gamo de aplikoj, plej precipe naturlingva prilaborado.

La serio GPT (Generative Pre-Trained Transformer) estas elstara transformilo-bazita modelo kiu estis utiligita por taskoj kiel ekzemple lingvotraduko, tekstsumigo, kaj babilbotgeneracio.

BERT (Dudirekta Encoder Representations de Transformiloj) estas alia ofta transformil-bazita modelo kiu estis utiligita por naturlingvaj komprenaplikoj kiel ekzemple demanda respondado kaj sentanalizo.

ambaŭ GPT kaj BERT estis kreitaj kun PyTorch, malfermfonta profund-lernada kadro kiu estis populara por evoluigado de transformil-bazitaj modeloj.

10. Restriktitaj Boltzmann-Maŝinoj (RBMoj)

Restricted Boltzmann Machines (RBMs) estas speco de nekontrolita neŭrala reto kiu lernas en genera maniero. Pro ilia kapablo lerni kaj eltiri esencajn trajtojn de altdimensiaj datumoj, ili estis vaste uzataj en la kampoj de maŝinlernado kaj profunda lernado.

RBMoj konsistas el du tavoloj, videblaj kaj kaŝitaj, kie ĉiu tavolo konsistas el grupo de neŭronoj ligitaj per pezbalancitaj randoj. RBMoj estas dizajnitaj por lerni probablodistribuon kiu priskribas la enirdatenojn.

Kio estas Restriktitaj Boltzmann-Maŝinoj?

RBMoj utiligas generan lernan strategion. En RBMoj, la videbla tavolo reflektas la enirdatenojn, dum la entombigita tavolo ĉifras la enirdatenojn karakterizaĵojn. La pezoj de la videblaj kaj kaŝitaj tavoloj montras la forton de sia ligo.

RBMoj ĝustigas la pezojn kaj biasojn inter la tavoloj dum trejnado uzante teknikon konatan kiel kontrasta diverĝo. Kontrasta diverĝo estas nekontrolita lernadstrategio kiu maksimumigas la prognozverŝajnecon de la modelo.

Kio estas la signifo de Restriktitaj Boltzmann-Maŝinoj?

RBMoj estas signifaj en maŝinlernado kaj profunda lernado ĉar ili povas lerni kaj ĉerpi koncernajn trajtojn el grandaj kvantoj da datumoj.

Ili estas tre efikaj por bilda kaj parolrekono, kaj ili estis uzataj en diversaj aplikoj kiel rekomendaj sistemoj, detekto de anomalioj kaj redukto de dimensieco. RBMoj povas trovi ŝablonojn en vastaj datumaroj, rezultigante superajn antaŭdirojn kaj komprenojn.

Kie oni povas uzi Restriktitajn Boltzmann-Maŝinojn?

Aplikoj por RBMoj inkludas dimensiecredukton, anomaliodetekton, kaj rekomendsistemojn. RBM-oj estas precipe helpemaj por sentanalizo kaj temomodelado en la kunteksto de naturlingva prilaborado.

Profundaj kredretoj, speco de neŭrala reto uzita por voĉo kaj bildrekono, ankaŭ utiligas RBMojn. La Profunda Kreda Reto Ilkesto, TensoroFluoKaj Theano estas kelkaj apartaj ekzemploj de programaro aŭ teknologio kiu uzas RBMojn.

Enŝipiĝi

Profunda Lernado-modeloj iĝas pli kaj pli decidaj en diversaj industrioj, inkluzive de parolrekono, naturlingva prilaborado kaj komputila vizio.

Konvoluciaj Neŭralaj Retoj (CNN) kaj Ripetiĝantaj Neŭralaj Retoj (RNN) montris la plej promesojn kaj estas vaste uzataj en multaj aplikoj, tamen ĉiuj Profunda Lernado-modeloj havas siajn avantaĝojn kaj malavantaĝojn.

Tamen, esploristoj ankoraŭ esploras Restricted Boltzmann Machines (RBMs) kaj aliajn variojn de Deep Learning-modeloj ĉar ankaŭ ili havas specialajn avantaĝojn.

Novaj kaj kreivaj modeloj estas antaŭviditaj esti kreitaj dum la areo de profunda lernado daŭre progresas por trakti pli malfacilajn problemojn.

Lasi Respondon