Inhaltsverzeichnis[Ausblenden][Zeigen]

Ich bin sicher, Sie haben schon von künstlicher Intelligenz gehört, sowie von Wörtern wie maschinellem Lernen und Verarbeitung natürlicher Sprache (NLP).

Vor allem, wenn Sie für ein Unternehmen arbeiten, das täglich Hunderte, wenn nicht Tausende von Kundenkontakten bearbeitet.

Die Datenanalyse von Social-Media-Beiträgen, E-Mails, Chats, offenen Umfrageantworten und anderen Quellen ist kein einfacher Prozess und wird noch schwieriger, wenn sie nur Personen anvertraut wird.

Deshalb sind viele Menschen vom Potenzial von begeistert künstliche Intelligenz für ihre tägliche Arbeit und für Unternehmen .

Die KI-gestützte Textanalyse verwendet eine breite Palette von Ansätzen oder Algorithmen, um Sprache organisch zu interpretieren, darunter die Themenanalyse, mit der Themen aus Texten automatisch entdeckt werden.

Unternehmen können Themenanalysemodelle verwenden, um einfache Aufgaben auf Maschinen zu übertragen, anstatt die Mitarbeiter mit zu vielen Daten zu überlasten.

Überlegen Sie, wie viel Zeit Ihr Team sparen und für wichtigere Arbeiten aufwenden könnte, wenn ein Computer jeden Morgen endlose Listen mit Kundenumfragen oder Supportproblemen filtern könnte.

In diesem Leitfaden werden wir uns mit der Themenmodellierung und verschiedenen Methoden der Themenmodellierung befassen und praktische Erfahrungen damit sammeln.

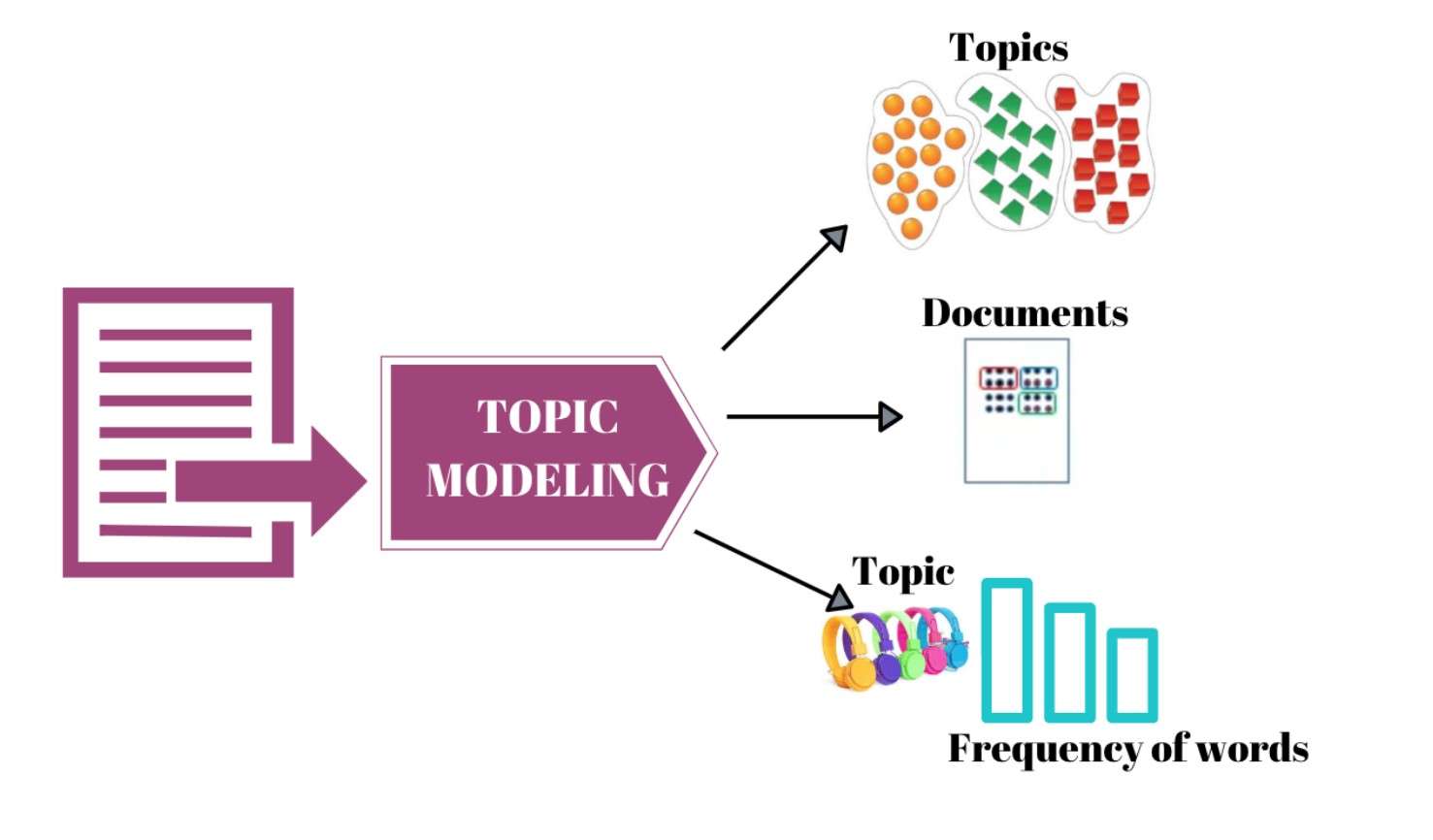

Was ist Themenmodellierung?

Themenmodellierung ist eine Art von Text Mining, bei der unüberwachte und überwachte statistische Maschinelles Lernen Techniken werden verwendet, um Trends in einem Korpus oder einer beträchtlichen Menge an unstrukturiertem Text zu erkennen.

Es kann Ihre riesige Sammlung von Dokumenten verwenden und eine Ähnlichkeitsmethode verwenden, um die Wörter in Begriffsclustern anzuordnen und Themen zu entdecken.

Das scheint ein wenig komplex und schwierig zu sein, also vereinfachen wir das Subjektmodellierungsverfahren!

Angenommen, Sie lesen eine Zeitung mit einem Satz farbiger Textmarker in der Hand.

Ist das nicht altmodisch?

Mir ist klar, dass heutzutage nur noch wenige Menschen gedruckte Zeitungen lesen; alles ist digital und Textmarker gehören der Vergangenheit an! Geben Sie vor, Ihr Vater oder Ihre Mutter zu sein!

Wenn Sie also die Zeitung lesen, heben Sie die wichtigen Begriffe hervor.

Noch eine Vermutung!

Sie verwenden einen anderen Farbton, um die Schlüsselwörter verschiedener Themen hervorzuheben. Sie kategorisieren die Keywords je nach bereitgestellter Farbe und Themen.

Jede Sammlung von Wörtern, die durch eine bestimmte Farbe gekennzeichnet sind, ist eine Liste von Schlüsselwörtern für ein bestimmtes Thema. Die Anzahl der verschiedenen Farben, die Sie ausgewählt haben, zeigt die Anzahl der Themen.

Dies ist die grundlegendste Themenmodellierung. Es hilft beim Verständnis, der Organisation und der Zusammenfassung großer Textsammlungen.

Beachten Sie jedoch, dass automatisierte Themenmodelle viel Inhalt erfordern, um effektiv zu sein. Wenn Sie ein kurzes Papier haben, möchten Sie vielleicht auf die alte Schule gehen und Textmarker verwenden!

Es ist auch von Vorteil, etwas Zeit damit zu verbringen, sich mit den Daten vertraut zu machen. Dadurch erhalten Sie ein grundlegendes Gefühl dafür, was das Themenmodell finden soll.

In diesem Tagebuch kann es beispielsweise um Ihre gegenwärtigen und früheren Beziehungen gehen. Daher würde ich erwarten, dass mein Text-Mining-Roboter-Kumpel auf ähnliche Ideen kommt.

Dies kann Ihnen helfen, die Qualität der von Ihnen identifizierten Themen besser zu analysieren und gegebenenfalls die Keyword-Sets zu optimieren.

Komponenten der Themenmodellierung

Wahrscheinlichkeitsmodell

Zufallsvariablen und Wahrscheinlichkeitsverteilungen werden in die Darstellung eines Ereignisses oder Phänomens in probabilistischen Modellen einbezogen.

Ein deterministisches Modell liefert eine einzige mögliche Schlussfolgerung für ein Ereignis, während ein probabilistisches Modell eine Wahrscheinlichkeitsverteilung als Lösung liefert.

Diese Modelle berücksichtigen die Realität, dass wir selten ein vollständiges Wissen über eine Situation haben. Es gibt fast immer ein Element der Zufälligkeit, das berücksichtigt werden muss.

Zum Beispiel basiert die Lebensversicherung auf der Realität, dass wir wissen, dass wir sterben werden, aber wir wissen nicht, wann. Diese Modelle können teilweise deterministisch, teilweise zufällig oder vollständig zufällig sein.

Informationsabruf

Information Retrieval (IR) ist ein Softwareprogramm, das Informationen aus Dokumentenablagen, insbesondere Textinformationen, organisiert, speichert, abruft und auswertet.

Die Technologie hilft Benutzern, die benötigten Informationen zu finden, liefert jedoch keine eindeutigen Antworten auf ihre Anfragen. Es informiert über das Vorhandensein und den Standort von Papieren, die die erforderlichen Informationen liefern können.

Relevante Dokumente sind diejenigen, die den Bedürfnissen des Benutzers entsprechen. Ein fehlerfreies IR-System gibt nur ausgewählte Dokumente zurück.

Themenkohärenz

Themenkohärenz bewertet ein einzelnes Thema, indem der Grad der semantischen Ähnlichkeit zwischen den Begriffen mit hoher Punktzahl des Themas berechnet wird. Diese Metriken helfen bei der Unterscheidung zwischen Themen, die semantisch interpretierbar sind, und Themen, die statistische Inferenzartefakte sind.

Wenn sich eine Gruppe von Behauptungen oder Tatsachen gegenseitig stützt, werden sie als kohärent bezeichnet.

Folglich kann ein zusammenhängender Faktensatz in einem Kontext verstanden werden, der alle oder die Mehrheit der Fakten umfasst. „Das Spiel ist ein Mannschaftssport“, „Das Spiel wird mit einem Ball gespielt“ und „Das Spiel erfordert enorme körperliche Anstrengung“ sind alles Beispiele für zusammenhängende Tatsachensätze.

Verschiedene Methoden der Themenmodellierung

Dieses kritische Verfahren kann durch eine Vielzahl von Algorithmen oder Methoden ausgeführt werden. Darunter sind:

- Latente Dirichlet-Allokation (LDA)

- Nicht negative Matrixfaktorisierung (NMF)

- Latente semantische Analyse (LSA)

- Probabilistische latente semantische Analyse (pLSA)

Latente Dirichlet-Zuordnung (LDA)

Um Beziehungen zwischen mehreren Texten in einem Korpus zu erkennen, wird das statistische und grafische Konzept der Latent Dirichlet Allocation verwendet.

Unter Verwendung des Variational Exception Maximization (VEM)-Ansatzes wird die größte Wahrscheinlichkeitsschätzung aus dem gesamten Textkorpus erreicht.

Traditionell werden die obersten paar Wörter aus einer Menge Wörter ausgewählt.

Der Satz ist jedoch völlig sinnlos.

Gemäß dieser Technik wird jeder Text durch eine probabilistische Verteilung von Themen dargestellt und jedes Thema durch eine probabilistische Verteilung von Wörtern.

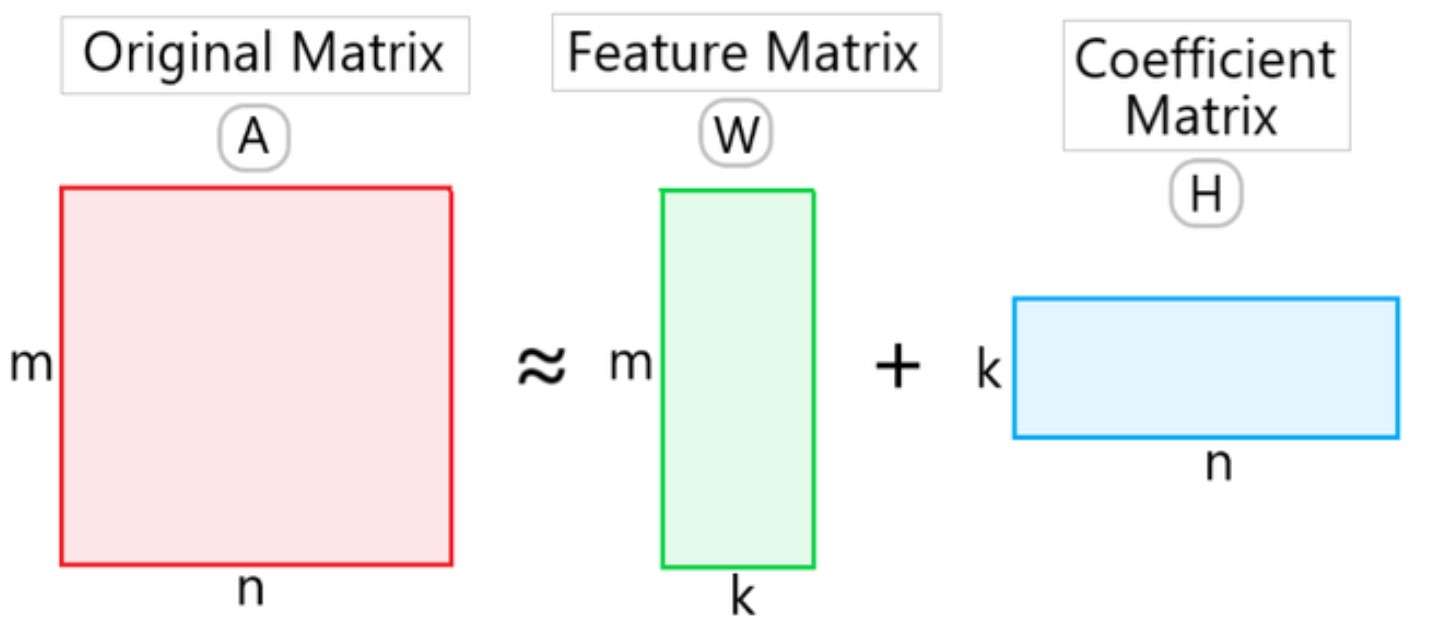

Nicht negative Matrixfaktorisierung (NMF)

Matrix with Non-Negative Values Factorization ist ein hochmoderner Ansatz zur Merkmalsextraktion.

Wenn es viele Qualitäten gibt und die Attribute vage oder schlecht vorhersagbar sind, ist NMF von Vorteil. NMF kann durch die Kombination von Merkmalen signifikante Muster, Themen oder Themen generieren.

NMF generiert jedes Feature als lineare Kombination des ursprünglichen Attributsatzes.

Jedes Feature enthält eine Reihe von Koeffizienten, die die Wichtigkeit jedes Attributs für das Feature darstellen. Jedes numerische Attribut und jeder Wert jedes Kategorieattributs hat seinen eigenen Koeffizienten.

Alle Koeffizienten sind positiv.

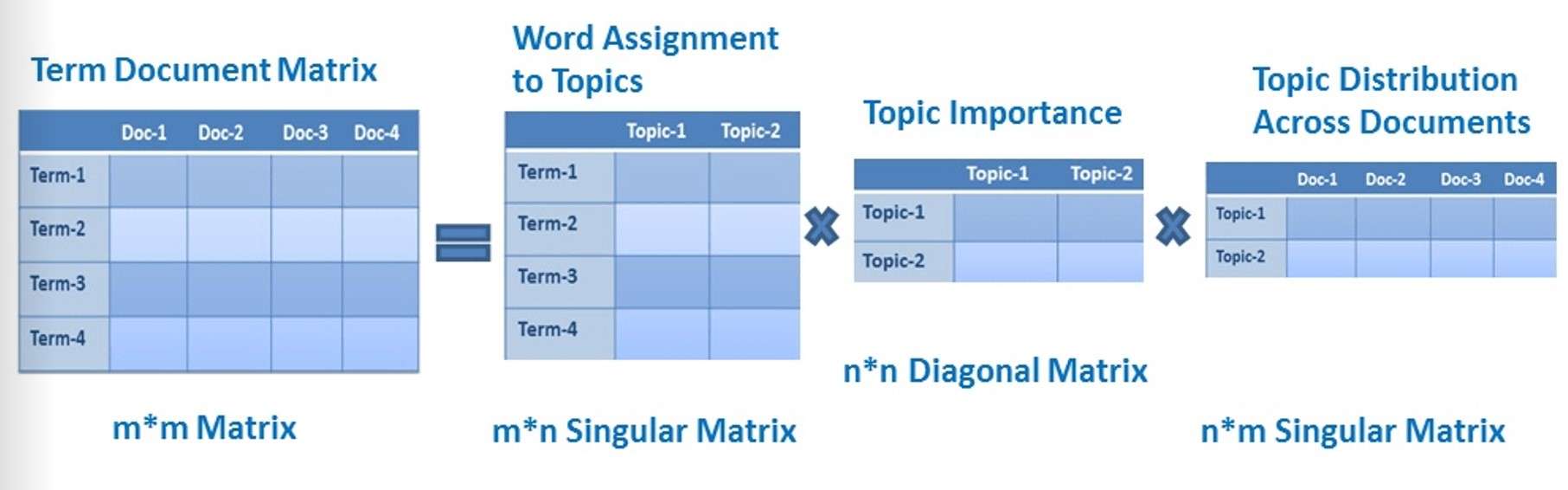

Latente semantische Analyse

Eine weitere unbeaufsichtigte Lernmethode, die verwendet wird, um Assoziationen zwischen Wörtern in einer Reihe von Dokumenten zu extrahieren, ist die latente semantische Analyse.

Dies hilft uns bei der Auswahl der richtigen Dokumente. Seine Hauptfunktion besteht darin, die Dimensionalität des enormen Korpus von Textdaten zu reduzieren.

Diese unnötigen Daten dienen als Hintergrundrauschen, um die notwendigen Erkenntnisse aus den Daten zu gewinnen.

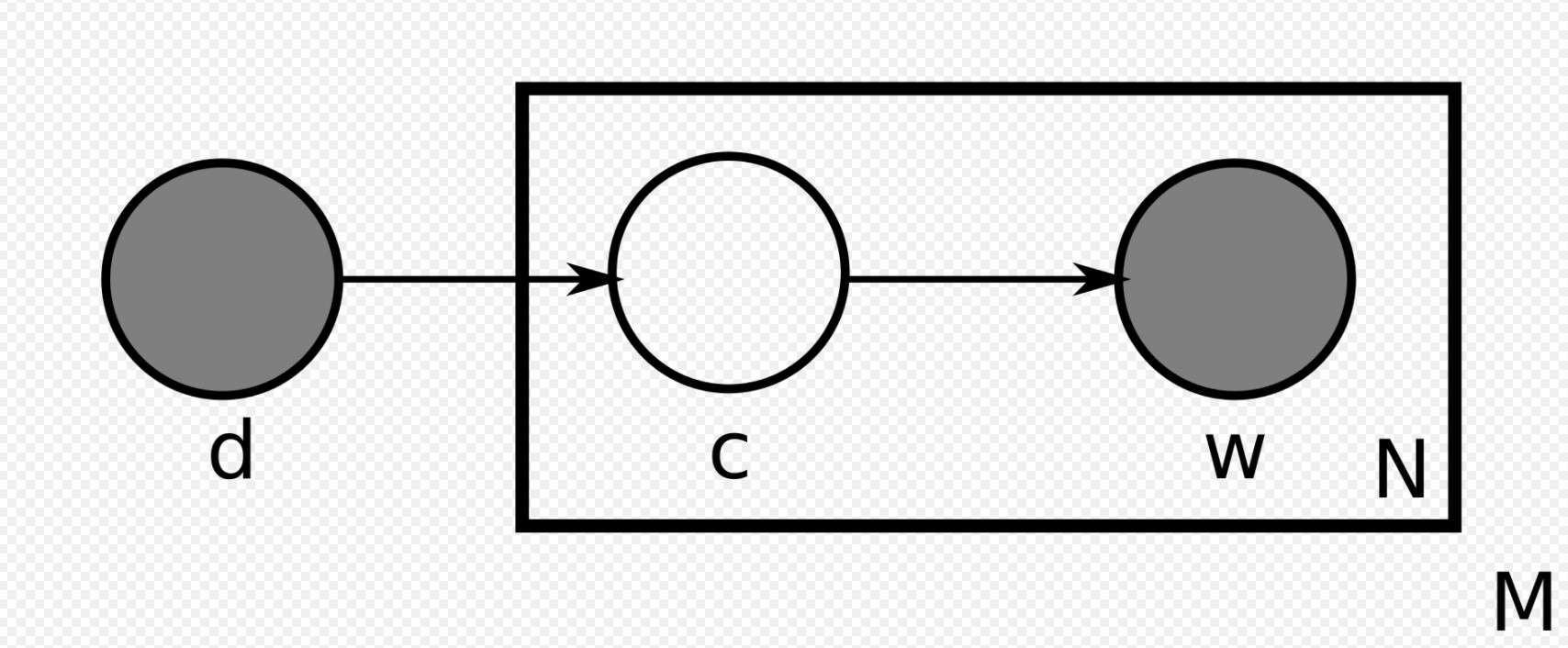

Probabilistische latente semantische Analyse (pLSA)

Die probabilistische latente semantische Analyse (PLSA), manchmal bekannt als probabilistische latente semantische Indizierung (PLSI), insbesondere in Kreisen zur Informationsabfrage, ist ein statistischer Ansatz zur Analyse von Zwei-Modus- und Kookkurrenzdaten.

Tatsächlich kann, ähnlich wie bei der latenten semantischen Analyse, aus der PLSA hervorgegangen ist, eine niederdimensionale Repräsentation der beobachteten Variablen hinsichtlich ihrer Affinität zu bestimmten verborgenen Variablen abgeleitet werden.

Praktisches Arbeiten mit der Themenmodellierung in Python

Jetzt führe ich Sie durch eine Subjektmodellierungsaufgabe mit Python Programmiersprache anhand eines realen Beispiels.

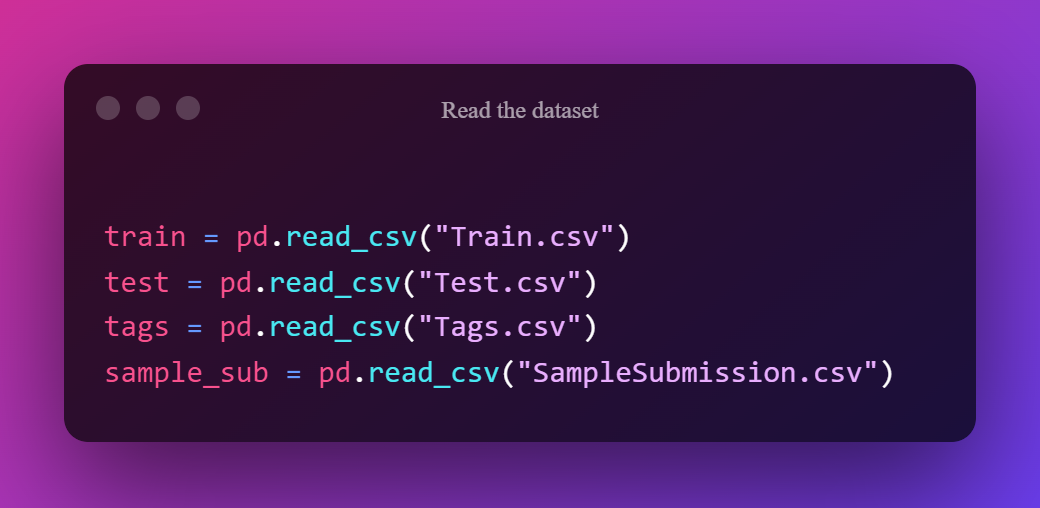

Ich werde Forschungsartikel modellieren. Der Datensatz, den ich hier verwenden werde, stammt von kaggle.com. Sie können alle Dateien, die ich in dieser Arbeit verwende, ganz einfach von dort erhalten Seite.

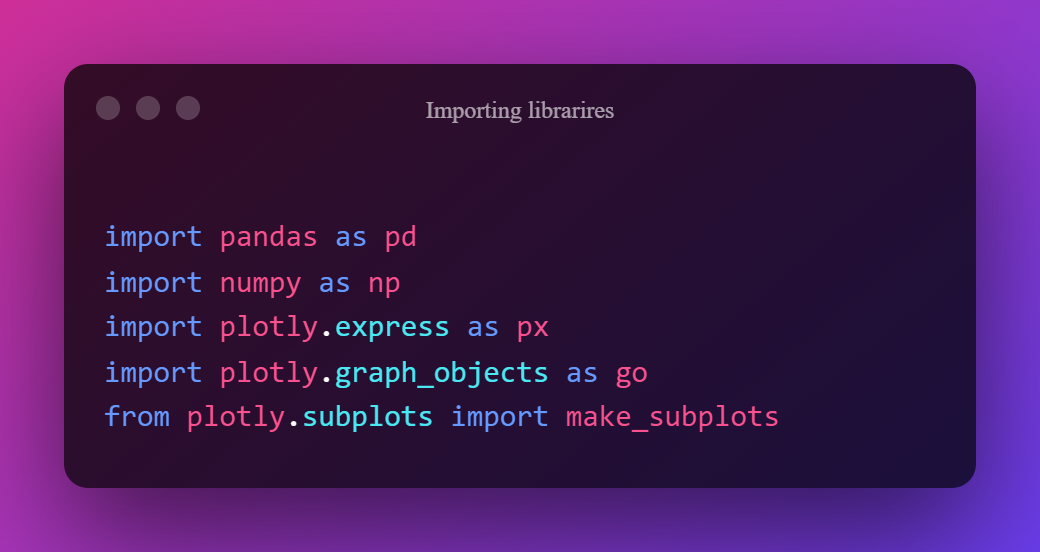

Beginnen wir mit der Themenmodellierung mit Python, indem wir alle wesentlichen Bibliotheken importieren:

Der folgende Schritt besteht darin, alle Datensätze zu lesen, die ich in dieser Aufgabe verwenden werde:

Explorative Datenanalyse

EDA (Exploratory Data Analysis) ist eine statistische Methode, die visuelle Elemente verwendet. Es verwendet statistische Zusammenfassungen und grafische Darstellungen, um Trends, Muster und Testannahmen zu erkennen.

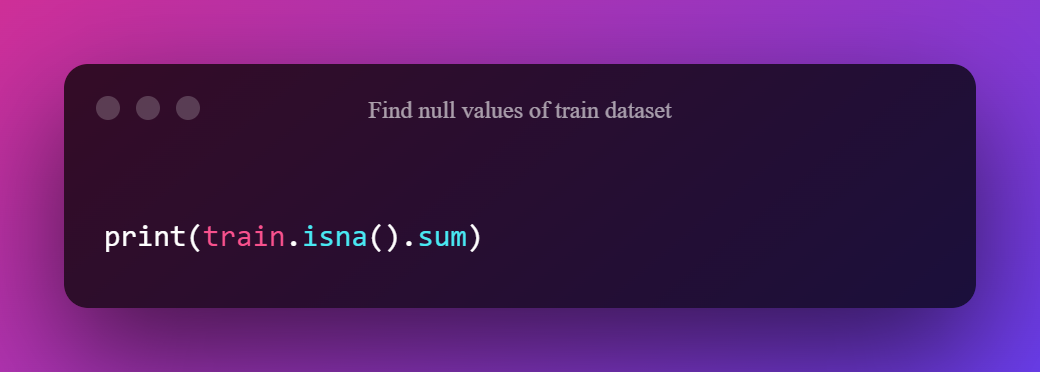

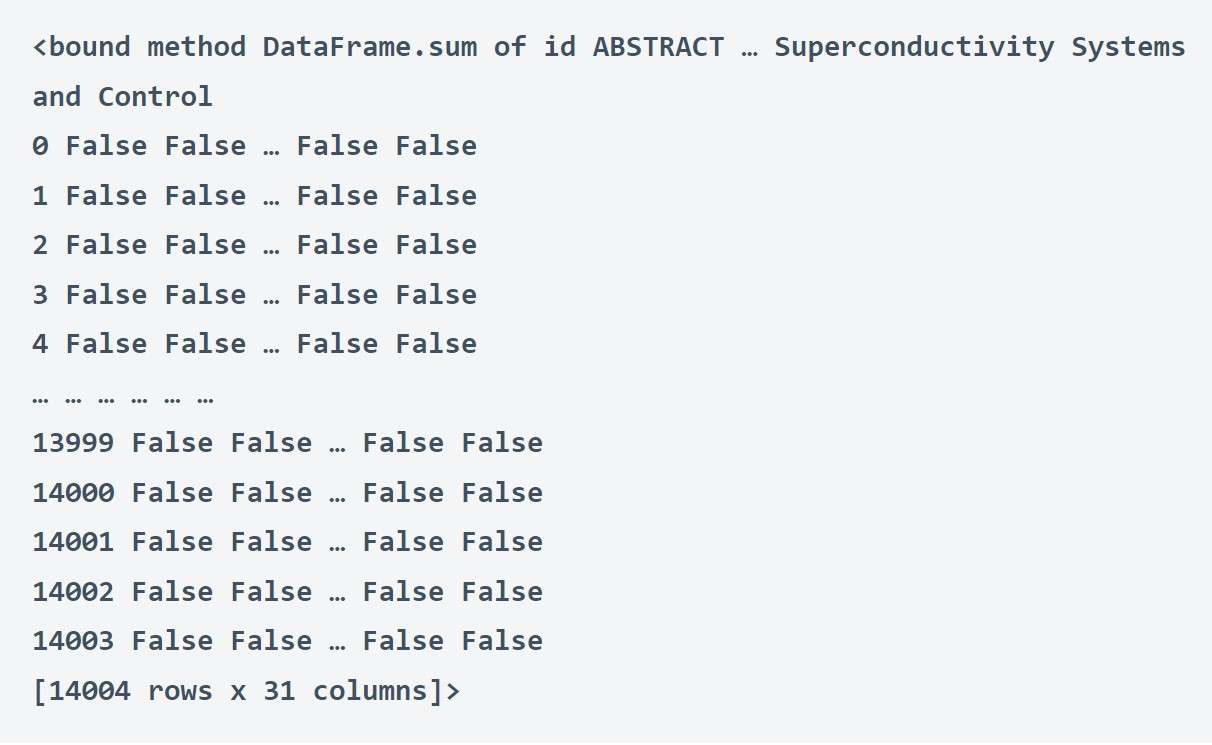

Ich werde eine explorative Datenanalyse durchführen, bevor ich mit der Themenmodellierung beginne, um zu sehen, ob es Muster oder Beziehungen in den Daten gibt:

Jetzt finden wir die Nullwerte des Testdatensatzes:

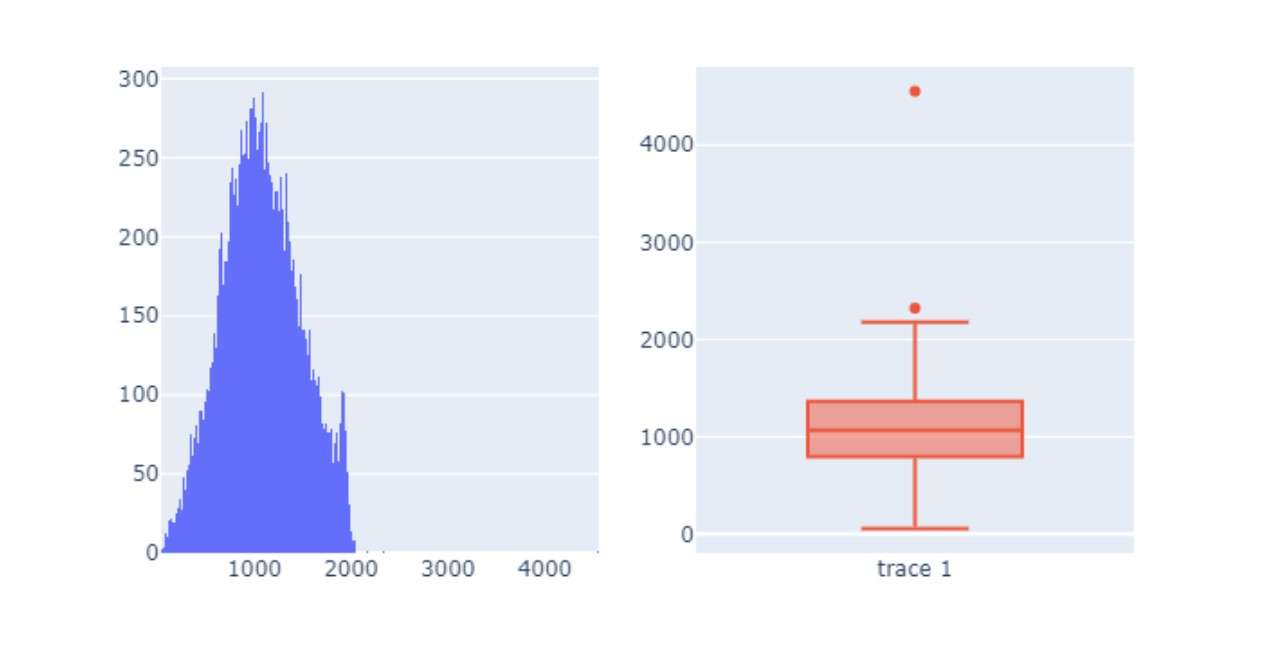

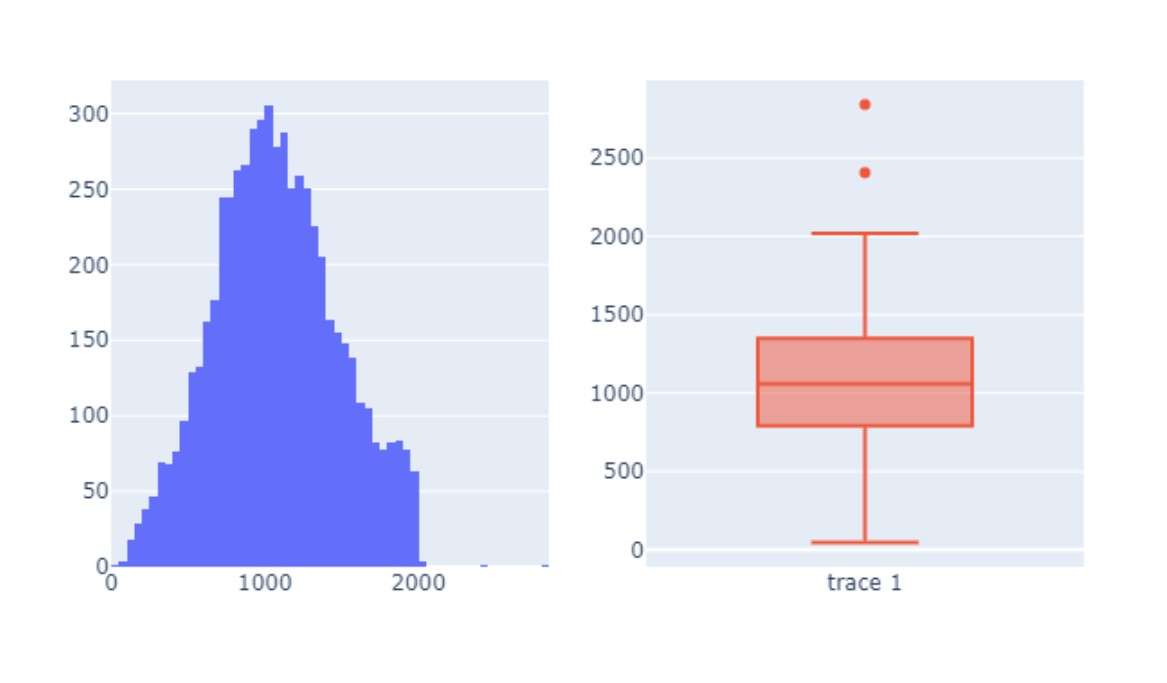

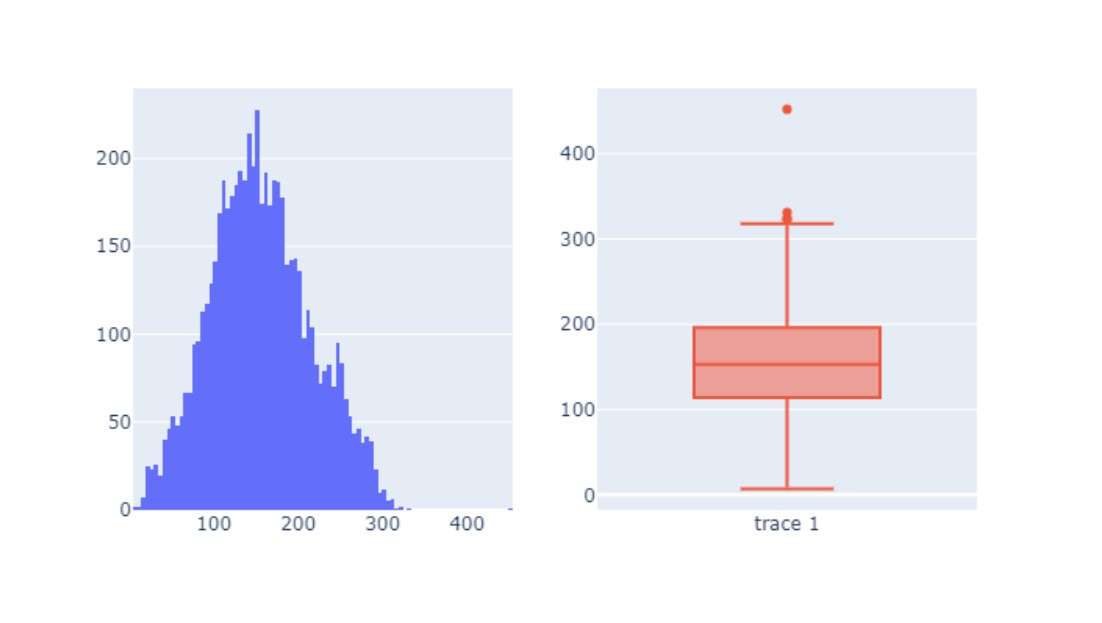

Jetzt werde ich ein Histogramm und einen Boxplot zeichnen, um die Beziehung zwischen den Variablen zu überprüfen.

Die Anzahl der Zeichen im Abstracts of the Train-Set ist sehr unterschiedlich.

Im Zug haben wir mindestens 54 und maximal 4551 Zeichen. 1065 ist die durchschnittliche Zeichenanzahl.

Der Testsatz scheint interessanter zu sein als der Trainingssatz, da der Testsatz 46 Zeichen hat, während der Trainingssatz 2841 hat.

Als Ergebnis hatte der Testsatz einen Median von 1058 Zeichen, was dem Trainingssatz ähnlich ist.

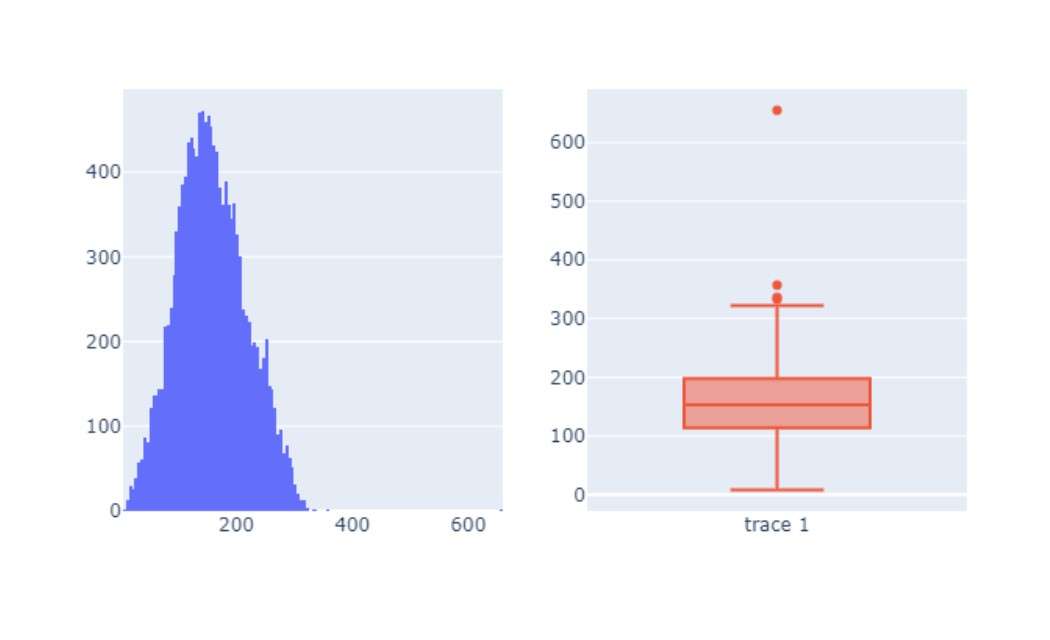

Die Anzahl der Wörter im Lernsatz folgt einem ähnlichen Muster wie die Anzahl der Buchstaben.

Erlaubt sind mindestens 8 Wörter und maximal 665 Wörter. Als Ergebnis beträgt die mittlere Wortzahl 153.

Mindestens sieben Wörter im Abstract und maximal 452 Wörter im Testsatz sind erforderlich.

Der Median beträgt in diesem Fall 153, was mit dem Median im Trainingssatz identisch ist.

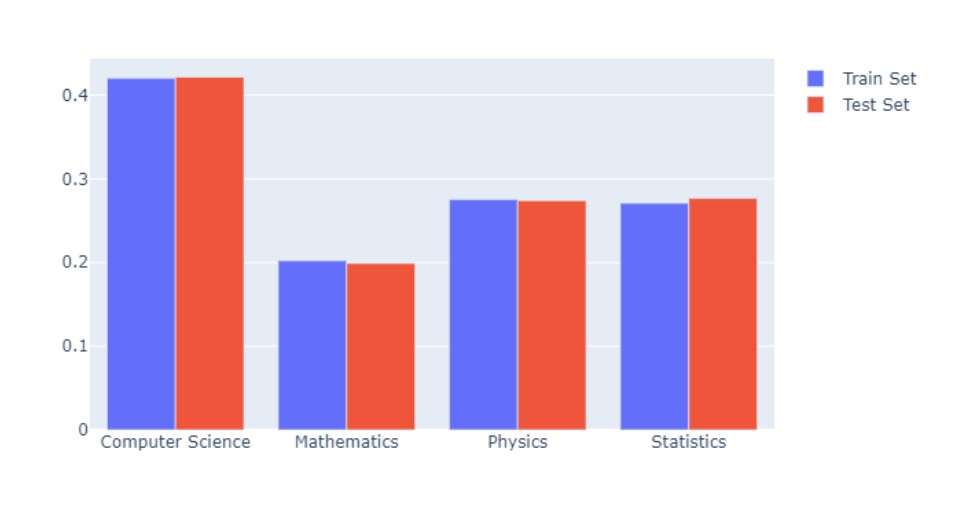

Verwenden von Tags für die Themenmodellierung

Es gibt mehrere Themenmodellierungsstrategien. Ich werde in dieser Übung Tags verwenden; Schauen wir uns an, wie das geht, indem wir die Tags untersuchen:

Anwendungen der Themenmodellierung

- Eine Textzusammenfassung kann verwendet werden, um das Thema eines Dokuments oder Buchs zu erkennen.

- Es kann verwendet werden, um Kandidatenvoreingenommenheit aus der Prüfungsbewertung zu entfernen.

- Die Themenmodellierung könnte verwendet werden, um semantische Beziehungen zwischen Wörtern in graphbasierten Modellen aufzubauen.

- Es kann den Kundenservice verbessern, indem Schlüsselwörter in der Anfrage des Kunden erkannt und beantwortet werden. Die Kunden haben mehr Vertrauen in Sie, da Sie ihnen im richtigen Moment die erforderliche Unterstützung zukommen lassen, ohne ihnen Probleme zu bereiten. Dadurch steigt die Kundenloyalität dramatisch an und der Wert des Unternehmens steigt.

Zusammenfassung

Themenmodellierung ist eine Art statistische Modellierung, die verwendet wird, um abstrakte „Themen“ aufzudecken, die in einer Sammlung von Texten existieren.

Es ist eine Form des statistischen Modells, das in verwendet wird Maschinelles Lernen und Verarbeitung natürlicher Sprache, um abstrakte Konzepte aufzudecken, die in einer Menge von Texten existieren.

Es ist eine Text-Mining-Methode, die weit verbreitet ist, um latente semantische Muster im Fließtext zu finden.

Hinterlassen Sie uns einen Kommentar