Inhaltsverzeichnis[Ausblenden][Zeigen]

Große Sprachmodelle gehören zu den beeindruckendsten jüngsten Entwicklungen auf dem Gebiet der Programmierung natürlicher Sprache und neuronaler Netze.

GPT-3 von OpenAI sticht als eines der leistungsstärksten Modelle heraus. Die Ausgabe des Modells ist oft nicht von Text zu unterscheiden, der von Menschen stammt.

GPT-3 ist jedoch immer noch ein Closed-Source-Modell. Obwohl es unglaublich leistungsfähig ist, gibt es bestimmte Einschränkungen, die es für bestimmte Anwendungsfälle ungeeignet machen könnten.

In diesem Artikel gehen wir auf einige große ein Sprachmodelle die mit der rohen Leistung von GPT-3 mithalten kann.

Warum nach einer OpenAI GPT-3-Alternative suchen?

Das GPT-3-Modell von OpenAI verwendet Advanced tiefe Lernen Modelle, um menschenähnlichen Text zu produzieren. Es ist das Sprachvorhersagemodell der dritten Generation aus dem Forschungslabor von OpenAI.

Das Modell wurde zunächst als geschlossene Beta veröffentlicht, bevor OpenAI die API schließlich Ende 2021 für die Öffentlichkeit öffnete.

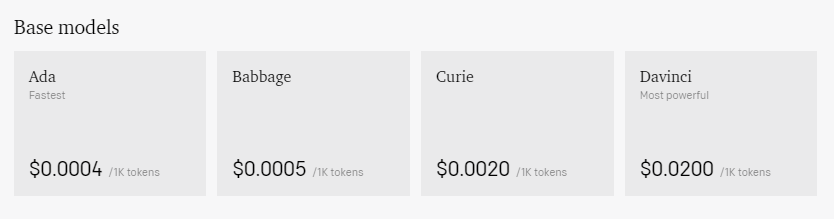

Derzeit hat GPT-3 vier Basismodelle zur Auswahl. Ada, das billigste und schnellste Modell, kostet nur 0.0004 $ pro 1000 Token. Das leistungsstärkste Modell von OpenAI, Davinci, kostet 0.02 $ pro 1000 Token oder ist etwa 50-mal teurer.

OpenAI erfordert auch, dass der Entwickler seinen eigenen folgt Nutzungsrichtlinien. Der Entwickler stellt außerdem ein begrenztes Nutzungskontingent zur Verfügung, das erhöht werden kann, sobald die Bewerbung des Entwicklers durch einen manuellen Überprüfungsprozess genehmigt wurde.

Obwohl die GPT-3-Ausgabe für ihre hochwertige Ausgabe bekannt ist, ist sie nicht das einzige Sprachvorhersagemodell, das Ihnen zur Verfügung steht.

Lassen Sie uns einige konkurrierende Modelle durchgehen, die Sie als Alternative zu GPT-3 verwenden können.

1. GPT-J

GPT-J ist ein Open-Source-Sprachmodell der Eleuther AI-Gruppe.

Die Zero-Shot-Leistung ist in etwa gleichauf mit GPT-3 und liegt viel näher an der Leistung als viele andere GPT-Implementierungen.

Das autoregressive Textgenerierungsmodell mit 6 Milliarden Parametern wurde mit einem Datensatz trainiert, der als „The Pile“ bekannt ist.

Der Stapel ist eigentlich eine Kombination aus 22 kleineren Datensätzen, die miteinander kombiniert werden. Es hat eine kombinierte Dateigröße von 825 GiB und es wurde beobachtet, dass es einen größeren Schwerpunkt auf akademische und professionelle Quellen legt.

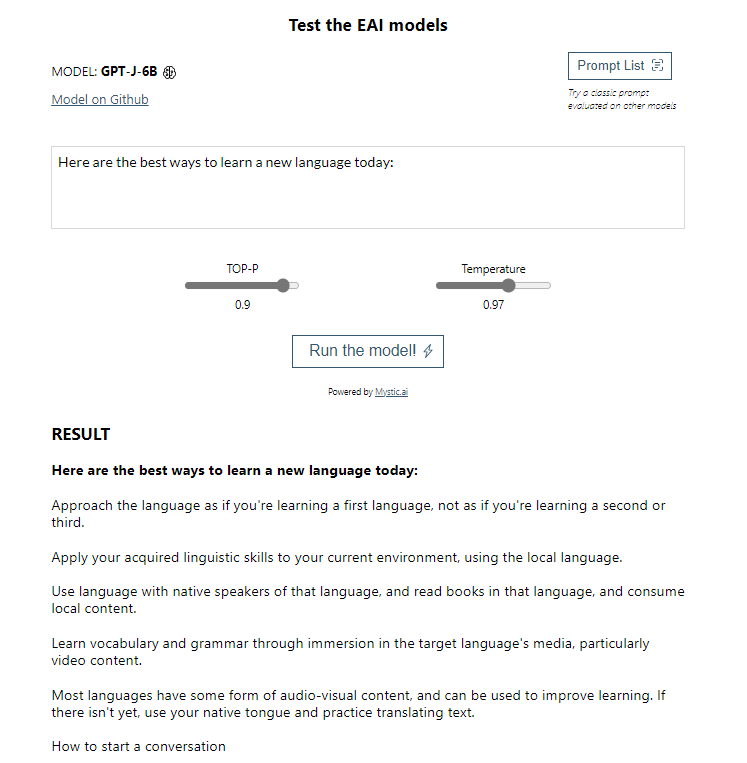

So können Sie das Modell selbst testen kostenlose Webanwendung.

Ich konnte das Modell mit einer einfachen Eingabeaufforderung testen. GPT-J ist es gelungen, die „besten Möglichkeiten, heute eine neue Sprache zu lernen“ aufzuzählen.

Die Leistung ist jedoch etwas lückenhaft, als ich versuchte, sie zu fragen, um zu erklären, was ein autoregressives Textgenerierungsmodell war.

Die Ausgabe machte zwar Sinn, beantwortete die Eingabeaufforderung jedoch nicht sinnvoll.

AnzeigenPreise

Da es sich bei GPT-J um ein Open-Source-Modell handelt, könnten Sie tatsächlich Ihre eigene Instanz selbst ausführen. Laut dem offizielles Repositoryist das Modell für die Ausführung auf einer Tensor Processing Unit (TPU) ausgelegt. Dies ist zwar optimal, aber möglicherweise nicht die kostengünstigste Option, da die von Google am günstigsten ist Cloud-TPUs kosten etwa 4.50 $/Stunde.

Auf lange Sicht kann es günstiger sein, eine eigene GPU zu verwenden oder einen dedizierten GPU-Server über Dienste wie zu mieten Vast.ai or FluidStack.

2. Jura-1

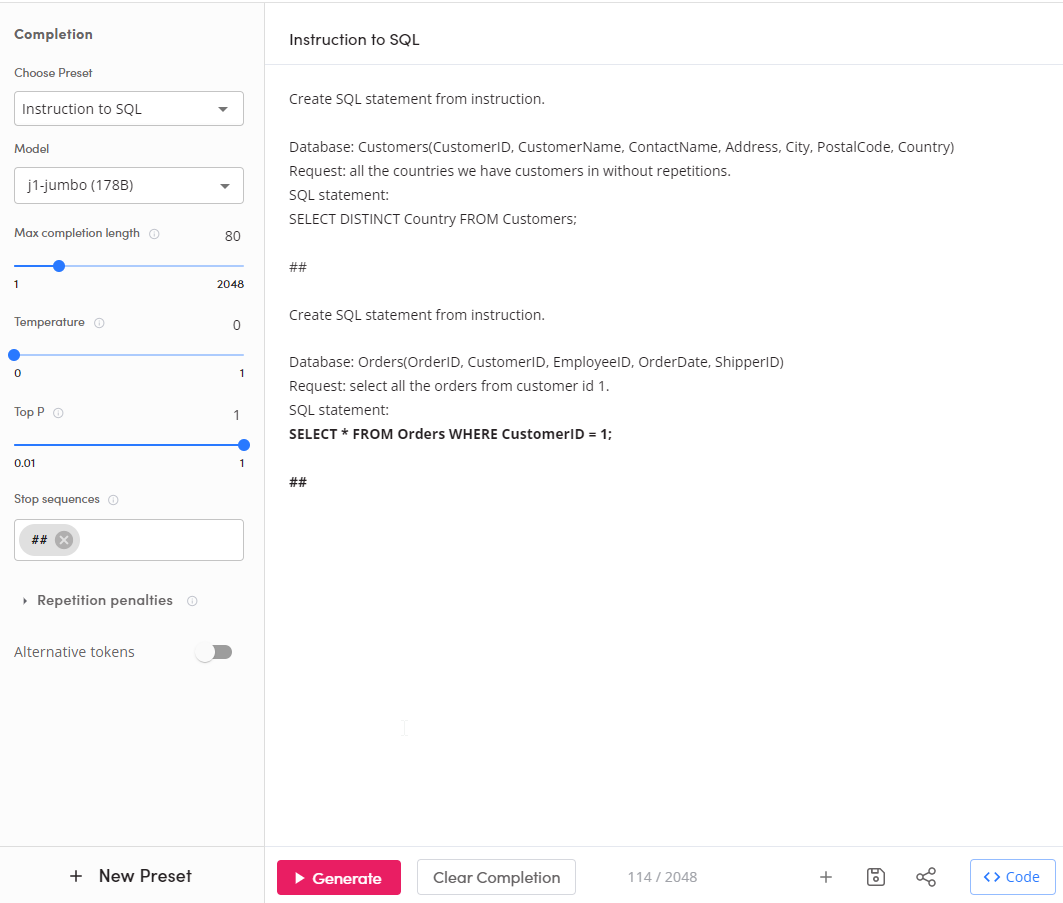

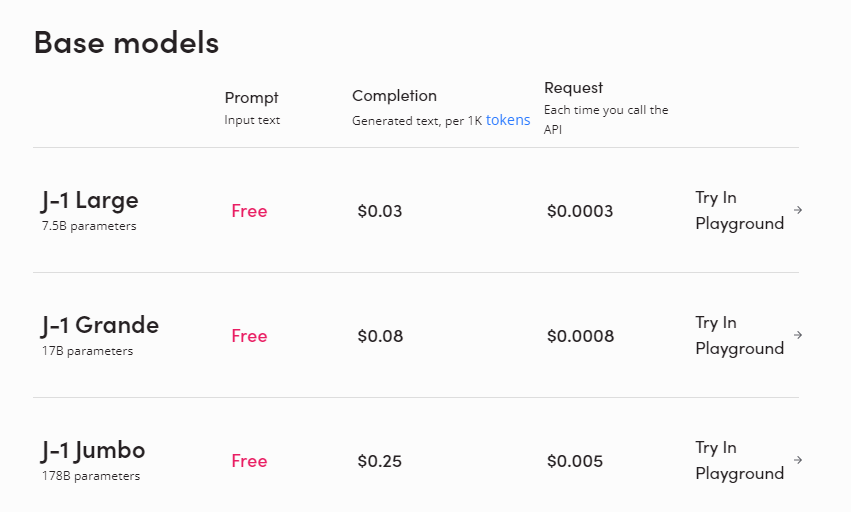

Jurassic-1 ist ein Sprachmodell, das von AI21 Labs veröffentlicht wurde, einem israelischen KI-Unternehmen, das sich auf NLP spezialisiert hat. Wie OpenAI bieten sie auch eine API an, mit der Sie auf ihr Sprachmodell zugreifen können.

Sie können dort ein Konto erstellen Website um auf eine Playground-Web-App zuzugreifen und das Modell selbst zu testen.

Das AI21 Studio enthält auch eine Funktion, mit der Sie Ihre eigenen benutzerdefinierten Versionen ihrer Jurassic-1-Modelle trainieren und abfragen können. Laut einer offizieller Blogbeitrag, benutzerdefinierte Modelle mit nur fünfzig Beispielen können die prompte Konstruktion mit dem Originalmodell übertreffen.

AnzeigenPreise

Sie bieten flexible nutzungsbasierte Preise für jedes ihrer drei Basismodelle. Beispielsweise berechnen sie 0.25 USD für jeweils 1000 vom Modell generierte Token. Im Durchschnitt besteht jedes Token aus ungefähr 1 Wort oder sechs Zeichen.

Das bedeutet, dass Sie das beste Modell von AI21 verwenden können, um ein Dokument mit 4000 Wörtern für nur 1 US-Dollar zu erstellen. Eine Sache, die Sie jedoch beachten müssen, ist, dass Sie immer noch jeden Monat mindestens 29 US-Dollar bezahlen müssen, um das Modell zu nutzen.

3. TextSynth

TextSynth ist ein weiterer NLP-Webdienst, mit dem Sie Text generieren können. Im Gegensatz zu den beiden vorherigen Beispielen ist TextSynth kein eigenständiges Modell. Der Dienst funktioniert, indem er dem Benutzer Zugriff auf verschiedene andere große Open-Source-Sprachmodelle wie GPT-NeoX, M2M100 und sogar GPT-J gibt.

Entwickler können ihre verwenden REST API die Sprachmodelle in eigene Anwendungen zu integrieren. Sie können versuchen, sie kostenlos auszuprobieren Spielplatz Seite um zu sehen, wie jedes verfügbare Modell funktioniert.

AnzeigenPreise

Ihr kostenloser Plan gibt Ihnen Zugriff auf alle ihre Sprachmodelle mit einigen Ratenbegrenzungen. Der Dienst beschränkt jede Anfrage auf eine Länge von 200 Token.

Der Standardplan hebt die Begrenzung der Anzahl der generierten Token auf. Das Preismodell ist kreditbasiert, um unerwartete Ausgaben zu vermeiden. Die Mindestanzahl an zu erwerbenden Credits beträgt 20 $. Ungenutzte Credits verfallen nach einem Jahr.

Der Preis jeder Anfrage basiert auf der Anzahl der eingegebenen und generierten Token. Basierend auf der Tabelle auf ihrer offiziellen Website können Sie damit rechnen, etwa 0.75 bis 1.25 US-Dollar für die Verwendung ihrer billigeren Modelle zu zahlen.

Zusammenfassung

Hoffentlich kann Ihnen dieser Artikel helfen, ein erschwingliches und effektives Sprachmodell zu finden, das Sie als verwenden können OpenAI GPT-3-Alternative.

Große Sprachmodelle sind sehr leistungsfähig und können für eine Vielzahl von Aufgaben verwendet werden. Sie können verwendet werden, um Text zu generieren, zwischen Sprachen zu übersetzen und natürliche Sprache zu verstehen und darauf zu reagieren.

Basierend auf meinen Forschungen im Weltraum und den von mir durchgeführten Tests übertrifft GPT-3 immer noch alle anderen großes Sprachmodell Ich habe es versucht. Dies könnte sich jedoch in Zukunft ändern, wenn Forscher neue Modelle entwickeln und veröffentlichen.

Forscher bei Google, Facebook und anderen KI-Laboren werden weiterhin an der Weiterentwicklung ihrer eigenen LMMs arbeiten. Es ist durchaus möglich, dass eines dieser KI-Teams ein Modell herausbringt, das GPT-3 überlegen ist.

Hinterlassen Sie uns einen Kommentar