Indholdsfortegnelse[Skjule][At vise]

Et af de primære kriterier for enhver form for virksomhedsaktivitet er effektiv udnyttelse af information. På et tidspunkt overstiger mængden af oprettede data kapaciteten af grundlæggende behandling.

Det er her, maskinlæringsalgoritmer kommer i spil. Men før noget af dette kan ske, skal informationen studeres og fortolkes. I en nøddeskal er det, hvad uovervåget maskinlæring bruges til.

I denne artikel vil vi undersøge dybtgående uovervåget maskinlæring, herunder dens algoritmer, use cases og meget mere.

Hvad er uovervåget maskinlæring?

Uovervågede maskinlæringsalgoritmer identificerer mønstre i et datasæt, der ikke har en kendt eller mærket konsekvens. Overvåget maskinlæringsalgoritmer have et mærket output.

At kende denne sondring hjælper dig med at forstå, hvorfor uovervågede maskinlæringsmetoder ikke kan bruges til at løse regressions- eller klassifikationsproblemer, da du ikke ved, hvad værdien/svaret for outputdataene kan være. Du kan ikke træne en algoritme normalt, hvis du ikke kender værdien/svaret.

Desuden kan uovervåget læring bruges til at identificere dataens grundlæggende struktur. Disse algoritmer registrerer skjulte mønstre eller datagrupperinger uden behov for menneskelig interaktion.

Dens evne til at opdage ligheder og kontraster i information gør den til et godt valg til undersøgende dataanalyse, krydssalgsteknikker, forbrugersegmentering og billedidentifikation.

Overvej følgende scenarie: du er i en købmand og ser en uidentificeret frugt, som du aldrig har set før. Du kan let skelne den ukendte frugt forskellig fra andre frugter rundt omkring baseret på dine observationer af dens form, størrelse eller farve.

Uovervågede Machine Learning-algoritmer

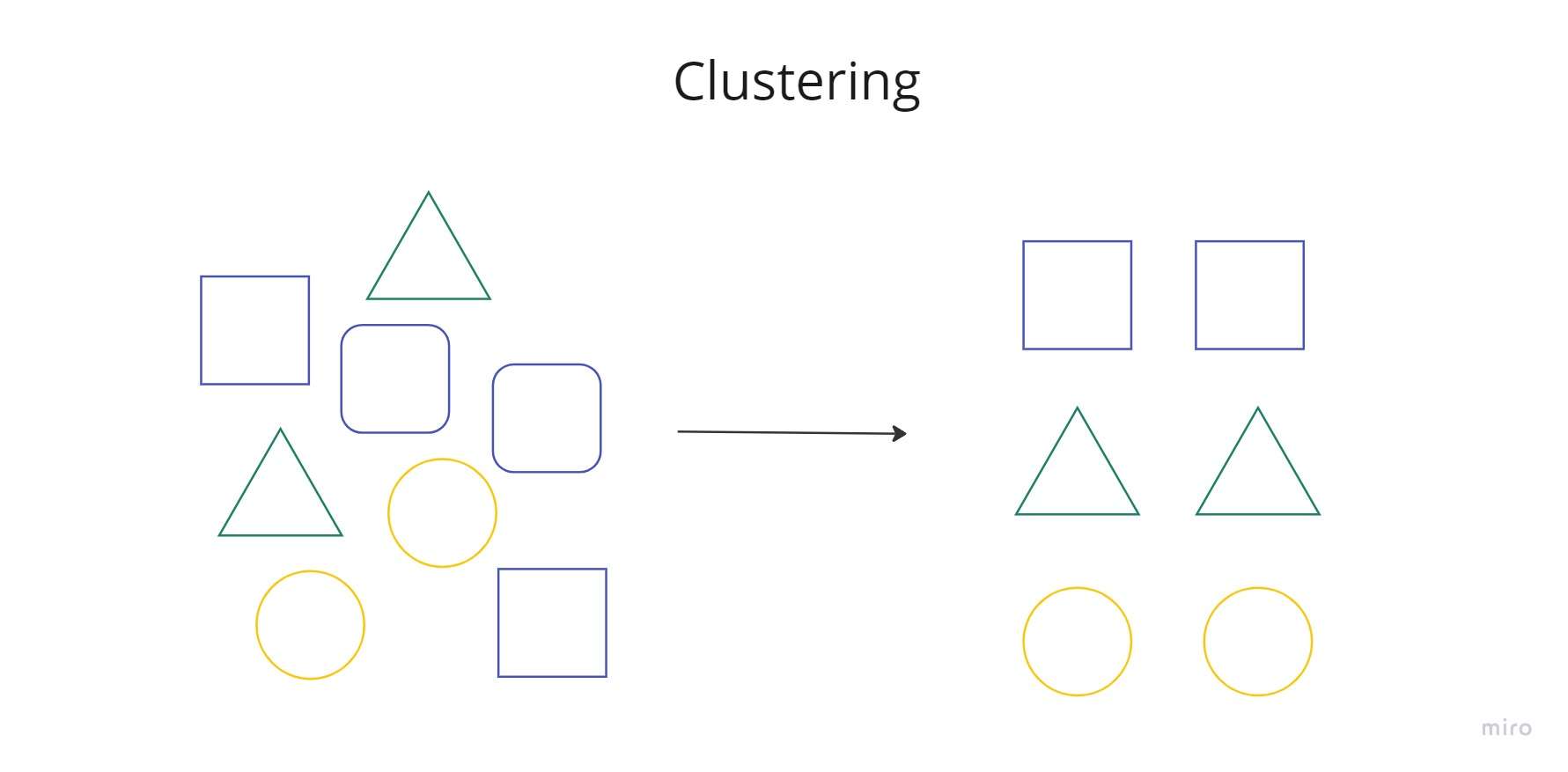

klyngedannelse

Clustering er uden tvivl den mest udbredte tilgang til uovervåget læring. Denne tilgang sætter relaterede dataelementer i tilfældigt genererede klynger.

I sig selv opdager en ML-model alle mønstre, ligheder og/eller forskelle i en ukategoriseret datastruktur. En model vil være i stand til at opdage alle naturlige grupperinger eller klasser i data.

Typer

Der er flere former for clustering, der kan bruges. Lad os først se på de vigtigste.

- Eksklusiv klyngedannelse, nogle gange kendt som "hård" klyngedannelse, er en type gruppering, hvor et enkelt stykke data tilhører kun en klynge.

- Overlappende klyngedannelse, ofte kendt som "blød" klyngedannelse, tillader dataobjekter at tilhøre mere end én klynge i forskellig grad. Desuden kan probabilistisk clustering bruges til at tackle "bløde" clustering- eller tæthedsestimeringsproblemer samt til at vurdere sandsynligheden eller sandsynligheden for datapunkter, der tilhører bestemte klynger.

- Oprettelse af et hierarki af grupperede dataelementer er målet med hierarkisk klyngedannelse, som navnet indikerer. Dataelementer dekonstrueres eller kombineres baseret på hierarkiet for at generere klynger.

Brug sager:

- Anomali detektion:

Enhver type af afvigelser i data kan detekteres ved hjælp af klyngedannelse. Virksomheder inden for transport og logistik kan for eksempel bruge anomalidetektion til at opdage logistiske hindringer eller afsløre beskadigede mekaniske dele (forudsigende vedligeholdelse).

Finansielle institutioner kan bruge teknologien til at opdage svigagtige transaktioner og reagere hurtigt, hvilket potentielt kan spare mange penge. Lær mere om at opdage abnormiteter og svindel ved at se vores video.

- Segmentering af kunder og markeder:

Klyngealgoritmer kan hjælpe med at gruppere personer, der har lignende egenskaber, og skabe forbrugerpersonas til mere effektiv markedsføring og målrettede initiativer.

K-midler

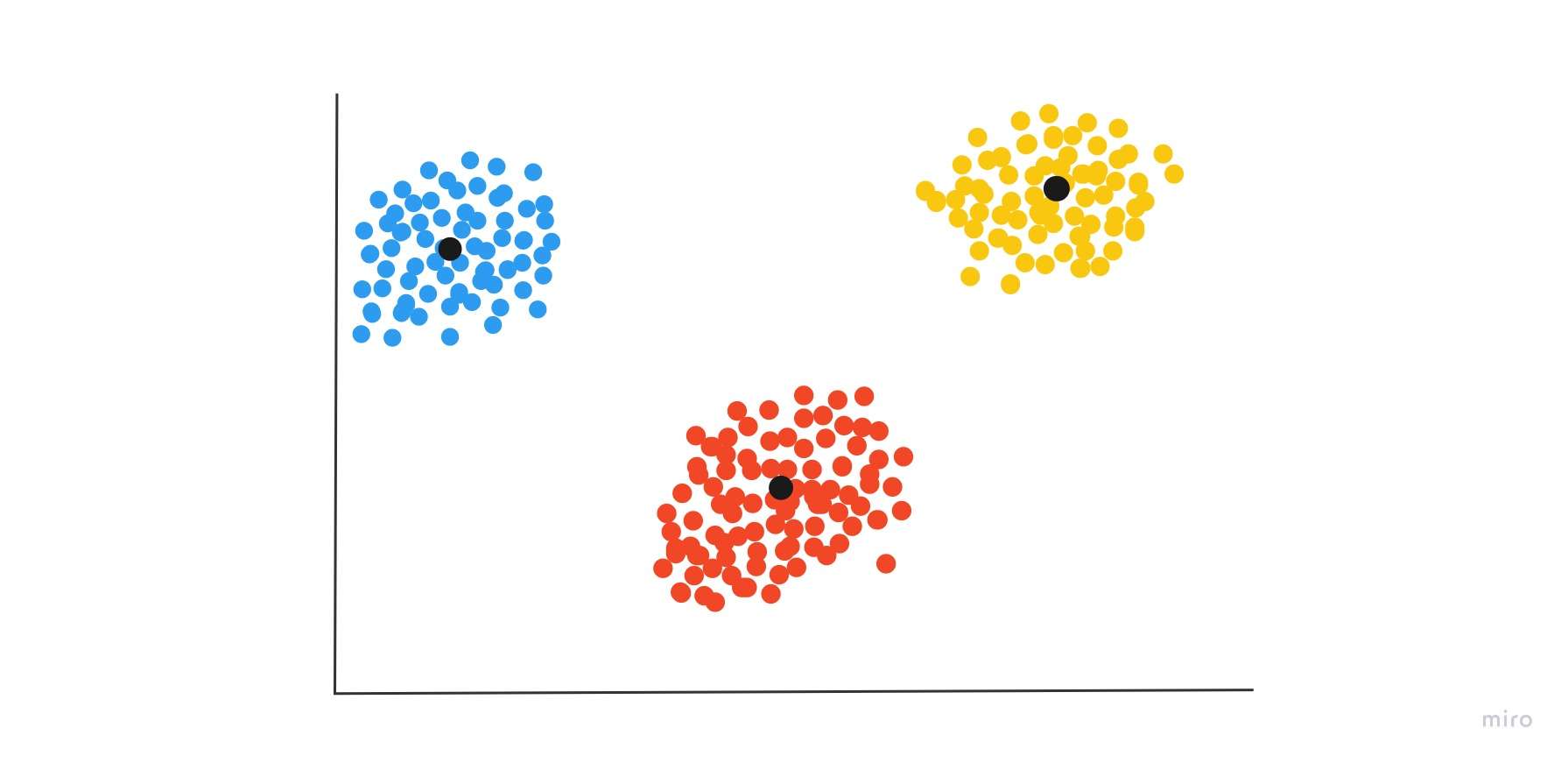

K-means er en klyngemetode, der også er kendt som partitionering eller segmentering. Den opdeler datapunkterne i et forudbestemt antal klynger kendt som K.

I K-means-metoden er K input, da du fortæller computeren, hvor mange klynger du vil identificere i dine data. Hvert dataelement tildeles efterfølgende til det nærmeste klyngecenter, kendt som et tyngdepunkt (sorte prikker på billedet).

Sidstnævnte tjener som datalagringspladser. Klyngeteknikken kan udføres adskillige gange, indtil klyngerne er veldefinerede.

Fuzzy K-betyder

Fuzzy K-means er en udvidelse af K-means-teknikken, som bruges til at lave overlappende clustering. I modsætning til K-middel-teknikken indikerer fuzzy K-midler, at datapunkter kan tilhøre mange klynger med varierende grader af nærhed til hver.

Afstanden mellem datapunkter og klyngens tyngdepunkt bruges til at beregne nærhed. Som et resultat kan der være tilfælde, hvor forskellige klynger overlapper hinanden.

Gaussiske blandingsmodeller

Gaussiske blandingsmodeller (GMM'er) er en metode, der bruges til probabilistisk klyngedannelse. Fordi middelværdien og variansen er ukendt, antager modellerne, at der er et fast antal Gauss-fordelinger, der hver repræsenterer en særskilt klynge.

For at bestemme hvilken klynge et specifikt datapunkt tilhører, bruges metoden i det væsentlige.

Hierarkisk klyngedannelse

Den hierarkiske klyngestrategi kan begynde med, at hvert datapunkt er tildelt en anden klynge. De to klynger, der er tættest på hinanden, blandes derefter til en enkelt klynge. Iterativ fletning fortsætter, indtil der kun er en klynge tilbage øverst.

Denne metode er kendt som bottom-up eller agglomerativ. Hvis du begynder med alle dataelementer knyttet til den samme klynge og derefter udfører opdelinger, indtil hvert dataelement er tildelt som en separat klynge, er metoden kendt som top-down eller divisive hierarkisk klynge.

Apriori algoritme

Markedskurvanalyse populariserede apriori-algoritmer, hvilket resulterede i forskellige anbefalingsmotorer til musikplatforme og onlinebutikker.

De bruges i transaktionsdatasæt til at finde hyppige varesæt eller grupperinger af varer for at forudsige sandsynligheden for at forbruge et produkt baseret på et andets forbrug.

For eksempel, hvis jeg begynder at spille OneRepublics radio på Spotify med "Counting Stars", vil en af de andre sange på denne kanal helt sikkert være en Imagine Dragon-sang, såsom "Bad Liar."

Dette er baseret på mine tidligere lyttevaner samt andres lyttemønstre. Apriori-metoder tæller varesæt ved hjælp af et hash-træ, der krydser datasættets bredde først.

Dimensionalitetsreduktion

Dimensionalitetsreduktion er en slags uovervåget læring, der bruger en samling af strategier til at minimere antallet af funktioner – eller dimensioner – i et datasæt. Tillad os at afklare.

Det kan være fristende at inkorporere så meget data som muligt, mens du opretter din datasæt til maskinlæring. Misforstå os ikke: Denne strategi fungerer godt, da flere data normalt giver mere nøjagtige resultater.

Antag, at data er lagret i N-dimensionelt rum, hvor hver funktion repræsenterer en anden dimension. Der kan være hundredvis af dimensioner, hvis der er mange data.

Overvej Excel-regneark med kolonner, der repræsenterer karakteristika, og rækker, der repræsenterer dataelementer. Når der er for mange dimensioner, kan ML-algoritmer fungere dårligt og datavisualisering kan blive svært.

Så det gør det logisk at begrænse egenskaberne eller dimensionerne og formidle netop relevant information. Dimensionalitetsreduktion er netop det. Det giver mulighed for en håndterbar mængde datainput uden at kompromittere datasættets integritet.

Principal Component Analysis (PCA)

Den vigtigste komponentanalyse er en dimensionsreduktionstilgang. Det bruges til at minimere antallet af funktioner i enorme datasæt, hvilket resulterer i større dataenkelhed uden at ofre nøjagtigheden.

Datasætkomprimering opnås ved en metode kendt som funktionsudtræk. Det angiver, at elementer fra det originale sæt er blandet til et nyt, mindre. Disse nye egenskaber er kendt som primære komponenter.

Selvfølgelig er der yderligere algoritmer, du kan bruge i dine uovervågede læringsapplikationer. De ovenfor nævnte er bare de mest udbredte, hvorfor de diskuteres mere detaljeret.

Anvendelse af uovervåget læring

- Uovervågede læringsmetoder bruges til visuelle perceptionsopgaver såsom objektgenkendelse.

- Uovervåget maskinlæring giver kritiske aspekter til medicinske billeddannelsessystemer, såsom billedidentifikation, klassificering og segmentering, som bruges i radiologi og patologi til at diagnosticere patienter hurtigt og pålideligt.

- Uovervåget læring kan hjælpe med at identificere datatendenser, der kan bruges til at skabe mere effektive krydssalgsstrategier ved at udnytte tidligere data om forbrugeradfærd. Under checkout-processen bruges dette af online-virksomheder til at foreslå de rigtige tilføjelser til kunder.

- Uovervågede læringsmetoder kan gennemsøge enorme mængder data for at finde outliers. Disse abnormiteter kan øge meddelelsen om defekt udstyr, menneskelige fejl eller sikkerhedsbrud.

Problemer med uovervåget læring

Uovervåget læring er tiltalende på en række forskellige måder, lige fra potentialet til at finde vigtig indsigt i data for at undgå kostbar datamærkning operationer. Der er dog flere ulemper ved at bruge denne strategi til at træne maskinlæringsmodeller som du skal være opmærksom på. Her er nogle eksempler.

- Da inputdata mangler etiketter, der tjener som svarnøgler, kan resultaterne af uovervågede læringsmodeller være mindre præcise.

- Uovervåget læring fungerer ofte med massive datasæt, hvilket kan øge beregningsmæssig kompleksitet.

- Tilgangen nødvendiggør outputbekræftelse af mennesker, enten interne eller eksterne specialister i emnet forespørgsel.

- Algoritmer skal undersøge og beregne alle mulige scenarier gennem træningsfasen, hvilket tager noget tid.

Konklusion

Effektiv dataudnyttelse er nøglen til at etablere en konkurrencefordel på et bestemt marked.

Du kan segmentere dataene ved hjælp af uovervågede maskinlæringsalgoritmer for at undersøge din målgruppes præferencer eller for at bestemme, hvordan en bestemt infektion reagerer på en bestemt behandling.

Der er flere praktiske anvendelser, og data forskere, ingeniører og arkitekter kan hjælpe dig med at definere dine mål og udvikle unikke ML-løsninger til din virksomhed.

Giv en kommentar