Indholdsfortegnelse[Skjule][At vise]

Sensorer og software er kombineret i autonome køretøjer til at navigere, styre og betjene en række forskellige køretøjer, herunder motorcykler, biler, lastbiler og droner.

Afhængigt af hvordan de blev udviklet eller designet, kan de kræve førerassistance eller ikke.

Fuldstændig autonome biler kan køre sikkert uden menneskelige chauffører. Nogle, som Googles Waymo bil, kunne ikke engang have et rat.

Et delvist autonomt køretøj, som f.eks Tesla, kan overtage fuldstændig kontrol over køretøjet, men kan have brug for en menneskelig chauffør til at hjælpe, hvis systemet kommer i tvivl.

Forskellige grader af selvautomatisering er inkluderet i disse biler, lige fra vognbanestyring og bremsehjælp til helt uafhængige, selvkørende prototyper.

Målet med førerløse biler er at sænke trafik, emissioner og ulykkesrater.

Dette er muligt, fordi selvkørende køretøjer er mere dygtige til at overholde trafikregler end mennesker.

For en jævn kørsel er visse oplysninger nødvendige, såsom placeringen af bilen eller eventuelle genstande i nærheden, den korteste og sikreste vej til destinationen og kapaciteten til at betjene køresystemet.

Det er afgørende at forstå, hvornår og hvordan man udfører nødvendige opgaver.

Denne artikel vil dække meget, herunder systemarkitektur til autonome biler, nødvendige komponenter og ad hoc-netværk til køretøjer (VANET'er).

Nødvendige komponenter påkrævet til autonomt køretøj

Nutidens autonome køretøjer anvender en række sensorer, herunder kameraer, GPS, inertimålenheder (IMU'er), ekkolod, laserbelysningsdetektion og rækkevidde (lidar), radiodetektering og rækkevidde (radar), lydnavigation og afstandsmåling (ekkolod) og 3D kort.

Sammen analyserer disse sensorer og teknologier data i realtid for at kontrollere styring, acceleration og bremsning.

Radarsensorerne hjælper med at holde styr på, hvor omkringliggende biler befinder sig. Køretøjer bliver hjulpet med ultralydssensorer under parkering.

En teknologi kendt som lidar blev skabt ved at bruge begge typer sensorer. Ved at reflektere lysimpulser fra omgivelserne omkring bilen, kan lidar-sensorer registrere vejbanernes marginer og identificere vognbanemarkører.

Disse advarer også bilister om tilstødende hindringer, såsom andre køretøjer, fodgængere og cykler.

Størrelsen og afstanden af alt omkring bilen måles ved hjælp af lidar-teknologi, som også skaber et 3D-kort, der gør det muligt for køretøjet at se sine omgivelser og identificere eventuelle risici.

Uanset tidspunktet på dagen, om det er lyst eller dystert, gør den et fremragende stykke arbejde med at optage information i forskellige typer omgivende lys.

Bilen bruger kameraer, radar og GPS-antenner, sammen med lidar og kameraer, til at registrere dens omgivelser og identificere dens placering.

Kameraer tjekker for fodgængere, cyklister, biler og andre forhindringer, mens de også registrerer trafiksignaler, læser vejskilte og afmærkninger og holder styr på andre køretøjer.

De kan dog have det svært i mørke eller skyggefulde områder. Et autonomt køretøj kan se, hvor det skal hen ved at bruge en blanding af lidar, radar, kameraer, GPS-antenner og ultralydssensorer til at kortlægge vejen foran det digitalt.

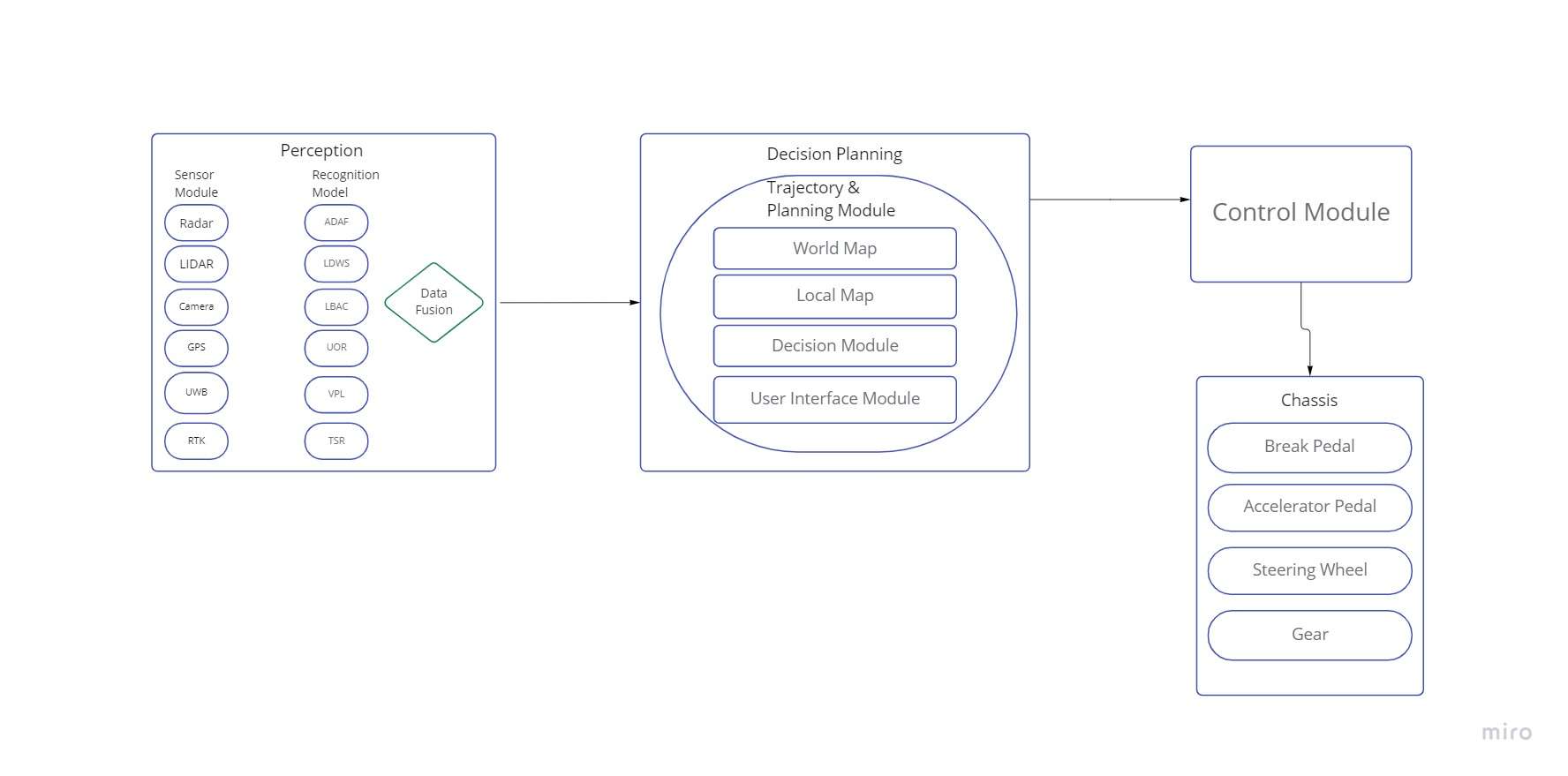

Systemarkitektur på højt niveau

De væsentlige sensorer, aktuatorer, hardware og software er opført i arkitekturen, som også demonstrerer hele kommunikationsmekanismen eller protokollen i AV'er.

Perception

Dette trin omfatter identifikation af AV'ens placering i forhold til miljøet og sansning af miljøet omkring AV'en ved hjælp af en række forskellige sensorer.

AV'en bruger RADAR, LIDAR, kamera, real-time kinetic (RTK) og andre sensorer på dette trin. Genkendelsesmodulerne modtager data fra disse sensorer og behandler dem efter at have videregivet dem.

Generelt består AV'en af et kontrolsystem, LDWS, TSR, genkendelse af ukendte forhindringer (UOR), et køretøjspositionerings- og lokaliseringsmodul (VPL) osv.

Den kombinerede information gives til beslutnings- og planlægningsstadiet efter at være blevet behandlet.

Beslutning & Planlægning

AV'ens bevægelser og adfærd besluttes, planlægges og kontrolleres på dette trin ved hjælp af informationen modtaget under perceptionsprocessen.

Denne fase, som hjernen ville repræsentere, er hvor der træffes valg om ting som stiplanlægning, handlingsforudsigelse, undgåelse af forhindringer osv.

Valget er baseret på den information, der er nu og historisk tilgængelig, herunder kortdata i realtid, trafikspecifikationer, tendenser, brugerinformation mv.

Der kan være et datalogmodul, der holder styr på fejl og data til senere brug.

kontrol

Kontrolmodulet udfører operationer/handlinger relateret til fysisk kontrol af AV'en, såsom styring, bremsning, acceleration osv. efter at have modtaget information fra beslutnings- og planlægningsmodulet.

Chassis

Det sidste trin involverer interaktion med de mekaniske dele, der er fastgjort til chassiset, såsom gearmotor, ratmotor, bremsepedalmotor og pedalmotorer til speederen og bremsen.

Styremodulet signalerer og styrer alle disse komponenter.

Nu vil vi tale om den generelle kommunikation af en AV, før vi taler om design, betjening og brug af forskellige nøglesensorer.

RADAR

I AV'er bruges RADAR'er til at scanne miljøet for at finde og lokalisere biler og andre objekter.

RADAR'er bruges ofte i både militære og civile formål, såsom lufthavne eller meteorologiske systemer, og de opererer i millimeterbølge-spektret (mm-bølge).

Forskellige frekvensbånd, herunder 24, 60, 77 og 79 GHz, bruges i moderne biler og har et måleområde på 5 til 200 m [10].

Ved at beregne ToF mellem det transmitterede signal og det returnerede ekko, bestemmes afstanden mellem AV'en og objektet.

I AV'er anvender RADAR'erne en række mikroantenner, der skaber en samling af lober for at forbedre afstandsopløsningen og identifikation af flere mål. mm-Wave RADAR kan præcist vurdere nærliggende objekter i enhver retning ved at udnytte variansen i Doppler-skift på grund af dens øgede gennemtrængelighed og større båndbredde.

Da mm-Wave-radarer har en længere bølgelængde, har de antiblokerings- og anti-forureningsegenskaber, der gør dem i stand til at fungere i regn, sne, tåge og svagt lys.

Derudover kan Doppler-skift bruges til at beregne den relative hastighed via mm-bølge-radarer. På grund af deres kapacitet er mm-Wave-radarer velegnede til en lang række AV-applikationer, herunder forhindringsdetektion og fodgænger- og køretøjsgenkendelse.

Ultralydssensorer

Disse sensorer arbejder i området 20-40 kHz og anvender ultralydsbølger. En magneto-resistiv membran, der bruges til at måle objektets afstand, producerer disse bølger.

Ved at beregne time-of-flight (ToF) af den udsendte bølge til det ekkoede signal, bestemmes afstanden. Den typiske rækkevidde af ultralydssensorer er mindre end 3 meter.

Sensoroutputtet opdateres hver 20. ms, hvilket forhindrer det i at overholde ITS'ens strenge QoS-krav. Disse sensorer har et relativt lille stråledetektionsområde og er rettet.

Derfor kræves der adskillige sensorer for at opnå et fuldfeltsyn. Imidlertid vil mange sensorer interagere og kan resultere i betydelige rækkevidde unøjagtigheder.

LIDAR

Spektrene på 905 og 1550 nm bruges i LiDAR. Da det menneskelige øje er modtageligt for nethindeskader fra 905 nm-området, fungerer den nuværende LiDAR i 1550 nm-båndet for at reducere nethindeskader.

Op til 200 meter er LiDARs maksimale arbejdsområde. Solid-state, 2D og 3D LiDAR er de forskellige underkategorier af LiDAR.

En enkelt laserstråle spredes over et spejl, der snurrer hurtigt i en 2D LiDAR. Ved at placere flere lasere på poden kan en 3D LiDAR få et 3D billede af omgivelserne.

Det er blevet påvist, at et vejside LiDAR-system sænker antallet af køretøj-til-fodgænger-kollisioner (V2P) i både krydsende og ikke-krydsende zoner.

Den anvender et 16-linjers, real-time, beregningsmæssigt effektivt LiDAR-system.

Det foreslås at bruge en dyb kunstig auto-encoder neurale netværk (DA-ANN), som opnår en nøjagtighed på 95 % over en rækkevidde på 30 m.

I er det demonstreret, hvordan en støttevektormaskine (SVM)-baseret algoritme kombineret med en 64-linjers 3D LiDAR kan forbedre fodgængergenkendelse.

På trods af at den har bedre målepræcision og 3D-syn end en mm-Wave-radar, klarer LiDAR sig mindre godt i dårligt vejr, herunder tåge, sne og regn.

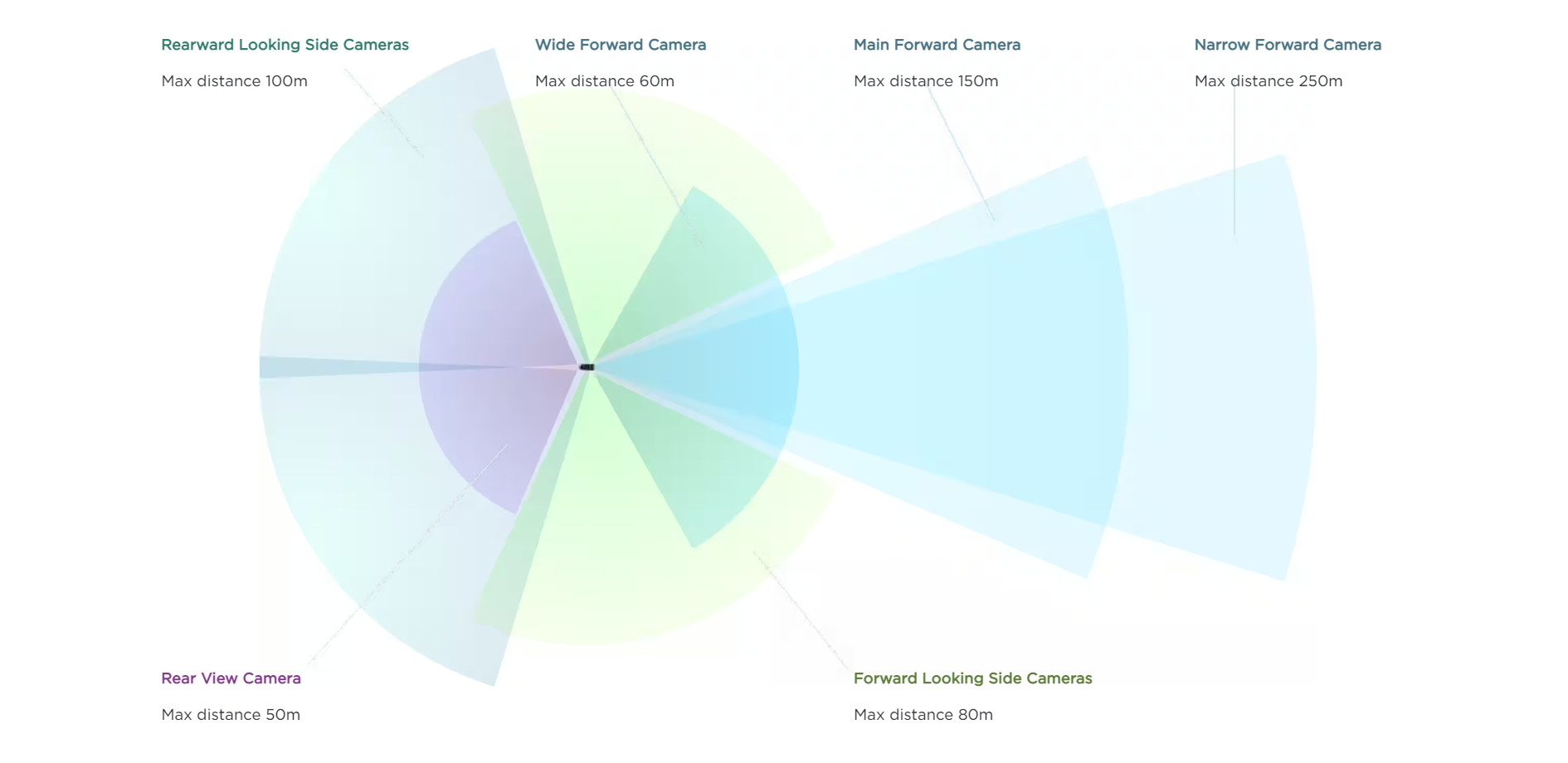

kameraer

Afhængigt af enhedens bølgelængde kan kameraet i AV'er enten være infrarødt- eller synligt-lys-baseret.

Opladningskoblet enhed (CCD) og komplementære metal-oxid-halvleder (CMOS) billedsensorer bruges i kameraet (CMOS).

Afhængigt af objektivkvaliteten er kameraets maksimale rækkevidde omkring 250 m. De tre bånd, der bruges af synlige kameraer - rød, grøn og blå - er adskilt af samme bølgelængde som det menneskelige øje, eller 400-780 nm (RGB).

To VIS-kameraer er koblet sammen med etablerede brændvidder for at skabe en ny kanal, der indeholder dybde (D) information, hvilket giver mulighed for at skabe stereoskopisk syn.

En 3D-visning af området omkring køretøjet kan opnås takket være denne funktion via kameraet (RGB-D).

Passive sensorer med en bølgelængde på mellem 780 nm og 1 mm bruges af det infrarøde (IR) kamera. I topbelysning tilbyder IR-sensorerne i AV'er visuel kontrol.

Dette kamera hjælper AV'er med objektgenkendelse, sidevisningskontrol, ulykkesoptagelse og BSD. Men i dårligt vejr, såsom sne, tåge og skiftende lysforhold, ændres kameraets ydeevne.

Et kameras primære fordele er dets evne til præcist at samle og registrere miljøets tekstur, farvefordeling og form.

Global Navigation Satellite System og Global Positioning System, inertimåleenhed

Denne teknologi hjælper AV'en med at navigere ved at lokalisere dens præcise placering. En gruppe satellitter i kredsløb omkring planetens overflade bruges af GNSS til at lokalisere.

Systemet gemmer data om AV'ens placering, hastighed og præcise tid.

Det fungerer ved at finde ud af ToF mellem det modtagne signal og satellittens emission. GPS-koordinaterne (Global Positioning System) bruges ofte til at opnå AV-placeringen.

De GPS-udtrukne koordinater er ikke altid præcise, og de tilføjer typisk en positionsfejl med en middelværdi på 3 m og en standardvariation på 1 m.

I storbysituationer forringes ydeevnen yderligere med en fejl i placeringen på op til 20 m, og under visse alvorlige omstændigheder er GPS-positionsfejlen cirka 100 m.

Derudover kan AV'er anvende RTK-systemet til præcist at bestemme køretøjets position.

I AV'er kan køretøjets position og retning også bestemmes ved hjælp af dødregning (DR) og inertipositionen.

Sensor Fusion

For korrekt køretøjsstyring og sikkerhed skal AV'er få præcis viden i realtid om placering, status og andre køretøjsfaktorer som vægt, stabilitet, hastighed osv.

Denne information skal indsamles af AV'erne ved hjælp af en række forskellige sensorer.

Ved at fusionere de data, der er erhvervet fra flere sensorer, udnyttes sensorfusionsteknikken til at producere sammenhængende information.

Metoden tillader syntese af ubehandlede data erhvervet fra komplementære kilder.

Som et resultat heraf gør sensorfusion det muligt for AV-en at forstå sine omgivelser nøjagtigt ved at fusionere alle nyttige data indsamlet fra forskellige sensorer.

Forskellige typer algoritmer, herunder Kalman-filtre og Bayesian-filtre, bruges til at udføre fusionsprocessen i AV'er.

Fordi det bruges i flere applikationer, herunder RADAR-sporing, satellitnavigationssystemer og optisk odometri, anses Kalman-filteret for at være afgørende for, at et køretøj kan fungere autonomt.

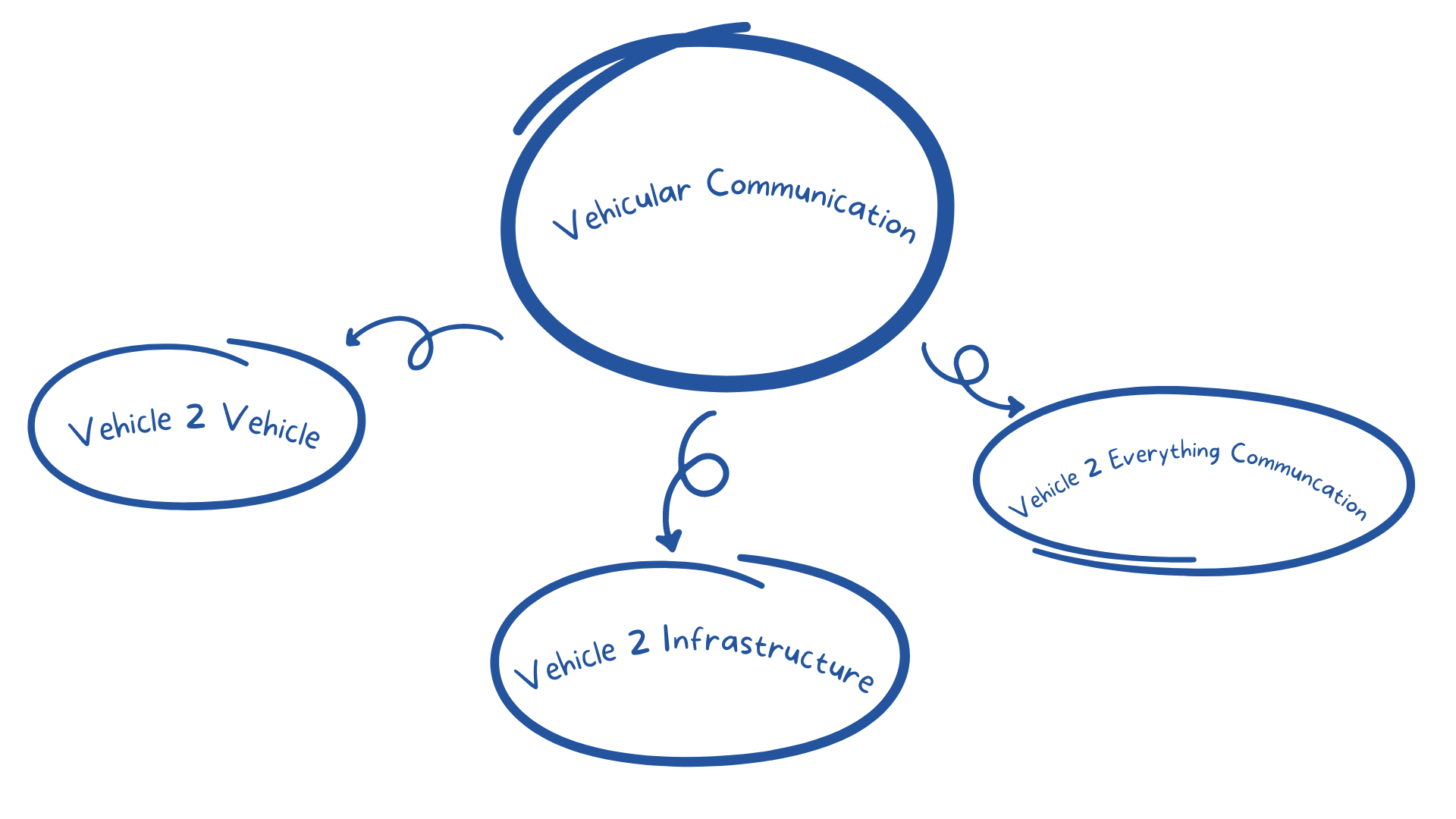

Ad hoc-netværk til køretøjer (VANETs)

VANET'er er en ny underklasse af mobile ad hoc-netværk, der spontant kan skabe et netværk af mobile enheder/køretøjer. Køretøj-til-køretøj (V2V) og køretøj-til-infrastruktur (V2I) kommunikation er mulig med VANET'er.

Det primære mål med en sådan teknologi er at øge trafiksikkerheden; for eksempel i farlige situationer som ulykker og trafikpropper, kan biler interagere med hinanden og netværket for at videresende afgørende information.

Følgende er de primære komponenter i VANET-teknologien:

- OBU (on-board unit): Det er et GPS-baseret sporingssystem placeret i hvert køretøj, som gør det muligt for dem at interagere med hinanden og med vejsideenheder (RSU). OBU'en er udstyret med flere elektroniske komponenter, herunder en ressourcekommandoprocessor (RCP), sensorenheder og brugergrænseflader, for at få væsentlig information. Dens primære formål er at bruge et trådløst netværk til at kommunikere mellem flere RSU'er og OBU'er.

- Roadside Unit (RSU): RSU'er er faste computerenheder, der er placeret på præcise punkter på gader, parkeringspladser og vejkryds. Dens hovedformål er at forbinde autonome køretøjer til infrastrukturen, og det hjælper også med lokalisering af køretøjer. Derudover kan det bruges til at forbinde et køretøj til andre RSU'er, der bruger forskellige netværkstopologier. Derudover er de blevet kørt på omgivende energikilder, herunder solenergi.

- Trusted Authority (TA): Det er et organ, der kontrollerer hvert trin i VANET-processen og sikrer, at kun legitime RSU'er og køretøjs-OBU'er kan registrere og interagere. Ved at bekræfte OBU-id'et og autentificere køretøjet giver det sikkerhed. Derudover finder den skadelig kommunikation og mærkelig adfærd.

VANET'er bruges til køretøjskommunikation, som inkluderer V2V-, V2I- og V2X-kommunikation.

Køretøj 2 Køretøjskommunikation

Muligheden for biler til at tale med hinanden og udveksle vigtige oplysninger om trafikpropper, ulykker og hastighedsbegrænsninger er kendt som inter-vehicle communication (IVC).

V2V-kommunikation kan skabe netværket ved at forbinde forskellige noder (køretøjer) sammen ved hjælp af en mesh-topologi, enten delvis eller fuld.

De er kategoriseret som single-hop (SIVC) eller multi-hop (MIVC) systemer afhængigt af hvor mange hop der bruges til kommunikation mellem køretøjer.

Mens MIVC kan bruges til langdistancekommunikation, såsom trafikovervågning, kan SIVC bruges til kortdistanceapplikationer som vognbanesammenlægning, ACC osv.

Adskillige fordele, herunder BSD, FCWS, automatiseret nødbremse (AEB) og LDWS, tilbydes gennem V2V-kommunikation.

Køretøj 2 Infrastrukturkommunikation

Bilerne kan kommunikere med RSU'erne gennem en proces kendt som roadside-to-vehicle communication (RVC). Det hjælper med at detektere parkeringsmålere, kameraer, vognbanemarkører og trafiksignaler.

Ad hoc, trådløs og tovejsforbindelse mellem bilerne og infrastrukturen.

Til administration og overvågning af trafikken anvendes infrastrukturens data. De bruges til at justere forskellige hastighedsparametre, der gør det muligt for bilerne at maksimere brændstoføkonomien og styre trafikstrømmen.

RVC-systemet kan adskilles i Sparse RVC (SRVC) og Ubiquitous RVC afhængigt af infrastrukturen (URVC).

SRVC-systemet tilbyder kun kommunikationstjenester på hotspots, såsom at lokalisere åbne parkeringspladser eller tankstationer, hvorimod URVC-systemet tilbyder dækning langs hele ruten, selv ved høje hastigheder.

For at sikre netværksdækning kræver URVC-systemet en stor investering.

Køretøj 2 Alt Kommunikation

Bilen kan forbindes med andre enheder via V2X, herunder fodgængere, vejsideobjekter, enheder og nettet (V2P, V2R og V2D) (V2G).

Ved at bruge denne form for kommunikation kan bilister undgå at ramme udsatte fodgængere, cyklister og motorcyklister.

Pedestrian Collision Warning-systemet (PCW) kan advare føreren af en vejpassager, før der sker en katastrofal kollision takket være V2X-kommunikation.

For at sende vigtige beskeder til fodgængeren kan PCW'en drage fordel af smartphonens Bluetooth eller Near Field Communication (NFC).

Konklusion

De mange teknologier, der bruges til at konstruere autonome biler, kan have stor indflydelse på, hvordan de fungerer.

På det mest basale udvikler bilen et kort over sine omgivelser ved hjælp af en række sensorer, der giver information om ruten omkring den og andre køretøjer på dens vej.

Disse data analyseres derefter af et kompliceret maskinlæringssystem, som genererer et sæt handlinger, som bilen kan udføre. Denne adfærd ændres og opdateres regelmæssigt, efterhånden som systemet lærer mere om køretøjets omgivelser.

På trods af mine bestræbelser på at præsentere dig for et overblik over arkitekturen for det autonome køretøjssystem, sker der meget mere bag kulisserne.

Jeg håber virkelig, at du vil finde denne viden værdifuld og gøre brug af den.

Giv en kommentar