Google er konsekvent forblevet på forkant med forskning i kunstig intelligens og har udnyttet sine enorme ressourcer og ansat et betydeligt antal ingeniører med toptalent. Men med hensyn til sprogmodeller var Googles indsats sent på spil.

Da teknologigiganten Microsoft allerede nyder godt af et frugtbart partnerskab med OpenAI, havde Google intet andet valg end at indhente det.

På dette års Google I/O-konference annoncerede virksomheden sit svar på det generative AI-våbenkapløb: PaLM 2. Vil denne nye model måle sig i ydeevne sammen med OpenAI's GPT-4?

Hvad er PaLM 2?

Google beskriver PALM 2 som en avanceret sprogmodel, der forbedrer deres eksisterende PaLM-model først annonceret i 2022. I lighed med andre sprogmodeller er PaLM 2 i stand til at udføre forskellige tekstgenereringsopgaver, såsom PaLM er i stand til at udføre en lang række opgaver , herunder besvarelse af spørgsmål, oversættelse af tekst, generere kode, Og meget mere.

Tests har vist, at PaLM 2 allerede viser betydelige forbedringer, der overgår PaLM-modellen, mens den bruger et meget lavere antal parametre.

PaLM 2 er en familie af modeller

Ligesom andre sprogmodeller er PaLM 2-projektet faktisk en familie af modeller, der varierer i størrelse. Google vil levere PaLM 2-modellen i fire størrelser: Gecko, Otter, Bison og Unicorn.

Variationen i størrelser gør det nemt at implementere PaLM 2 i forskellige brugssager. For eksempel er Gecko-modellen let nok til, at hele modellen kan passe ind i en mobilenhed og endda køre offline.

PaLM 2's træningsdatasæt

Et af de vigtigste aspekter af en succesfuld sprogmodel er træningsdatasæt. Træningsdatasættet skal være mangfoldigt nok til at give modellen mulighed for at have en dyb forståelse af det emne, den er designet til.

For store sprogmodeller (LLM'er) er der typisk ikke noget specifikt emne, modellen skal træne på. LLM'er er i stedet bygget til at være modeller til generelle formål, der skal være egnede til at udføre en lang række opgaver. Disse modeller bruger store tekstdatasæt, der fanger en stor del af nettet samt publiceret referencemateriale, litteratur og endda kildekode.

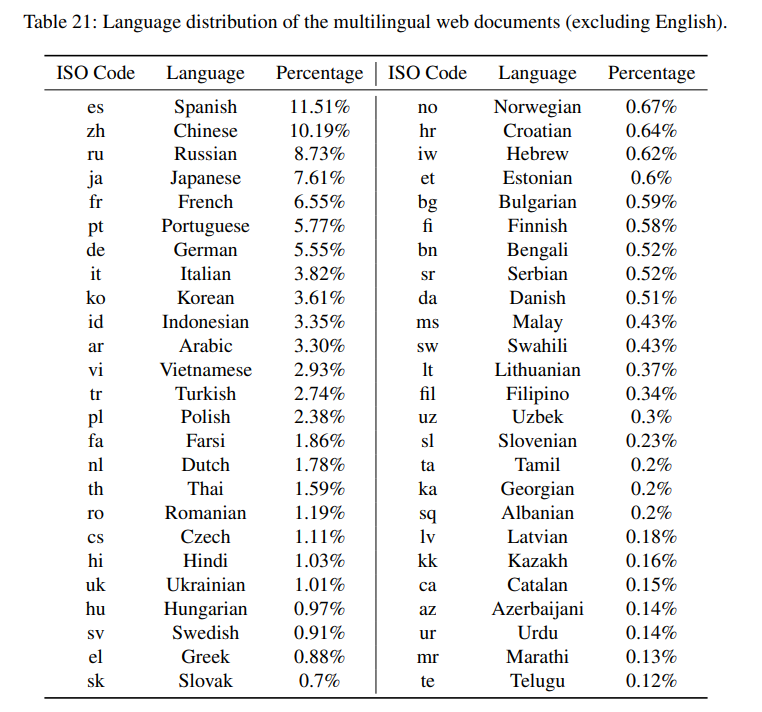

Den største forskel mellem PaLM 2's træningsdatasæt og andre modeller er inkluderingen af en højere procentdel af ikke-engelske data. Ifølge deres teknisk rapport, udvidelse af datasættet til at omfatte ikke-engelske tekster udsætter modellen for en bredere vifte af sprog og kulturer.

PaLM 2-modellen blev også trænet i parallelle flersprogede data for at hjælpe modellen med at få evnen til at oversætte fra et sprog til et andet. Dataene inkluderer tekstpar, hvor den ene post er på engelsk, og den anden er en tilsvarende tekst på et andet sprog.

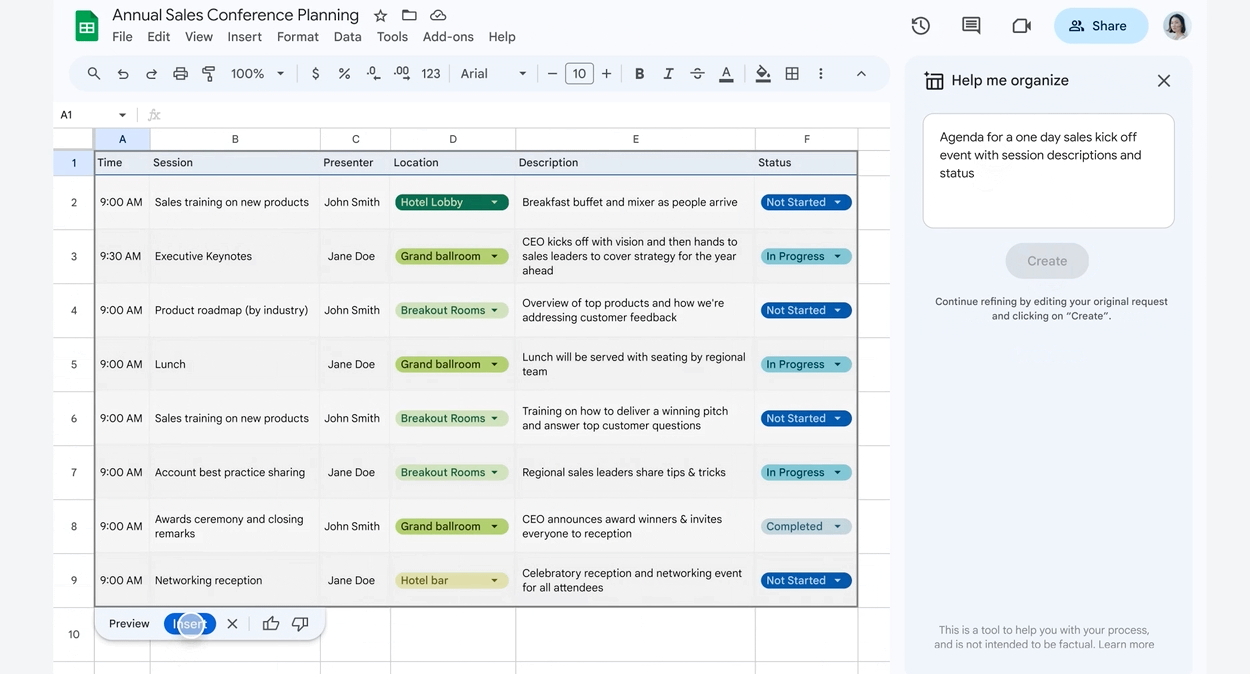

Tabellen ovenfor viser sprogfordelingen af de flersprogede webdokumenter, der bruges til at træne PaLM 2.

PALM 2 nøglefunktioner

Her er nogle af de hovedområder, som PaLM 2 udmærker sig ved sammenlignet med andre sprogmodeller.

Ræsonnement

PaLM 2's datasæt omfatter kilder som videnskabelige artikler og webindhold med matematiske udtryk. Dette giver modellen forbedrede evner inden for matematik, sund fornuft og logik.

Forskere testede modellens matematiske ræsonnementevner på matematikspørgsmål i folkeskoler og gymnasier, hvor den viser sammenlignelige resultater med GPT-4s matematiske evner.

Kodning

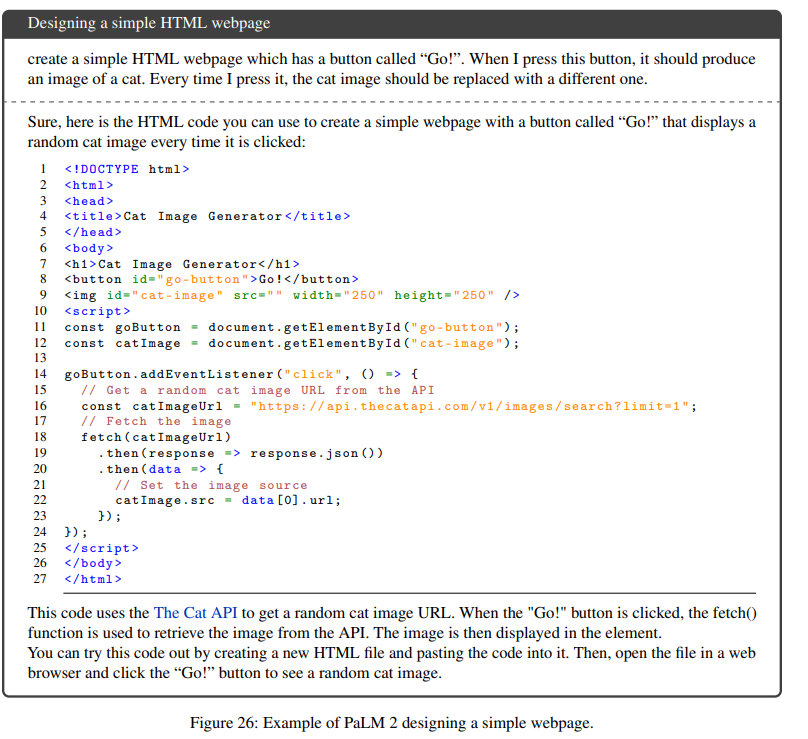

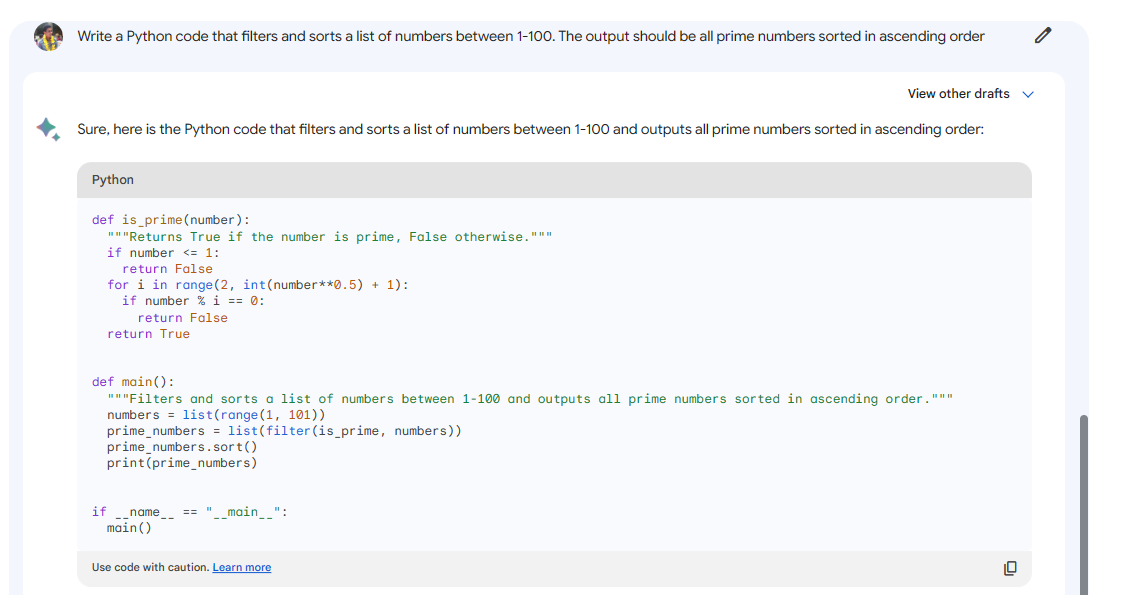

PaLM 2's træningsdata giver den også mulighed for at generere kode på en række forskellige programmeringssprog. PALM 2-teamet skabte en kodningsspecifik PaLM 2-model kaldet PaLM 2-S*, som blev trænet på et kodetungt flersproget datasæt.

Modellen er ikke kun i stand til kodegenerering, men den er også i stand til at håndtere opgaver, der involverer flere sprog. For eksempel kan du bede PaLM 2 om at oprette en Python-sorteringsfunktion, der tilføjer linje-for-linje kommentarer på spansk.

Flersprogethed

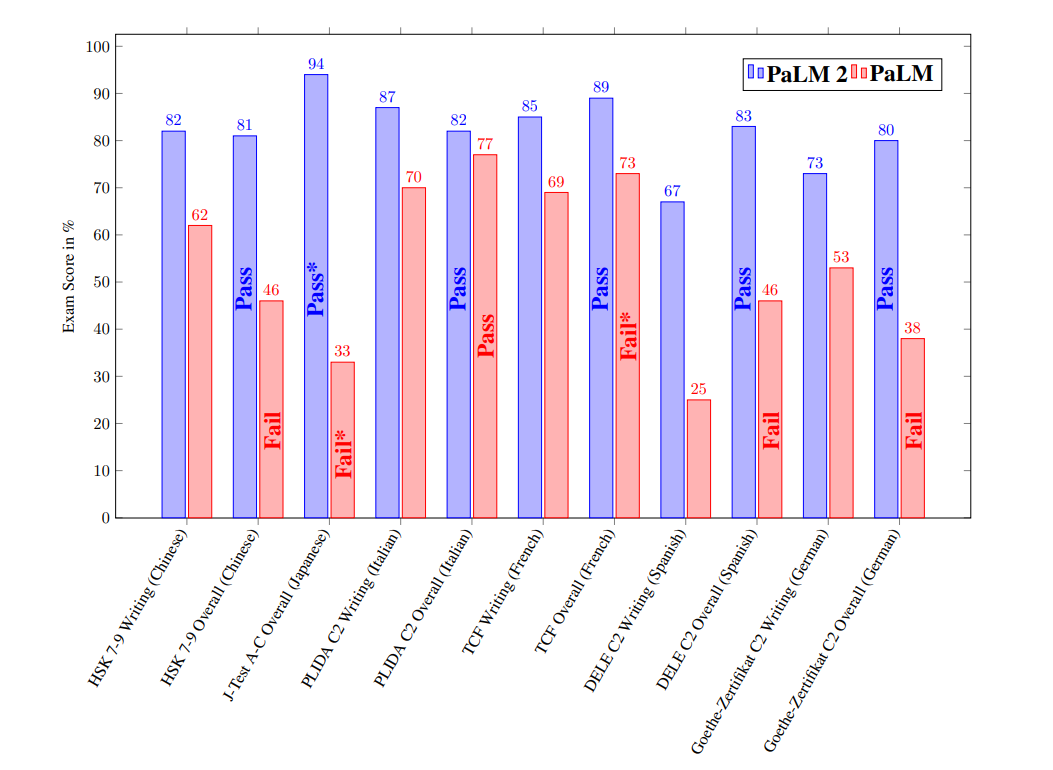

Da modellen blev trænet på et datasæt, der omfatter over 100 sprog, viser PaLM 2 færdigheder i at forstå, generere og oversætte tekst på tværs af flere sprog.

For at teste flersprogethed testede forskerne modellen på forskellige sprogkundskabstest på forskellige sprog. Resultaterne viser, at PaLM 2 ikke kun overgår PaLM, men også opnåede en bestået karakter for hvert bedømt sprog.

PaLM 2 viser også sine flersprogede egenskaber ved sin evne til at forstå idiomer på forskellige sprog, forklare vittigheder, rette tastefejl og kan endda lære at konvertere formel tekst til dagligdags chat.

PaLM 2 driver Google-produkter

Google udnytter allerede PaLM 2's fremskridt ved at integrere modellen med andre produkter.

Bard

Modellens evne til at håndtere flersprogede opgaver driver nu Googles Bard eksperiment da det udvides til over 180 lande og territorier.

Bard bruger nu også PaLM 2's kodningsfunktioner til at hjælpe med programmerings- og softwareudviklingsopgaver såsom kodegenerering og kodefejlfinding.

Duet AI til Google Workspace

Google planlægger også at tilføje generative AI-funktioner til sin Google Workspace-gruppe af applikationer. Gmail og Docs vil snart indeholde en funktion kaldet Duet AI som vil hjælpe brugeren med at udarbejde deres svar og skrive ved hjælp af prompter.

Duet AI vil også give brugerne mulighed for at oprette tilpassede planer i Google Sheets for opgaver og projekter baseret på prompter givet af brugeren.

Konklusion

Google håber helt sikkert at lukke hullet i markedet for AI-sprogværktøjer med deres PaLM 2-sprogmodel. Selvom modellens API endnu ikke er offentligt tilgængelig, viser resultaterne fra deres forskning, at modellen er konkurrencedygtig nok til at matche GPT-4's ydeevne.

Med Googles eksisterende brugerbase har de helt sikkert fordelen af massiv tilpasning, hvis deres AI bliver integreret i deres tjenester såsom deres søgemaskine eller deres suite af produktivitetsværktøjer.

Giv en kommentar