Indholdsfortegnelse[Skjule][At vise]

Vi bruger meget tid på at kommunikere med folk online via chat, e-mail, hjemmesider og sociale medier.

De enorme mængder tekstdata, vi producerer hvert sekund, undslipper vores opmærksomhed, men ikke altid.

Kundernes handlinger og anmeldelser giver organisationer uvurderlig information om, hvad kunder værdsætter og afviser af varer og tjenester, samt hvad de ønsker af et brand.

De fleste virksomheder har dog stadig svært ved at bestemme den mest effektive metode til dataanalyse.

Da meget af dataene er ustrukturerede, har computere svært ved at forstå dem, og det ville være ekstremt tidskrævende at sortere dem manuelt.

At behandle en masse data i hånden bliver besværligt, monotont og simpelthen uskalerbart, efterhånden som en virksomhed ekspanderer.

Heldigvis kan Natural Language Processing hjælpe dig med at finde indsigtsfuld information i ustruktureret tekst og løse en række tekstanalyseproblemer, bl.a. følelser analyse, emnekategorisering og mere.

At gøre det menneskelige sprog forståeligt for maskiner er målet for kunstig intelligens-feltet for naturlig sprogbehandling (NLP), som gør brug af lingvistik og datalogi.

NLP sætter computere i stand til automatisk at evaluere enorme mængder data, hvilket gør det muligt for dig hurtigt at identificere relevant information.

Ustruktureret tekst (eller andre former for naturligt sprog) kan bruges med en række teknologier til at afdække indsigtsfuld information og løse en række problemer.

Selvom den på ingen måde er omfattende, er listen over open source-værktøjer præsenteret nedenfor et vidunderligt sted at starte for enhver eller enhver organisation, der er interesseret i at bruge naturlig sprogbehandling i deres projekter.

1. NLTK

Man kan argumentere for, at Natural Language Toolkit (NLTK) er det mest funktionsrige værktøj, jeg har set på.

Næsten alle NLP-teknikkerne er implementeret, herunder kategorisering, tokenisering, stemming, tagging, parsing og semantisk ræsonnement.

Du kan vælge den præcise algoritme eller tilgang, du vil bruge, fordi der ofte er flere implementeringer tilgængelige for hver.

Adskillige sprog understøttes også. Selvom det er godt til simple strukturer, gør det faktum, at det repræsenterer alle data som strenge, det udfordrende at anvende nogle sofistikerede funktioner.

Sammenlignet med andre værktøjer er biblioteket også lidt trægt.

Alt taget i betragtning er dette et fremragende værktøjssæt til eksperimentering, udforskning og applikationer, der kræver en vis blanding af algoritmer.

FORDELE

- Det er det mest populære og komplette NLP-bibliotek med flere tredje tilføjelser.

- I sammenligning med andre biblioteker understøtter den de fleste sprog.

ULEMPER

- svære at forstå og bruge

- Det er langsomt

- ingen modeller af neurale netværk

- Den deler kun teksten op i sætninger uden at tage hensyn til semantikken

2. spacy

SpaCy er NLTKs mest sandsynlige toprival. Selvom det kun har én implementering for hver NLP-komponent, er det generelt hurtigere.

Derudover er alt repræsenteret som et objekt snarere end en streng, hvilket forenkler grænsefladen til udvikling af apps.

At have et dybere greb om dine tekstdata vil gøre dig i stand til at opnå mere.

Dette gør det også lettere for det at forbinde med flere andre rammer og datavidenskabelige værktøjer. Men sammenlignet med NLTK understøtter SpaCy ikke så mange sprog.

Den har mange neurale modeller for forskellige aspekter af sprogbehandling og -analyse, samt en ligetil brugergrænseflade med et fortættet udvalg af muligheder og fremragende dokumentation.

Derudover er SpaCy bygget til at rumme enorme mængder data og er ekstremt grundigt dokumenteret.

Det inkluderer også en overflod af modeller for naturlig sprogbehandling, som allerede er blevet trænet, hvilket gør det nemmere at lære, undervise og bruge naturlig sprogbehandling med SpaCy.

Samlet set er dette et glimrende værktøj til nye apps, der ikke har brug for en specifik metode og skal være effektive i produktionen.

FORDELE

- Sammenlignet med andre ting er det hurtigt.

- At lære og bruge det er enkelt.

- modeller trænes ved hjælp af neurale netværk

ULEMPER

- mindre tilpasningsevne i forhold til NLTK

3. Gensim

De mest effektive og nemme tilgange til at udtrykke dokumenter som semantiske vektorer opnås ved at bruge den specialiserede open source Python-ramme kendt som Gensim.

Gensim blev skabt af forfatterne til at håndtere rå, ustruktureret almindelig tekst ved hjælp af en række machine learning metoder; derfor er det en smart idé at bruge Gensim til at løse opgaver som Topic Modelling.

Derudover finder Gensim effektivt tekstlige ligheder, indekserer indhold og navigerer mellem forskellige tekster.

Det er et højt specialiseret Python bibliotek med fokus på emnemodelleringsopgaver ved hjælp af latent Dirichlet-allokering og andre LDA-metoder.

Derudover er den ret god til at finde tekster, der ligner hinanden, indeksere tekster og navigere på tværs af papirer.

Dette værktøj håndterer enorme mængder data effektivt og hurtigt. Her er nogle startvejledninger.

FORDELE

- enkel brugergrænseflade

- effektiv brug af velkendte algoritmer

- På en gruppe af computere kan den udføre latent Dirichlet-allokering og latent semantisk analyse.

ULEMPER

- Det er mest beregnet til uovervåget tekstmodellering.

- Det mangler en komplet NLP-pipeline og bør bruges sammen med andre biblioteker som Spacy eller NLTK.

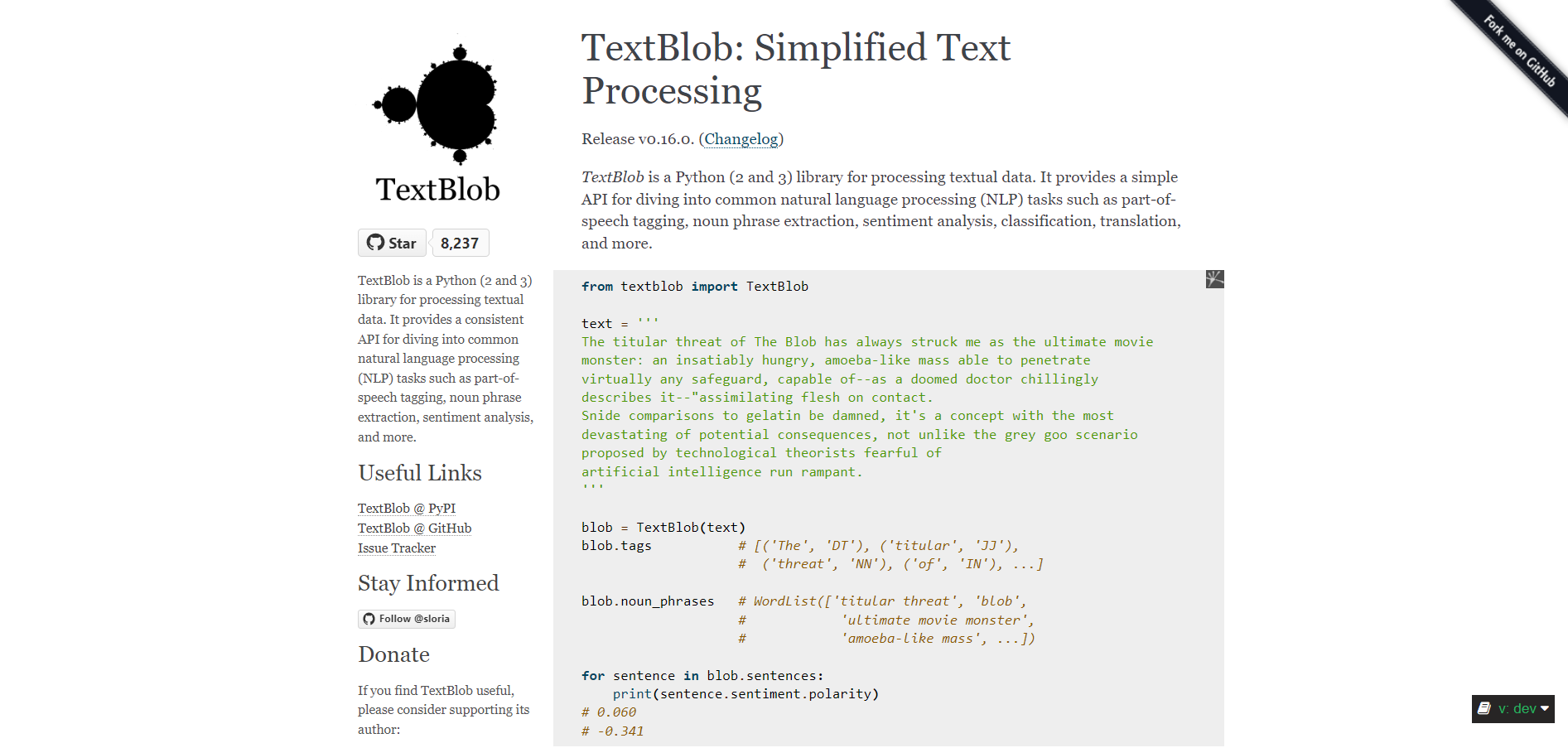

4. TextBlob

TextBlob er en slags NLTK-udvidelse.

Gennem TextBlob kan du lettere få adgang til adskillige NLTK-funktioner, og TextBlob inkorporerer også mønsterbiblioteksfunktioner.

Dette kan være et nyttigt værktøj at bruge, mens du lærer, hvis du lige er startet, og det kan bruges i produktionen til applikationer, der ikke kræver meget ydeevne.

Det tilbyder en langt mere brugervenlig og ligetil grænseflade til at udføre de samme NLP-funktioner.

Det er en fantastisk mulighed for nybegyndere, der ønsker at påtage sig NLP-opgaver som sentimentanalyse, tekstkategorisering og orddelsmærkning, fordi dens indlæringskurve er mindre end med andre open source-værktøjer.

TextBlob er meget udbredt og fremragende til mindre projekter generelt.

FORDELE

- Bibliotekets brugerflade er enkel og overskuelig.

- Det tilbyder sprogidentifikation og oversættelsestjenester ved hjælp af Google Translate.

ULEMPER

- I sammenligning med andre er det langsomt.

- Ingen modeller af neurale netværk

- Ingen ordvektorer integreret

5. OpenNLP

Det er nemt at inkorporere OpenNLP med andre Apache-projekter som Apache Flink, Apache NiFi og Apache Spark, fordi det er hostet af Apache Foundation.

Det er et omfattende NLP-værktøj, der kan bruges fra kommandolinjen eller som et bibliotek i en applikation.

Det inkluderer alle NLP's almindelige behandlingskomponenter.

Derudover tilbyder den omfattende sprogunderstøttelse. Hvis du bruger Java, er OpenNLP et stærkt værktøj med et væld af muligheder, der er forberedt til produktionsbelastninger.

Ud over at muliggøre de mest typiske NLP-opgaver, såsom tokenisering, sætningssegmentering og mundtlig tagging, kan OpenNLP bruges til at skabe mere komplekse tekstbehandlingsapplikationer.

Maksimal entropi og perceptron-baseret maskinlæring er også inkluderet.

FORDELE

- Et model træningsværktøj med flere funktioner

- Fokuserer på grundlæggende NLP-opgaver og udmærker sig ved dem, herunder enhedsidentifikation, sætningsdetektion og tokenisering.

ULEMPER

- mangler sofistikerede kapaciteter; hvis du vil fortsætte med JVM, er det næste naturlige skridt at flytte til CoreNLP.

6. AllenNLP

AllenNLP er ideel til kommercielle applikationer og dataanalyse, da det er bygget på PyTorch-værktøjer og -ressourcer.

Det udvikler sig til et altomfattende værktøj til tekstanalyse.

Dette gør det til et af listens mere sofistikerede værktøjer til behandling af naturlige sprog. Mens de udfører de andre opgaver uafhængigt, forbehandler AllenNLP data ved hjælp af den gratis SpaCy open source-pakke.

AllenNLPs vigtigste salgsargument er, hvor nemt det er at bruge.

AllenNLP strømliner den naturlige sprogbehandlingsproces i modsætning til andre NLP-programmer, der omfatter flere moduler.

Som en konsekvens heraf føles outputresultaterne aldrig forvirrende. Det er et fantastisk værktøj for dem uden meget viden.

FORDELE

- Udviklet oven på PyTorch

- fremragende til at udforske og eksperimentere ved hjælp af banebrydende modeller

- Det kan bruges både kommercielt og akademisk

ULEMPER

- Ikke egnet til store projekter, der i øjeblikket er i produktion.

Konklusion

Virksomheder bruger NLP-teknikker til at udtrække indsigt fra ustrukturerede tekstdata såsom e-mails, online anmeldelser, sociale medier opslag og meget mere. Open source-værktøjer er omkostningsfrie, tilpasningsdygtige og giver udviklere komplette tilpasningsmuligheder.

Hvad venter du på? Brug dem med det samme og skab noget utroligt.

Glad kodning!

Giv en kommentar