Cloud GPU'er er i stor efterspørgsel efterhånden som nye teknologier som deep learning, AI og machine learning dukker op.

GPU'er (Graphics Processing Units) er specialiserede processorer lavet til at håndtere de enorme datasæt og komplicerede beregninger, der er nødvendige for aktiviteter som computergrafik og spil. De er nu afgørende for området kunstig intelligens (AI) også, dog for sent.

Traditionelle CPU'er (Central Processing Units) er ikke i stand til at imødekomme efterspørgslen, da AI-modeller kræver en betydelig mængde computerkraft for at træne og køre.

På den anden side, da de er bygget til at understøtte parallel behandling, er GPU'er mere effektive til at håndtere de enorme mængder data og komplicerede beregninger, der er nødvendige for AI-operationer.

Hvis du er i teknologi, skal du have hørt om cloud GPU-tjenester. Til dem, der ikke vil følge med.

En cloud-baseret tjeneste, der giver brugere online adgang til potente GPU-ressourcer, er kendt som en cloud-GPU-tjeneste til AI. I stedet for at skulle købe og vedligeholde deres egen GPU-hardware, giver disse tjenester kunderne mulighed for at leje GPU-ressourcer efter behov.

Dette gør det muligt for mennesker og organisationer at bruge GPU'ernes behandlingskapacitet uden at skulle foretage en betydelig initial investering eller betale løbende vedligeholdelsesgebyrer.

Størstedelen af cloud GPU-tjenester til AI tilbyder en bred vifte af GPU-muligheder, herunder adskillige modeller og konfigurationer og fleksibiliteten til at skalere op eller ned efter behov. Du kan nu vælge de ideelle GPU-ressourcer til deres unikke krav og projekter takket være denne service.

Derudover kommer tjenesterne ofte med andre funktioner, herunder netværk, lagring og softwareværktøjer til at hjælpe kunder i deres AI-projekter. I dette indlæg vil vi se på de bedste cloud GPU-tjenester til AI.

1. Linode

Linode tilbyder GPU'er efter behov for arbejdsbelastninger som videobehandling, videnskabelig databehandling, machine learning, kunstig intelligens og andre.

Det giver GPU-optimerede virtuelle maskiner (VM'er), der kører på NVIDIA Quadro RTX 6000, Tensor og RT-kerner og bruger CUDA-kapacitet til at gøre dyb læring, ray tracing arbejdsbelastninger og komplekse beregninger.

Ved at omdanne dine anlægsudgifter til en driftsudgift, kan du bruge Linode GPU's GPU-kapacitet og den reelle værdi af skyen.

Derudover frigør Linode dig fra at skulle bekymre dig om hardwaren, så du kan koncentrere dig om dine stærkeste færdigheder.

Med Linode GPU'er er det nu muligt at bruge dem til sofistikerede applikationer som videostreaming, kunstig intelligens og maskinlæring.

Derudover kan du, afhængigt af mængden af processorkraft, der kræves til forventede arbejdsbelastninger, modtage op til 4 kort for hver instans.

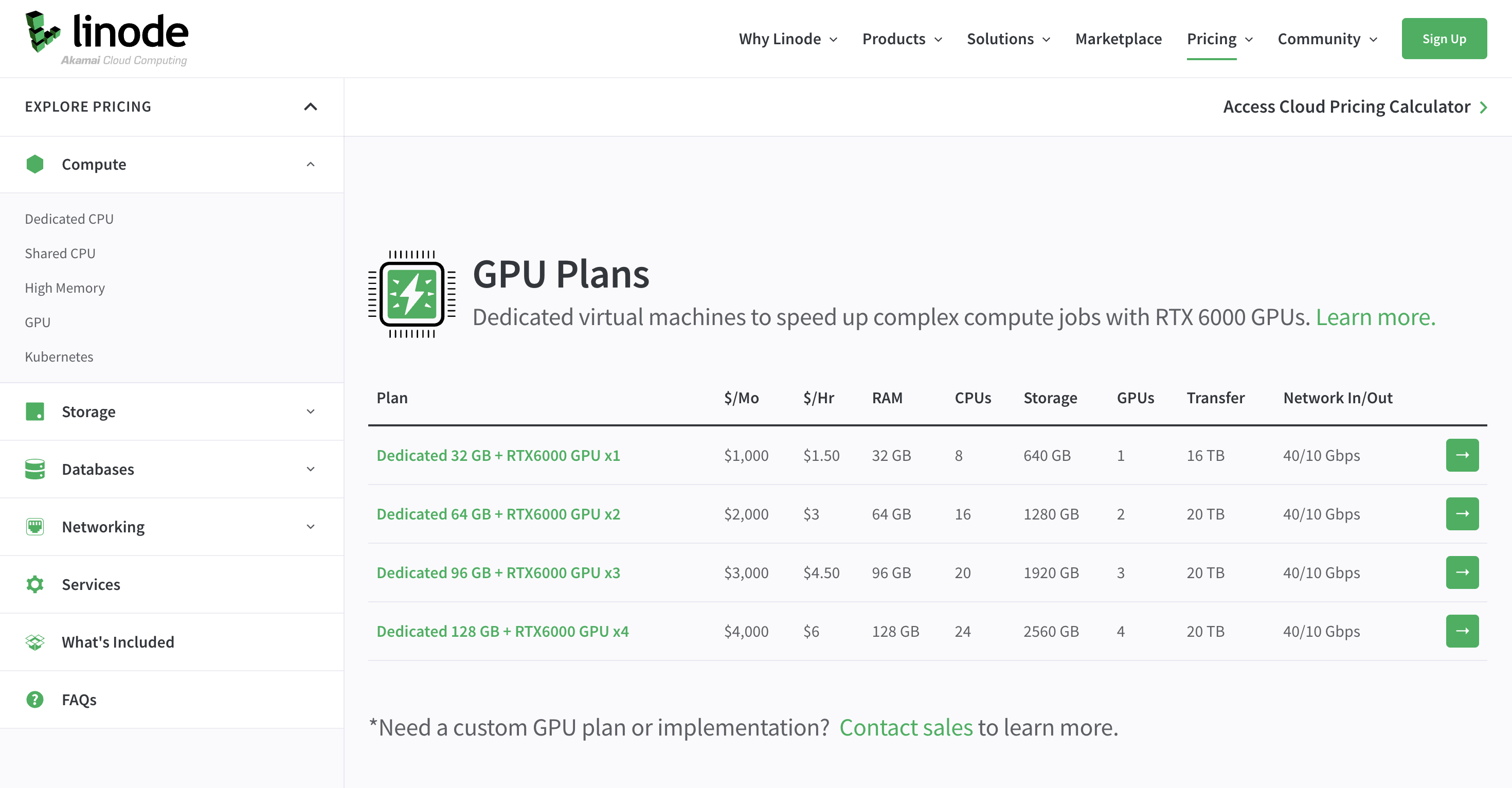

Priser

Prisen starter ved $1.5/time for den dedikerede RTX6000 GPU-plan. Kom i gang med Linode gratis.

2. Stor AI

Vast AI er en global markedsplads, hvor brugere kan leje billige GPU'er til brug i højtydende computing.

De reducerer omkostningerne ved beregningstunge opgaver ved at gøre det muligt for værter at udleje deres GPU-hardware, hvilket gør det muligt for brugere at bruge deres online søgeværktøj til at finde de billigste priser for computere i overensstemmelse med deres behov og udføre kommandoer eller starte SSH-forbindelser.

De leverer SSH-forekomster, Jupyter-forekomster med Jupyter GUI eller kun kommando-forekomster og har en ligetil brugergrænseflade.

En deep learning performance funktion (DLPerf), som forudsiger en estimeret deep learning opgave ydeevne, er også tilvejebragt.

Systemerne, der bruges af Vast AI, er Ubuntu-baserede og tilbyder ikke fjernskriveborde. De driver også instanser, der er tilgængelige på efterspørgsel for et specifikt gebyr fastsat af værten.

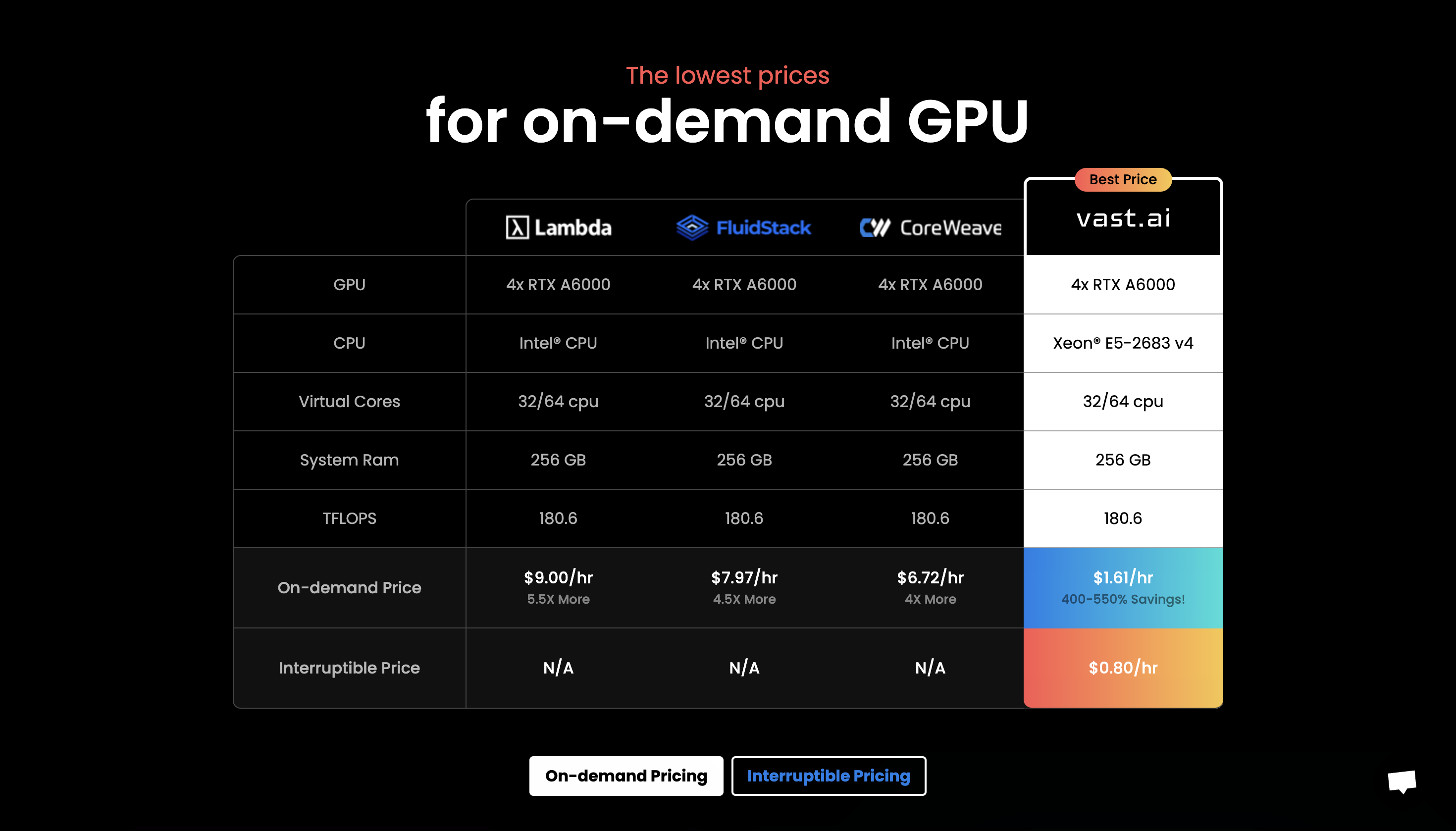

Priser

Prisen starter ved $0.80/time for 4x RTX A6000.

3. AWS & NVIDIA

Sammen leverer AWS og NVIDIA konsekvent GPU-baserede løsninger, der er overkommelige, tilpasningsdygtige og kraftfulde.

Det inkluderer NVIDIA GPU-drevne Amazon EC2-instanser og tjenester som AWS IoT Greengrass, der installeres med NVIDIA Jetson Nano-moduler.

Til virtuelle arbejdsstationer, maskinlæring (ML), Internet of Things (IoT)-tjenester og højtydende databehandling bruger brugere AWS og NVIDIA. Skalerbar ydeevne leveres af NVIDIA GPU'erne, der driver Amazon EC2-instanser.

Brug desuden AWS IoT Greengrass til at forbinde NVIDIA-baserede edge-enheder til AWS-skytjenesterne.

Amazon EC2 P4d-instanser er drevet af NVIDIA A100 Tensor Core GPU'er, som giver branchens laveste latency-netværk og højeste gennemløb.

I lighed med dette er der andre forskellige tilfælde tilgængelige under visse omstændigheder, såsom Amazon EC2 P3, Amazon EC2 G4 osv.

Priser

Du kan ansøge om en gratis prøveperiode og kontakt venligst leverandøren for prisfastsættelse.

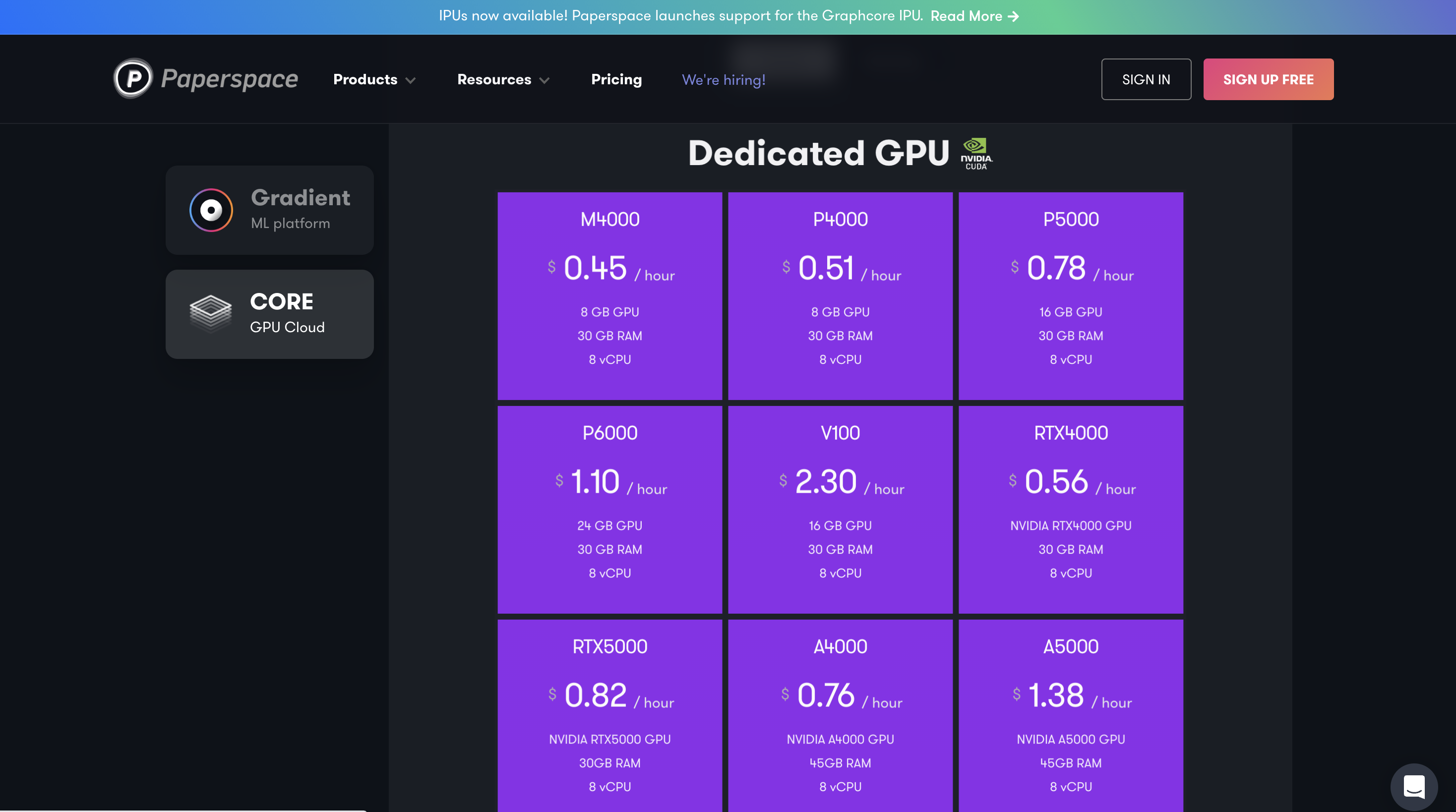

4. Paperspace CORE

A CORE er en fuldt administreret cloud GPU-platform skabt af Paperspace, der giver ligetil, omkostningseffektiv og accelereret databehandling til en række forskellige applikationer.

Udnyt den banebrydende accelererede computerinfrastruktur leveret af Paperspace CORE til at fremskynde organisatoriske processer. For hurtig onboarding, samarbejdsværktøjer og desktop-applikationer til Mac, Linux og Windows tilbyder den en brugervenlig og ukompliceret grænseflade.

Brug den til at udføre krævende programmer på en uendelig mængde processorkraft. CORE tilbyder et superhurtigt netværk, hurtig klargøring, understøttelse af 3D-apps og en komplet API til programmatisk adgang.

Med en brugervenlig og intuitiv GUI får du et omfattende billede af din infrastruktur på ét sted.

Få desuden fremragende kontrol takket være CORE's administrationsgrænseflade, som tilbyder kraftfulde værktøjer og giver dig mulighed for at filtrere, sortere, forbinde eller oprette maskiner, netværk og brugere.

Priser

Prisen starter ved $0.45/time for den dedikerede M4000 GPU.

5. Alibaba Elastic GPU Service

Alibaba Elastic GPU Service (EGS) udnytter GPU-teknologi til at levere parallelle og kraftfulde behandlingsmuligheder. Mange applikationer, herunder videobehandling, visualisering, videnskabelig databehandling og deep learning, er velegnede til det.

EGS gør brug af en række GPU'er, herunder AMD FirePro S7150, NVIDIA Tesla M40, NVIDIA Tesla V100, NVIDIA Tesla P4 og NVIDIA Tesla P100.

Du vil have adgang til fordele, herunder online deep learning inferenstjenester og træning, indholdsidentifikation, billed- og stemmegenkendelse, HD-mediekodning, videokonferencer, kildefilmgendannelse og 4K/8K HD live.

Få alternativer som videogengivelse, beregningsfinansiering, klimaforudsigelse, kollisionssimulering, genteknologi, ikke-lineær redigering, fjernundervisningsapplikationer og ingeniørdesign.

Priser

Det tilbyder en gratis prøveperiode og betal-som-du-go-abonnement, hvilket betyder, at du kun har de instanser eller GPU'er, du bruger.

6. Genesis Cloud

Genesis Cloud tilbyder en yderst omkostningseffektiv cloud GPU-platform. De arbejder i partnerskab med adskillige effektive datacentre over hele verden for at levere en bred vifte af applikationer.

Genesis Cloud giver en bred vifte af nyttige funktioner uden ekstra omkostninger, inklusive snapshots til sikkerhedskopiering af dit arbejde, sikkerhedsgrupper til netværkstrafik, lagervolumener til store datasæt, FastAI, PyTorch, forudindstillede billeder og en offentlig TensorFlow API.

De fremskynder beregningen ved hjælp af NVIDIA GeForce RTX 3090, RTX 3080, RTX 3060 Ti og GTX 1080 Ti-teknologier i deres cloud GPU-instanser.

Du kan bruge kraften fra GPU-computere til at producere animerede film eller træne neurale netværk.

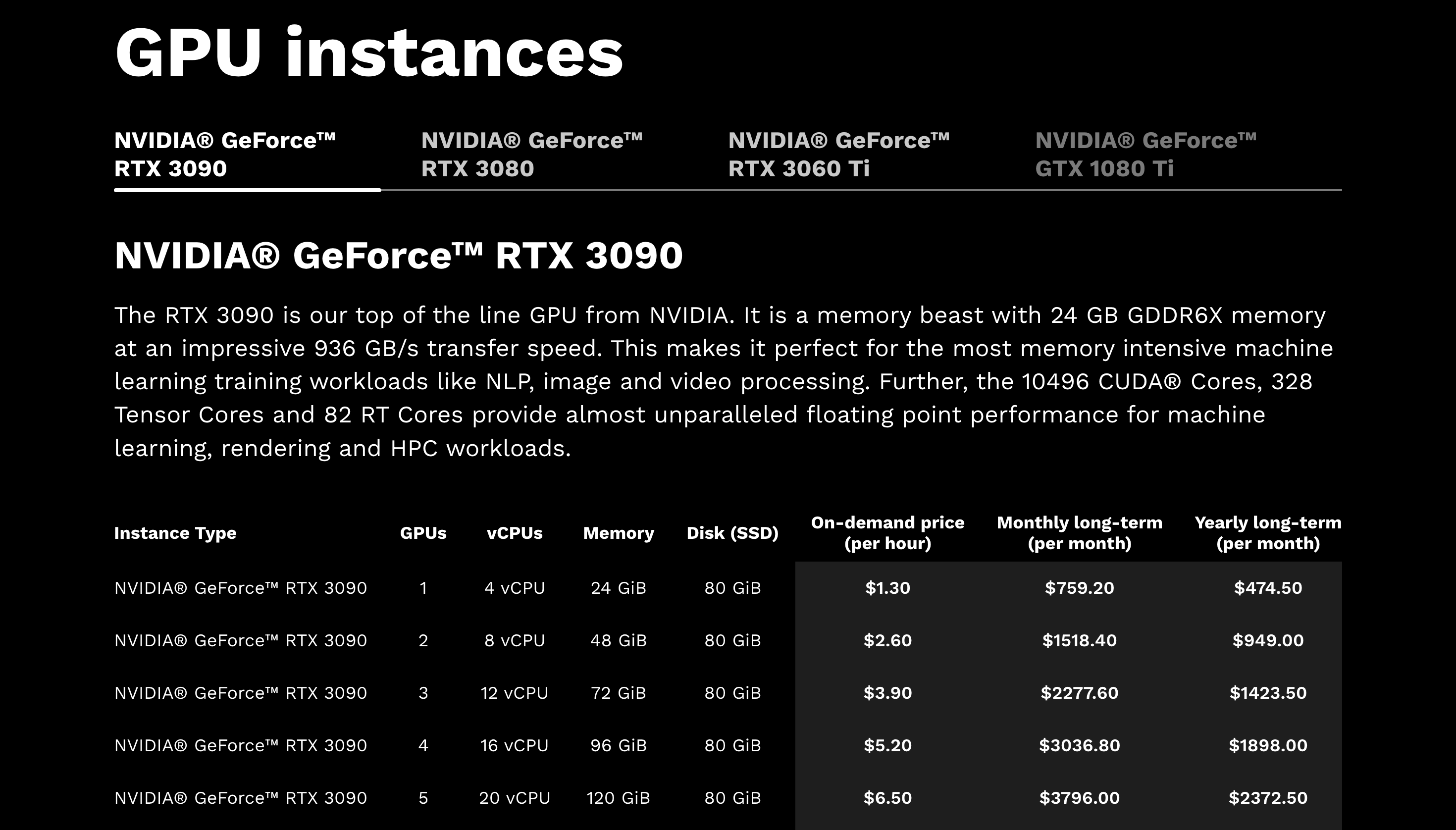

Priser

Prisen starter ved $1.30/time for NVIDIA® GeForce™ RTX 3090.

7. Google Cloud GPU

Google Cloud Platform (GCP) tilbyder en række GPU-instanser, der kan bruges til at fremskynde processer som maskinlæring, dyb læring og højtydende computing (HPC).

Gennem disse GPU-instanser, som understøttes af NVIDIA, AMD og Intel GPU'er, er det muligt at få adgang til CUDA- og cuDNN-bibliotekerne, som ofte bruges til GPU-accelereret computing.

På grund af maskinmodifikationer, fleksible priser og en lang række GPU-muligheder kan HPC være mere produktiv.

Derudover kan det hjælpe dig med at lette din arbejdsbyrde. Blandt de GPU'er, de leverer, er NVIDIA K80, P4, V100, A100, T4 og P100. Kun et lille antal zoner spredt over forskellige steder har adgang til GPU'erne.

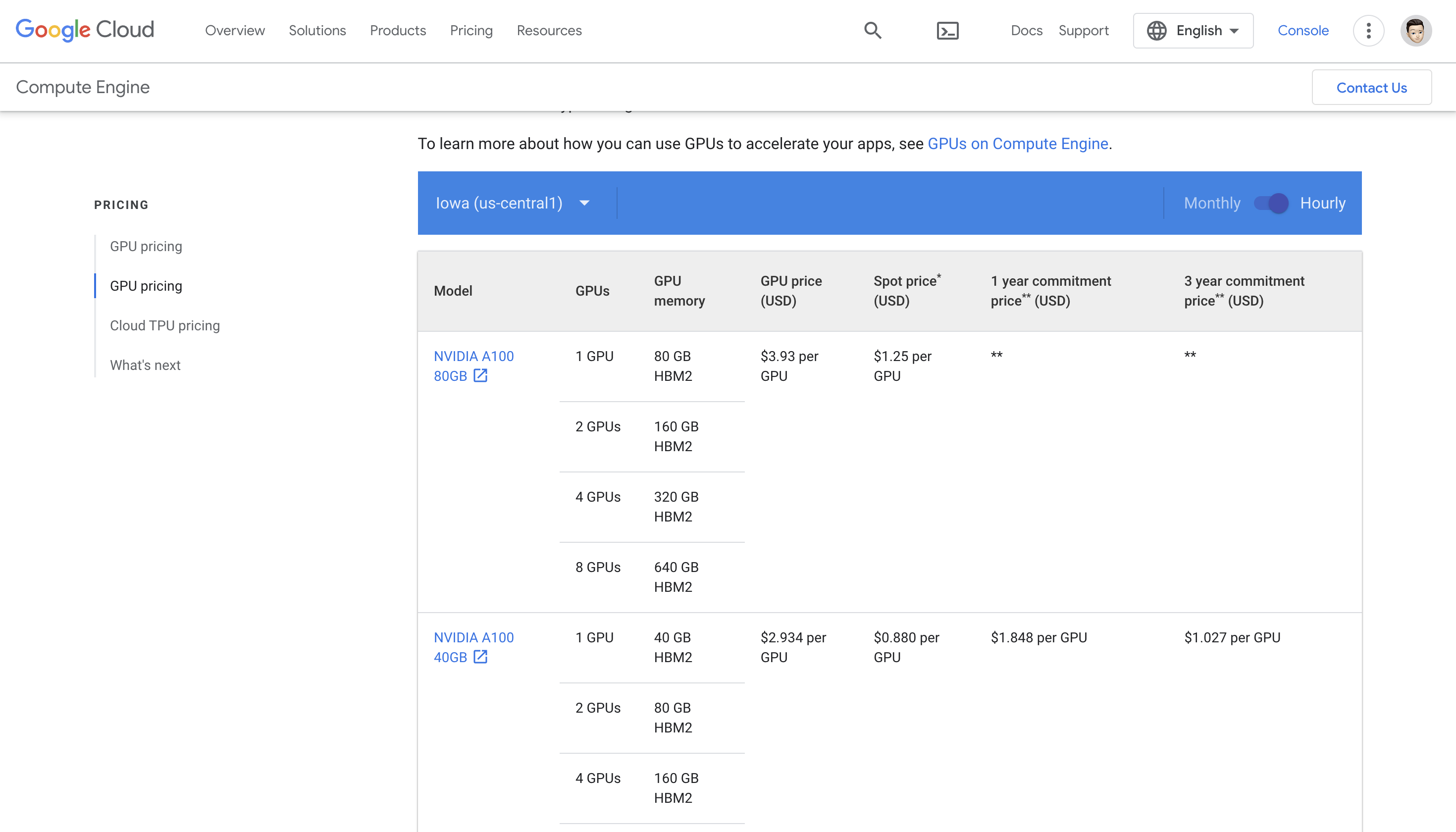

Priser

Omkostningerne vil variere baseret på regionen, den GPU du vælger, og maskintypen. For NVIDIA A100 starter priserne ved $3.93 per GPU.

8. NVIDIA GPU Cloud

NVIDIA GPU Cloud (NGC) er en cloud-baseret platform, der giver brugerne adgang til en række GPU-accelereret software, såsom visualiseringsværktøjer, HPC-programmer og dyb læring rammer.

Udviklere, data forskere, og forskere kan nu nemt bruge computerkraften fra NVIDIA GPU'er i skyen uden at skulle bekymre sig om den nødvendige infrastruktur eller vedligeholdelse til at betjene deres apps takket være NGC.

Et bibliotek af prækonfigurerede softwarecontainere er inkluderet i NGC og kan hurtigt implementeres på en række cloud computing infrastrukturer, herunder Amazon Web Services, Google Cloud Platform og Microsoft Azure.

Adgang til NGC giver også brugere adgang til NVIDIAs deep learning platform, som kommer med en række programmer og ressourcer til at skabe og implementere deep learning modeller, herunder TensorRT, cuDNN og CUDA-X AI.

Priser

Afhængigt af de specifikke tjenester og ressourcer, du bruger, ændres prisen på NVIDIA GPU Cloud (NGC). Mens visse NGC-tjenester, såsom deep learning-softwarestakken, er gratis at bruge, kan andre, såsom HPC-applikationsbeholderne, opkræve en pris. Se venligst NGC-kataloget.

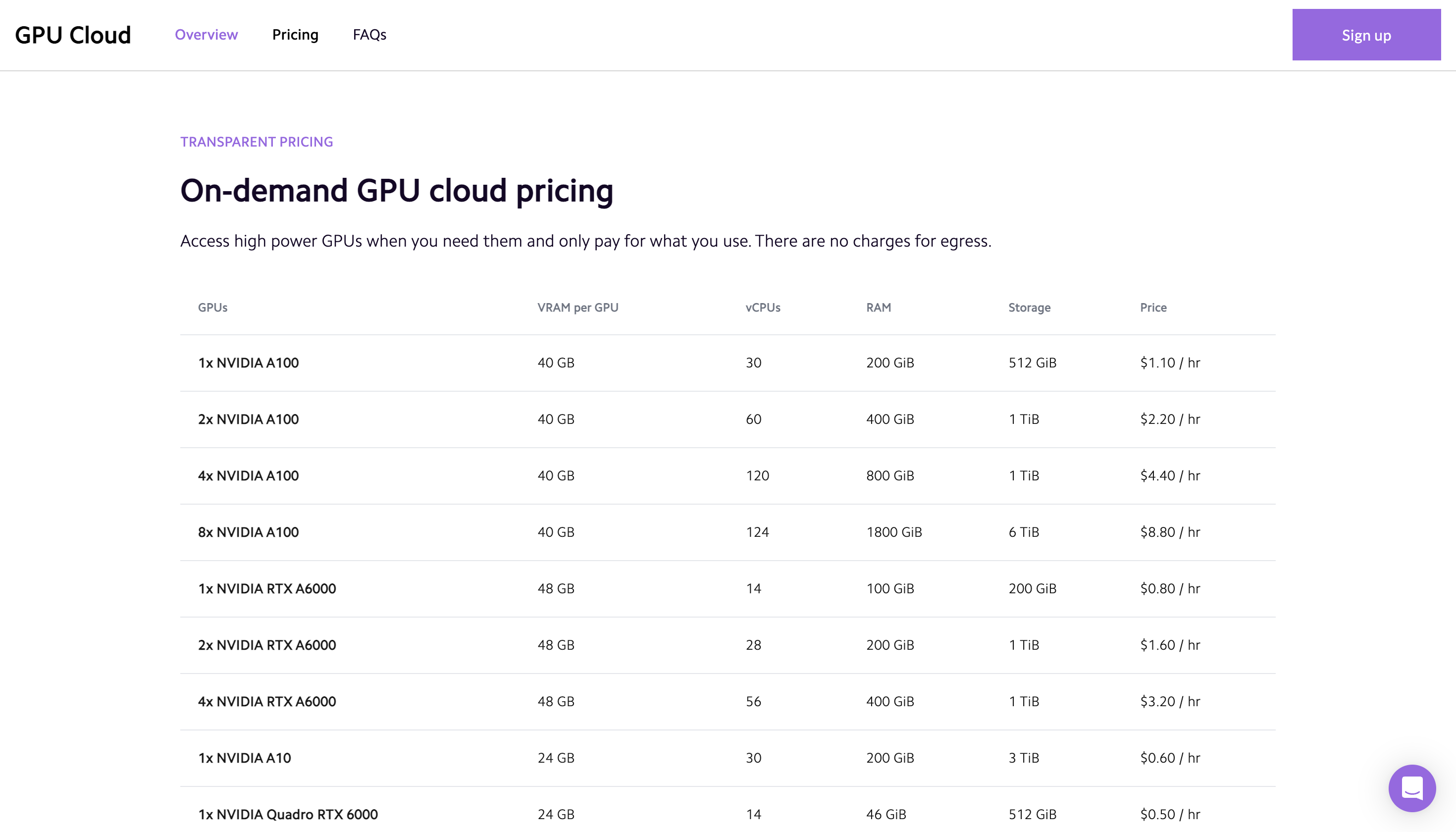

9. Lambda GPU Cloud

Lambda leverer cloud GPU-instanser til dyb læringsmodeltræning og skalerbarhed fra en enkelt fysisk computer til mange virtuelle maskiner.

Fra instrumentbrættet får du straks adgang til hver maskines specialiserede Jupyter Notebook programmeringsmiljø. For direkte adgang skal du bruge SSH direkte med en af SSH-tasterne eller oprette forbindelse via webterminalen på cloud-dashboardet.

Maksimalt 10 Gbps inter-node-forbindelse understøttes af hver instans, hvilket giver mulighed for distribueret træning ved hjælp af rammer som Horovod.

Opskalering af antallet af GPU'er på en eller flere forekomster kan hjælpe med at fremskynde modeloptimering. Platformen understøtter GPU-instanser fra NVIDIA RTX 6000, Quadro RTX 6000 og Tesla V100s.

Priser

Prisen starter ved $1.10/time for NVIDIA A100.

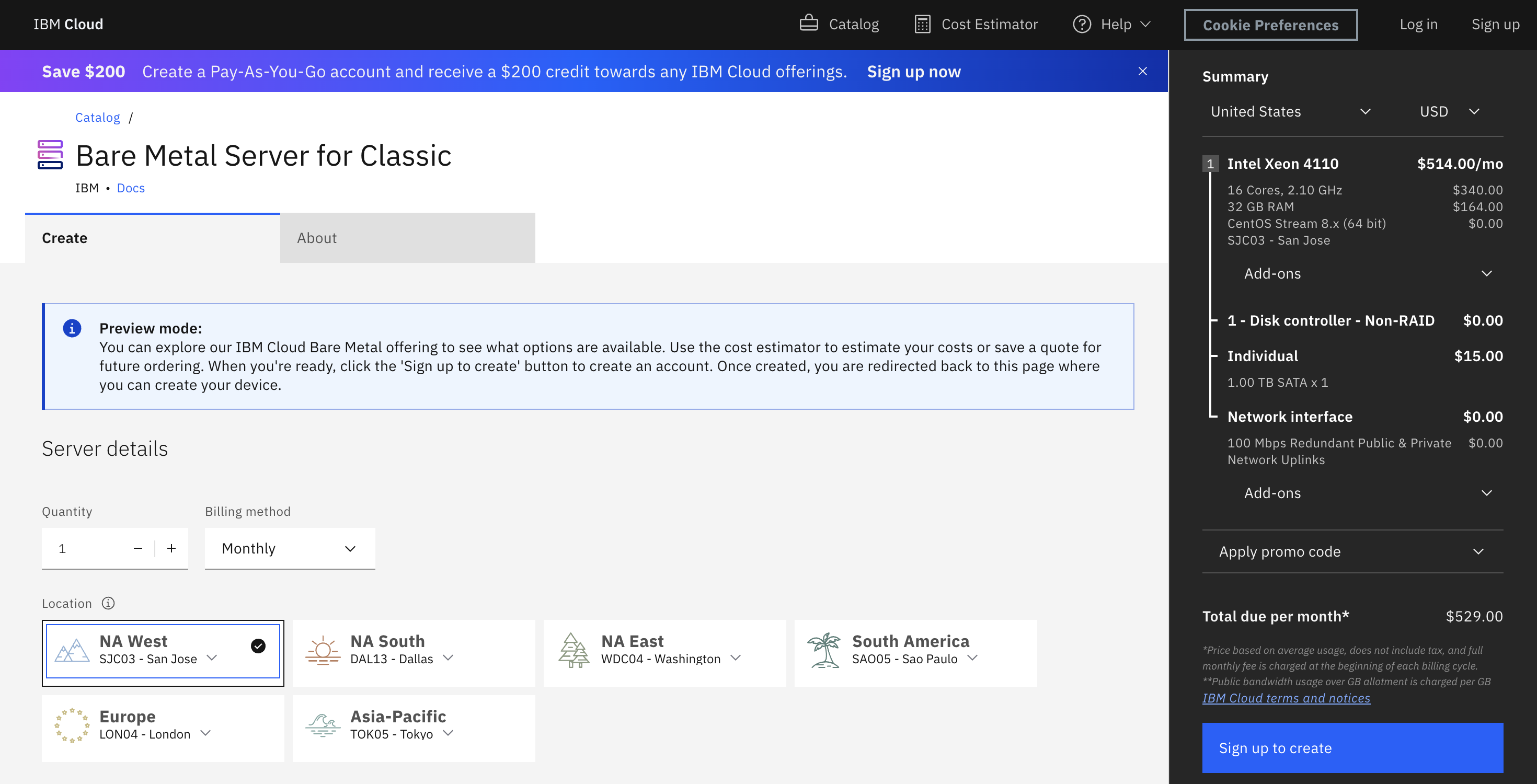

10. IBM Cloud GPU

IBM Cloud GPU'en bruger et globalt spredt netværk af datacentre til at tilbyde fleksible servervalgsprocedurer og glat forbindelse med IBM's cloud-arkitektur, API'er og applikationer.

Med Intel Xeon 4210, Xeon 5218 og Xeon 6248 GPU-forekomster tilbyder den bare-metal Server GPU-muligheden.

Du kan udføre højtydende, latenstidsfølsomme, specialiserede og konventionelle arbejdsbelastninger direkte på serverhardware ved hjælp af bare-metal-instanser, ligesom de kunne med on-premise GPU'er.

For deres bare-metal-servermulighed leverer de også instanser med NVIDIA T4 GPU'er og Intel Xeon-processorer med op til 40 kerner, samt instanser til deres virtuelle serveralternativer med NVIDIA V100- og P100-modeller.

Priser

Prisen starter ved $514/måned for Intel Xeon4110.

Konklusion

Endelig er de bedste cloud-GPU-tjenester til AI dem, der tilbyder stærke GPU-ressourcer, tilpasningsdygtige prisvalg og enkel skalering.

Alle de virksomheder, der leverer GPU-instanser til AI-arbejdsbelastninger - AWS, NVIDIA, IBM og GCP - har fremragende produktlinjer med hensyn til ydeevne og funktionalitet.

Den bedste mulighed bestemmes i sidste ende af dine unikke krav, økonomiske begrænsninger, infrastruktur, der allerede er på plads, og leverandørpræferencer.

Giv en kommentar