És possible que hagis sentit a parlar de com s'han convertit els models d'IA de text a imatge en els últims dos anys. Però sabíeu que la mateixa tecnologia podria ajudar a fer el salt del 2D al 3D?

Els models 3D generats per IA tenen un ampli cas d'ús en el panorama digital actual. Videojocs i el cinema depenen d'artistes 3D experts i de programari de modelatge com Blender per crear actius en 3D per omplir escenes generades per ordinador.

Tanmateix, és possible que la indústria pugui utilitzar l'aprenentatge automàtic per crear actius en 3D amb menys esforç, de manera similar a com els artistes en 2D d'avui comencen a adoptar tecnologia com DALL-E i A mig camí?

Aquest article explorarà un algorisme nou que intenta crear un model eficaç de text a 3D utilitzant l'existent models de difusió.

Què és Dreamfusion?

Un dels principals problemes amb la creació d'un model de difusió que generi directament actius 3D és que simplement no hi ha moltes dades 3D disponibles. Els models de difusió 2D s'han tornat tan poderosos a causa del gran conjunt de dades d'imatges que es troben a Internet. No es pot dir el mateix amb els actius en 3D.

Algunes tècniques generatives 3D treballen per solucionar aquesta manca de dades aprofitant aquesta abundància de dades en 2D.

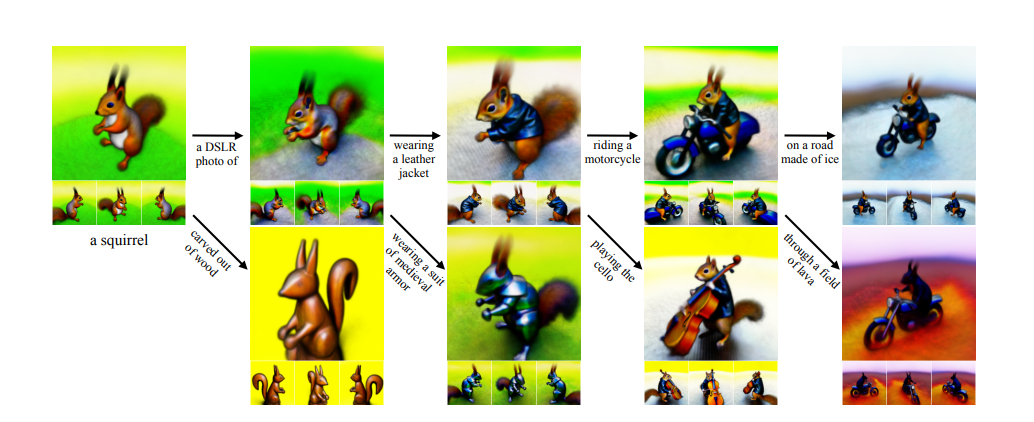

DreamFusion és un model generatiu que pot crear models 3D basats en una descripció de text proporcionada. El model DreamFusion utilitza un model de difusió de text a imatge prèviament entrenat per generar models tridimensionals realistes a partir d'indicacions de text.

Tot i no tenir dades d'entrenament en 3D, aquest enfocament ha generat actius 3D coherents amb un aspecte i una profunditat d'alta fidelitat.

Com funciona?

L'algorisme DreamFusion consta de dos models principals: un model de difusió 2D i un xarxa neural que pot convertir imatges 2D en una escena 3D cohesionada.

Model de text a imatge d'Imatge de Google

La primera part de l'algorisme és el model de difusió. Aquest model s'encarrega de convertir text en imatges.

Imatge és un model de difusió que pot generar una gran mostra de variacions d'imatge d'un objecte concret. En aquest cas, les nostres variacions d'imatge haurien de cobrir tots els angles possibles de l'objecte proporcionat. Per exemple, si volguéssim generar un model 3D d'un cavall, voldríem imatges en 2D del cavall des de tots els angles possibles. L'objectiu és utilitzar Imagen per proporcionar la màxima informació possible (colors, reflexos, densitat) per al següent model del nostre algorisme.

Creació de models 3D amb NeRF

A continuació, Dreamfusion utilitza un model conegut com a Camp de radiació neuronal o NeRF per crear realment el model 3D a partir del conjunt d'imatges generades. Els NeRF són capaços de crear escenes 3D complexes a partir d'un conjunt de dades d'imatges en 2D.

Intentem entendre com funciona un NeRF.

El model pretén crear una funció d'escena volumètrica contínua optimitzada a partir del conjunt de dades proporcionat d'imatges 2D.

Si el model crea una funció, quines són les entrades i les sortides?

La funció d'escena té com a entrada una ubicació 3D i una direcció de visualització en 2D. Aleshores, la funció emet un color (en forma de RGB) i una densitat de volum específica.

Per generar una imatge 2D des d'un punt de vista específic, el model generarà un conjunt de punts 3D i executarà aquests punts a través de la funció d'escena per retornar un conjunt de valors de densitat de color i volum. Les tècniques de renderització de volum convertiran aquests valors en una sortida d'imatge 2D.

Ús conjuntament de models de difusió 2D i NeRF

Ara que sabem com funciona un NeRF, vegem com aquest model pot generar models 3D precisos a partir de les nostres imatges generades.

Per a cada missatge de text proporcionat, DreamFusion entrena un NeRF inicialitzat aleatòriament des de zero. Cada iteració tria una posició aleatòria de la càmera en un conjunt de coordenades esfèriques. Penseu en el model encastat en una esfera de vidre. Cada vegada que generem una nova imatge del nostre model 3D, triarem un punt aleatori de la nostra esfera com a punt de vista de la nostra sortida. DreamFusion també triarà una posició de llum aleatòria l per utilitzar per a la representació.

Un cop tinguem una càmera i una posició de llum, es renderitzarà un model NeRF. DreamFusion també triarà aleatòriament entre una representació de colors, una representació sense textura i una representació de l'albedo sense cap ombrejat.

Hem esmentat anteriorment que volem que el nostre model de text a imatge (Imagen) produeixi prou imatges per crear una mostra representativa.

Com ho aconsegueix Dreamfusion?

Dreamfusion simplement modifica lleugerament el missatge d'entrada per aconseguir els angles previstos. Per exemple, podem aconseguir angles d'elevació elevats afegint "vista aérea" al nostre missatge. Podem generar altres angles afegint frases com ara "vista frontal", "vista lateral" i "vista posterior".

Les escenes es representen repetidament des de posicions aleatòries de la càmera. Aquestes representacions passen després per una funció de pèrdua de destil·lació de puntuació. Un enfocament senzill de descens de gradients millorarà lentament Model 3D fins que coincideixi amb l'escena descrita pel text.

Un cop hàgim representat el model 3D amb NeRF, podem utilitzar el Algorisme Marching Cubes per generar una malla 3D del nostre model. Aquesta malla es pot importar a renderitzadors 3D populars o programari de modelatge.

Limitacions

Tot i que la sortida de DreamFusion és prou impressionant, ja que utilitza models de difusió de text a imatge existents d'una manera nova, els investigadors han observat algunes limitacions.

S'ha observat que la funció de pèrdua de SDS produeix resultats sobresaturats i suavitzats. Podeu observar-ho en la coloració antinatural i la manca de detalls precís que es troben a les sortides.

L'algorisme DreamFusion també està limitat per la resolució de la sortida del model Imagen, que és de 64 x 64 píxels. Això fa que els models sintetitzats no tinguin detalls més fins.

Finalment, els investigadors han observat que hi ha un repte inherent a la síntesi de models 3D a partir de dades 2D. Hi ha molts models 3D possibles que podem generar a partir d'un conjunt d'imatges en 2D, la qual cosa fa que l'optimització sigui força difícil i fins i tot ambigua.

Conclusió

Les representacions 3D de DreamFusion funcionen molt bé a causa de la capacitat dels models de difusió de text a imatge per crear qualsevol objecte o escena. És impressionant com una xarxa neuronal pot entendre una escena a l'espai 3D sense cap dada d'entrenament en 3D. Recomano llegir el paper sencer per obtenir més informació sobre els detalls tècnics de l'algoritme DreamFusion.

Amb sort, aquesta tecnologia millorarà per crear models 3D fotorealistes. Imagineu videojocs o simulacions sencers que utilitzen entorns generats per IA. Podria reduir la barrera d'entrada dels desenvolupadors de videojocs per crear mons en 3D immersius!

Quin paper creus que jugaran els models de text a 3D en el futur?

Deixa un comentari