Taula de continguts[Amaga][Espectacle]

El futur és aquí. I, en aquest futur, les màquines comprenen el món que les envolta de la mateixa manera que ho fan les persones. Els ordinadors poden conduir automòbils, diagnosticar malalties i predir el futur amb precisió.

Això pot semblar ciència ficció, però els models d'aprenentatge profund ho estan fent realitat.

Aquests algorismes sofisticats estan revelant els secrets de intel·ligència artificial, permetent que els ordinadors s'autoaprendran i es desenvolupin. En aquesta publicació, ens endinsarem en l'àmbit dels models d'aprenentatge profund.

I, investigarem l'enorme potencial que tenen per revolucionar les nostres vides. Prepareu-vos per conèixer la tecnologia d'avantguarda que està canviant el futur de la humanitat.

Què són exactament els models d'aprenentatge profund?

Has jugat mai a un joc en què has d'identificar les diferències entre dues imatges?

És divertit, però, també pot ser difícil, oi? Imagineu poder ensenyar a un ordinador a jugar a aquest joc i guanyar cada cop. Els models d'aprenentatge profund aconsegueixen això!

Els models d'aprenentatge profund són similars a les màquines súper intel·ligents que poden examinar un gran nombre d'imatges i determinar què tenen en comú. Ho aconsegueixen desmuntant les imatges i estudiant cadascuna individualment.

A continuació, apliquen el que han après per identificar patrons i fer prediccions sobre imatges noves que mai abans havien vist.

Els models d'aprenentatge profund són xarxes neuronals artificials que poden aprendre i extreure patrons i característiques complicats de conjunts de dades massius. Aquests models estan formats per diverses capes de nodes enllaçats, o neurones, que analitzen i canvien les dades entrants per generar una sortida.

Els models d'aprenentatge profund són especialment adequats per a feines que requereixen una gran precisió i precisió, com ara la identificació d'imatges, el reconeixement de veu, el processament del llenguatge natural i la robòtica.

S'han utilitzat en tot, des de cotxes autònoms fins a diagnòstics mèdics, sistemes de recomanació i analítica predictiva.

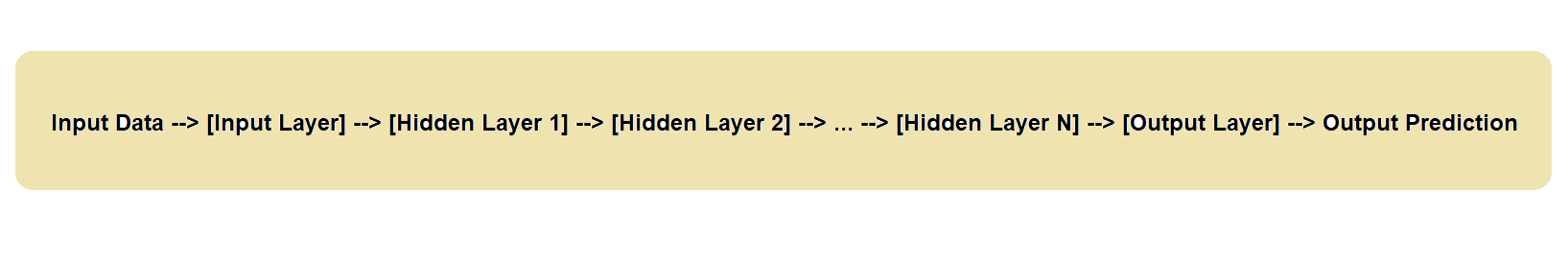

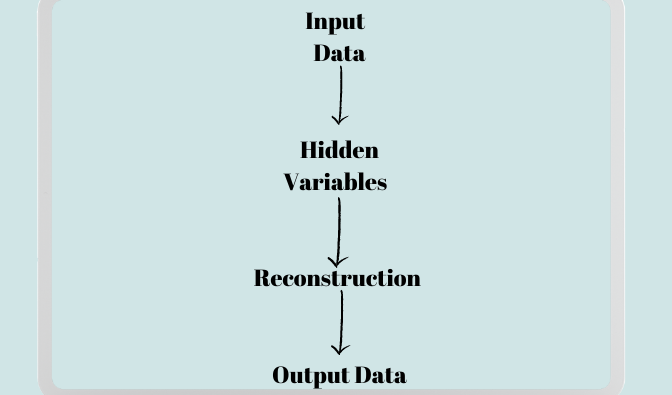

Aquí hi ha una versió simplificada de la visualització per il·lustrar el flux de dades en un model d'aprenentatge profund.

Les dades d'entrada flueixen a la capa d'entrada del model, que després passa les dades a través d'una sèrie de capes ocultes abans de proporcionar una predicció de sortida.

Cada capa oculta realitza una sèrie d'operacions matemàtiques sobre les dades d'entrada abans de passar-les a la següent capa, que proporciona la predicció final.

Ara, anem a veure quins són els models d'aprenentatge profund i com els podem utilitzar a la nostra vida.

1. Xarxes neuronals convolucionals (CNN)

Les CNN són un model d'aprenentatge profund que ha transformat l'àrea de la visió per ordinador. Les CNN s'utilitzen per classificar imatges, reconèixer objectes i segmentar imatges. L'estructura i la funció de l'escorça visual humana van informar el disseny de les CNN.

Com funcionen?

Una CNN està formada per una sèrie de capes convolucionals, capes d'agrupació i capes totalment enllaçades. L'entrada és una imatge i la sortida és una predicció de l'etiqueta de classe de la imatge.

Les capes convolucionals d'una CNN creen un mapa de característiques realitzant un producte de punts entre la imatge d'entrada i un conjunt de filtres. Les capes d'agrupació redueixen la mida del mapa de característiques reduint-lo.

Finalment, les capes completament connectades utilitzen el mapa de característiques per predir l'etiqueta de classe de la imatge.

Per què són importants les CNN?

Les CNN són essencials perquè poden aprendre a detectar patrons i característiques en imatges que la gent troba difícil de notar. Es pot ensenyar als CNN a reconèixer característiques com ara vores, cantonades i textures mitjançant grans conjunts de dades. Després d'aprendre aquestes propietats, una CNN les pot utilitzar per identificar objectes en fotos noves. Les CNN han demostrat un rendiment d'avantguarda en una varietat d'aplicacions d'identificació d'imatges.

On fem servir les CNN

La salut, la indústria de l'automòbil i el comerç minorista són només alguns dels sectors que utilitzen CNN. A la indústria sanitària, poden ser beneficiosos per al diagnòstic de malalties, el desenvolupament de medicaments i l'anàlisi d'imatges mèdiques.

En el sector de l'automòbil, ajuden a la detecció de carrils, detecció d'objectes, i conducció autònoma. També s'utilitzen molt al detall per a la cerca visual, la recomanació de productes basada en imatges i el control d'inventari.

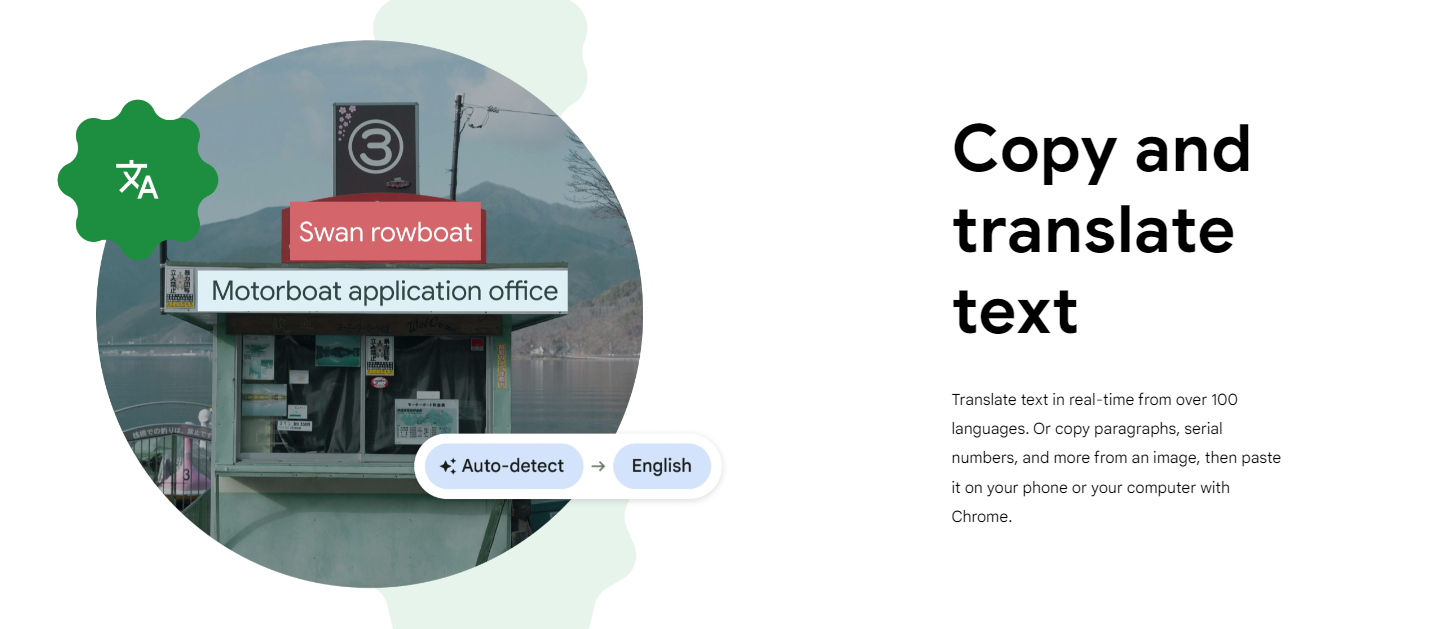

Per exemple; Google utilitza CNN en una varietat d'aplicacions, com ara Lent de Google, una eina d'identificació d'imatges molt popular. El programa utilitza CNN per avaluar fotografies i donar informació als usuaris.

Google Lens, per exemple, pot reconèixer coses en una imatge i oferir-ne detalls, com ara el tipus de flor.

També pot traduir el text que s'extreu d'una imatge a diversos idiomes. Google Lens és capaç de proporcionar als consumidors informació útil gràcies a l'assistència de les CNN per identificar amb precisió els articles i extreure característiques de les fotos.

2. Xarxes de memòria a curt termini (LSTM).

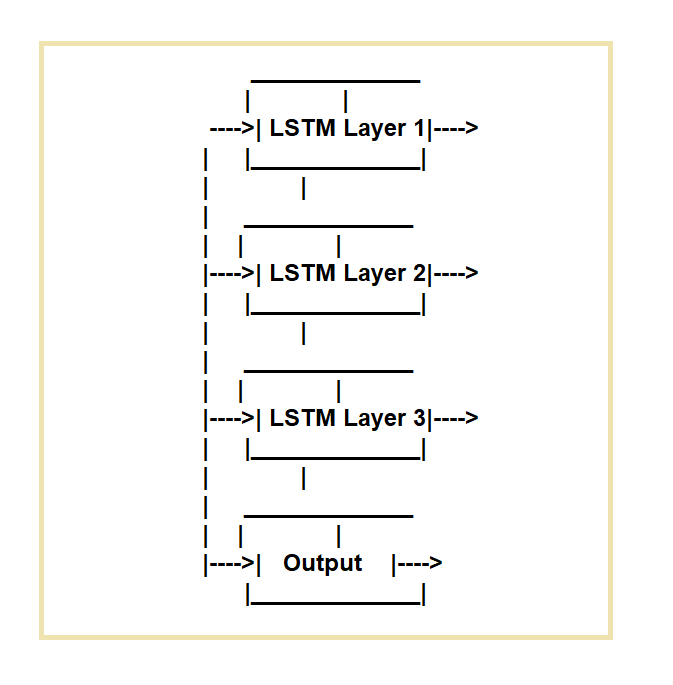

Les xarxes de memòria a curt termini (LSTM) es creen per abordar les deficiències de les xarxes neuronals recurrents (RNN). Les xarxes LSTM són ideals per a tasques que exigeixen el processament de seqüències de dades al llarg del temps.

Funcionen emprant una cèl·lula de memòria específica i tres mecanismes de gating.

Regulan el flux d'informació dins i fora de la cèl·lula. La porta d'entrada, la porta oblidada i la porta de sortida són les tres portes.

La porta d'entrada regula el flux de dades a la cel·la de memòria, la porta d'oblit regula l'eliminació de dades de la cel·la i la porta de sortida regula el flux de dades fora de la cel·la.

Quina és la seva importància?

Les xarxes LSTM són útils perquè poden representar i preveure amb èxit seqüències de dades amb relacions a llarg termini. Poden registrar i retenir informació sobre entrades anteriors, cosa que els permet fer prediccions més precises sobre entrades futures.

El reconeixement de veu, el reconeixement d'escriptura a mà, el processament del llenguatge natural i els subtítols d'imatges són només algunes de les aplicacions que han fet ús de les xarxes LSTM.

On fem servir les xarxes LSTM?

Moltes aplicacions de programari i tecnologia utilitzen xarxes LSTM, inclosos sistemes de reconeixement de veu, eines de processament de llenguatges naturals com ara anàlisi del sentiment, sistemes de traducció automàtica i sistemes de generació de text i imatges.

També s'han utilitzat en la creació de cotxes i robots autònoms, així com en el sector financer per detectar fraus i anticipar-se. del mercat de valors moviments.

3. Xarxes adversàries generatives (GAN)

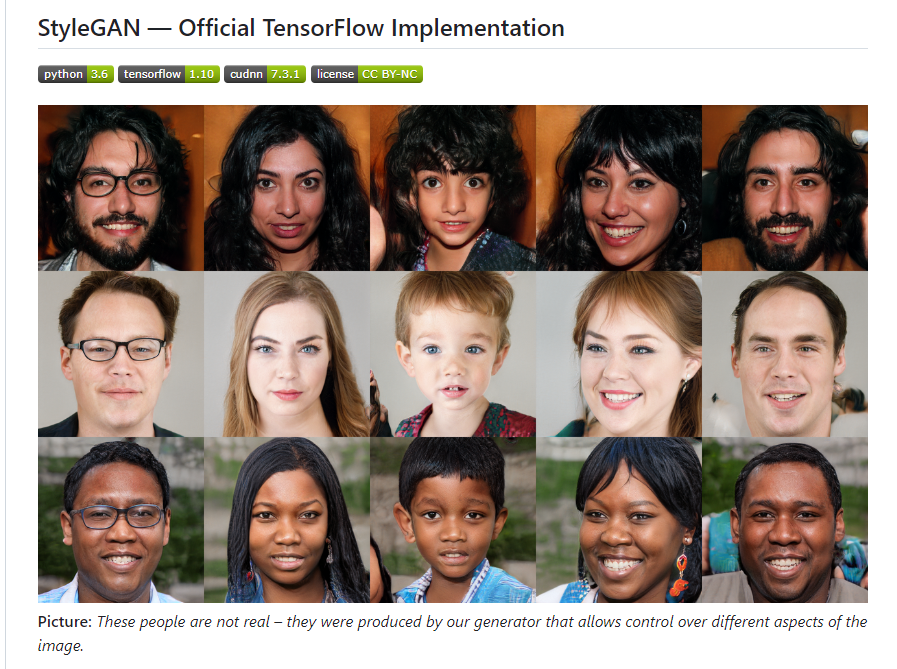

Els GAN són a aprenentatge profund tècnica que s'utilitza per generar noves mostres de dades similars a un conjunt de dades determinat. Els GAN estan formats per dos xarxes neuronals: un que aprèn a produir noves mostres i un que aprèn a distingir entre mostres genuïnes i generades.

En un enfocament similar, aquestes dues xarxes s'entrenen juntes fins que el generador pot generar mostres que no es poden distingir de les reals.

Per què utilitzem GAN

Els GAN són importants per la seva capacitat de produir de gran qualitat dades sintètiques que es poden utilitzar per a una varietat d'aplicacions, com ara la producció d'imatges i vídeos, la generació de text i fins i tot la generació de música.

Els GAN també s'han utilitzat per augmentar les dades, que és la generació de dades sintètiques per complementar les dades del món real i millorar el rendiment dels models d'aprenentatge automàtic.

A més, mitjançant la creació de dades sintètiques que es poden utilitzar per entrenar models i imitar assajos, les GAN tenen el potencial de transformar sectors com la medicina i el desenvolupament de fàrmacs.

Aplicacions dels GAN

Els GAN poden complementar conjunts de dades, crear noves imatges o pel·lícules i fins i tot generar dades sintètiques per a simulacions científiques. A més, els GAN tenen el potencial d'utilitzar-se en una varietat d'aplicacions que van des d'entreteniment a mèdiques.

edats i vídeos. StyleGAN2 de NVIDIA, per exemple, s'ha utilitzat per crear fotografies d'alta qualitat de celebritats i obres d'art.

4. Xarxes de creences profundes (DBN)

Les xarxes de creences profundes (DBN) són intel·ligència artificial sistemes que poden aprendre a detectar patrons en les dades. Ho aconsegueixen segmentant les dades en trossos cada cop més petits, obtenint-ne una comprensió més completa a cada nivell.

Els DBN poden aprendre de les dades sense ser informats de què són (això s'anomena "aprenentatge no supervisat"). Això els fa extremadament valuosos per detectar patrons en dades que una persona trobaria difícil o impossible de discernir.

Què fa que els DBN siguin significatius?

Els DBN són importants per la seva capacitat per aprendre representacions de dades jeràrquiques. Aquestes representacions es poden utilitzar per a una varietat d'aplicacions com la classificació, la detecció d'anomalies i la reducció de la dimensionalitat.

La capacitat dels DBN per dur a terme una formació prèvia no supervisada, que pot augmentar el rendiment dels models d'aprenentatge profund amb dades mínimes etiquetades, és un benefici important.

Quines són les aplicacions dels DBN?

Una de les aplicacions més significatives és detecció d'objectes, en què els DBN s'utilitzen per reconèixer certs tipus de coses com ara avions, ocells i humans. També s'utilitzen per a la generació i classificació d'imatges, la detecció de moviment en pel·lícules i la comprensió del llenguatge natural per al processament de la veu.

A més, els DBN s'utilitzen habitualment en conjunts de dades per avaluar les postures humanes. Els DBN són una gran eina per a diverses indústries, com ara la sanitat i la banca i la tecnologia.

5. Xarxes d'aprenentatge de reforç profund (DRL)

profund Aprenentatge de reforç Les xarxes (DRL) integren xarxes neuronals profundes amb tècniques d'aprenentatge de reforç per permetre que els agents aprenguin en un entorn complicat mitjançant assaig i error.

Els DRL s'utilitzen per ensenyar als agents a optimitzar un senyal de recompensa interactuant amb el seu entorn i aprenent dels seus errors.

Què els fa remarcables?

S'han utilitzat eficaçment en una varietat d'aplicacions, com ara jocs, robòtica i conducció autònoma. Els DRL són importants perquè poden aprendre directament de l'entrada sensorial en brut, cosa que permet als agents prendre decisions en funció de les seves interaccions amb l'entorn.

Aplicacions importants

Els DRL s'utilitzen en circumstàncies del món real perquè poden gestionar problemes difícils.

Els DRL s'han inclòs en diverses plataformes tecnològiques i de programari destacades, inclòs OpenAI's Gym, Agents ML d'Unity, i DeepMind Lab de Google. AlphaGo, creat per Google DeepMind, per exemple, utilitza DRL per jugar al joc de taula Go a nivell de campió del món.

Un altre ús de DRL és en robòtica, on s'utilitza per controlar els moviments dels braços robòtics per executar tasques com agafar coses o apilar blocs. Els DRL tenen molts usos i són una eina útil formar agents per aprendre i prendre decisions en entorns complicats.

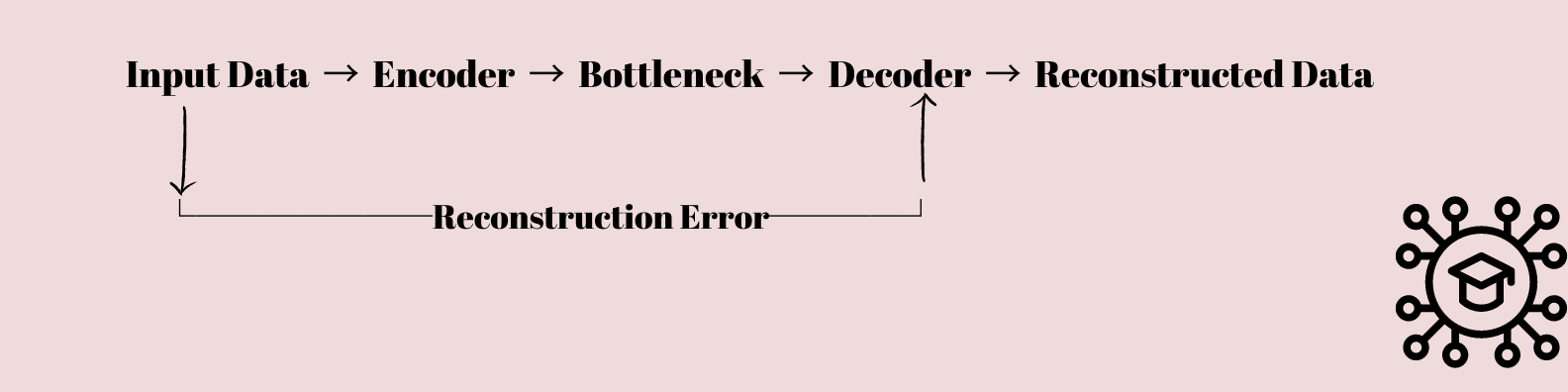

6. Autoencoders

Els codificadors automàtics són un tipus interessant xarxa neural que ha despertat l'interès tant dels estudiosos com dels científics de dades. Estan dissenyats fonamentalment per aprendre a comprimir i restaurar dades.

Les dades d'entrada s'alimenten a través d'una successió de capes que redueixen gradualment la dimensionalitat de les dades fins que es comprimeixen en una capa de coll d'ampolla amb menys nodes que les capes d'entrada i sortida.

Aquesta representació comprimida s'utilitza per recrear les dades d'entrada originals mitjançant una seqüència de capes que augmenten gradualment la dimensionalitat de les dades fins a la seva forma original.

Per què és important?

Els codificadors automàtics són un component crucial de aprenentatge profund perquè fan possible l'extracció de característiques i la reducció de dades.

Són capaços d'identificar els elements clau de les dades entrants i traduir-los en una forma comprimida que després es pot aplicar a altres tasques com la classificació, l'agrupació o la creació de noves dades.

On utilitzem els codificadors automàtics?

Detecció d'anomalies, processament del llenguatge natural i visió per computadora són només algunes de les disciplines on s'utilitzen codificadors automàtics. Els codificadors automàtics, per exemple, es poden utilitzar per a la compressió d'imatges, la eliminació de sorolls i la síntesi d'imatges en visió per ordinador.

Podem utilitzar els codificadors automàtics en tasques com la creació de text, la categorització de text i el resum de text en el processament del llenguatge natural. Pot identificar l'activitat anòmala en dades que s'allunyen de la norma en la identificació d'anomalies.

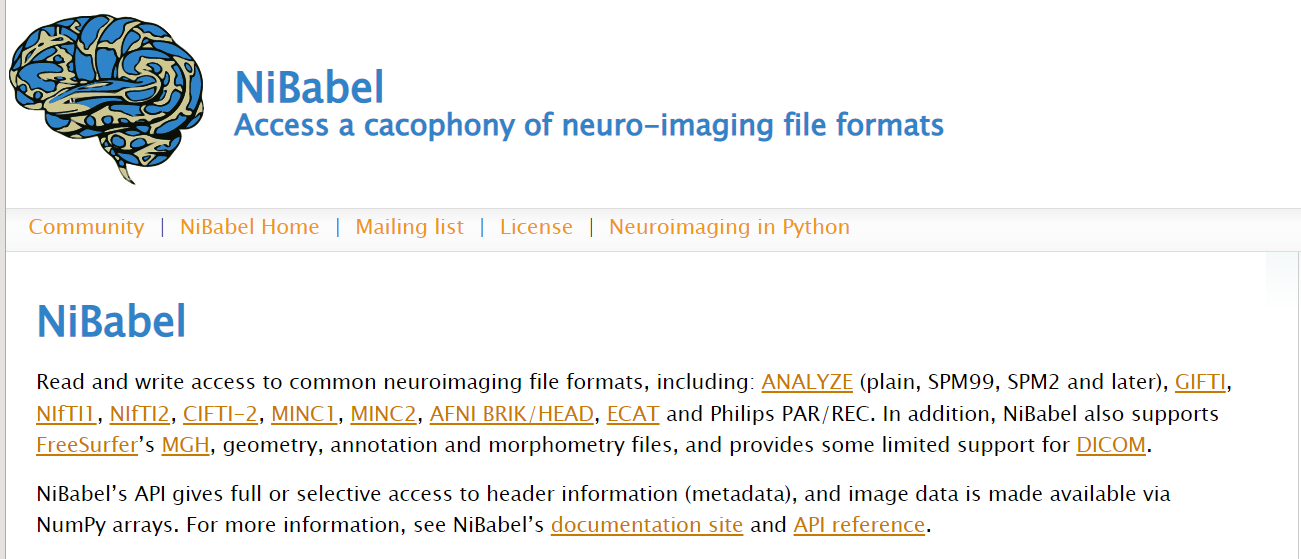

7. Xarxes càpsules

Capsule Networks és una nova arquitectura d'aprenentatge profund que es va desenvolupar com a substitució de les xarxes neuronals convolucionals (CNN).

Les xarxes de càpsules es basen en la noció d'agrupar unitats cerebrals anomenades càpsules que s'encarreguen de reconèixer l'existència d'un determinat element en una imatge i codificar els seus atributs, com l'orientació i la posició, en els seus vectors de sortida. Per tant, les xarxes càpsules poden gestionar les interaccions espacials i les fluctuacions de perspectiva millor que les CNN.

Per què escollim les xarxes càpsules a les de CNN?

Les xarxes càpsules són útils perquè superen les dificultats de la CNN per capturar relacions jeràrquiques entre els elements d'una imatge. Les CNN poden reconèixer coses de diferents mides, però lluiten per comprendre com aquests elements es connecten entre si.

Capsule Networks, d'altra banda, poden aprendre a reconèixer les coses i les seves peces, així com com es col·loquen espacialment en una imatge, la qual cosa les converteix en un competidor viable per a aplicacions de visió per computador.

Àrees d'Aplicacions

Capsule Networks ja han demostrat resultats prometedors en una varietat d'aplicacions, inclosa la classificació d'imatges, la identificació d'objectes i la segmentació d'imatges.

S'han utilitzat per distingir coses a les fotos mèdiques, reconèixer persones en pel·lícules i fins i tot crear models 3D a partir d'imatges en 2D.

Per augmentar el seu rendiment, les xarxes càpsules s'han combinat amb altres arquitectures d'aprenentatge profund com les xarxes generatives adversàries (GAN) i els codificadors automàtics variacionals (VAE). Es preveu que les xarxes càpsules tinguin un paper cada cop més vital en la millora de les tecnologies de visió per ordinador a mesura que evoluciona la ciència de l'aprenentatge profund.

Per exemple; Nibabel és una eina Python coneguda per llegir i escriure tipus de fitxers de neuroimatge. Per a la segmentació d'imatges, utilitza les xarxes de càpsules.

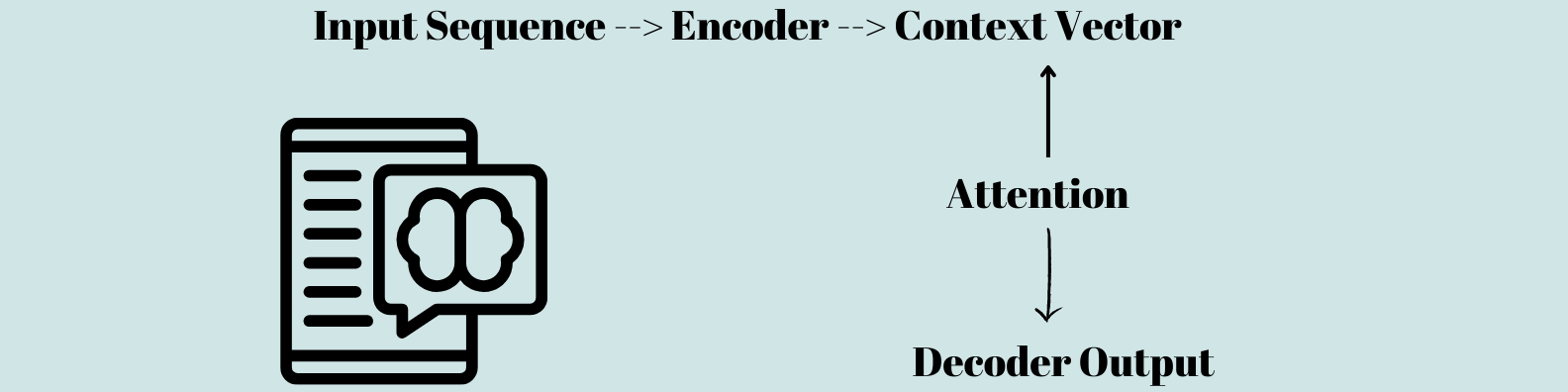

8. Models basats en l'atenció

Els models d'aprenentatge profund coneguts com a models basats en l'atenció, també coneguts com a mecanismes d'atenció, s'esforcen per augmentar la precisió de models d’aprenentatge automàtic. Aquests models funcionen concentrant-se en determinades característiques de les dades entrants, donant lloc a un processament més eficient i eficaç.

En tasques de processament del llenguatge natural, com ara la traducció automàtica i l'anàlisi de sentiments, els mètodes d'atenció han demostrat tenir bastant èxit.

Quina importància tenen?

Els models basats en l'atenció són útils perquè permeten un processament més eficaç i eficient de dades complicades.

Xarxes neuronals tradicionals avaluar totes les dades d'entrada com a igual d'importants, donant lloc a un processament més lent i una precisió reduïda. Els processos d'atenció es concentren en aspectes crucials de les dades d'entrada, permetent prediccions més ràpides i precises.

Àrees d'ús

En l'àmbit de la intel·ligència artificial, els mecanismes d'atenció tenen una àmplia gamma d'aplicacions, com ara el processament del llenguatge natural, el reconeixement d'imatges i àudio, i fins i tot els vehicles sense conductor.

Els mètodes d'atenció, per exemple, es poden utilitzar per millorar la traducció automàtica en el processament del llenguatge natural permetent al sistema centrar-se en determinades paraules o frases que són essencials per al context.

Es poden utilitzar mètodes d'atenció en cotxes autònoms per ajudar el sistema a centrar-se en determinats elements o reptes del seu entorn.

9. Xarxes de transformadors

Les xarxes transformadores són models d'aprenentatge profund que examinen i produeixen seqüències de dades. Funcionen processant la seqüència d'entrada un element a la vegada i produint una seqüència de sortida de longituds iguals o diferents.

Les xarxes de transformadors, a diferència dels models estàndard de seqüència a seqüència, no processen seqüències mitjançant xarxes neuronals recurrents (RNN). En canvi, utilitzen processos d'autoatenció per aprendre els vincles entre les peces de la seqüència.

Quina és la importància de les xarxes de transformadors?

Les xarxes transformadores han crescut en popularitat en els últims anys com a resultat del seu millor rendiment en treballs de processament de llenguatge natural.

Són especialment adequats per a tasques de creació de text, com ara traducció d'idiomes, resum de text i producció de converses.

Les xarxes de transformadors són significativament més eficients computacionalment que els models basats en RNN, cosa que els converteix en una opció preferida per a aplicacions a gran escala.

On es poden trobar xarxes de transformadors?

Les xarxes transformadores s'utilitzen àmpliament en una àmplia gamma d'aplicacions, sobretot en el processament del llenguatge natural.

La sèrie GPT (Generative Pre-Trained Transformer) és un model destacat basat en transformadors que s'ha utilitzat per a tasques com ara la traducció d'idiomes, el resum de text i la generació de chatbots.

BERT (Representacions de codificadors bidireccionals de transformadors) és un altre model comú basat en transformadors que s'ha utilitzat per a aplicacions de comprensió del llenguatge natural, com ara la resposta a preguntes i l'anàlisi de sentiments.

Tots dos GPT i BERT es van crear amb PyTorch, un marc d'aprenentatge profund de codi obert que ha estat popular per desenvolupar models basats en transformadors.

10. Màquines Boltzmann restringides (RBM)

Les màquines de Boltzmann restringides (RBM) són una mena de xarxa neuronal no supervisada que aprèn de manera generativa. A causa de la seva capacitat per aprendre i extreure característiques essencials de dades d'alta dimensió, s'han utilitzat àmpliament en els camps de l'aprenentatge automàtic i l'aprenentatge profund.

Els RBM estan formats per dues capes, visibles i ocultes, amb cada capa formada per un grup de neurones connectades per vores ponderades. Els RBM estan dissenyats per aprendre una distribució de probabilitat que descrigui les dades d'entrada.

Què són les màquines Boltzmann restringides?

Els RBM utilitzen una estratègia d'aprenentatge generatiu. En els RBM, la capa visible reflecteix les dades d'entrada, mentre que la capa soterrada codifica les característiques de les dades d'entrada. Els pesos de les capes visibles i ocultes mostren la força del seu enllaç.

Els RBM ajusten els pesos i els biaixos entre les capes durant l'entrenament mitjançant una tècnica coneguda com a divergència contrastiva. La divergència contrastiva és una estratègia d'aprenentatge no supervisada que maximitza la probabilitat de predicció del model.

Quina és la importància de les màquines Boltzmann restringides?

Els RBM són importants màquina d'aprenentatge i aprenentatge profund perquè poden aprendre i extreure característiques rellevants de grans quantitats de dades.

Són molt efectius per al reconeixement d'imatges i de veu, i s'han utilitzat en una varietat d'aplicacions com sistemes de recomanació, detecció d'anomalies i reducció de dimensionalitat. Els RBM poden trobar patrons en grans conjunts de dades, donant lloc a prediccions i coneixements superiors.

On es poden utilitzar les màquines Boltzmann restringides?

Les aplicacions dels RBM inclouen la reducció de la dimensionalitat, la detecció d'anomalies i els sistemes de recomanació. Els RBM són especialment útils per a l'anàlisi de sentiments i modelització de temes en el context del processament del llenguatge natural.

Les xarxes de creences profundes, una mena de xarxa neuronal utilitzada per al reconeixement de veu i imatges, també utilitzen RBM. La caixa d'eines de la xarxa Deep Belief, TensorFlowi Teano són alguns exemples concrets de programari o tecnologia que utilitza RBM.

Embolicar

Els models d'aprenentatge profund són cada cop més crucials en diverses indústries, com ara el reconeixement de la parla, el processament del llenguatge natural i la visió per ordinador.

Les xarxes neuronals convolucionals (CNN) i les xarxes neuronals recurrents (RNN) són les més prometedores i s'utilitzen àmpliament en moltes aplicacions, però, tots els models d'aprenentatge profund tenen els seus avantatges i desavantatges.

Tanmateix, els investigadors encara estan investigant les màquines Boltzmann restringides (RBM) i altres varietats de models d'aprenentatge profund perquè també tenen avantatges especials.

Es preveu que es creïn models nous i creatius a mesura que l'àrea d'aprenentatge profund segueixi avançant per tal de fer front a problemes més difícils.

Deixa un comentari