Съдържание[Крия][Покажи]

Един от основните критерии за всеки вид корпоративна дейност е ефективното използване на информацията. В даден момент обемът на създадените данни надвишава капацитета на основната обработка.

Това е мястото, където алгоритмите за машинно обучение влизат в игра. Въпреки това, преди нещо от това да се случи, информацията трябва да бъде проучена и интерпретирана. С две думи, това е, за което се използва неконтролираното машинно обучение.

В тази статия ще разгледаме в дълбочина неконтролираното машинно обучение, включително неговите алгоритми, случаи на употреба и много повече.

Какво е неконтролирано машинно обучение?

Алгоритмите за машинно обучение без надзор идентифицират модели в набор от данни, които нямат известни или етикетирани последствия. Под наблюдение алгоритми за машинно обучение имат етикетиран изход.

Познаването на това разграничение ви помага да разберете защо методите за машинно обучение без надзор не могат да се използват за решаване на проблеми с регресия или класификация, тъй като не знаете каква може да бъде стойността/отговорът за изходните данни. Не можете да тренирате алгоритъм нормално, ако не знаете стойността/отговора.

Освен това обучението без надзор може да се използва за идентифициране на фундаменталната структура на данните. Тези алгоритми откриват скрити модели или групи от данни без необходимост от човешко взаимодействие.

Способността му да открива прилики и контрасти в информацията го прави чудесен избор за проучвателен анализ на данни, техники за кръстосани продажби, потребителско сегментиране и идентификация на картина.

Помислете за следния сценарий: вие сте в магазин за хранителни стоки и виждате неидентифициран плод, който никога преди не сте виждали. Можете лесно да различите непознатия плод от другите плодове наоколо въз основа на вашите наблюдения върху неговата форма, размер или цвят.

Алгоритми за машинно обучение без надзор

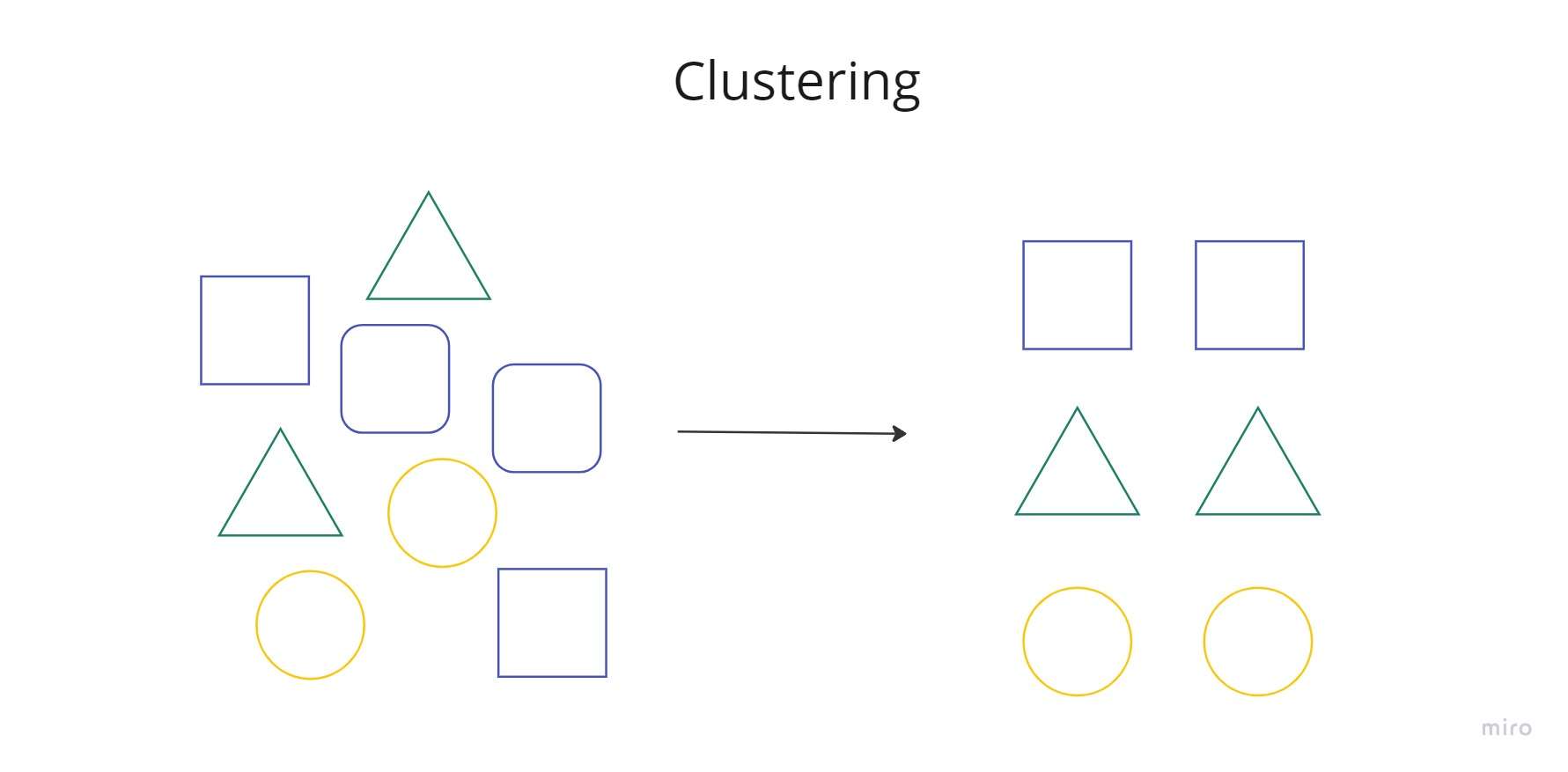

Clustering

Клъстерирането без съмнение е най-широко използваният подход за обучение без надзор. Този подход поставя свързани елементи от данни в произволно генерирани клъстери.

Сам по себе си ML моделът открива всякакви модели, прилики и/или разлики в некатегоризирана структура от данни. Моделът ще може да открие всякакви естествени групи или класове в данните.

Видове

Има няколко форми на групиране, които могат да се използват. Нека първо да разгледаме най-важните.

- Ексклузивното клъстериране, понякога известно като „твърдо“ клъстериране, е вид групиране, при което единична част от данните принадлежи само на един клъстер.

- Припокриващото се клъстериране, често известно като „меко“ клъстериране, позволява на обектите с данни да принадлежат към повече от един клъстер в различна степен. Освен това, вероятностното клъстериране може да се използва за справяне с „меки“ клъстери или проблеми с оценка на плътността, както и за оценка на вероятността или вероятността точките от данни да принадлежат към определени клъстери.

- Създаването на йерархия от групирани елементи от данни е целта на йерархичното групиране, както показва името. Елементите от данни се деконструират или комбинират въз основа на йерархията за генериране на клъстери.

Случаи на употреба:

- Откриване на аномалия:

Всеки тип отклонение в данните може да бъде открито с помощта на групиране. Компаниите в транспорта и логистиката, например, могат да използват откриването на аномалии, за да открият логистични пречки или да разкрият повредени механични части (прогнозна поддръжка).

Финансовите институции могат да използват технологията за откриване на измамни транзакции и да реагират бързо, като потенциално спестяват много пари. Научете повече за откриването на аномалии и измами, като гледате нашето видео.

- Сегментиране на клиенти и пазари:

Алгоритмите за клъстериране могат да помогнат при групирането на хора, които имат сходни характеристики и създаване на потребителски личности за по-ефективен маркетинг и целеви инициативи.

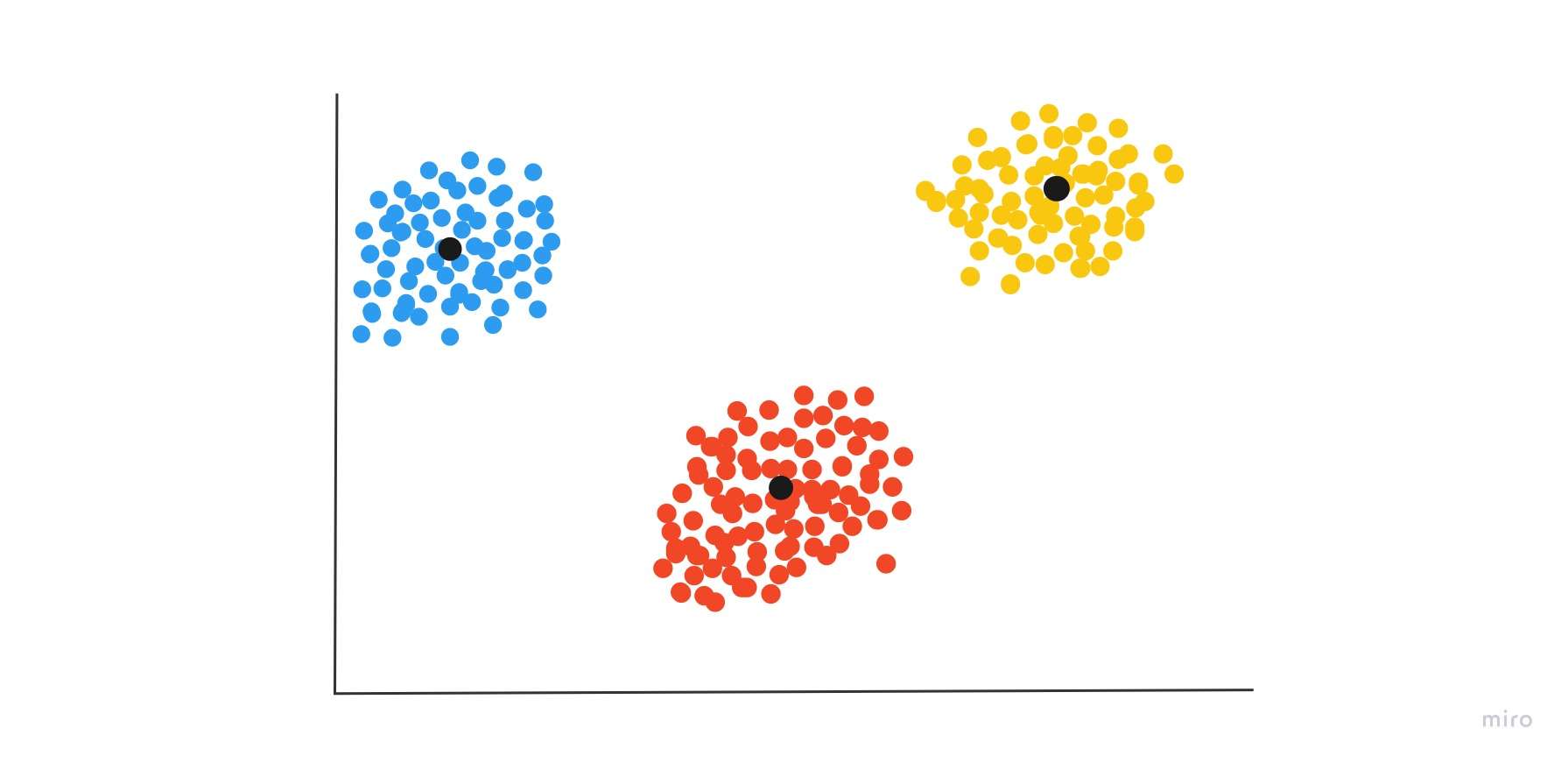

К-средства

K-means е метод за клъстериране, който е известен също като разделяне или сегментиране. Той разделя точките от данни на предварително определен брой клъстери, известни като K.

В метода на K-средствата K е входът, тъй като казвате на компютъра колко клъстера искате да идентифицирате във вашите данни. Всеки елемент от данни впоследствие се присвоява на най-близкия център на клъстера, известен като центроид (черни точки на снимката).

Последните служат като места за съхранение на данни. Техниката на клъстериране може да се извършва многократно, докато клъстерите са добре дефинирани.

Размити К-средства

Fuzzy K-means е разширение на техниката K-means, която се използва за извършване на припокриващо се групиране. За разлика от техниката на K-средни стойности, размитите K-средни стойности показват, че точките от данни могат да принадлежат към много клъстери с различна степен на близост до всеки.

Разстоянието между точките от данни и центроида на клъстера се използва за изчисляване на близостта. В резултат на това може да има случаи, когато различни клъстери се припокриват.

Гаусови смесени модели

Gaussian Mixture Models (GMMs) са метод, използван при вероятностно клъстериране. Тъй като средната стойност и дисперсията са неизвестни, моделите приемат, че има фиксиран брой разпределения на Гаус, всяко от които представлява отделен клъстер.

За да се определи към кой клъстер принадлежи конкретна точка от данни, по същество се използва методът.

Йерархично клъстериране

Стратегията за йерархично клъстериране може да започне с всяка точка от данни, присвоена на различен клъстер. След това двата клъстера, които са най-близо един до друг, се смесват в един клъстер. Итеративното сливане продължава, докато на върха остане само един клъстер.

Този метод е известен като "отдолу нагоре" или агломеративен. Ако започнете с всички елементи от данни, обвързани с един и същи клъстер, и след това провеждате разделяния, докато всеки елемент от данни бъде присвоен като отделен клъстер, методът е известен като йерархично клъстериране отгоре надолу или разделение.

Априорен алгоритъм

Анализът на пазарната кошница популяризира априорните алгоритми, което доведе до различни механизми за препоръки за музикални платформи и онлайн магазини.

Те се използват в набори от транзакционни данни за намиране на често срещани набори от артикули или групи от артикули, за да се предвиди вероятността за потребление на един продукт въз основа на потреблението на друг.

Например, ако започна да пускам радиото на OneRepublic в Spotify с „Counting Stars“, една от другите песни в този канал със сигурност ще бъде песен на Imagine Dragon, като например „Bad Liar“.

Това се основава на предишните ми навици за слушане, както и на моделите на слушане на другите. Априорните методи преброяват набори от елементи с помощта на хеш дърво, преминавайки първо в ширина на набора от данни.

Намаляване на размерите

Намаляването на размерността е вид неконтролирано обучение, което използва набор от стратегии за минимизиране на броя на характеристиките – или измеренията – в набор от данни. Позволете ни да изясним.

Може да бъде изкушаващо да включите възможно най-много данни, докато създавате своя набор от данни за машинно обучение. Не ни разбирайте погрешно: тази стратегия работи добре, тъй като повече данни обикновено водят до по-точни констатации.

Да приемем, че данните се съхраняват в N-измерно пространство, като всяка характеристика представлява различно измерение. Може да има стотици измерения, ако има много данни.

Помислете за електронни таблици на Excel, с колони, представляващи характеристики, и редове, представляващи елементи от данни. Когато има твърде много измерения, ML алгоритмите може да работят лошо и визуализация на данни може да стане трудно.

Така че е логично да се ограничат характеристиките или размерите и да се предаде само уместна информация. Намаляването на размерността е точно това. Той позволява управляемо количество входни данни, без да се компрометира целостта на набора от данни.

Анализ на основни компоненти (PCA)

Анализът на главните компоненти е подход за намаляване на размерността. Използва се за минимизиране на броя на характеристиките в огромни набори от данни, което води до по-голяма простота на данните, без да се жертва точността.

Компресирането на набор от данни се осъществява чрез метод, известен като извличане на характеристики. Това показва, че елементи от оригиналния набор са смесени в нов, по-малък. Тези нови черти са известни като първични компоненти.

Разбира се, има допълнителни алгоритми, които можете да използвате във вашите приложения за обучение без надзор. Изброените по-горе са само най-разпространените, поради което са разгледани по-подробно.

Приложение на неконтролирано обучение

- Методите за обучение без надзор се използват за задачи за визуално възприятие, като например разпознаване на обекти.

- Машинното обучение без надзор дава критични аспекти на системите за медицински изображения, като идентификация, класификация и сегментиране на изображения, които се използват в радиологията и патологията за бързо и надеждно диагностициране на пациенти.

- Обучението без надзор може да помогне за идентифициране на тенденции в данните, които могат да се използват за създаване на по-ефективни стратегии за кръстосани продажби, като се използват минали данни за поведението на потребителите. По време на процеса на плащане това се използва от онлайн бизнесите, за да предложат правилните добавки на клиентите.

- Методите за обучение без надзор могат да пресеят огромни обеми данни, за да открият отклонения. Тези аномалии могат да предизвикат известие за неправилно функциониращо оборудване, човешка грешка или пробиви в сигурността.

Проблеми с обучението без надзор

Ученето без надзор е привлекателно по различни начини, от потенциала да се намерят важни прозрения до данни за избягване на скъпоструващо етикетиране на данни операции. Въпреки това, има няколко недостатъка при използването на тази стратегия за обучение модели за машинно обучение че трябва да сте наясно. Ето няколко примера.

- Тъй като на входните данни липсват етикети, които служат като ключове за отговор, резултатите от моделите на обучение без надзор могат да бъдат по-малко точни.

- Неконтролираното обучение често работи с масивни набори от данни, което може да увеличи изчислителната сложност.

- Подходът изисква потвърждение на изхода от хора, вътрешни или външни специалисти по предмета на запитването.

- Алгоритмите трябва да изследват и изчисляват всеки възможен сценарий по време на фазата на обучение, което отнема известно време.

Заключение

Ефективното използване на данни е ключът към установяването на конкурентно предимство на определен пазар.

Можете да сегментирате данните с помощта на неконтролирани алгоритми за машинно обучение, за да изследвате предпочитанията на вашата целева аудитория или да определите как дадена инфекция реагира на конкретно лечение.

Има няколко практически приложения и учени по данни, инженери и архитекти могат да ви помогнат при определянето на вашите цели и разработването на уникални ML решения за вашата компания.

Оставете коментар