Google het deurgaans aan die voorpunt van KI-navorsing gebly, deur sy groot hulpbronne te benut en 'n aansienlike aantal top-talent-ingenieurs in diens te neem. Wat taalmodelle betref, was Google se pogings egter laat.

Met die tegnologiereus Microsoft wat reeds voordeel trek uit 'n vrugbare vennootskap met OpenAI, het Google geen ander keuse gehad as om in te haal nie.

By vanjaar se Google I/O-konferensie het die maatskappy sy antwoord op die generatiewe KI-wapenwedloop aangekondig: PaLM 2. Sal hierdie nuwe model in prestasie meet langs OpenAI se GPT-4?

Wat is PaLM 2?

Google beskryf PALM 2 as 'n moderne taalmodel wat verbeter op hul bestaande PaLM-model wat die eerste keer in 2022 aangekondig is. Soortgelyk aan ander taalmodelle is PaLM 2 in staat om verskeie teksgenereringstake uit te voer, soos PaLM in staat is tot 'n wye reeks take , insluitend die beantwoording van vrae, vertaling van teks, kode genereer, en baie meer.

Toetse het getoon dat die PaLM 2 reeds aansienlike verbeterings toon, wat beter as die PaLM-model presteer terwyl dit 'n baie laer aantal parameters gebruik.

PaLM 2 is 'n familie van modelle

Soos ander taalmodelle, is die PaLM 2-projek eintlik 'n familie van modelle wat in grootte wissel. Google sal die PaLM 2-model in vier groottes verskaf: Gecko, Otter, Bison en Unicorn.

Die verskeidenheid in groottes maak dit maklik om PaLM 2 in verskeie gebruiksgevalle te ontplooi. Byvoorbeeld, die Gecko-model is liggewig genoeg dat die hele model in 'n mobiele toestel kan pas en selfs vanlyn kan hardloop.

PaLM 2 se opleidingsdatastel

Een van die belangrikste aspekte van 'n suksesvolle taalmodel is die opleidingsdatastel. Die opleidingdatastel moet divers genoeg wees om die model toe te laat om 'n diepgaande begrip te hê van die onderwerp waarvoor dit ontwerp is.

Vir groot taalmodelle (LLM's) is daar tipies geen spesifieke onderwerp waarop die model moet oefen nie. LLM's word eerder gebou om algemene doelmodelle te wees wat geskik moet wees om 'n groot aantal take uit te voer. Hierdie modelle gebruik groot tekstuele datastelle wat 'n groot gedeelte van die web vaslê asook gepubliseerde verwysingsmateriaal, literatuur en selfs bronkode.

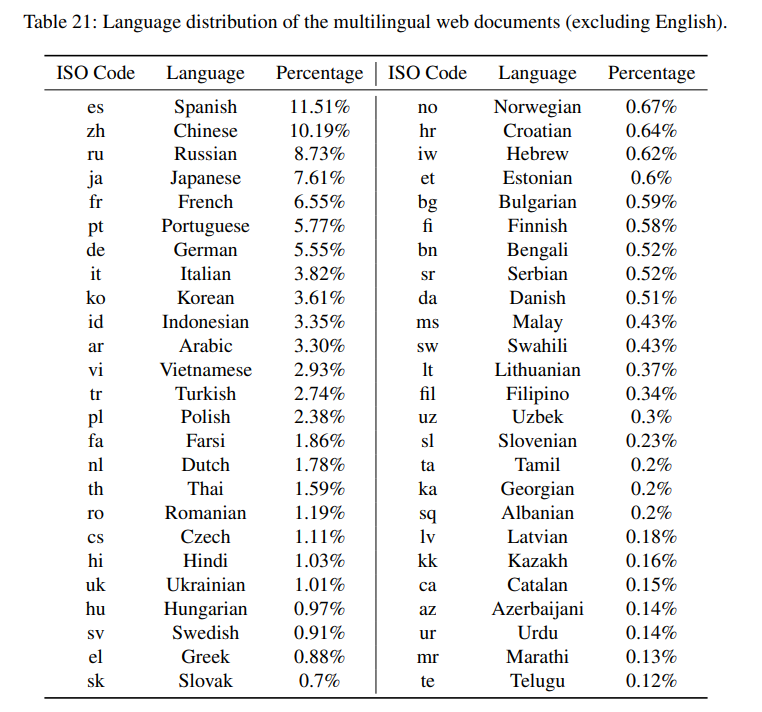

Die belangrikste verskil tussen PaLM 2 se opleidingdatastel en ander modelle is die insluiting van 'n hoër persentasie nie-Engelse data. Volgens hul tegniese verslag, die uitbreiding van die datastel om nie-Engelse tekste in te sluit, stel die model bloot aan 'n groter verskeidenheid tale en kulture.

Die PaLM 2-model is ook opgelei op parallelle veeltalige data om die model te help om die vermoë te verkry om van een taal na 'n ander te vertaal. Die data sluit pare teks in waar een inskrywing in Engels is en die ander 'n ekwivalente teks in 'n ander taal is.

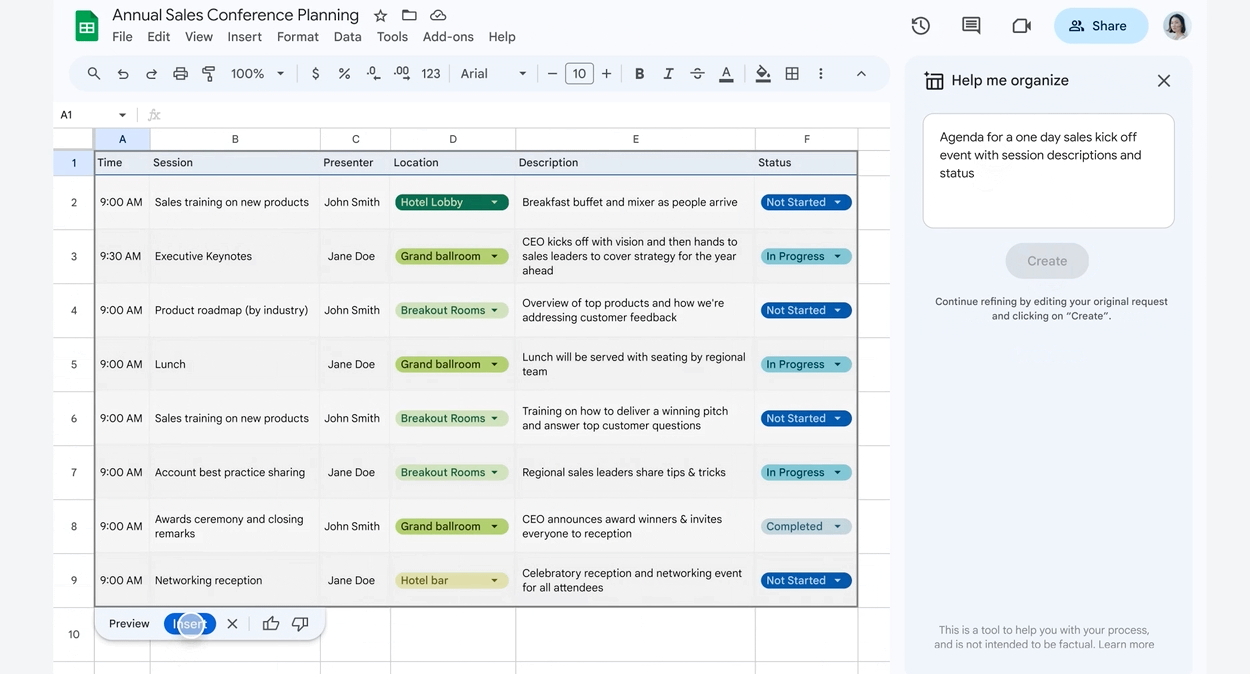

Die tabel hierbo toon die taalverspreiding van die meertalige webdokumente wat gebruik word om PaLM 2 op te lei.

PALM 2 Sleutelkenmerke

Hier is 'n paar van die hoofareas waarin PaLM 2 uitblink in vergelyking met ander taalmodelle.

redenasie

PaLM 2 se datastel bevat bronne soos wetenskaplike referate en webinhoud met wiskundige uitdrukkings. Dit gee die model verbeterde vermoëns in wiskunde, gesonde verstand redenering en logika.

Navorsers het die model se wiskundige redenasievermoë op laerskool- en hoërskoolwiskundevrae getoets waar dit vergelykbare resultate met GPT-4 se wiskundevermoëns toon.

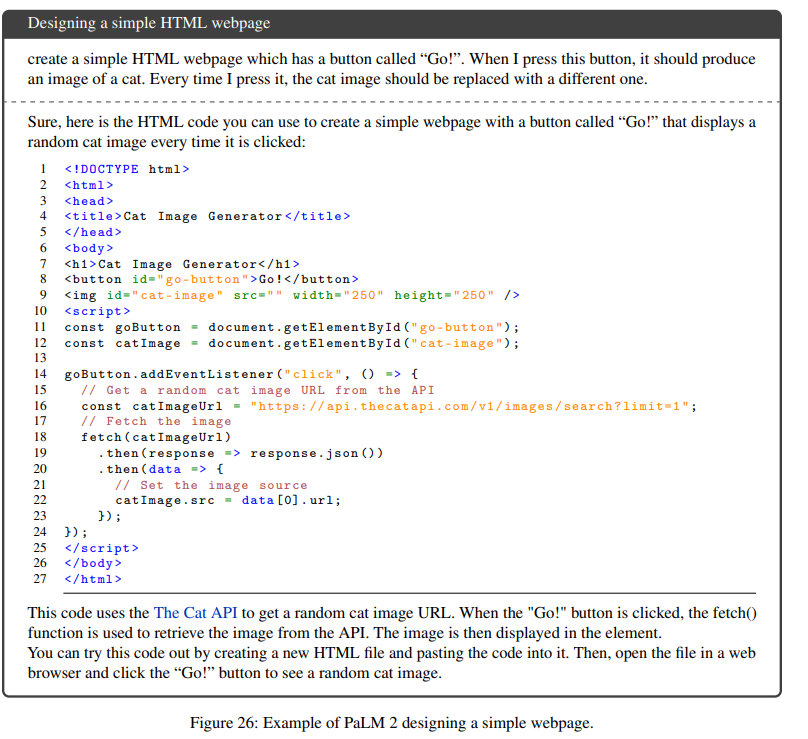

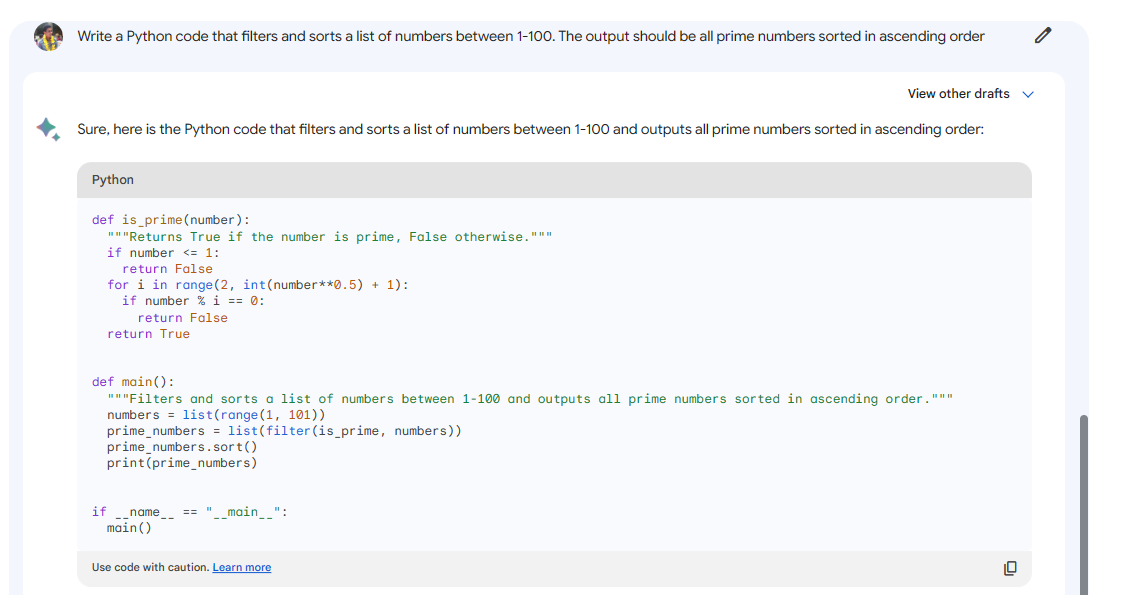

Kodering

PaLM 2 se opleidingsdata gee dit ook die vermoë om kode in 'n verskeidenheid programmeertale te genereer. Die PALM 2-span het 'n koderingspesifieke PaLM 2-model genaamd PaLM 2-S* geskep wat op 'n kodeswaar veeltalige datastel opgelei is.

Nie net is die model in staat om kode te genereer nie, maar dit is ook in staat om take te hanteer wat verskeie tale behels. Byvoorbeeld, jy kan vir PaLM 2 vra om 'n Python-sorteerfunksie te skep wat reël-vir-reël opmerkings in Spaans byvoeg.

Veeltaligheid

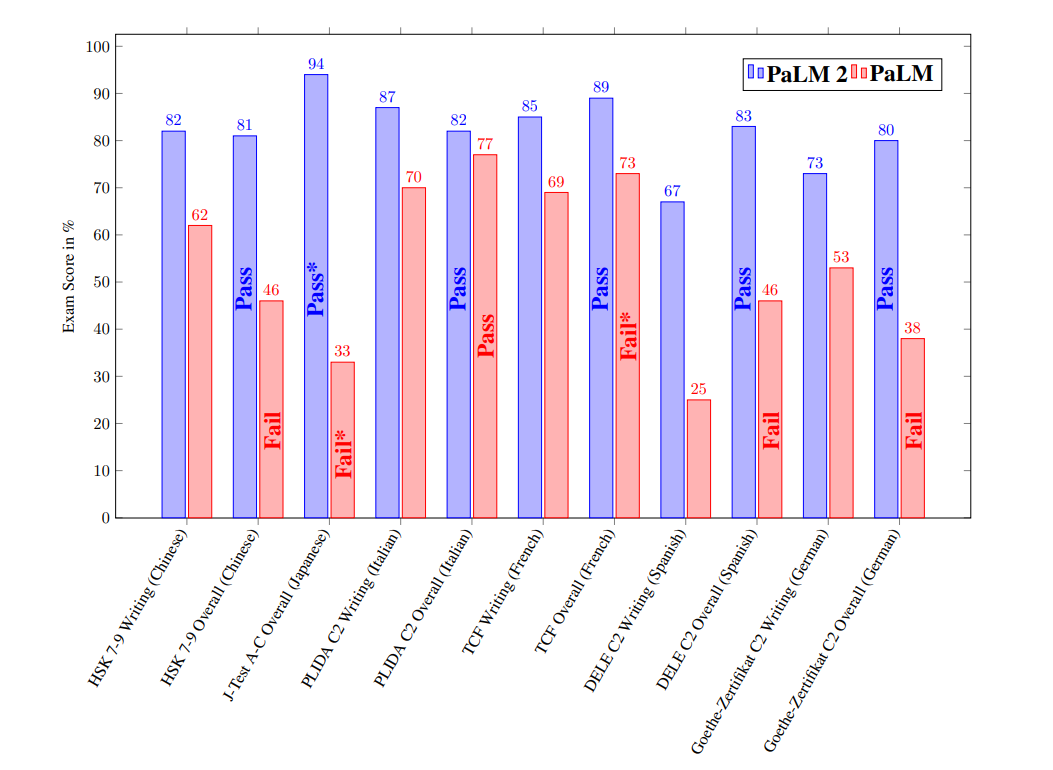

Aangesien die model opgelei is op 'n datastel wat meer as 100 tale insluit, toon PaLM 2 vaardigheid in die verstaan, generering en vertaling van teks oor verskeie tale.

Om veeltaligheid te toets, het die navorsers die model op verskeie taalvaardigheidstoetse in verskillende tale getoets. Die resultate toon dat PaLM 2 nie net beter as PaLM presteer nie, maar ook 'n slaagsyfer vir elke geëvalueerde taal behaal het.

PaLM 2 wys ook sy veeltalige vermoëns deur sy vermoë om idiome in verskillende tale te verstaan, grappies te verduidelik, tikfoute reg te stel, en kan selfs leer hoe om formele teks na spreektaal om te skakel.

PaLM 2 dryf Google-produkte aan

Google trek reeds voordeel uit PaLM 2 se vooruitgang deur die model met ander produkte te integreer.

Bard

Die model se vermoë om veeltalige take te hanteer, dryf nou Google s'n aan Bard eksperiment aangesien dit uitbrei na meer as 180 lande en gebiede.

Bard gebruik nou ook PaLM 2 se koderingsvermoëns om te help met programmering en sagteware-ontwikkelingstake soos kodegenerering en kodeontfouting.

Duet AI vir Google Workspace

Google beplan ook om generatiewe KI-kenmerke by sy Google Workspace-groep toepassings by te voeg. Gmail en Dokumente sal binnekort 'n kenmerk insluit genaamd Duet AI wat die gebruiker sal help om hul antwoorde en skryfwerk op te stel deur aanwysings te gebruik.

Duet AI sal gebruikers ook toelaat om pasgemaakte planne in Google Blaaie vir take en projekte te skep, gebaseer op versoeke wat deur die gebruiker gegee word.

Gevolgtrekking

Google hoop sekerlik om die gaping in die mark van KI-taalgereedskap te verklein met hul PaLM 2-taalmodel. Alhoewel die model se API nog nie publiek beskikbaar is nie, toon die resultate van hul navorsing dat die model mededingend genoeg is om by GPT-4 se prestasie te pas.

Met Google se bestaande gebruikersbasis, het hulle beslis die voordeel van massiewe aanpassing as hul KI by hul dienste geïntegreer word, soos hul soekenjin of hul reeks produktiwiteitnutsmiddels.

Lewer Kommentaar